在使用HuggingFace的transformer下的BertForMaskedLM进行预训练语言模型的load时,bert会占用很大的显存。

这里可以考虑使用TinyBERT,速度和显存上都能得到很大的优化。

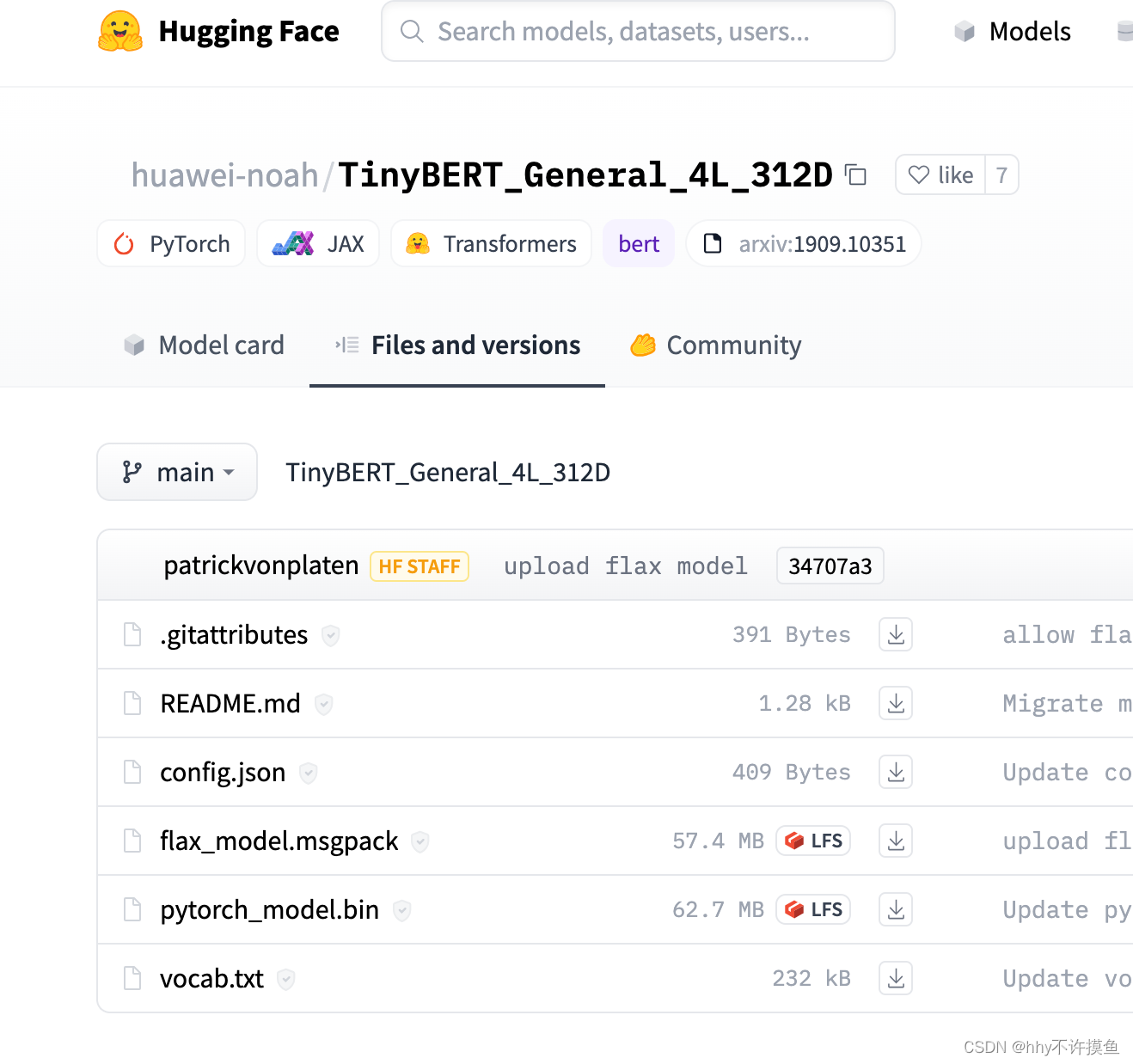

具体的方法进入https://huggingface.co/huawei-noah/TinyBERT_General_4L_312D/tree/main链接中,download其中的model参数,以及词典表、config。

在load模型时load这些文件就可以了。

使用Hugging Face预训练Bert处理下游任务显存占用过多

最新推荐文章于 2024-02-21 12:43:59 发布

124

124

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?