hadoop spark 进行文件写入时,调整分区

两种方式:

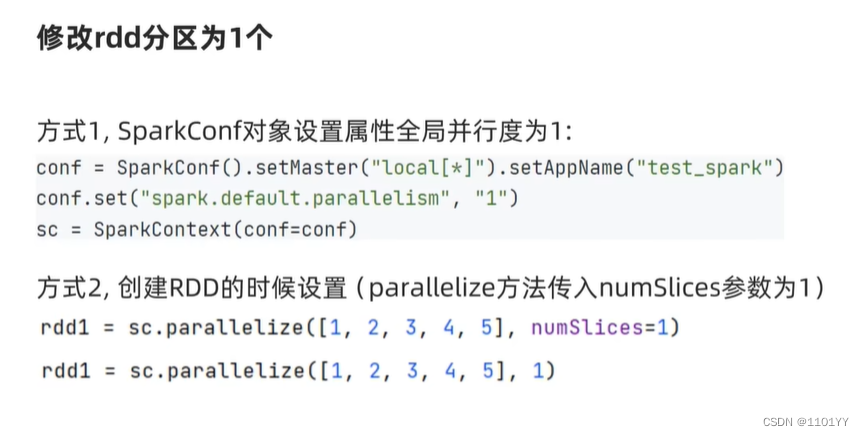

# 修改rdd分区为1个

#方式1,SparkConf对象设置属性全局并行度为1:

conf = SparkConf().setMaster("local[*]").setAppName("test_spark")

conf.set("spark.default.parallelism","1")

sc = SparkContext(conf=conf)

#方式2,创建RDD的时候设置(parallelize方法传入numslices参数为1)

rdd1 = sc.parallelize([1, 2,3,4,5], numSlices=1)

rdd1 = sc.parallelize([1,2,3,4,5],1)

7284

7284

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?