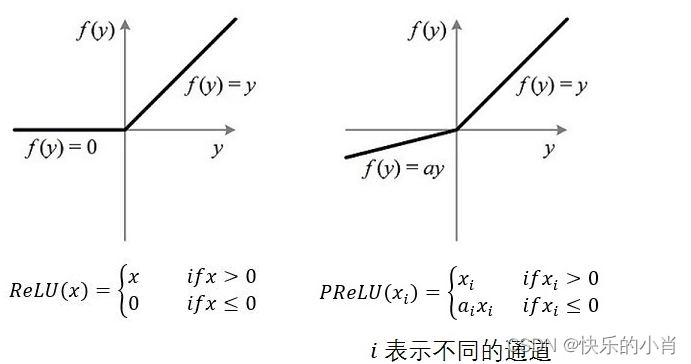

首先介绍PReLU激活函数,如图中所示,其中a 是一个可以学习的参数(即可变)

当a=0时,PReLU就变成了ReLU。

当a(a!=0)是一个固定值时,PReLU就变成了LReLU。

实验表明LReLU相较 ReLU对准确率几乎没有提高,LReLU目的是为了避免零梯度。

PReLU的参数 a 可以自适应学习,从而可以获得不同通道的专门的激活函数,可以提高准确率。

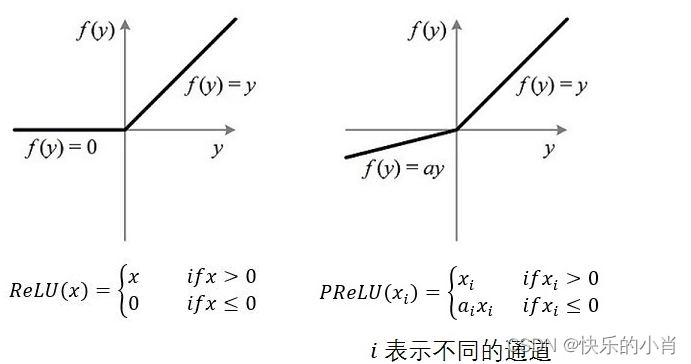

首先介绍PReLU激活函数,如图中所示,其中a 是一个可以学习的参数(即可变)

当a=0时,PReLU就变成了ReLU。

当a(a!=0)是一个固定值时,PReLU就变成了LReLU。

实验表明LReLU相较 ReLU对准确率几乎没有提高,LReLU目的是为了避免零梯度。

PReLU的参数 a 可以自适应学习,从而可以获得不同通道的专门的激活函数,可以提高准确率。

4000

4000

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?