数据挖掘,计算机网络、操作系统刷题笔记44

2022找工作是学历、能力和运气的超强结合体,遇到寒冬,大厂不招人,可能很多算法学生都得去找开发,测开

测开的话,你就得学数据库,sql,oracle,尤其sql要学,当然,像很多金融企业、安全机构啥的,他们必须要用oracle数据库

这oracle比sql安全,强大多了,所以你需要学习,最重要的,你要是考网络警察公务员,这玩意你不会就别去报名了,耽误时间!

考网警特招必然要考操作系统,计算机网络,由于备考时间不长,你可能需要速成,我就想办法自学速成了,课程太长没法玩

刷题系列文章

【1】Oracle数据库:刷题错题本,数据库的各种概念

【2】操作系统,计算机网络,数据库刷题笔记2

【3】数据库、计算机网络,操作系统刷题笔记3

【4】数据库、计算机网络,操作系统刷题笔记4

【5】数据库、计算机网络,操作系统刷题笔记5

【6】数据库、计算机网络,操作系统刷题笔记6

【7】数据库、计算机网络,操作系统刷题笔记7

【8】数据库、计算机网络,操作系统刷题笔记8

【9】操作系统,计算机网络,数据库刷题笔记9

【10】操作系统,计算机网络,数据库刷题笔记10

【11】操作系统,计算机网络,数据库刷题笔记11

【12】操作系统,计算机网络,数据库刷题笔记12

【13】操作系统,计算机网络,数据库刷题笔记13

【14】操作系统,计算机网络,数据库刷题笔记14

【15】计算机网络、操作系统刷题笔记15

【16】数据库,计算机网络、操作系统刷题笔记16

【17】数据库,计算机网络、操作系统刷题笔记17

【18】数据库,计算机网络、操作系统刷题笔记18

【19】数据库,计算机网络、操作系统刷题笔记19

【20】数据库,计算机网络、操作系统刷题笔记20

【21】数据库,计算机网络、操作系统刷题笔记21

【22】数据库,计算机网络、操作系统刷题笔记22

【23】数据库,计算机网络、操作系统刷题笔记23

【24】数据库,计算机网络、操作系统刷题笔记24

【25】数据库,计算机网络、操作系统刷题笔记25

【26】数据库,计算机网络、操作系统刷题笔记26

【27】数据库,计算机网络、操作系统刷题笔记27

【28】数据库,计算机网络、操作系统刷题笔记28

【29】数据库,计算机网络、操作系统刷题笔记29

【30】数据库,计算机网络、操作系统刷题笔记30

【31】数据库,计算机网络、操作系统刷题笔记31

【32】数据库,计算机网络、操作系统刷题笔记32

【33】数据库,计算机网络、操作系统刷题笔记33

【34】数据库,计算机网络、操作系统刷题笔记34

【35】数据挖掘,计算机网络、操作系统刷题笔记35

【36】数据挖掘,计算机网络、操作系统刷题笔记36

【37】数据挖掘,计算机网络、操作系统刷题笔记37

【38】数据挖掘,计算机网络、操作系统刷题笔记38

【39】数据挖掘,计算机网络、操作系统刷题笔记39

【40】数据挖掘,计算机网络、操作系统刷题笔记40

【41】数据挖掘,计算机网络、操作系统刷题笔记41

【42】数据挖掘,计算机网络、操作系统刷题笔记42

【43】数据挖掘,计算机网络、操作系统刷题笔记43

文章目录

- 数据挖掘,计算机网络、操作系统刷题笔记44

-

- 数据挖掘分析应用:特征数值化

- 数值化:独热编码

- 正规化,规范化,将向量长度规范化到1

- 特征降维:PAC主成分分析

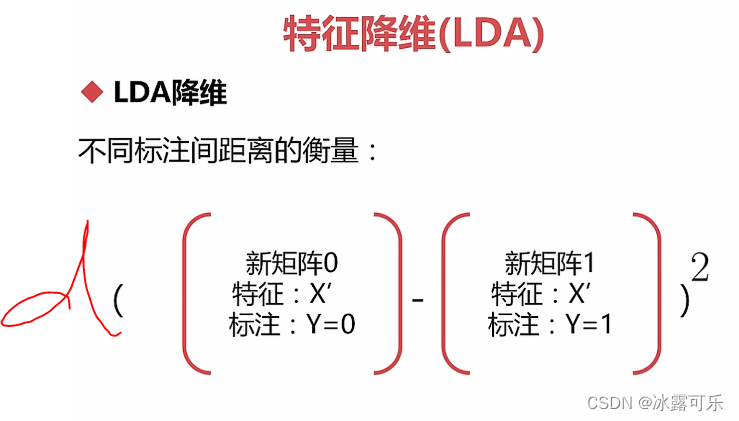

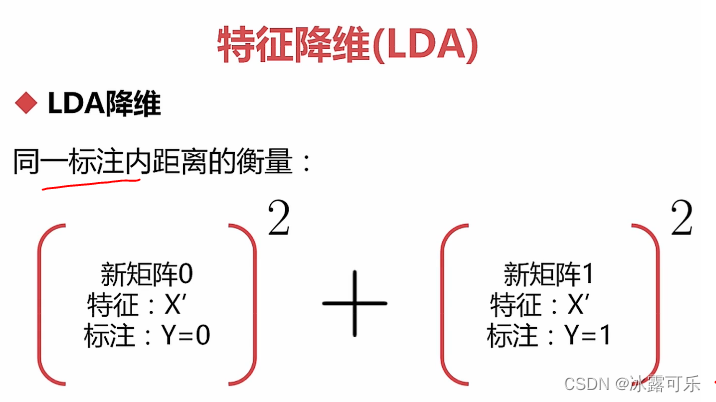

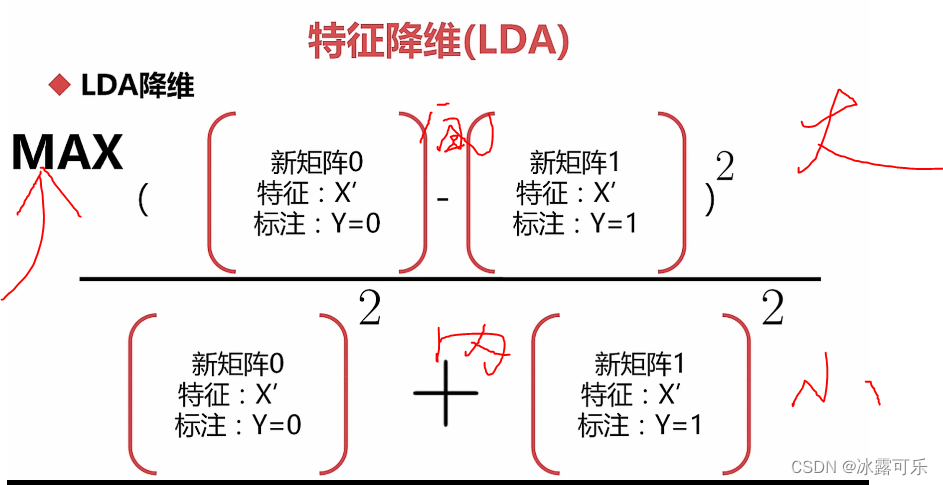

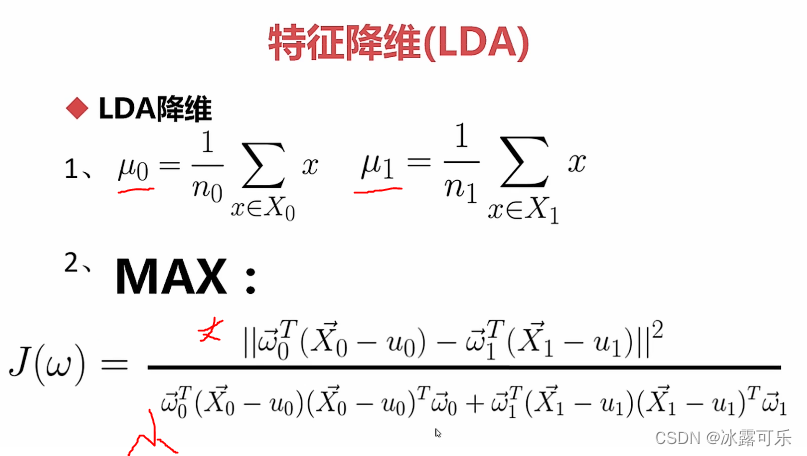

- 特征降维:LDA线性判别式分析

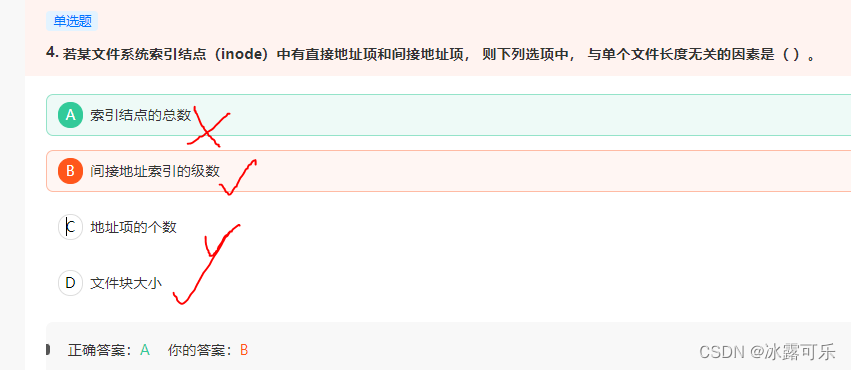

- Linux使用索引节点来记录文件信息,作用类似于Windows下的文件分配表。索引节点是一个结构,它包含了一个文件的长度、创建及修改时间、权限、所属关系、磁盘中的位置等信息

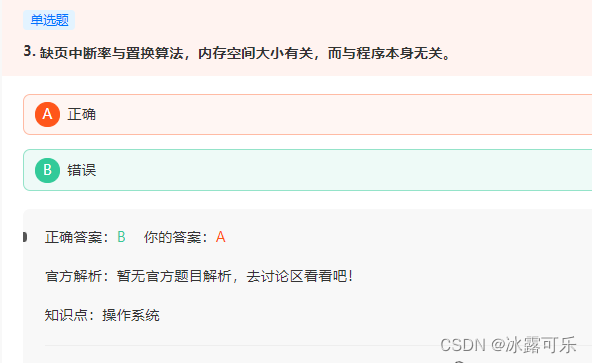

- 缺页率主要受以下几个因素影响——1、页面大小 2、页面置换算法 3、进程所分配的物理块 4、程序的固有特性

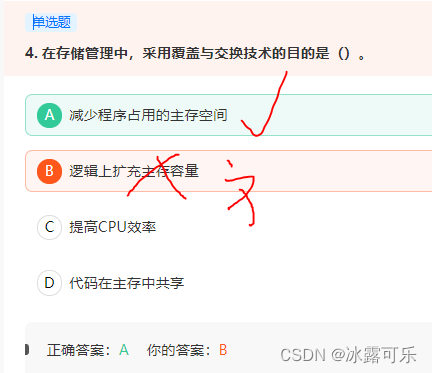

- 减少占用的主存空间是最终目的;逻辑上扩充主存容量可以看作是方法。

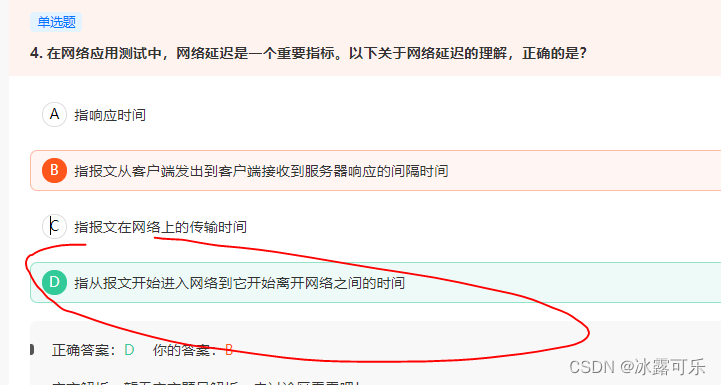

- 在网络应用测试中,网络延迟是一个重要指标。以下关于网络延迟的理解,正确的是?

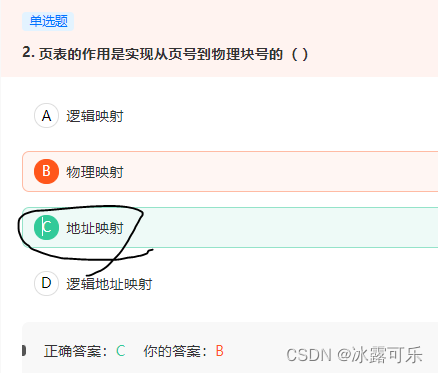

- 页表的作用是实现从页号到物理块号的( )

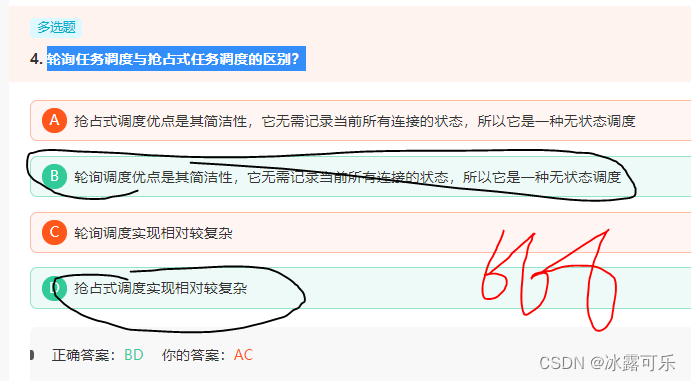

- 轮询任务调度与抢占式任务调度的区别?

- 总结

文章目录

- 数据挖掘,计算机网络、操作系统刷题笔记44

- 数据挖掘分析应用:特征数值化

- 数值化:独热编码

- 正规化,规范化,将向量长度规范化到1

- 特征降维:PAC主成分分析

- 特征降维:LDA线性判别式分析

- Linux使用索引节点来记录文件信息,作用类似于Windows下的文件分配表。索引节点是一个结构,它包含了一个文件的长度、创建及修改时间、权限、所属关系、磁盘中的位置等信息

- 缺页率主要受以下几个因素影响——1、页面大小 2、页面置换算法 3、进程所分配的物理块 4、程序的固有特性

- 减少占用的主存空间是最终目的;逻辑上扩充主存容量可以看作是方法。

- 在网络应用测试中,网络延迟是一个重要指标。以下关于网络延迟的理解,正确的是?

- 页表的作用是实现从页号到物理块号的( )

- 轮询任务调度与抢占式任务调度的区别?

- 总结

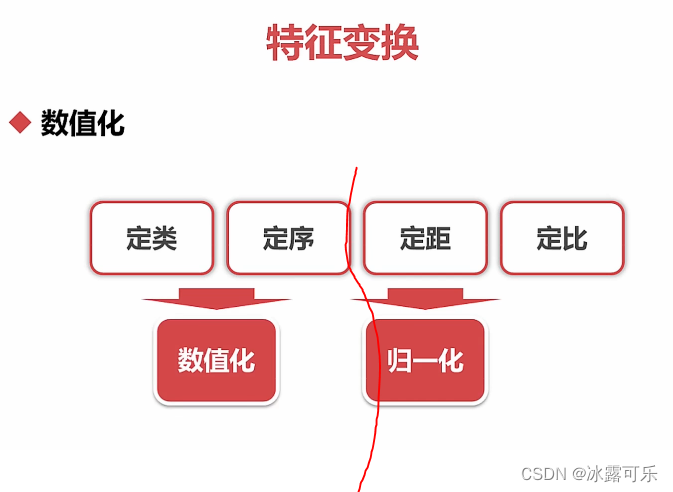

数据挖掘分析应用:特征数值化

非数值特征–>数值

定类,定序,定距,定比

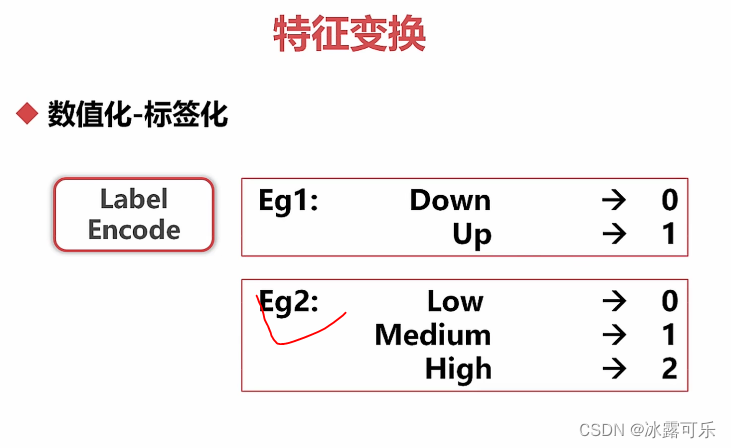

标签化

label encode编码

012啥的编码即可

这很容易,很简单

当全取值很多,咋搞???

但有一个问题,你这低中高,咋就知道他们距离是1呢????

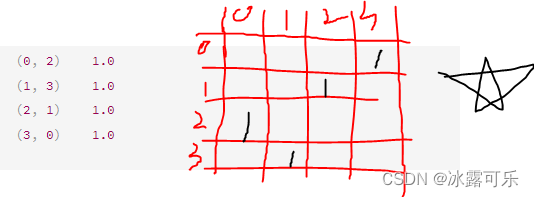

数值化:独热编码

用一个向量表示,某一个位存在表示1,否则0

扩展维度

1维特征编程4维

但是这种吧,当特征取值范围空间很大,那就gg

太稀疏了

没意义

想办法

代码演示:

def f3():

from sklearn.preprocessing import LabelEncoder, OneHotEncoder

# 标签化

x = np.array(['Down', 'Up', 'Up', 'Down'])

lae = LabelEncoder()

print(lae.fit_transform(x.reshape(-1, 1))) # 1列

# 独热编码

if __name__ == '__main__':

f3()

[0 1 1 0]

Process finished with exit code 0

x = np.array(['low', 'meidum', 'Up', 'Down'])

lae = LabelEncoder()

print(lae.fit_transform(x.reshape(-1, 1))) # 1列

[2 3 1 0]

你看duud

d编码为0

u编码为1

这好说吧,就两类,很简单的

def f3():

from sklearn.preprocessing import LabelEncoder, OneHotEncoder

# 标签化

x = np.array(['Down', 'Up', 'Up', 'Down'])

x = np.array(['low', 'meidum', 'Up', 'Down'])

lae = LabelEncoder()

# print(lae.fit_transform(x.reshape(-1, 1))) # 1列

# 独热编码

one = OneHotEncoder()

print(one.fit_transform(x.reshape(-1, 1))) # 看看这种呢?

if __name__ == '__main__':

f3()

(0, 2) 1.0

(1, 3) 1.0

(2, 1) 1.0

(3, 0) 1.0

Process finished with exit code 0

看懂结果了吗???

他是一个系数矩阵的表示方法

1的地方,编码位置,告诉你,其余的都是0

这里就是说四行四列

0行2列 1

这样的编码,独热编码

懂?

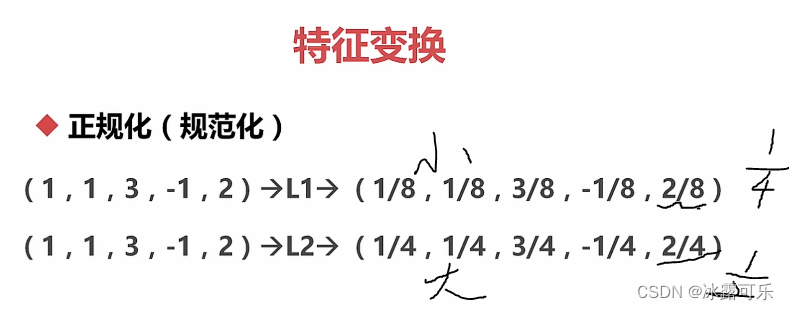

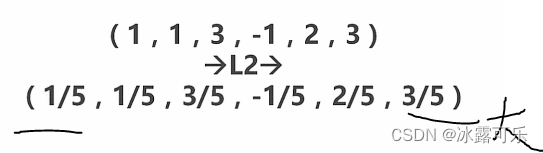

正规化,规范化,将向量长度规范化到1

L1正规化

L2?

特征可以直接正规化

每个对象的各个特征的表示,特征矩阵的行

模型参数也可以正规化

def f4():

from sklearn.preprocessing import Normalizer

x = np.array([[1,1,3,-1,2]])

nor = Normalizer(norm='l1')

nor2 = Normalizer(norm='l2')

print(nor.fit_transform(x))

print(nor2.fit_transform(x))

if __name__ == '__main__':

f4()

[[ 0.125 0.125 0.375 -0.125 0.25 ]]

[[ 0.25 0.25 0.75 -0.25 0.5 ]]

Process finished with exit code 0

输入[[]]

外面表示行上的维度,里面就是一个

print(np.array([[1,1,1], [1,1,1]]))

[[1 1 1]

[1 1 1]]

Process finished with exit code 0

里面的矩阵就是一行了

所以是行上做的规范化

L2正规化的特征范围大一些哦

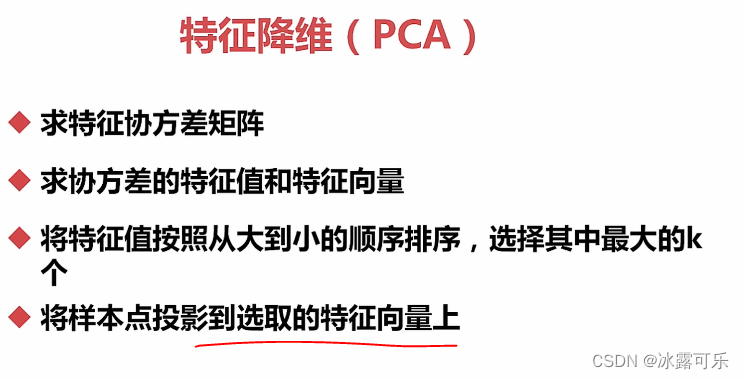

特征降维:PAC主成分分析

根据特征和特征之间的关系来决定

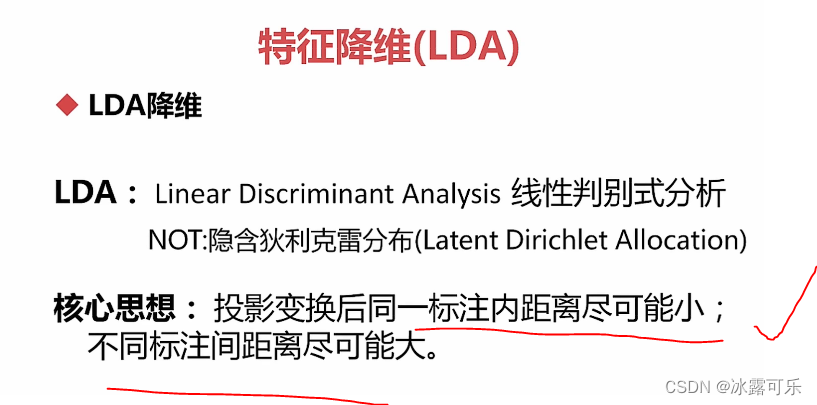

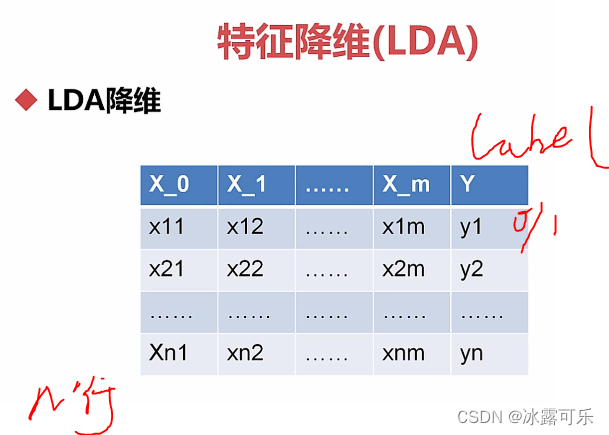

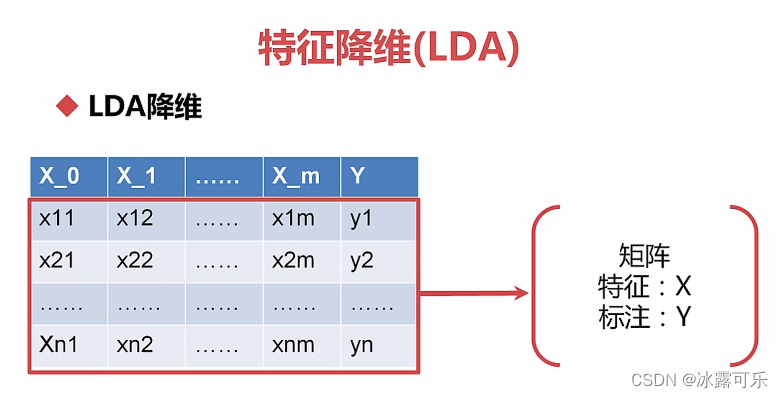

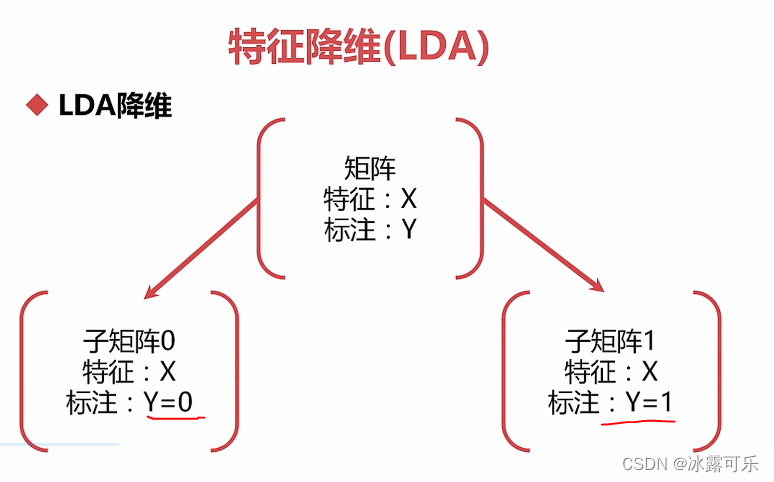

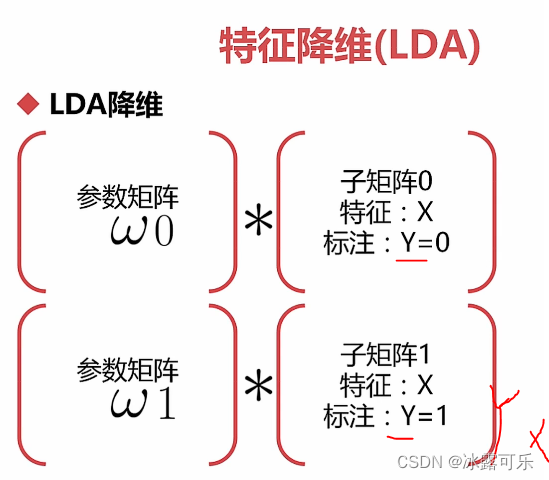

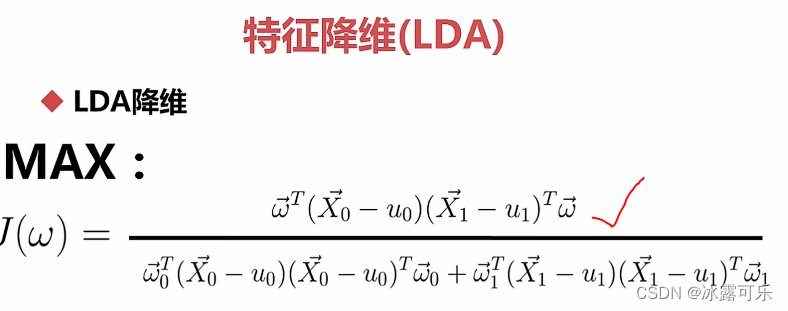

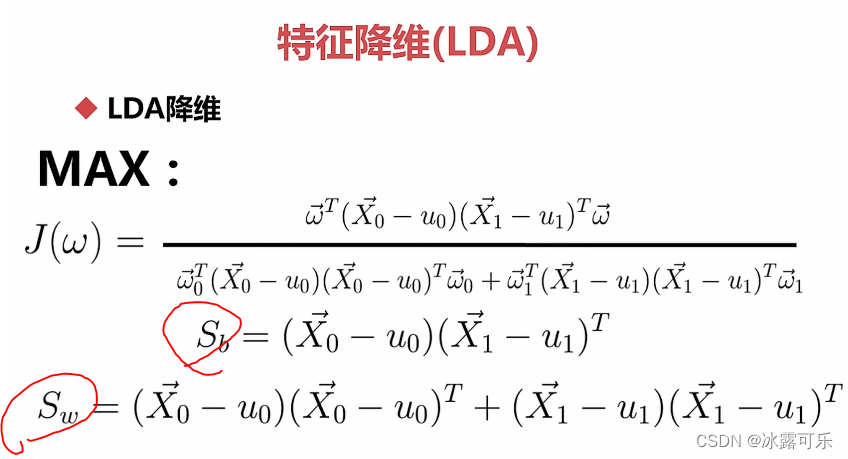

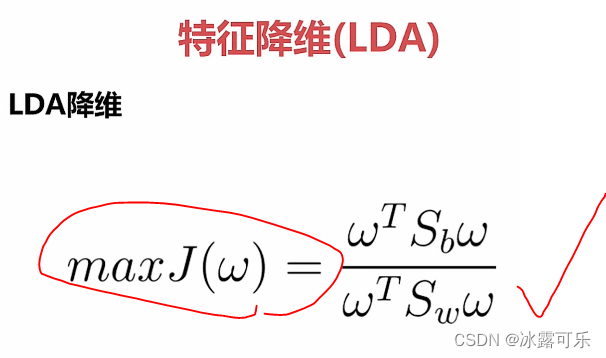

特征降维:LDA线性判别式分析

各自线性变换

标注内距离小

标准间距离大

求w

求均值

最大化一个函数,其变量是w

化简

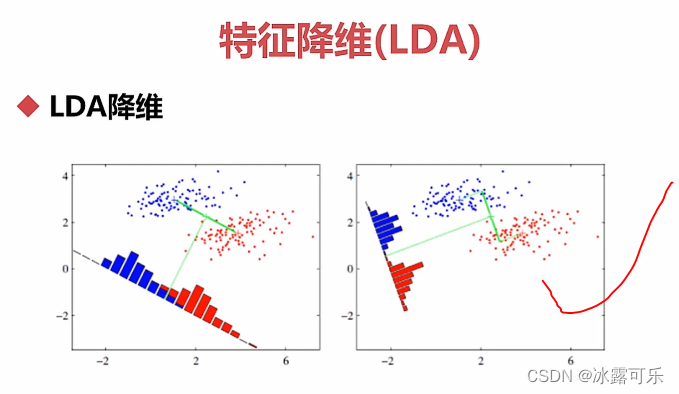

w求出来之后

图2就是最牛逼的分界线,分类的作用美滋滋

代码玩

def f5():

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

# LDA

x = np.array([[-1,-1],[-2,-1],[-3,-2],[1,1],[2,1],[3,2]]) # 矩阵

y = np.array([1,1,1,2,2,2]) # 标注

print(x)

lda = LinearDiscriminantAnalysis(n_components=1)

print(lda.fit_transform(x, y)) # 降维到1

if __name__ == '__main__':

f5()

[[-1 -1]

[-2 -1]

[-3 -2]

[ 1 1]

[ 2 1]

[ 3 2]]

[[-1.73205081]

[-1.73205081]

[-3.46410162]

[ 1.73205081]

[ 1.73205081]

[ 3.46410162]]

Process finished with exit code 0

降维到1维之后的特征就是这了

def f5():

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

# LDA

x = np.array([[-1,-1],[-2,-1],[-3,-2],[1,1],[2,1],[3,2]]) # 矩阵

y = np.array([1,1,1,2,2,2]) # 标注

# print(x)

lda = LinearDiscriminantAnalysis(n_components=1)

# print(lda.fit_transform(x, y)) # 降维到1

clf = lda.fit(x, y) # 不去做特征转化,而是直接去用作预测模型

print(clf.predict([[0.8, 1]])) # fisher classifer

if __name__ == '__main__':

f5()

[2]

Process finished with exit code 0

这个玩意,可以直接做预测期

而不必展示它的特征降维过程

fit就是训练模型的意思

然后predict即可

Linux使用索引节点来记录文件信息,作用类似于Windows下的文件分配表。索引节点是一个结构,它包含了一个文件的长度、创建及修改时间、权限、所属关系、磁盘中的位置等信息

缺页率主要受以下几个因素影响——1、页面大小 2、页面置换算法 3、进程所分配的物理块 4、程序的固有特性

减少占用的主存空间是最终目的;逻辑上扩充主存容量可以看作是方法。

在网络应用测试中,网络延迟是一个重要指标。以下关于网络延迟的理解,正确的是?

页表的作用是实现从页号到物理块号的( )

轮询任务调度与抢占式任务调度的区别?

总结

提示:重要经验:

1)

2)学好oracle,操作系统,计算机网络,即使经济寒冬,整个测开offer绝对不是问题!同时也是你考公网络警察的必经之路。

3)笔试求AC,可以不考虑空间复杂度,但是面试既要考虑时间复杂度最优,也要考虑空间复杂度最优。

989

989

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?