目录

课后作业

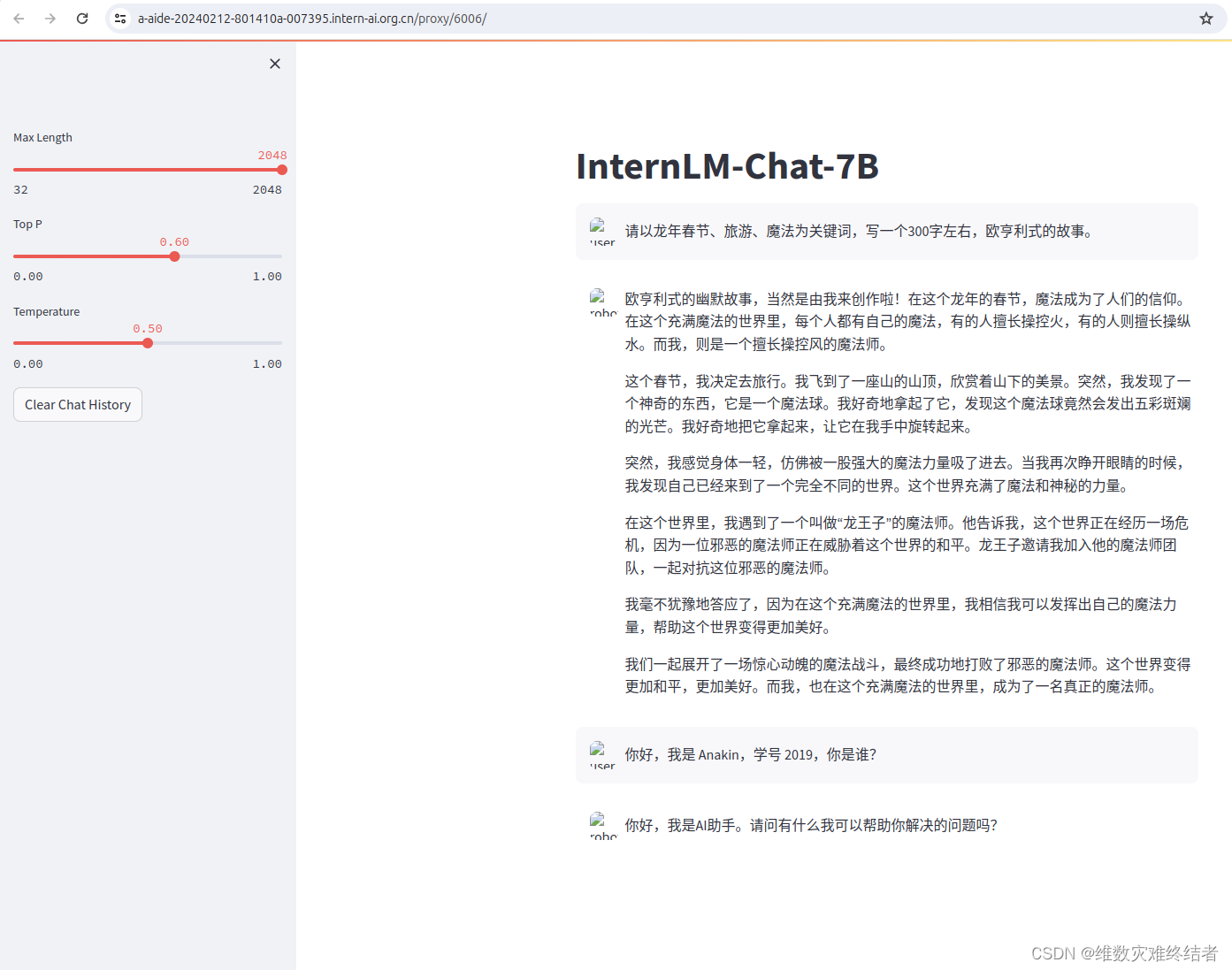

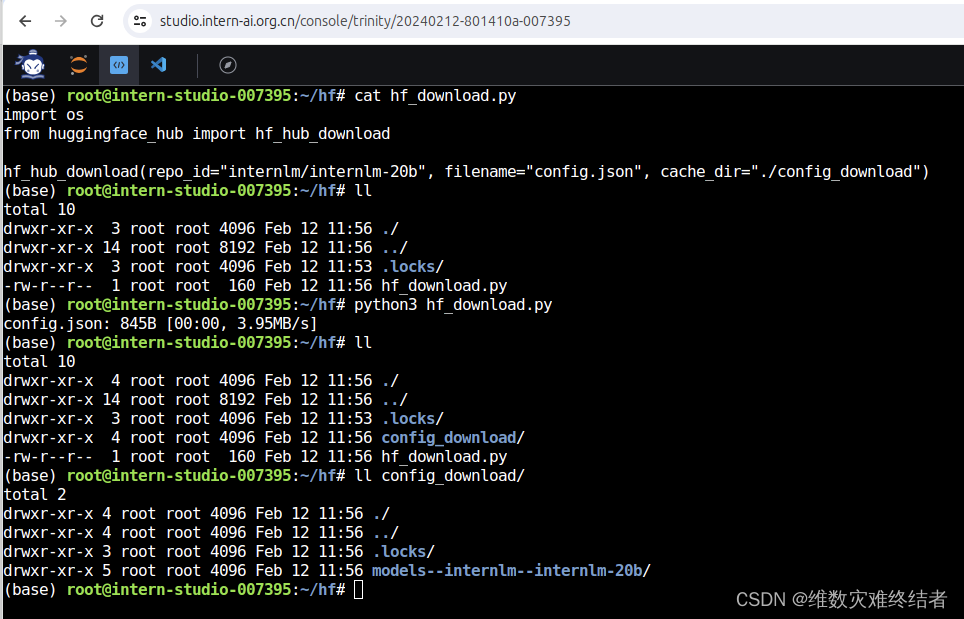

基础作业:

- 使用 InternLM-Chat-7B 模型生成 300 字的小故事(需截图)。

- 熟悉 hugging face 下载功能,使用

huggingface_hubpython 包,下载InternLM-20B的 config.json 文件到本地(需截图下载过程)。

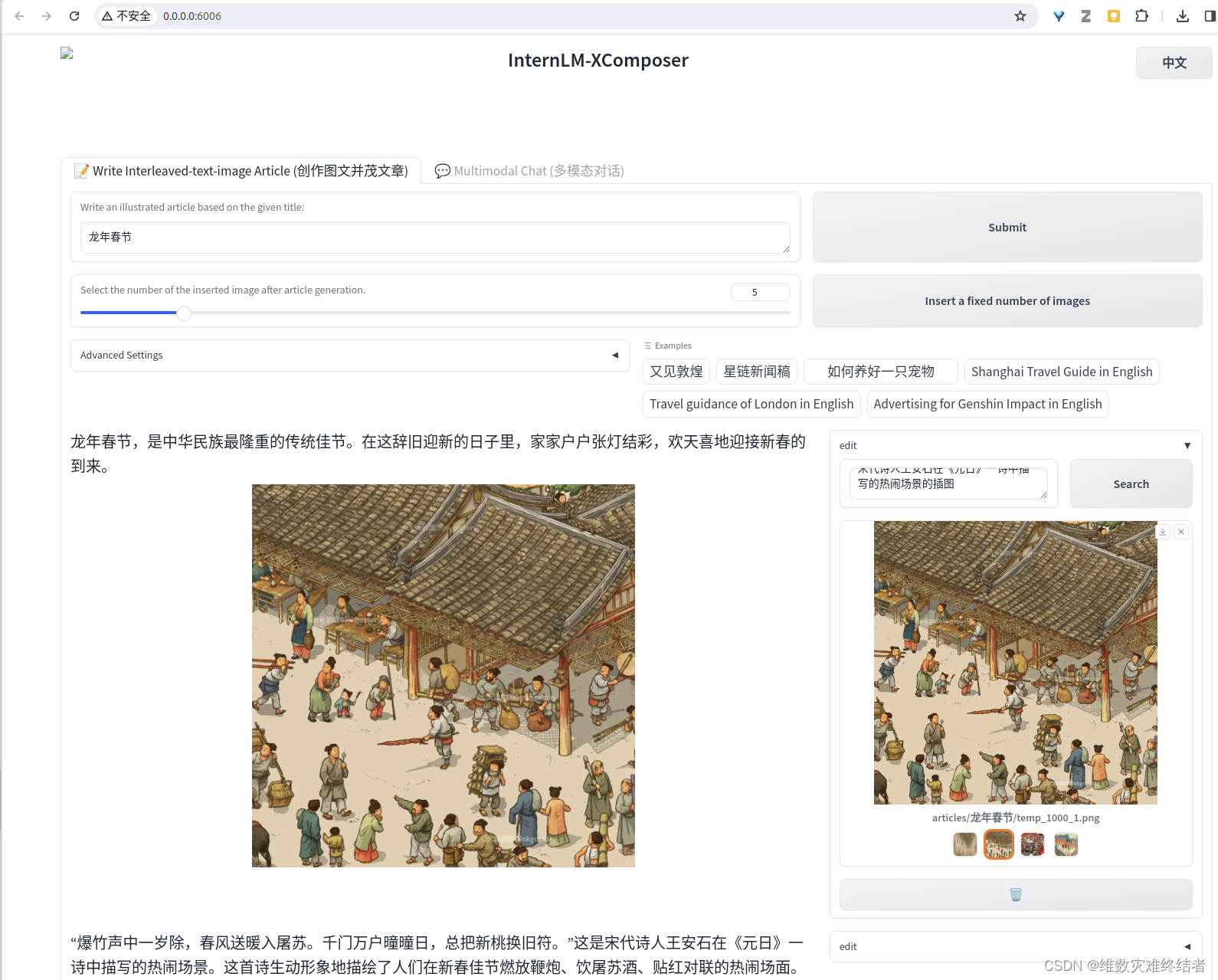

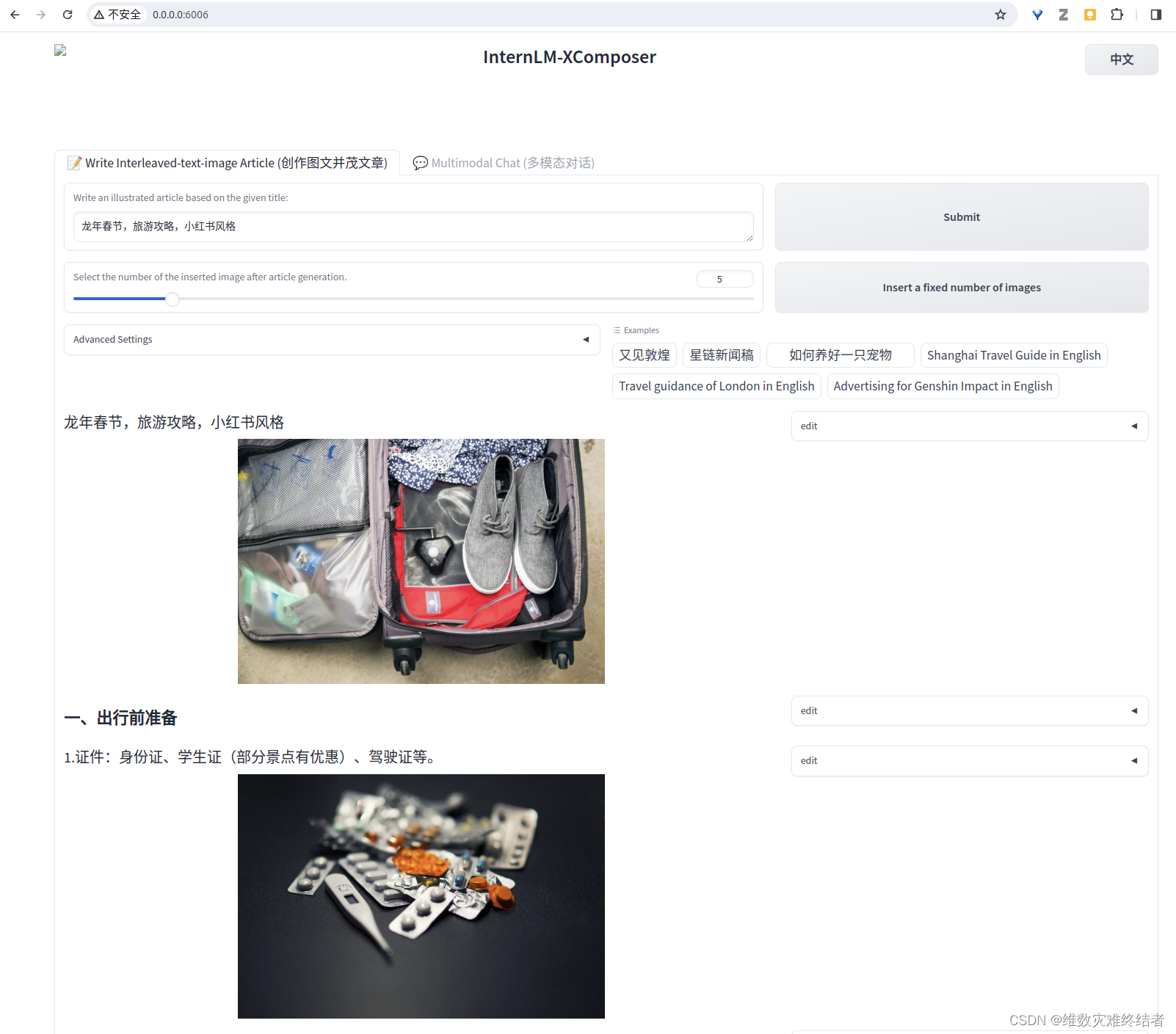

进阶作业:

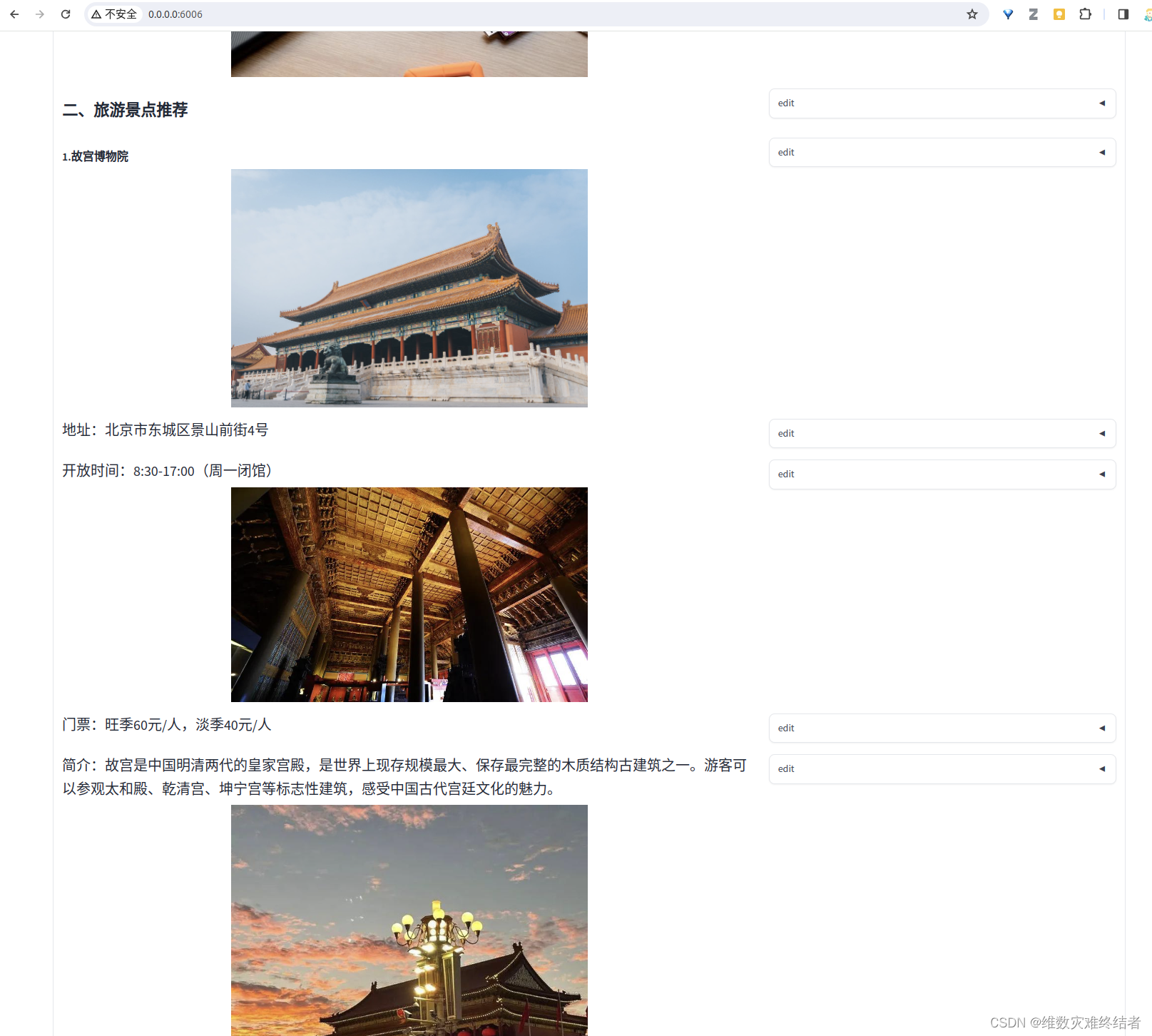

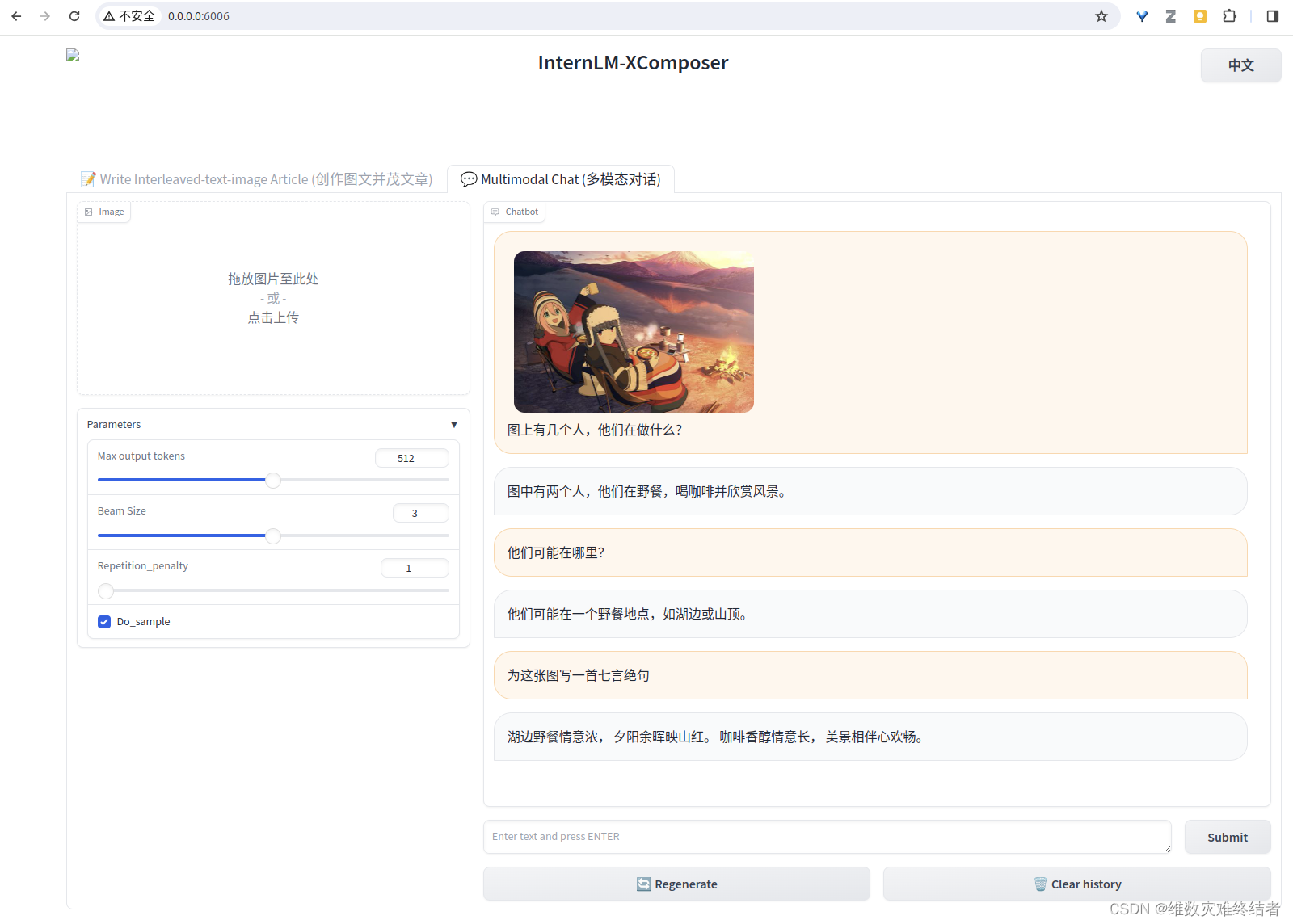

- 完成浦语·灵笔的图文理解及创作部署(需截图)

- 图文创作:

- 图文理解:

- 原图:

- 多模态对话:

- 完成 Lagent 工具调用 Demo 创作部署(需截图)

笔记

大模型的概念:

大模型通常指的是机器学习或人工智能领域中参数数量巨大、拥有庞大计算能力和参数规模的模型。这些模型利用大量数据进行训练,并且拥有数十亿甚至数千亿个参数。大模型的出现和发展得益于增长的数据量、计算能力的提升以及算法优化等因素。这些模型在各种任务中展现出惊人的性能,比如自然语言处理、计算机视觉、语音识别等。这种模型通常采用深度神经网络结构,如 Transformer、BERT、GPT( Generative Pre-trained Transformer )等。

大模型的优势:

大模型的优势在于其能够捕捉和理解数据中更为复杂、抽象的特征和关系。通过大规模参数的学习,它们可以提高在各种任务上的泛化能力,并在未经过大量特定领域数据训练的情况下实现较好的表现。然而,大模型也面临着一些挑战,比如巨大的计算资源需求、高昂的训练成本、对大规模数据的依赖以及模型的可解释性等问题。因此,大模型的应用和发展也需要在性能、成本和道德等多个方面进行权衡和考量。

InternLM 介绍:

InternLM 是一个开源的轻量级训练框架,旨在支持大模型训练而无需大量的依赖。通过单一的代码库,它支持在拥有数千个 GPU 的大型集群上进行预训练,并在单个 GPU 上进行微调,同时实现了卓越的性能优化。在 1024 个 GPU 上训练时,InternLM 可以实现近 90% 的加速效率。

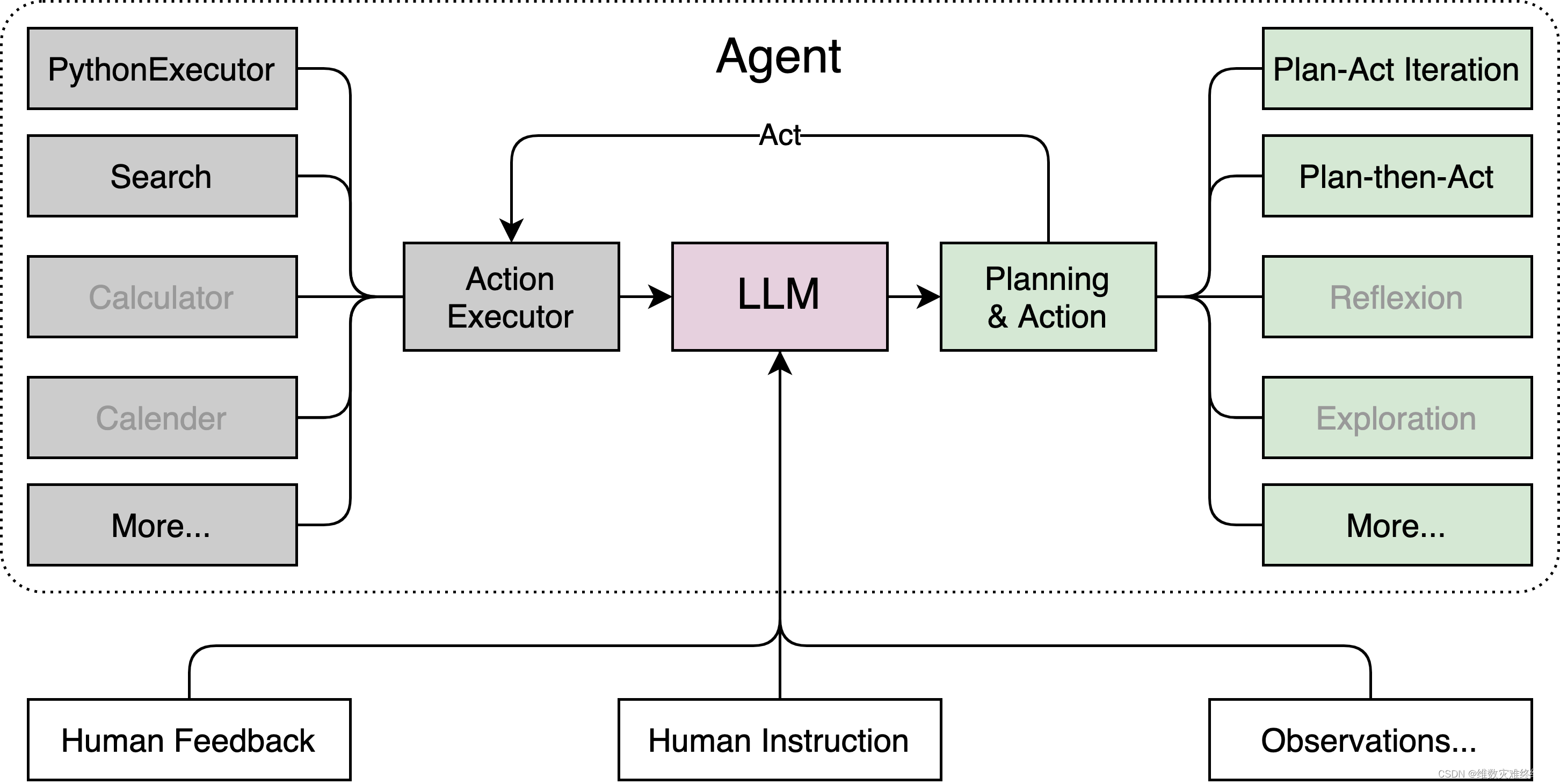

Lagent 框架介绍:

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。通过 Lagent 框架可以更好的发挥 InternLM 的全部性能。

Agent 的架构:

浦语·灵笔(支持多模态对话)介绍:

浦语·灵笔是基于书生·浦语大语言模型研发的视觉-语言大模型,提供出色的图文理解和创作能力,结合了视觉和语言的先进技术,能够实现图像到文本、文本到图像的双向转换。使用浦语·灵笔大模型可以轻松的创作一篇图文推文,也能够轻松识别一张图片中的物体,并生成对应的文本描述。

技术要点:

conda 打包环境

# 把虚拟环境 my_env 打包为 my_env.tar.gz

conda pack -n my_env

# -o 参数指定打包路径和名称,把虚拟环境 my_env 打包为 out_name.tar.gz

conda pack -n my_env -o out_name.tar.gz

# 把某个特定路径的虚拟环境打包为 my_env.tar.gz

conda pack -p /explicit/path/to/my_envSSH 代理转发

ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p 33090作用:将远程服务器上的127.0.0.1:6006端口的流量转发到本地机器的6006端口。

-C: 压缩数据,这样在传输过程中可以减少网络带宽的使用。-N: 不执行远程命令。通常,当你使用SSH连接到服务器时,你会在服务器上执行一个命令。使用-N选项,SSH连接将仅用于端口转发,而不执行任何远程命令。-g: 允许其他机器连接到本地端口转发。这意味着,除了本地机器,其他机器也可以连接到通过SSH创建的本地端口转发。-L: 表示进行本地端口转发。6006: 这是本地机器上的端口号。127.0.0.1:6006: 这是远程服务器上的地址和端口号。由于地址是127.0.0.1,它指的是远程服务器上的本地地址。

Lagent 安装(源码安装)

git clone https://gitee.com/internlm/lagent.git

cd /root/code/lagent

pip install -e .

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?