# ResNet

class Residual(nn.Module):

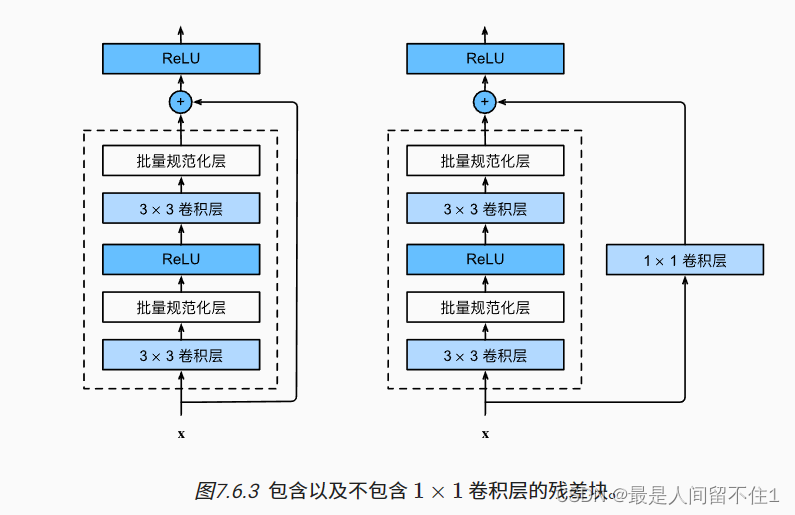

def __init__(self, input_channels, num_channels,use_1x1conv=False, strides=1): # input_channels:输入通道数,表示输入特征图的通道数,num_channels:输出通道数,表示输出特征图的通道数。use_1x1conv:一个布尔值,表示是否使用1x1卷积层来改变通道数。如果为True,将使用1x1卷积层来调整输入特征图的通道数,以匹配输出通道数;如果为False,将直接将输入特征图连接到输出。

super().__init__()

self.conv1 = nn.Conv2d(input_channels, num_channels,

kernel_size=3, padding=1, stride=strides) # 这是定义Residual块的第一个卷积层 conv1,它将输入特征图进行卷积操作。这里使用3x3的卷积核,步幅由参数 strides 控制,填充为1,以保持输入和输出特征图的空间尺寸。

self.conv2 = nn.Conv2d(num_channels, num_channels,

kernel_size=3, padding=1) # 这是定义Residual块的第二个卷积层 conv2,它对第一个卷积层的输出进行卷积操作。它也使用3x3的卷积核,填充为1。

if use_1x1conv:

self.conv3 = nn.Conv2d(input_channels, num_channels,

kernel_size=1, stride=strides)

else:

self.conv3 = None # 这是定义Residual块的可选的1x1卷积层 conv3。如果 use_1x1conv 为True,将使用1x1卷积层来改变输入特征图的通道数,以匹配输出通道数;如果为False,将保持 conv3 为None,即不进行1x1卷积操作。

self.bn1 = nn.BatchNorm2d(num_channels)

self.bn2 = nn.BatchNorm2d(num_channels) # 这是定义两个批量归一化层 bn1 和 bn2,用于对卷积层的输出进行批量归一化。

def forward(self, X):

Y = F.relu(self.bn1(self.conv1(X))) # 在前向传播过程中,首先将输入 X 通过第一个卷积层 conv1 进行卷积操作,然后进行批量归一化 bn1,最后应用ReLU激活函数。

Y = self.bn2(self.conv2(Y)) # 接下来,将第一个卷积层的输出 Y 通过第二个卷积层 conv2 进行卷积操作,并进行批量归一化 bn2。

if self.conv3:

X = self.conv3(X) # 如果 conv3 不为None,表示需要使用1x1卷积层来调整输入特征图的通道数,那么将输入 X 通过 conv3 进行卷积操作。

Y += X # 最后,将 Y 和 X 相加。这种结构允许模块学习残差(即差值)并将其添加回输入,从而改善梯度传播和训练深层网络。

return F.relu(Y)以上代码对应下面的图

blk = Residual(3,6, use_1x1conv=True, strides=2) # blk接受3个输入通道,但使用了1x1卷积层来改变通道数,将输出通道数改变为6,并且使用步幅为2的卷积操作。

blk(X).shape # 输出Y的形状是(4, 6, 3, 3),4表示小批量大小,与输入相同。

#6表示输出通道数,这是由Residual块的第一个卷积层指定的。

#3表示输出图像的高度,这是由步幅为2的卷积操作引起的。

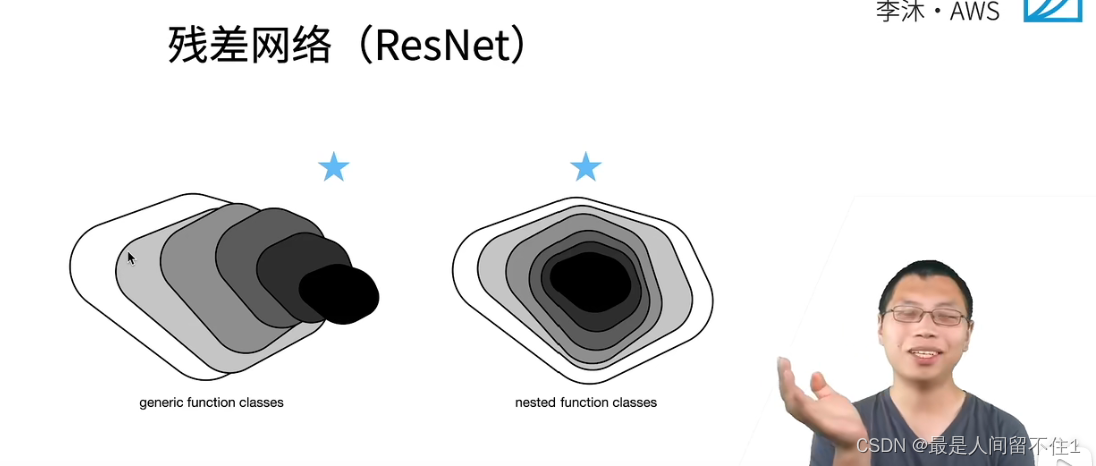

#3表示输出图像的宽度,这是由步幅为2的卷积操作引起的。ResNet为什么能训练出1000层的模型

从梯度大小的角度来解释,residual connection 使得靠近数据的层的权重 w 也能够获得比较大的梯度,因此,不管网络有多深,下面的层都是可以拿到足够大的梯度,使得网络能够比较高效地更新。

6462

6462

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?