简介

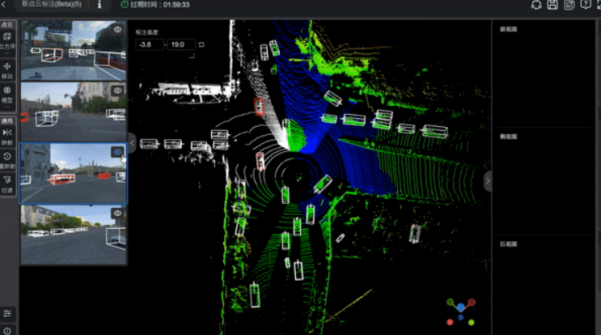

传感器融合是指将来自多个不同类型传感器(如摄像头、激光雷达、毫米波雷达、超声波雷达、全球定位系统、惯性传感器等)的数据进行整合,通过智能算法进行综合分析和处理,以获得更加全面、准确、可靠的环境信息。

这一技术不仅能够弥补单一传感器在感知能力上的不足,还能提升自动驾驶系统的鲁棒性和安全性。

一、传感器融合技术

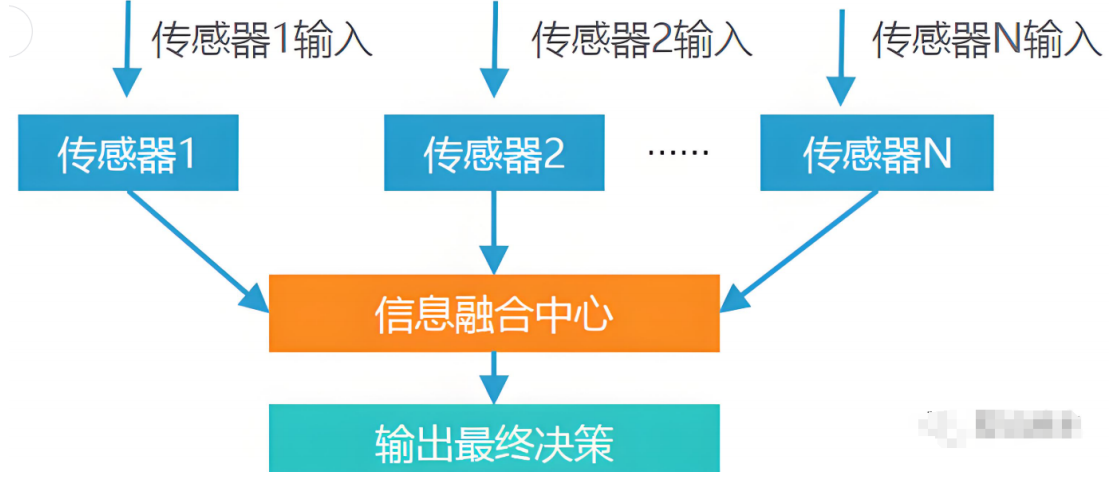

作为自动驾驶系统的“感知神经网络”,传感器融合需解决多模态数据时空对齐、特征互补与冗余校验问题,核心技术架构分为三级:

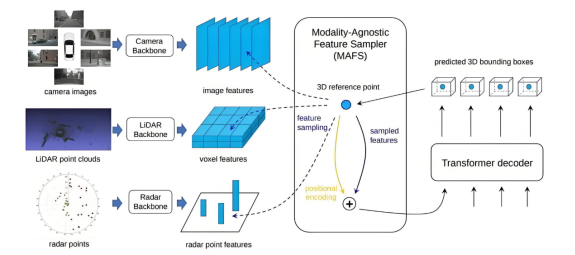

数据级融合

通过硬件层同步机制(如PTP协议)实现激光雷达、摄像头、毫米波雷达等传感器的微秒级时间同步。

坐标系统一采用Velodyne LiDAR点云与相机图像的联合标定,建立基于外参矩阵的3D-2D映射关系。

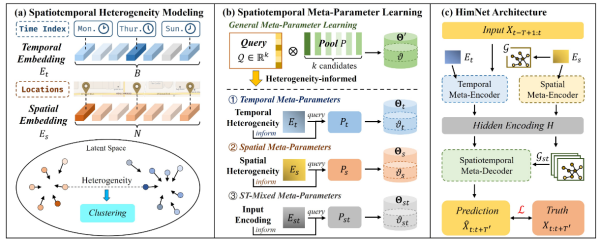

特征级融合

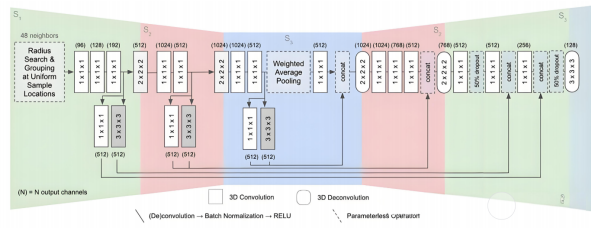

采用BEV(鸟瞰图)Transformer架构,将多传感器特征映射至统一BEV空间,实现跨模态特征融合(如毫米波雷达速度信息与激光雷达点云几何特征结合)。

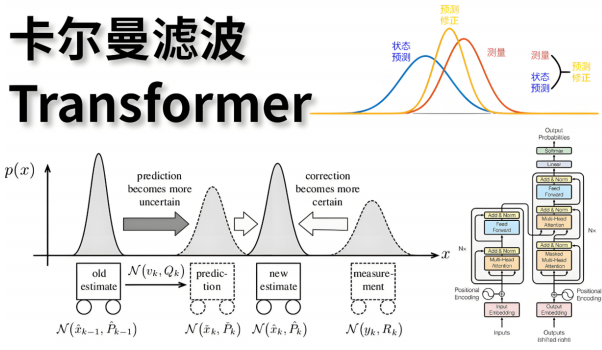

动态障碍物跟踪引入卡尔曼滤波与匈牙利算法组合,解决跨传感器ID匹配难题。

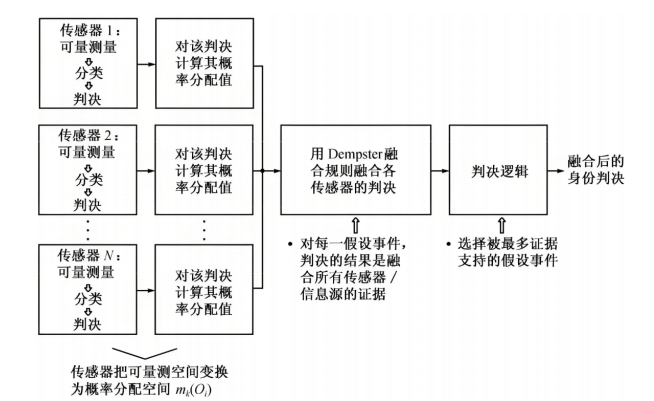

决策级融合

基于D-S证据理论的多传感器置信度加权融合,消除摄像头误检交通灯与激光雷达漏检透明物体的场景矛盾。

二、决策融合技术

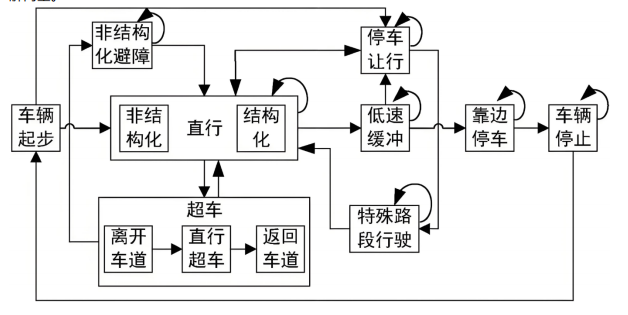

在行为决策层实现环境理解与驾驶策略的闭环优化:

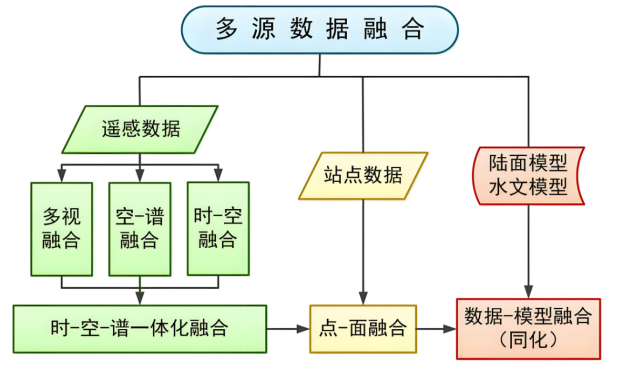

多源信息融合决策

采用分层有限状态机(HFSM)架构,将高精度地图语义、V2X信号与实时感知数据融合生成场景理解向量。

路径规划模块引入时空联合优化算法,在Frenet坐标系下实现动态障碍物避让与交通规则约束的轨迹平滑。

控制执行融合

智己L6线控数字底盘采用X/Y/Z三轴六自由度控制,通过动态转向比算法实现8:1至18:1的无级传动比切换,较传统CAN总线架构响应速度提升两个数量级。

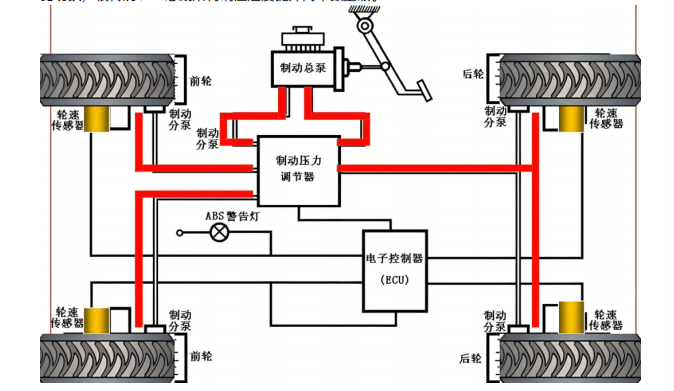

双冗余制动系统采用FPGA+MCU异构计算架构,制动响应时间缩短至50ms,制动力建立速率达5000N/s,较博世iBooster系统性能提升60%。

三、核心挑战与工程实践

跨域数据一致性

激光雷达点云与视觉语义的时空对齐误差需控制在<3cm(横向)/<10ms(时间)。

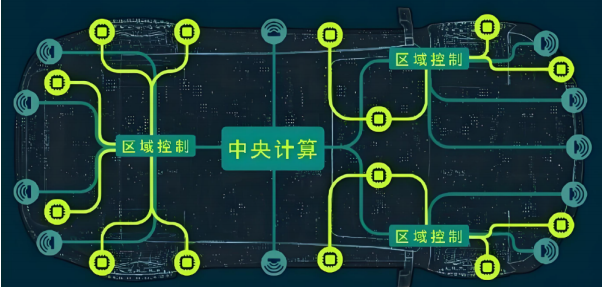

大众CMP平台通过CEA电子电气架构重构传感器数据传输拓扑,解决传统分布式架构的带宽瓶颈。

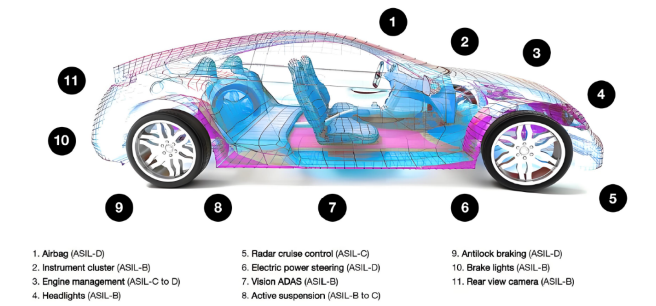

功能安全冗余

符合ISO 26262 ASIL-D标准的双独立感知链路设计(如摄像头+4D毫米波雷达异构冗余)。

智己灵蜥系统通过轮毂胎压监测与IMU数据融合实现爆胎后100ms内的稳定性控制。

四、技术演进趋势

集中式EE架构:域控制器算力需求突破1000TOPS,支持多传感器原始数据融合(如NVIDIA Thor架构)。

车云协同感知:5G+V2X实现路侧单元(RSU)与车载感知数据联邦学习,扩展感知盲区。

量子化融合算法:基于量子退火机的组合优化算法在超大规模传感器网络中的应用验证。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?