1. 下载

官网下载,我的选项如下:

2.配置

2.1. 在visual studio的配置

- 下载vs2017或者是vs2022

新建一个c++项目。选择控制台应用 - 视图–》解决方案资源管理器

在源文件下创建main.cpp文件 - 视图–》其他窗口–》属性管理器

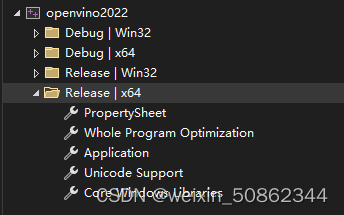

右键Release 添加新项目属性表 就会出现PropertySheet

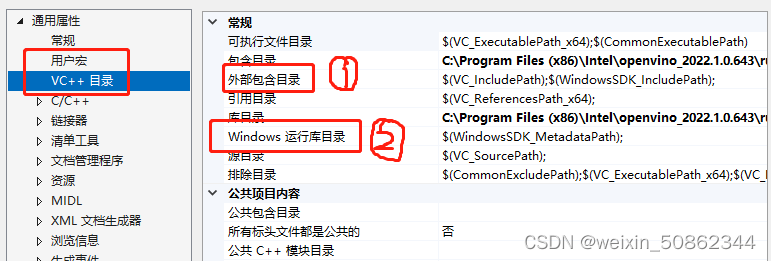

需要配置的是外部包含目录和windows运行库目录,以下都要到自己的目录下找对应文件

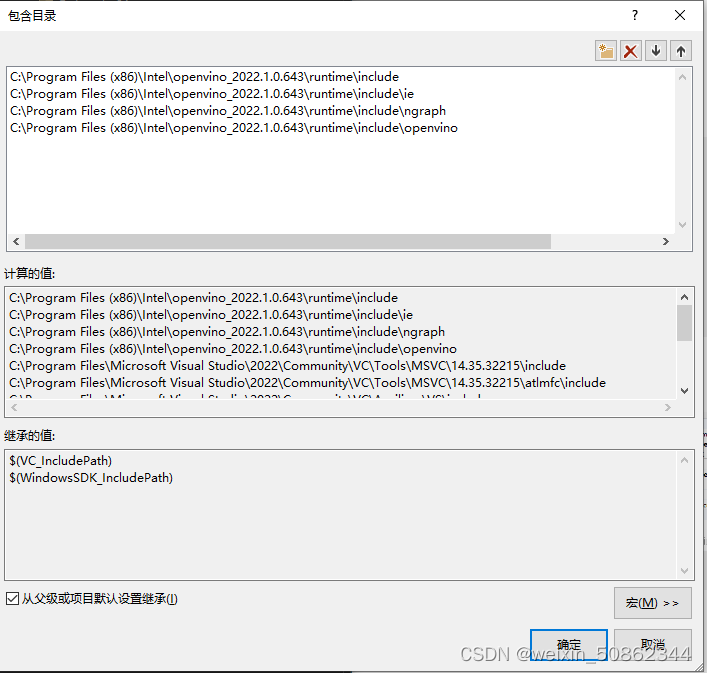

外部包含目录:

以我为例

C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\include

C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\include\ie

C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\include\ngraph

C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\include\openvino

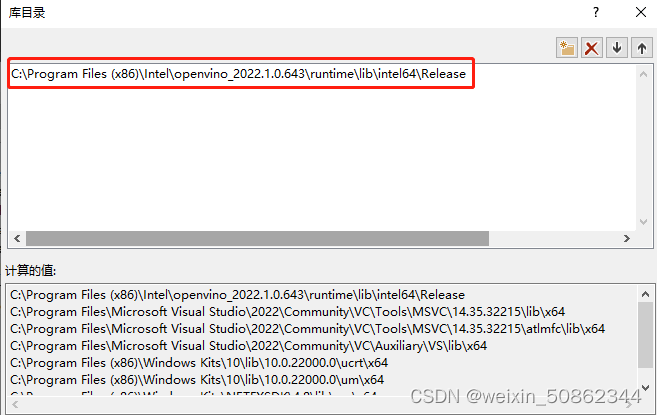

windows运行库目录(后面应该还要加上opencv的)

C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\lib\intel64\Release

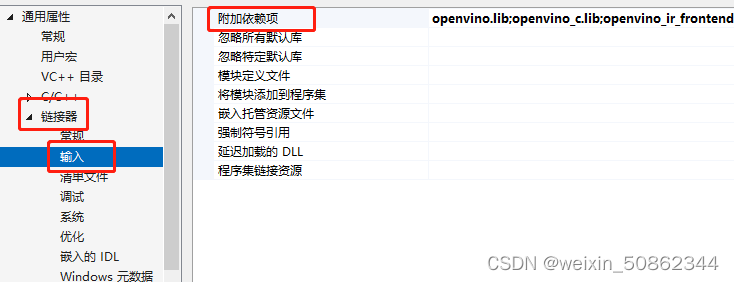

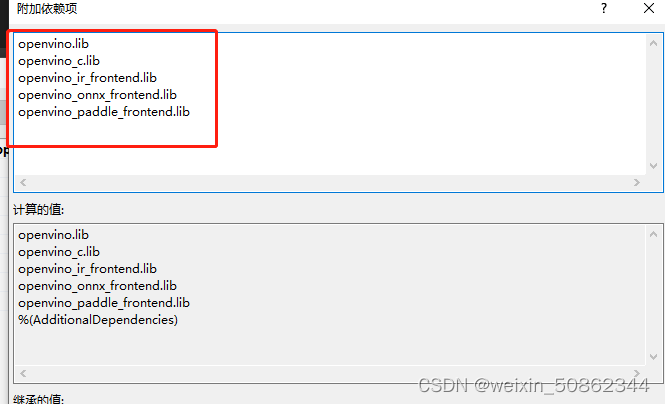

连接器输入的附加依赖项:

将C:\Program Files (x86)\Intel\openvino_2022.1.0.643\runtime\lib\intel64\Release下这几个用得上的都添加上去

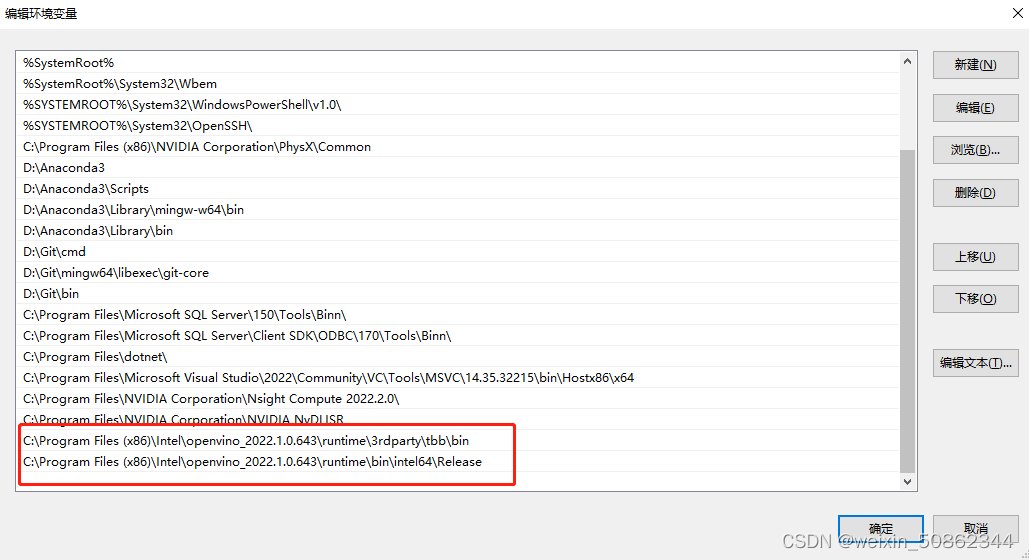

环境路径

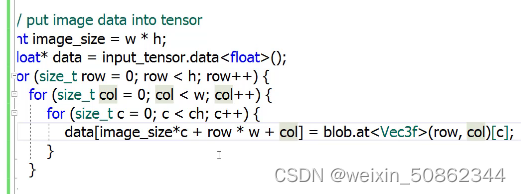

2.2 测试代码

#include <openvino/openvino.hpp>

//using namespace cv

using namespace std;

int main(int argc, char** argv) {

ov::Core ie;

vector<string> availableDevices = ie.get_available_devices();

for (int i=0; i < availableDevices.size(); i++)

{

printf("support device name:%s\n", availableDevices[i].c_str());

}

return 0;

}

3385

3385

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?