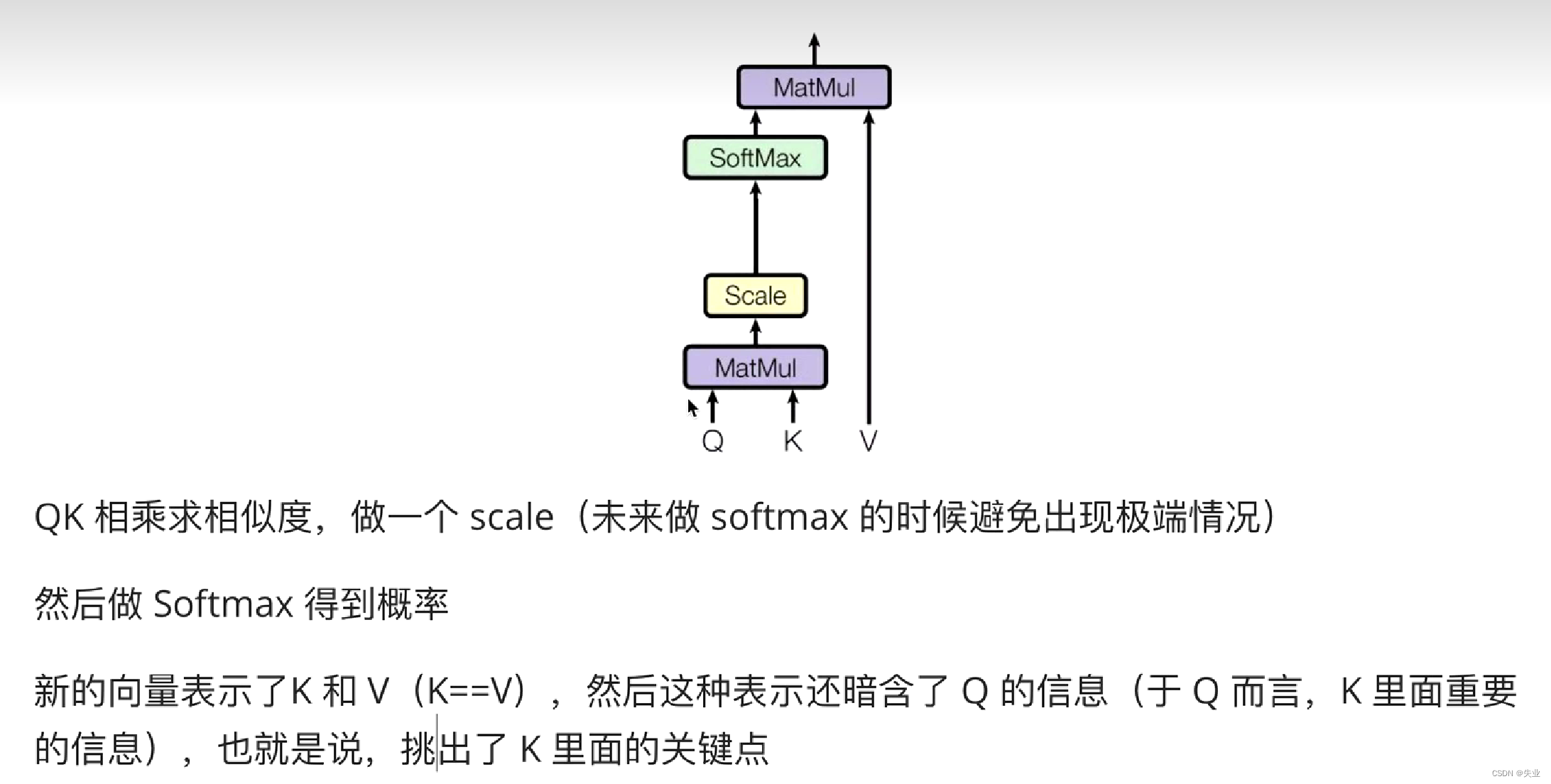

回顾以下注意力机制:

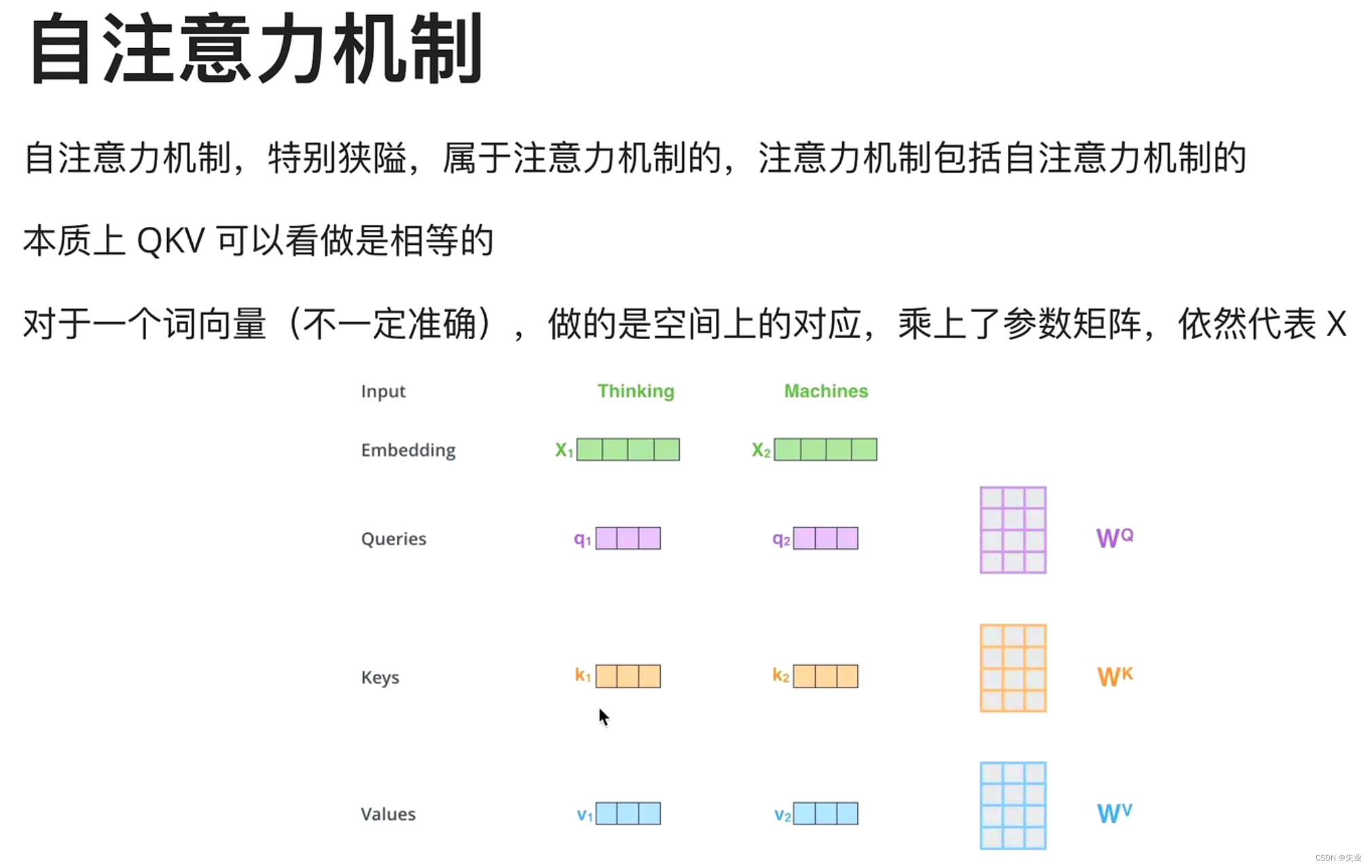

自注意力机制

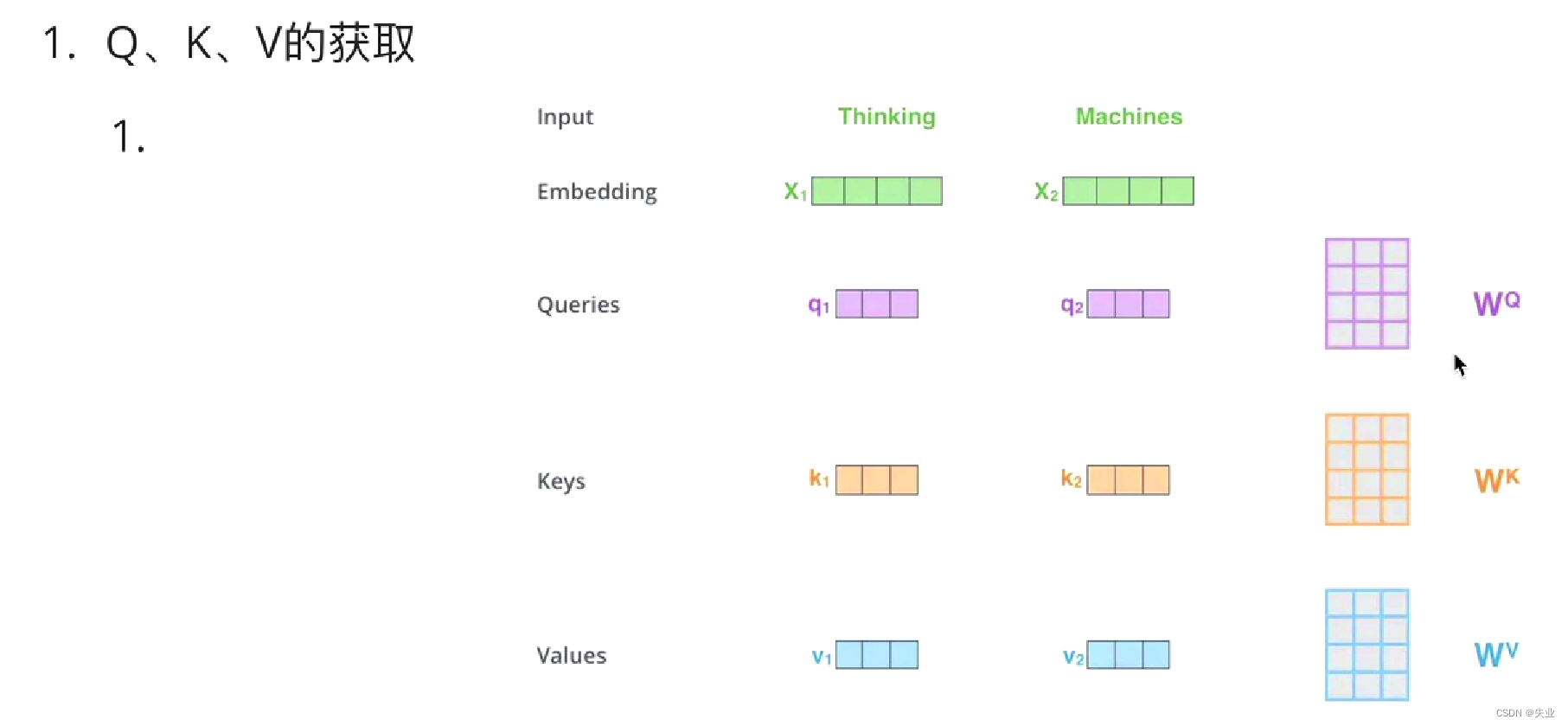

Self-Attention的关键点 在于

K

≈

\approx

≈V

≈

\approx

≈Q 来源于同一个X,三者是同源的,通过

W

Q

W_Q

WQ,

W

K

W_K

WK,

W

V

W_V

WV做了一层线性变换。

接下来步骤和注意力机制一模一样。

z

1

z_1

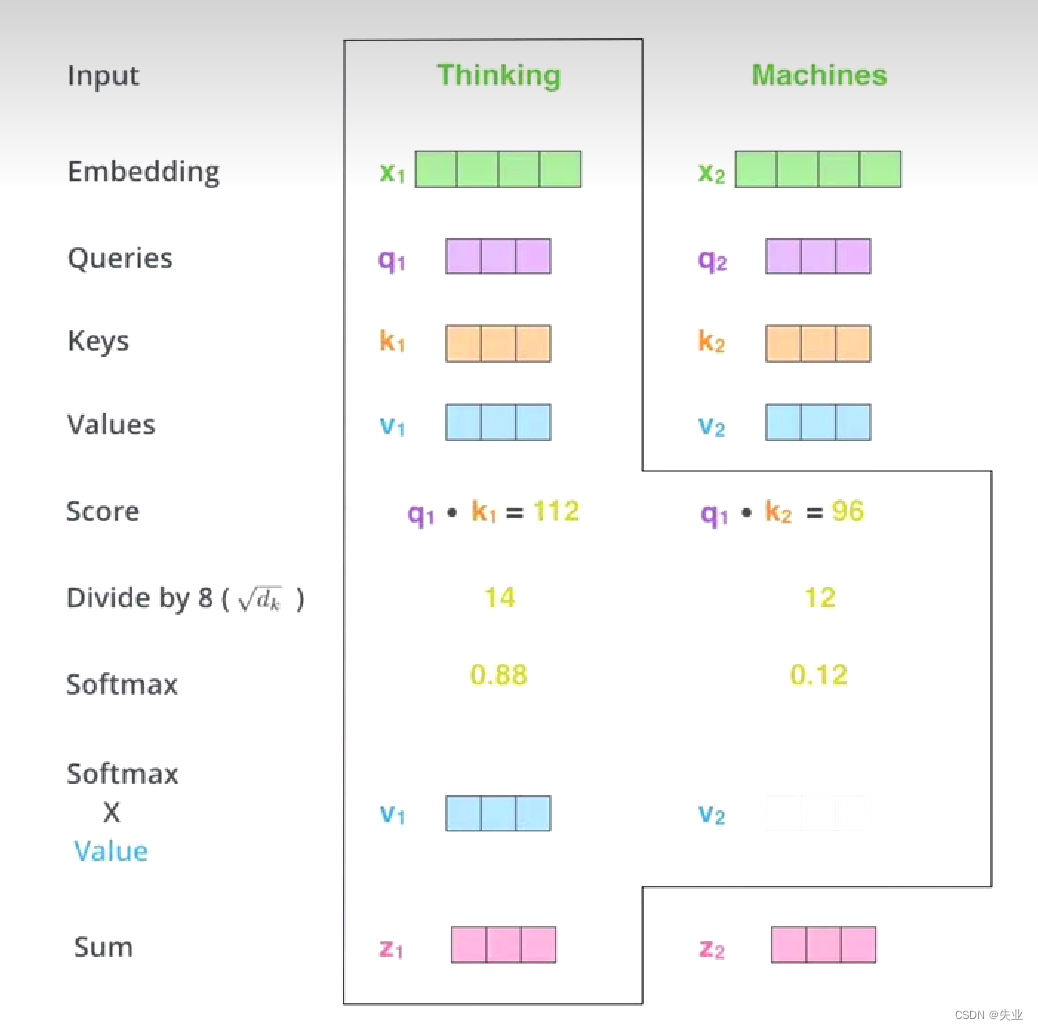

z1就是 thinking 的新的向量表示

对于thinking,初始词向量

x

1

x_1

x1

现在我通过thinking machines这句话去查询这句话里的每一个单词和thinking之间的相似度

新的

z

1

z_1

z1依然是thinking的词向量表示,只不过这个词向量表示蕴含了thinking machines这句话对于thinking而言哪个更重要的信息。

不仅规定了QKV同源,还规定了做法。

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?