论文阅读:Edge Detection of Motion-Blurred Images Aided by Inertial Sensors

原文地址:Edge Detection of Motion-Blurred Images Aided by Inertial Sensors

摘要

边缘检测应用于运动模糊图像时,边缘检测的准确性会显著降低。在本文中,作者提出了一种利用惯性传感器(如陀螺仪和加速度计来辅助去模糊的方法。我们知道,惯性传感器作为物理仪器,在测量时会有不可避免的误差,如零偏误差、标度因子误差、温度漂移、对准误差、非线性误差等。为了解决惯性传感器的测量误差,作者将其转换为模糊核误差,并应用基于总最小二乘法 (TLS) 的迭代优化方案来处理涉及模糊核误差的图像去模糊问题,其相关先验由神经网络学习。作者将 Canny 边缘检测算法应用于迭代过程的每个中间输出,并使用所有边缘检测结果来计算网络的总损失函数,从而在边缘检测任务和去模糊迭代过程之间实现更紧密的耦合。基于BSDS500边缘检测数据集和独立的惯性传感器数据集,作者构建了一个用于训练和评估网络的合成数据集。合成数据集的结果表明,与现有的代表性去模糊方法相比,该方法在运动模糊图像的边缘检测中表现出更高的准确性和鲁棒性。

注:模糊核是一个数学模型,通常用于描述图像在拍摄或采集过程中由于运动、失焦等原因造成的模糊。理想情况下,模糊核应该完全反映图像模糊的实际情况,以便在去模糊过程中准确恢复图像细节。然而,由于多种因素,模糊核往往带有误差

1. 引言

运动模糊产生的原因是:当相机和物体在曝光时间内存在相对运动时,捕获的图像将出现运动模糊。由于伪影的存在,直接对运动模糊图像应用边缘检测会导致准确性显著降低,从而影响后续图像处理任务。目前,对运动模糊图像执行边缘检测面临两个主要挑战:

-

运动模糊图像的边缘检测需要一种有效的去模糊方法。在以前的工作中,大部分工作都集中在利用图像本身的内容来消除运动模糊 ,这是一个病态的问题,因为潜在图像和模糊内核仍然是未知的。惯性传感器可以在曝光期间提供有关成像系统的其他运动信息。利用惯性传感器来辅助去模糊可以有效减少去模糊算法的病态 。然而,由于时间同步误差和噪声,无法从传感器数据中获得准确的运动信息,因此由惯性传感器数据辅助的去模糊方法通常缺乏鲁棒性;

潜在图像:原文是“latent images”,我的理解为就是指图像本身,因为在实际的去噪中,提供的图片往往是未知的。

-

去除运动模糊通常是为提升图片质量设计的,而不是为了更好的边缘感知设计的。近期研究表明,与具有较低峰值信噪比 (PSNR) 的去模糊结果相比,具有较高 PSNR 的去模糊结果并不总是能实现更好的边缘检测性能。将去模糊算法与边缘检测任务耦合,并确保去模糊方法能够有效提高边缘检测精度是另一个需要解决的关键问题。

为解决上述问题,作者做了如下工作:

- 将有误差的传感器数据转化为有误差的模糊核,作者采用基于 TLS (最小二乘法总计)的迭代优化方案来处理涉及模糊核误差的图像去模糊问题,其相关先验由两种类型的神经网络学习。在训练过程中包含带有传感器数据错误信息的模糊内核使最终的去模糊方法非常稳健。

- Canny边缘检测算法被纳入去模糊过程中,以计算最终的损失函数。通过将边缘检测任务和去模糊迭代过程更紧密地耦合,确保边缘检测任务通过图像去模糊过程获得更高的准确率。

- 将BSDS500边缘检测数据集和独立的惯性传感器数据集相结合,创建了一个用于运动模糊图像边缘检测的合成数据集。合成数据集的结果证明了所提出的方法的有效性和稳健性。

2. 该领域其他人的相关工作

- Joshi 等人构建了一台配备陀螺仪和加速度计的单镜头反光相机,用于估计相机在曝光过程中的运动,传感器数据在自然图像的引导下事先进行了校正。( Joshi, N.; Kang, S.B.; Zitnick, C.L.; Szeliski, R. Image deblurring using inertial measurement sensors. ACM Trans. Graph. 2010, 29, 1–9.)

- Park 和 Levoy 采用了类似的陀螺仪校准方法来解决多图像去模糊问题(Hee Park, S.; Levoy, M. Gyro-based multi-image deconvolution for removing handshake blur. In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Columbus, OH, USA, 23–28 June 2014; pp. 3366–3373)

- Šindeláˇr 和 Šroubek 在移动设备上开发了一种基于空间不变模糊近似的实时去模糊方法(Šindelárˇ, O.; Šroubek, F. Image deblurring in smartphone devices using built-in inertial measurement sensors. J. Electron. Imaging 2013, 22, 011003.)

- Zhang 和 Hirakawa 将惯性测量和基于图像的信息相结合,以消除模糊(Zhang, Y.; Hirakawa, K. Combining inertial measurements with blind image deblurring using distance transform. IEEE Trans. Comput. Imaging 2016, 2, 281–293.)

以上这些人的研究都是假设他们记录的传感器数据是可靠的,或者是放宽了这个假设。然而,当使用惯性传感器时,存在更具挑战性的问题,这些传感器不能提供高质量的传感器数据来有效地澄清图像。

- Mustaniemi 等人首次将陀螺仪数据应用于基于深度学习网络的单张图像去模糊 。在他们的工作中,在网络训练期间考虑了传感器数据误差。然而,他们只使用传感器数据将模糊内核的形状简化为一条直线,这会导致物理阶段的部分信息丢失,从而影响卷积神经网络 (CNN) 的最终性能。(Mustaniemi, J.; Kannala, J.; Särkkä, S.; Matas, J.; Heikkila, J. Gyroscope-aided motion deblurring with deep networks. In Proceedings of the 2019 IEEE Winter Conference on Applications of Computer Vision (WACV), Waikoloa, HI, USA, 7–11 January 2019; IEEE: Piscataway, NJ, USA, 2019; pp. 1914–1922.)

- Nan 和 Ji 提出了一种基于 TLS 的迭代优化方案,用于处理图像去模糊中的内核误差问题 ,即使模糊内核的估计存在误差,也可以获得良好的去模糊结果。此框架特别适用于处理由传感器数据错误引起的模糊内核错误。(Nan, Y.; Ji, H. Deep learning for handling kernel/model uncertainty in image deconvolution. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, Seattle, WA, USA, 13–19 June 2020; pp. 2388–2397.)

- 在将去模糊算法与边缘检测任务耦合方面,Adler 等人 的工作中提出了任务适应图像重建的广泛理论概述。他们的研究表明,与顺序和端到端方法相比,联合重建-分割方法实现了更准确的分割。(Adler, J.; Lunz, S.; Verdier, O.; Schönlieb, C.-B.; Öktem, O. Task adapted reconstruction for inverse problems. Inverse Probl. 2022, 38, 075006. )

- Yang 等人提出了一种新的联合图像恢复和边缘检测的合作博弈框架 。它使用迭代方法来解决这两个任务,迭代过程中任务之间的交互促进导致了图像恢复和边缘检测性能的改进。(Yang, C.; Wang, W.; Feng, X. Joint image restoration and edge detection in cooperative game formulation. Signal Process. 2022, 191, 108363)

3. 本文提出的方法

3.1初始核估计

回想一下图像模糊过程的空间不变卷积模型:g = f ∗ k + n,其中 g 和 f 表示运动模糊图像及其潜在的清晰图像,* 是卷积算子,k 是模糊核,噪声项 n 通常表示为附加的白色高斯噪声。

CNN的卷积不变性:卷积操作本身具备平移不变性,当输入图像在空间中发生平移时,卷积网络能够识别出相同的特征,而不受平移的影响。这是因为卷积核在图像的每个位置上都执行相同的操作,不依赖绝对位置。有些时候还会用到旋转卷积或者尺度空间变换等技术实现更广泛的空间不变性,使模型不仅对平移,而且对旋转和尺度变化也具有不变性。作者提出这个旨在证明下面将多个不同位置的清晰图像进行叠加生成模糊图像的过程并没有改变图像特征信息。是可行的。

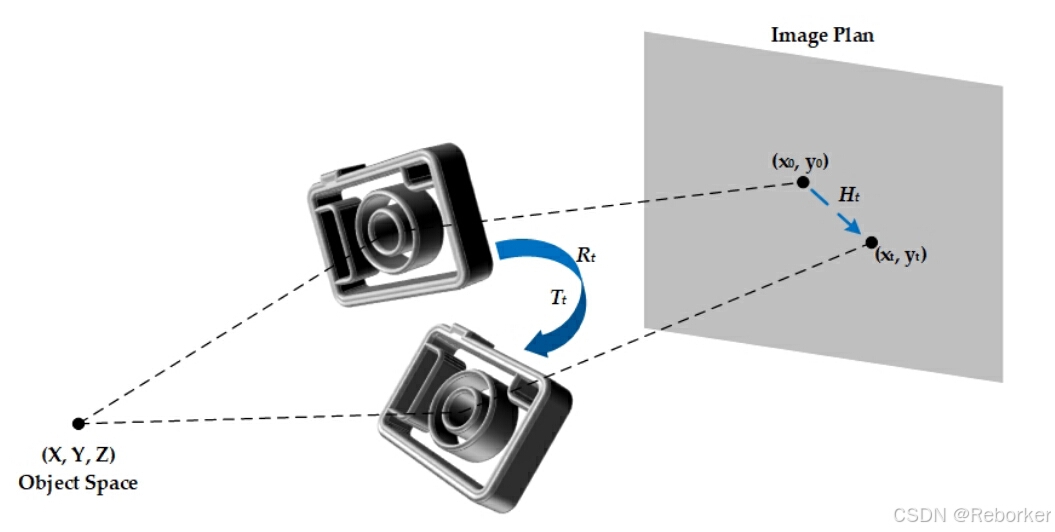

为了整合记录相机运动信息的惯性传感器数据,将运动模糊图像表述为曝光间隔期间一系列投影运动下多个清晰图像的总和:

g ( x ) = 1 N p ∑ t = 1 N p f ( H t x ) + n (1) g(x)=\frac{1}{N_p} \sum_{t=1}^{N_{p}} f\left(H_{t} x\right)+n\tag{1} g(x)=Np1t=1∑Npf(Htx)+n(1)

其中 x ∈ R 3 × 1 x \in \mathbb{R}^{3 \times 1} x∈R3×1表示齐次坐标中的像素位置, H t H_t Ht表示单应矩阵,n 表示噪声项, N p N_p Np表示曝光时间内所有相机姿势的数量。考虑到将 t = 0 处点的初始投影映射到任何其他时间 t 的平面同向性,对于特定深度d,单应矩阵 H t H_t Ht 可以表征为

H t = K ( R t + T t N T d ) K − 1 (2) H_t=K(R_t+\frac{T_tN^T}d)K^{-1}\tag{2} Ht=K(Rt+dTtNT)K−1(2)

R t R_t Rt 是旋转变换矩阵, T t T_t Tt 是平移向量, N t N_t Nt 是与图像平面正交的单位向量。相机内参矩阵 K 可以用焦距 f 和相机光学中心 ( O x , O y O_x, O_y Ox,Oy) 来表征:

K = [ f 0 O x 0 f O y 0 0 1 ] (3) K=\begin{bmatrix}f&0&O_x\\0&f&O_y\\0&0&1\end{bmatrix}\tag{3} K=

f000f0OxOy1

(3)

投影运动:“投影运动”(projective motions)是指相机在曝光期间由于运动而导致的视角变化。这些运动导致了物体在相机平面上的投影位置、大小和角度发生变化。这种变化是投影几何的一个典型表现,通常用投影矩阵来描述。文中为了建模运动模糊,选择将不同瞬间拍摄的多个清晰图像进行叠加,每个清晰图像对应相机在曝光时间内某一时刻的位置。每个时刻的视角变化被描述为一个“投影运动”,即相机对拍摄物体的投影矩阵变化。

**单应性矩阵:**Homography matrix,用于描述两个平面之间的透视变换关系。它是一个3×3 的矩阵,可以将一个平面上的点转换到另一个平面上,同时保持透视投影的特性。

**内参矩阵:**Intrinsic matrix,用于描述相机的内部参数。它包含了与相机的光学特性和传感器几何结构相关的信息,使得能够将三维空间中的点投影到二维图像平面上。

与运动相关的参数,即旋转变换矩阵 R t R_t Rt和平移向量 T t T_t Tt,可以分别根据陀螺仪和加速度计的测量值计算得出。相机运动引起的图像模糊过程如图所示:

假设旋转中心位于相机的光学中心,则旋转变换矩阵可以近似为:

R t = [ 1 − d θ t z d θ t y d θ t z 1 − d θ t x − d θ t y − d θ t x 1 ] R t − 1 (4) R_t=\begin{bmatrix}1&-d\theta_t^z&d\theta_t^y\\d\theta_t^z&1&-d\theta_t^x\\-d\theta_t^y&-d\theta_t^x&1\end{bmatrix}R_{t-1}\tag{4} Rt=

1dθ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?