注:本图来自官方

开源公告:Ghibli Diffusion模型发布

一、模型简介

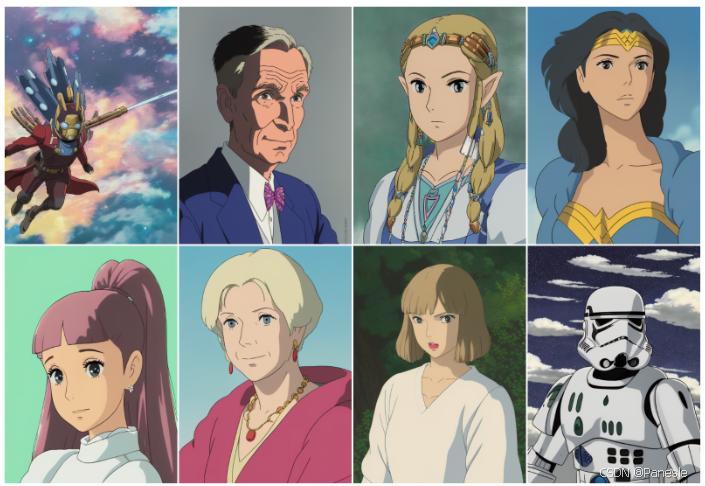

Ghibli Diffusion模型正式开源!这是一个经过精细微调的Stable Diffusion模型,它基于吉卜力工作室(Studio Ghibli)现代动画长片的图像进行训练。通过在提示词中加入“ghibli style”,用户能够生成具有吉卜力风格的独特图像。

二、模型应用示例

(一)多样化的渲染内容

该模型可以渲染出各种风格的图像,包括角色、汽车、动物和风景等。例如,有美丽的加勒比海滩热带日落景观,以及冰原、白色山脉、北极光和星空等带有低地平线的北方景色。在生成这些图像时,还可设置负向提示词,如“soft blurry”,以避免生成模糊的图像。

(二)特定对象的生成示例

风暴兵(Storm Trooper):使用“ghibli style (storm trooper)”作为提示词,负向提示词为“(bad anatomy)”,并设置步数为20、采样器为DPM++ 2M Karras、CFG比例为7、种子数为3450349066、尺寸为512x704,即可生成具有吉卜力风格的风暴兵图像。

大众甲壳虫(VW Beetle):提示词为“ghibli style VW beetle”,负向提示词设为“soft blurry”,步数30、采样器为Euler a、CFG比例为7、种子数为1529856912、尺寸为704x512,能生成吉卜力风格的大众甲壳虫图像。

三、模型训练细节

此模型由ShivamShrirao采用基于diffusers的DreamBooth训练方法,结合先验保留损失(prior - preservation loss)和训练文本编码器标志(train - text - encoder flag),经过15000步训练而成。

四、使用方法

Ghibli Diffusion模型的使用方式与其他Stable Diffusion模型相同。以下是一个简单的Python代码示例,展示如何使用该模型生成图像:

from diffusers import StableDiffusionPipeline

import torch

model_id = "nitrosocke/Ghibli-Diffusion"

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype = torch.float16)

pipe = pipe.to("cuda")

prompt = "ghibli style magical princess with golden hair"

image = pipe(prompt).images[0]

image.save("./magical_princess.png")

五、模型扩展

该模型支持导出为ONNX、MPS和/或FLAX/JAX格式,方便用户在不同的环境和应用中使用。

六、支持与反馈

让我们一起利用Ghibli Diffusion模型,开启充满创意的图像生成之旅!

423

423

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?