为什么要和yarn整合

在上一篇文章中我们提到了Spark的独立集群的搭建,但是在公司里面,一般不适用standalone模式,因为公司已经有了yarn,不需要再搞俩个资源管理框架了

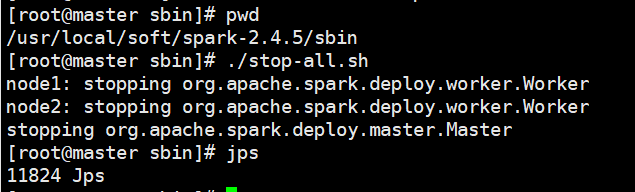

停止spark集群

停止spark集群需要再spark的sibin目录下执行

./stop-all.sh

删除node1和node2中所有spark文件

因为spark整合yarn只需要再一个节点整合,所以这个时候我们可以删除node1和node2中所有的spark文件

rm -rf spark-2.4.5/

开始整合

如果前期配过环境变量修改配置文件之类的操作这时候就可以按照我的步骤来了,但是如果前期没有的话这边建议可以去我上一篇文章看一下。

增加hadoop配置文件地址

vim spark-env.sh

中增加(这个文件再spark的conf文件夹下)

export HADOOP_CONF_DIR=/usr/local/soft/hadoop-2.7.6/etc/hadoop

因为spark需要获取Hadoop的配置信息,所以需要配置这个

前期配置不变,只在最后加一行

往yarn提交任务需要的两个配置

因为spark跑任务的时候对资源的需求比较高,所以我们需要在yarn里面给资源分配的俩个限制给关掉

关闭yarn

stop-yarn.sh

修改文件,在对应目录下

yarn-site.xml(/usr/local/soft/hadoop-2.7.6/etc/hadoop/yarn-site.xml)

增加俩个配置

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

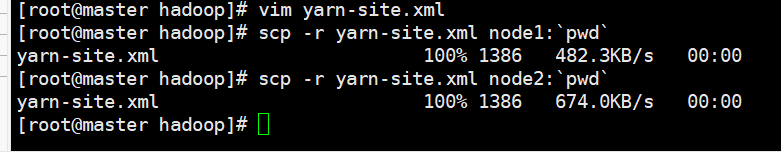

同步到其他节点,重启yarn

scp -r yarn-site.xml node1:`pwd`

scp -r yarn-site.xml node2:`pwd`

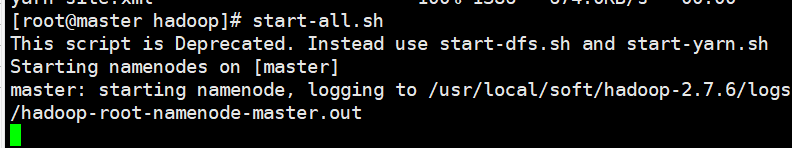

启动hadoop

start-all.sh

7574

7574

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?