论文笔记UBoCo: Unsupervised Boundary Contrastive Learning for Generic Event Boundary Detection

1. Abstract

GEBD 弥合了人类感知与视频理解之间的差距,具有更好的可解释性与语义有效性。本文提出了一种名为UBoCo的新颖框架,用于视频中的无监督和监督通用事件边界检测(GEBD)。该框架使用时间自相似矩阵(TSM)作为视频表示,并将其与Recursive TSM Parsing (RTP)算法和Boundary Contrastive loss相结合,以检测边界并训练编码器。该方法在GEBD基准测试中取得了最先进的性能,超过了以前的监督模型。

2. Introduction

Kinetics-GEBD是GEBD任务的最新数据集,它的特点是发现 one level deeper granularity compared to the video-level event。它没有预先设定的动作类,标签仅仅由人类的感知给出,以模拟人类的感知。

本文贡献:

-

我们发现时间自相似矩阵(TSM)的性质与通用事件边界检测(GEBD)任务非常匹配,并提出使用TSM作为视频的表示来解决GEBD问题。

-

利用TSM独特的边界模式,我们提出递归TSM解析(递归TSM Parsing, RTP)算法,该算法是一种分而治之的检测事件边界的方法。

-

结合RTP和新的边界对比(BoCo)损失,引入了GEBD的无监督框架。利用BoCo损失,视频编码器可以在没有标签的情况下进行训练,并产生更独特的tsm。我们的无监督框架不仅优于以前的无监督方法,而且优于有监督方法。

-

通过添加解码器,我们的框架可以很容易地扩展到监督设置,并以很大的幅度(16.2%)实现最先进的性能。

3. Related work

略

4. Proposed Method

4.1 Overview

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-fZWljNnW-1693298379437)(https://cdn.jsdelivr.net/gh/twilightmiao/image@master/picture/image-20230820134830894.png)]

给定一个L帧的视频:

- 特征提取:通过两个Feature Extractor提取特征:分别为Res50与自定义encoder,其中Res50是不可训练的,自定义Encoder可以训练

- 时间自相似矩阵(TSM)计算:计算帧之间的自相似性,形成TSM。

- 递归TSM解析(RTP):通过RTP算法产生边界索引预测。

- BoCo损失计算:使用BoCo损失训练encoder,以产生更丰富的边界敏感特征。

4.2 Unsupervised Boundary Contrastive Learning

4.2.1 Recursive TSM Parsing(RTP)

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-CWiCpqfq-1693298379439)(https://cdn.jsdelivr.net/gh/twilightmiao/image@master/picture/image-20230821095245856.png)](a). Zero-pad:对输入的TSM进行零填充,使卷积操作适用于角元素。

(b). 对角卷积:使用“对比核”对TSM的对角元素进行卷积,产生表示边界性的标量值。较高的边界分数意味着局部TSM模式与对比核匹配得很好,表明较高的成为事件边界的概率。

©. 边界分数选择:通过计算的边界分数,选择与事件边界对应的索引。为减少过度随机性,仅保留前k%的分数。通过计算的分布进行采样,确定边界帧索引。

(d). 分割TSM:使用给定的边界帧索引将TSM分割为两个单独的TSM,每个TSM再次进入RTP算法的另一次运行。

4.2.2 Boundary contrastive loss

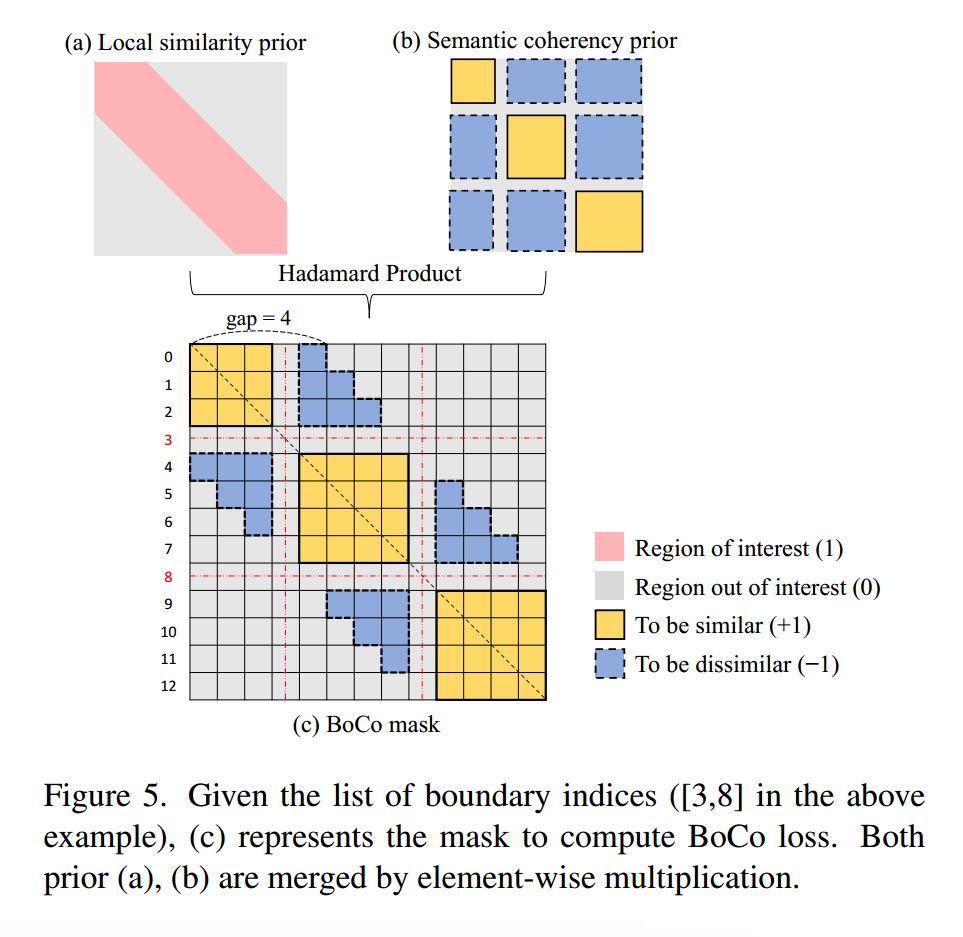

(a). local similarity prior: As our task focuses on the short-term frame relationship, the similarity between distant frames would not give much information for detecting event boundaries. The prior implies that we only care about the similarities between frames within a predefined interval.

(b). Semantic coherency prior: the frame similarity among them should be high, while the similarity between the frames in different segments should stay low.

BoCo loss is simply computed as the difference between the mean values of the blue region and the yellow region in Figure 5 ©.

5. Experiments

5.1. Benchmark Dataset

本文使用Kinetics-GEBD数据集进行实验,评价指标为F1@0.05与average F1。其中 0.05表示Relation Distance的阈值,即预测边界与真实边界的距离;average F1指from 0.05 to 0.5 with 0.05 interval。

5.2. Implementation Detailes

实验设备:RTX 2080 Ti;

batch size:23

optimizer: AdamW

learning rate:1e-3.

encoder: 1D CNNs to capture short-term and Mixer for long-term representations respectively.

5.3. Ablation Studies

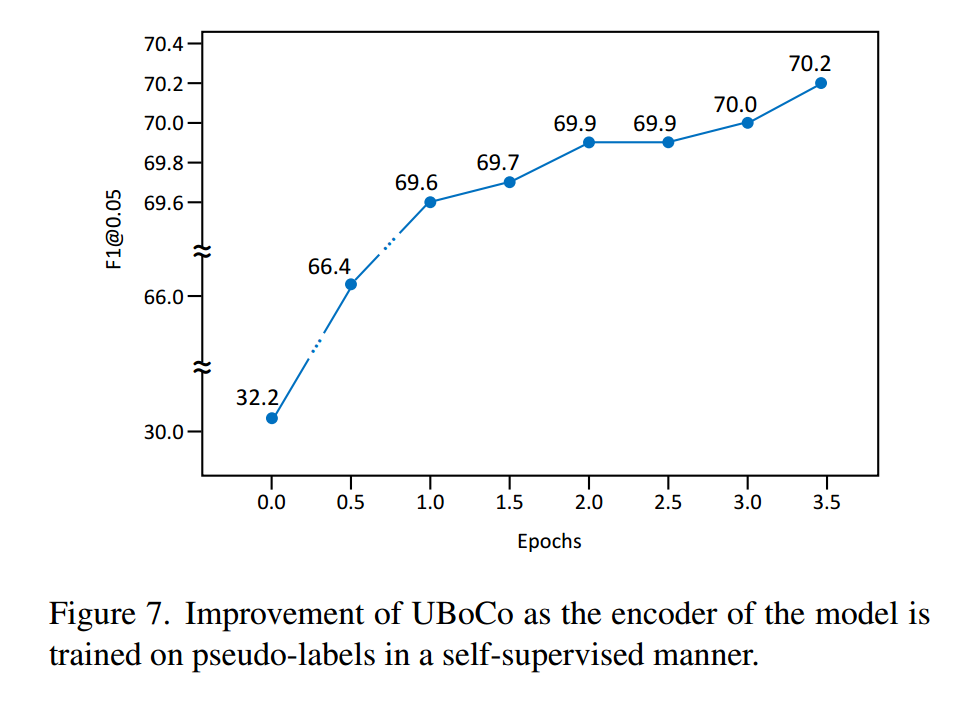

5.3.1. Self-supervision with Pseudo-label

其实是训练过程中F1@0.05的变化过程。

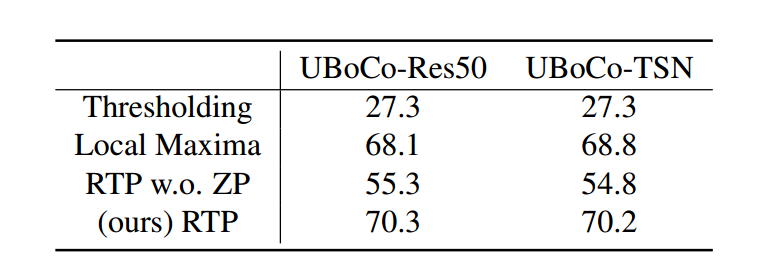

5.3.2. RTP

ZP即zero-padding。

For the method Thresholding, the points whose sigmoid value of event score is larger than the threshold are predicted as event boundaries. We use the best score for various thresholds from 0.1 to 0.5.

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-0TlCzDB3-1693298379439)(https://cdn.jsdelivr.net/gh/twilightmiao/image@master/picture/image-20230821105913231.png)]

如图为RTP的训练过程,包括镜头变化在内的明显边界在RTP的早期阶段被捕获,而更微妙的边界则被推迟到最后一个阶段。

[外链图片转存中…(img-0TlCzDB3-1693298379439)]

如图为RTP的训练过程,包括镜头变化在内的明显边界在RTP的早期阶段被捕获,而更微妙的边界则被推迟到最后一个阶段。

471

471

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?