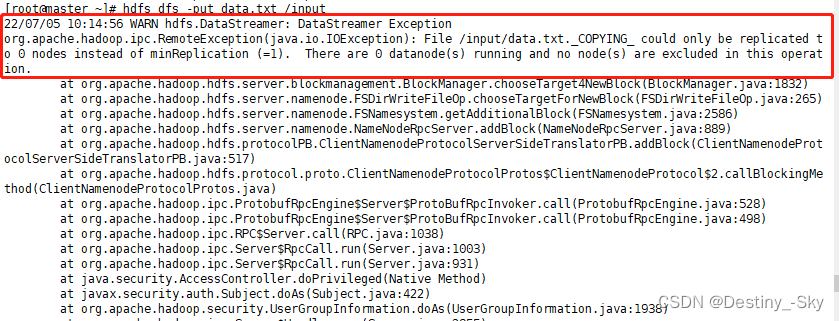

上传报错,报错提示:

22/07/05 10:14:56 WARN hdfs.DataStreamer: DataStreamer Exception

org.apache.hadoop.ipc.RemoteException(java.io.IOException): File /input/data.txt._COPYING_ could only be replicated to 0 nodes instead of minReplication (=1). There are 0 datanode(s) running and no node(s) are excluded in this operation.

它的报错信息是节点没有启动,我们先来检查一下,

master:

slave1:

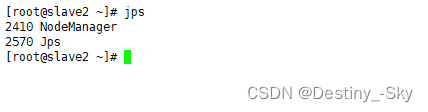

stop-all.shslave2:

可以看到从节点上的 datanode并没有启动

成这个问题的原因可能是使用hadoop namenode -format格式化时格式化了多次造成的

解决方案:

1、停止集群(切换到/sbin目录下)

stop-all.sh2、删除所有节点在hdfs中配置的data目录(即在core-site.xml中配置的hadoop.tmp.dir对应文件件)下面的所有数据;

rm -rf hadoop/cloud3、重新格式化namenode(切换到hadoop目录下的bin目录下)

hdfs namenode -format4、重新启动hadoop集群(切换到hadoop目录下的sbin目录下)

$./start-all.sh

我们再来查看一下进程

master:

slave1:

slave2:

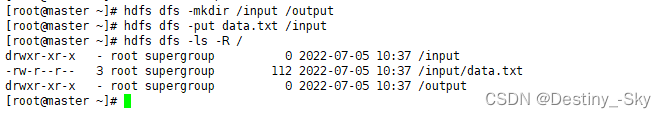

我们再来上传数据:

问题解决!

1907

1907

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?