在此之前要启动hdfs:

start-all.sh

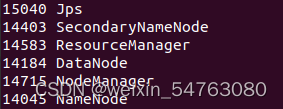

jps

出现下面六个进程则说明启动成功

在云端创建一个/data/input的文件夹结构:

bin/hdfs dfs -mkdir -p /data/input在本地创建一个my_wordcount.txt :

touch my_wordcount.txt编辑my_wordcount.txt文件,输入一些字符:

nano my_wordcount.txt把本地的my_wordcount.txt文件上传到云端:

bin/hdfs dfs -ls /data/input运行share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.4.jar这个java程序(与自己的Hadoop系统版本对应)

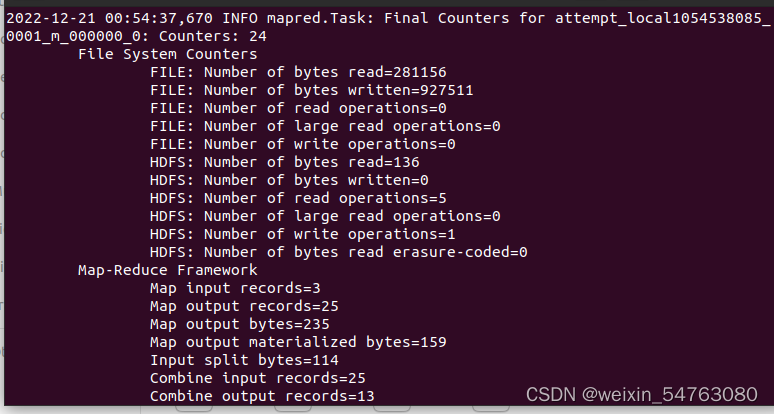

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.4.jar wordcount /data/input/my_wordcount.txt /data/out/my_wordcount出现如下图片则说明运行成功:

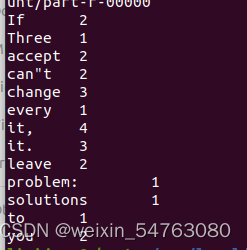

查看云端的/data/output/my_wordcount/part-r-00000文件

bin/hdfs dfs -cat /data/out/my_wordcount/part-r-00000

1145

1145

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?