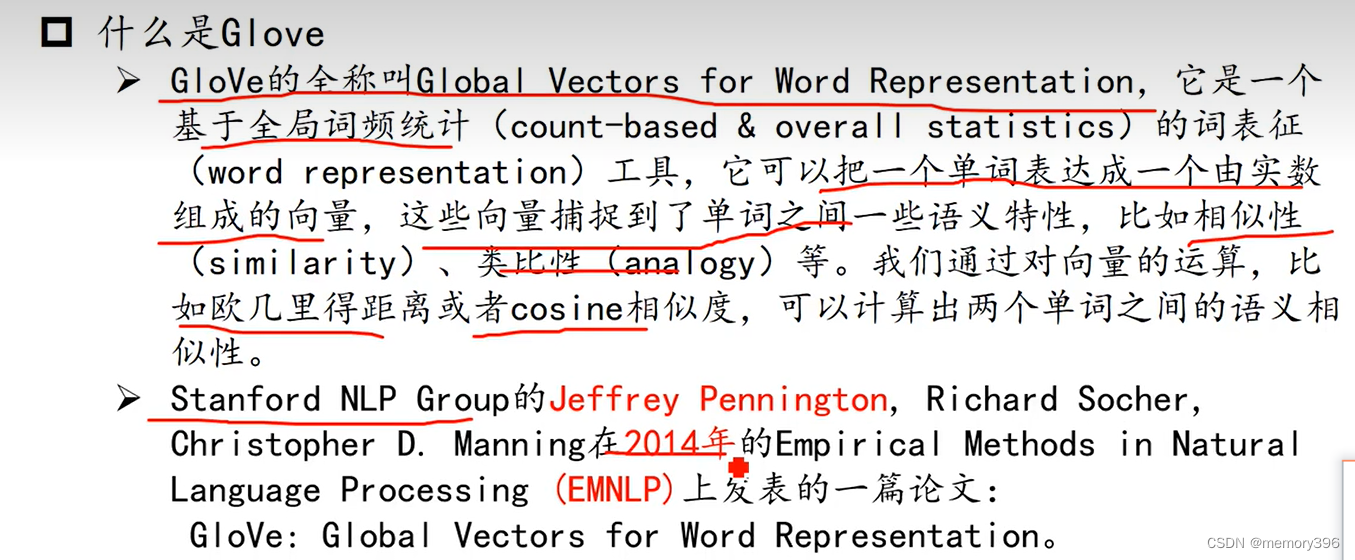

1、Glove(Global Vectors for Word representation):基于全局词频统计的词表达工具,把单词表达成一个由实数组成的向量。

2、word2vec 是Google研究团队里的Tomas Mikolov等人于2013年的《Distributed Representations ofWords and Phrases and their Compositionality》以及后续的《Efficient Estimation of Word Representations in Vector Space》两篇文章中提出的一种高效训练词向量的模型,基本出发点和Distributed representation类似:上下文相似的两个词,它们的词向量也应该相似,比如香蕉和梨在句子中可能经常出现在相同的上下文中,因此这两个词的表示向量应该就比较相似。

word2vec的基本思想:

句子之中相近的词之间是有联系的,比如今天后面经常出现上午、下午。所以它的基本思想就是用词来预测词。(准确的说,word2vec仍然是一种编码方式,将一个个的词给编码成向量,但是被他编码而成的向量并不是随便生成的,而是能够体现这些单词之间的关系(如相似性等))

知乎连接:word2vec详解-基础 - 知乎

Numpy & pandas

知乎连接:Numpy&Pandas 傻傻分不清楚? - 知乎

3、token和tokenization

tokenization就是通常所说的分词,分出的每一个词语我们把它称为token。

4、cls_token的作用:

cls_token与图像无关。它是随机生成的,不基于图像内容,因此可以避免对sequence中某个特定token的偏向性。

cls_token 对所有其他token上的信息做汇聚(全局特征聚合),cls_token(第0个token)使用固定的位置编码能够避免输出受到位置编码的干扰。(本段为CSDN博主「gltangwq」的原创文章,

原文链接:https://blog.csdn.net/gltangwq/article/details/124950935)

5、多头注意力机制:拥有多套QKV训练出多个特征

765

765

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?