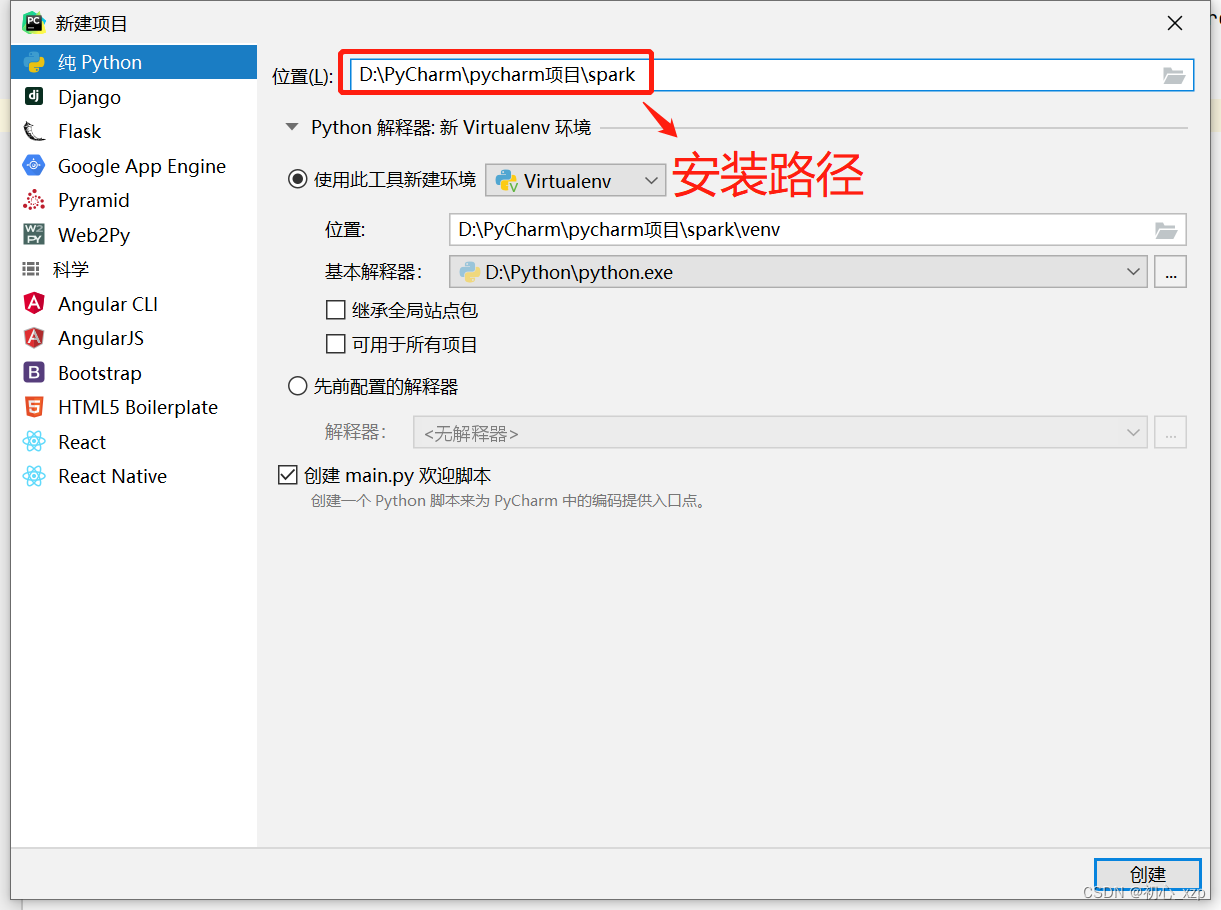

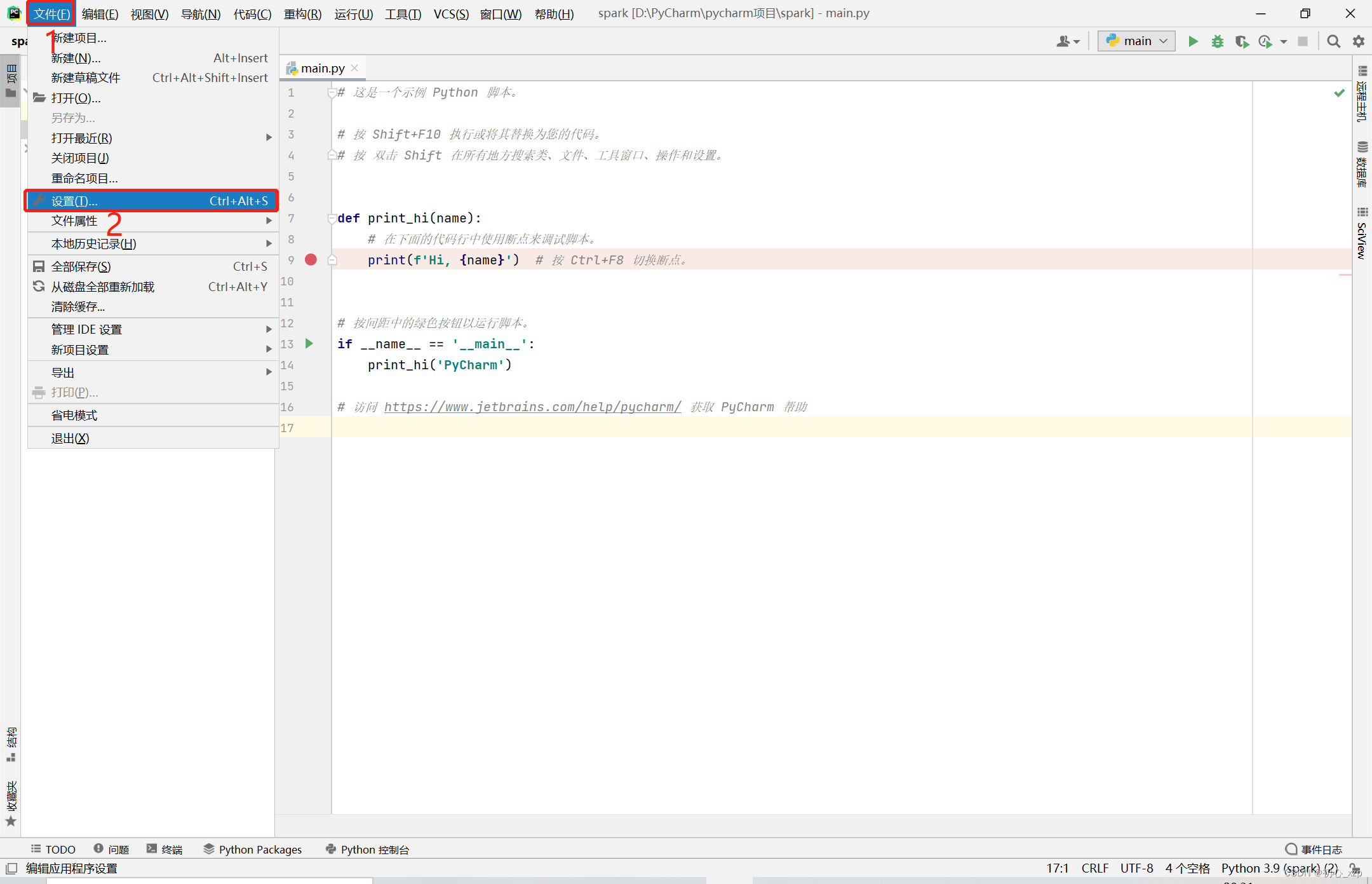

打开pycharm创建项目,这里安装路径在D盘

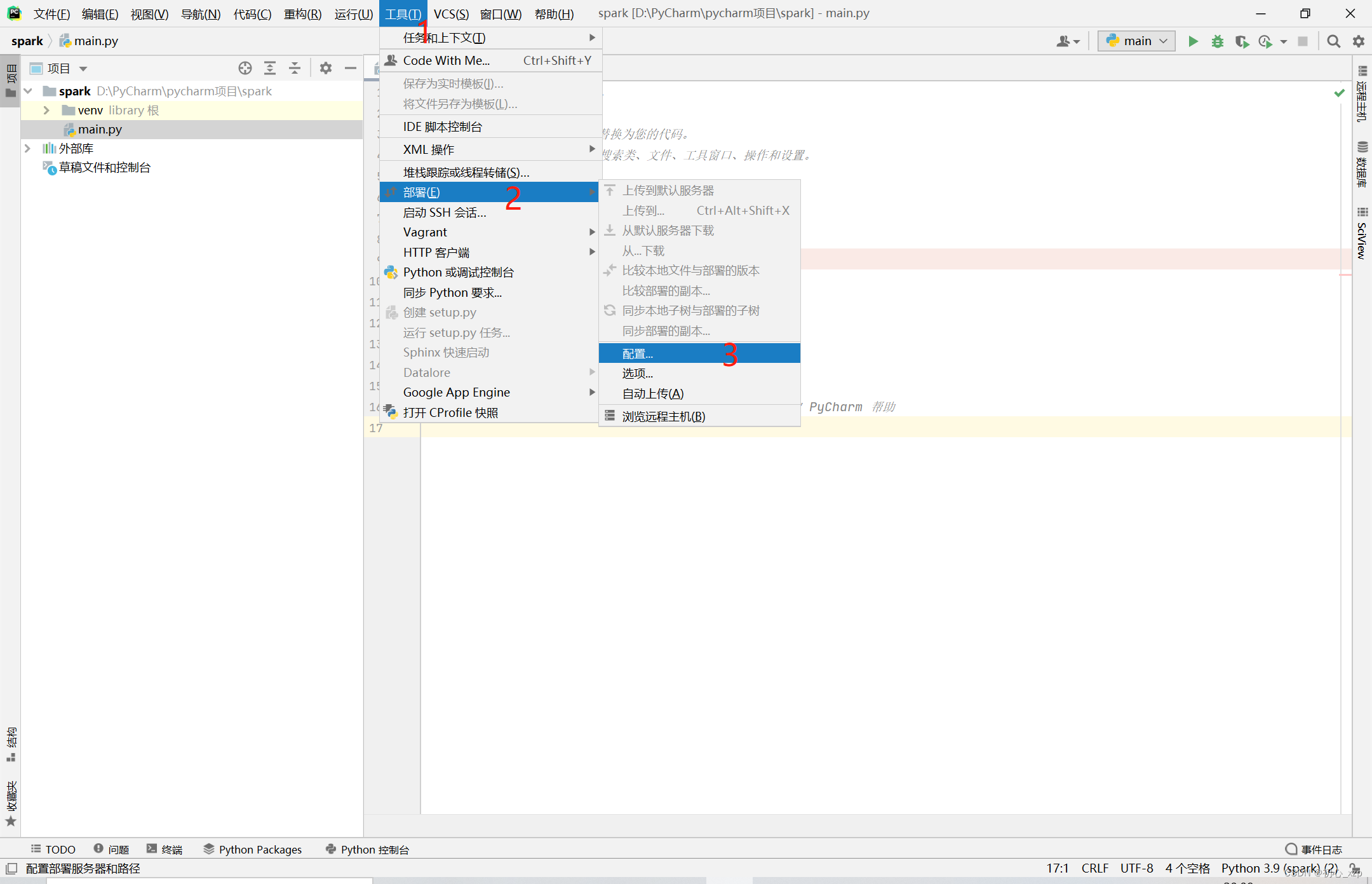

打开菜单"工具(Tools) -> 部署(Deployment) ->配置(Configuration)

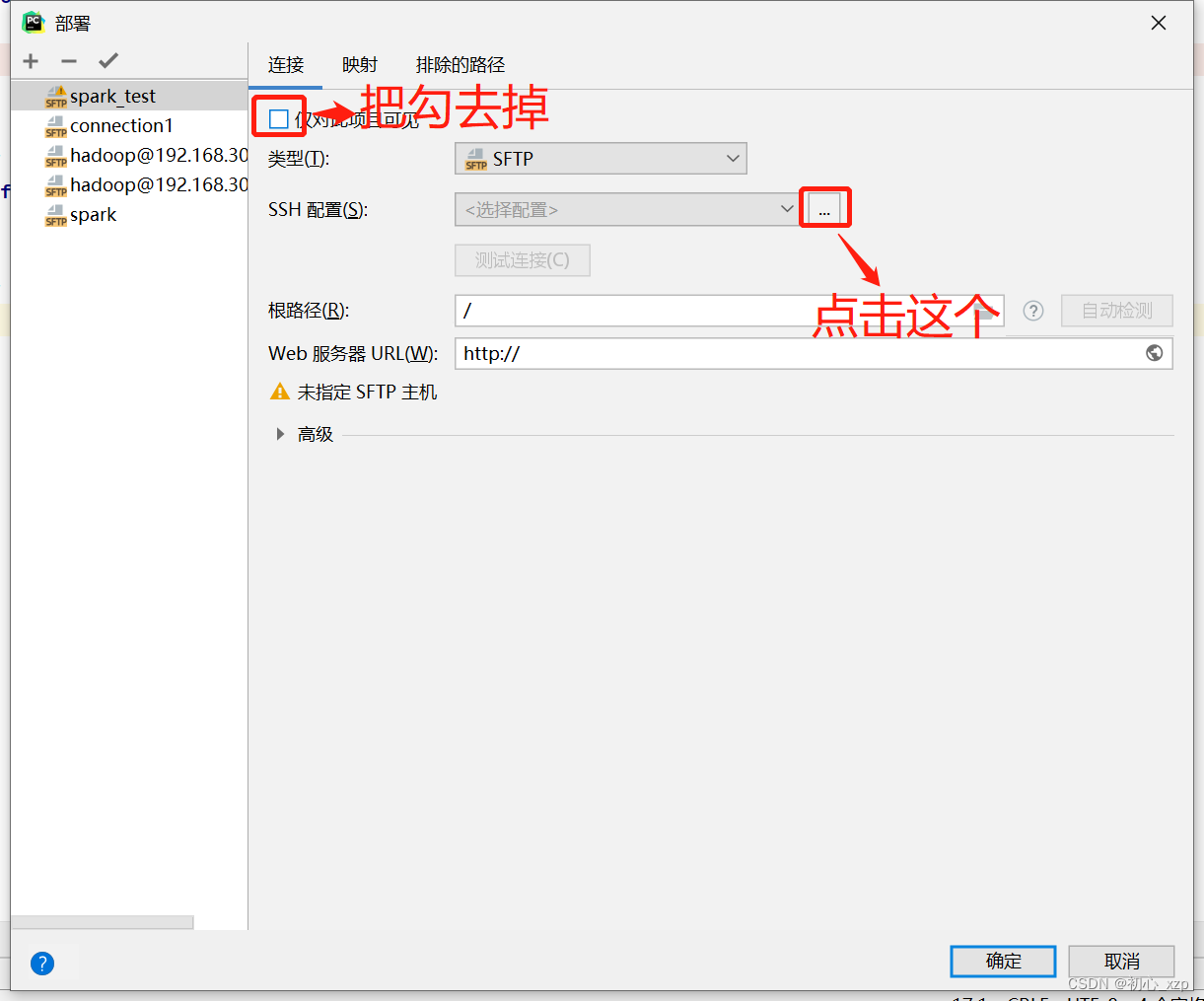

创建SFTP

步骤:

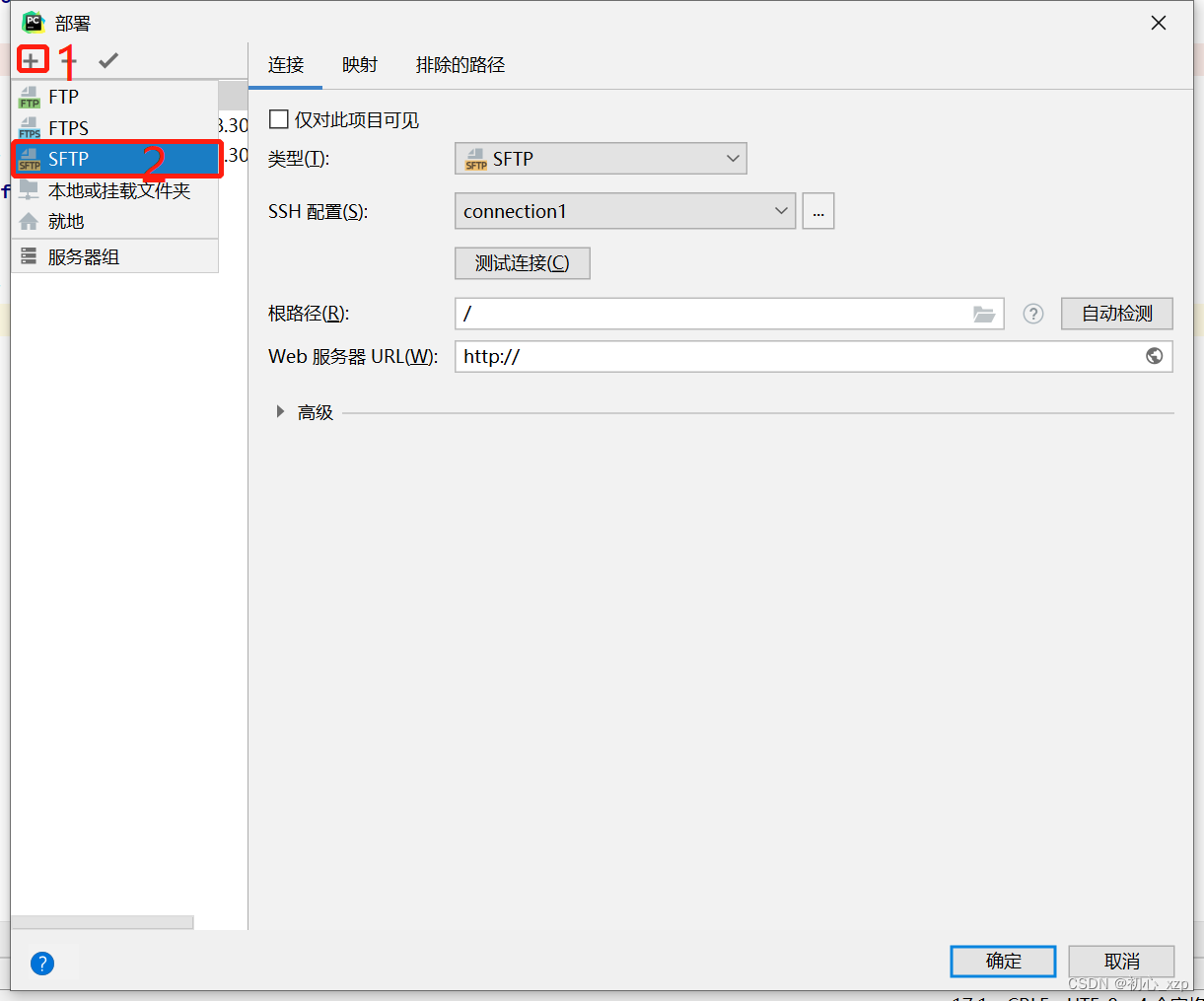

点左上角的+号选择SFTP

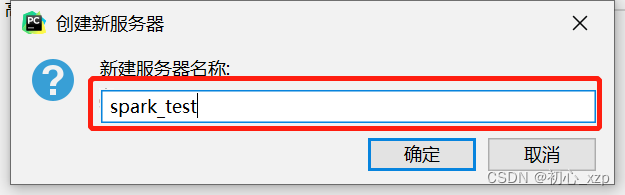

取一个服务器名称

去掉仅对此项目可见的勾,如果不去掉代表只有该项目能用。

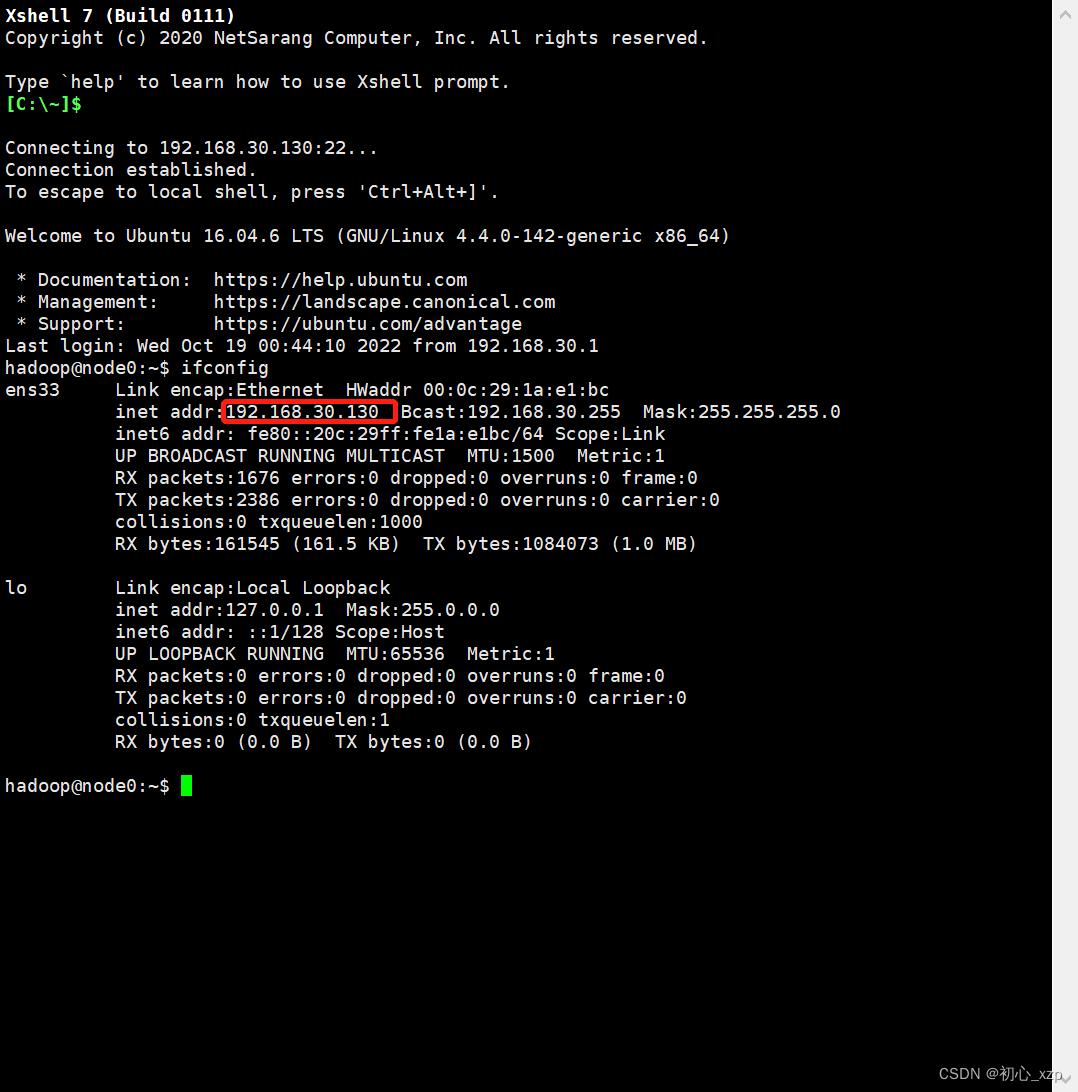

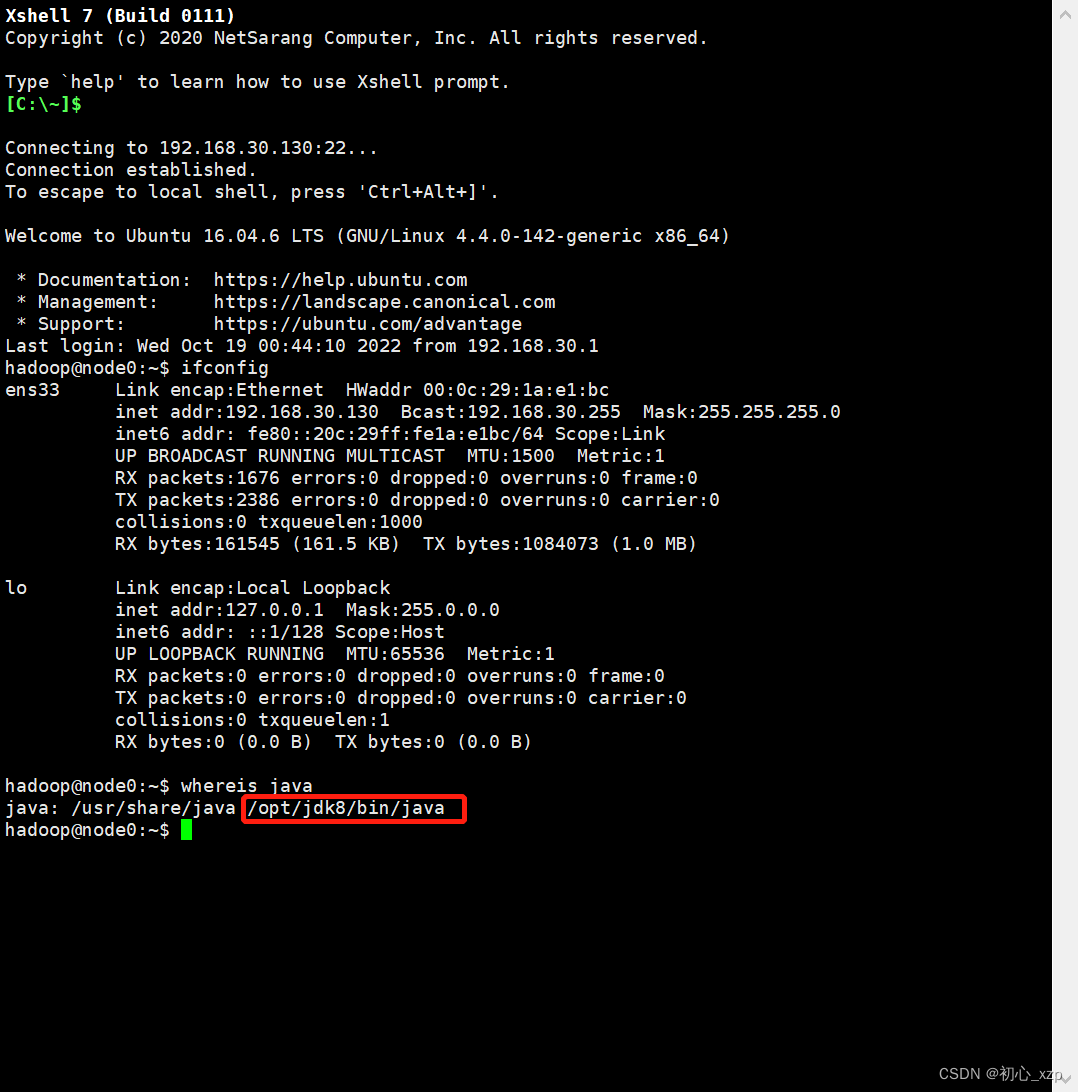

如果忘记spark的ip可以在spark环境中输入ifconfig进行查看

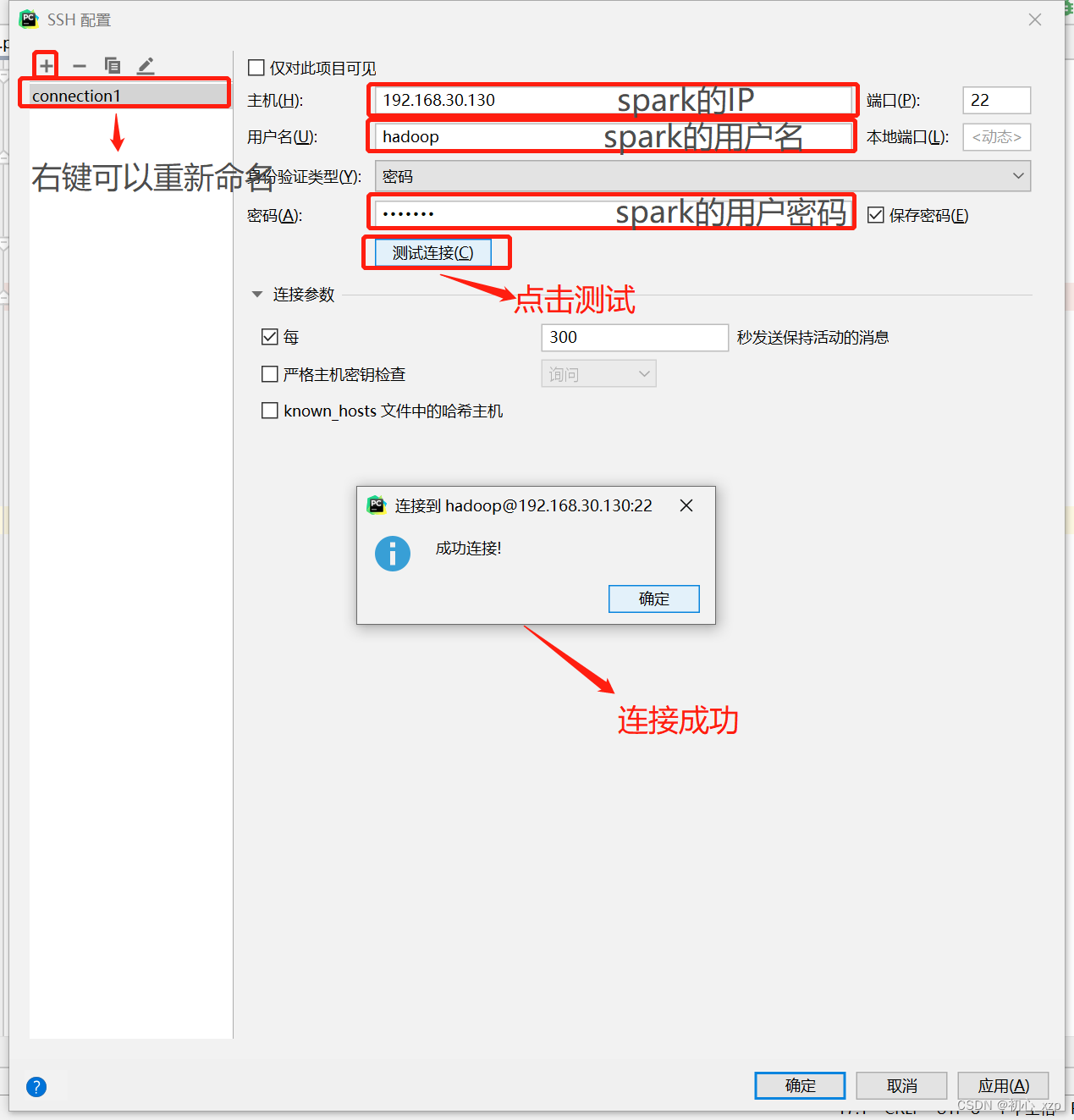

进行主机IP、用户名、密码填写,切记这里的填写的都是spark中的。

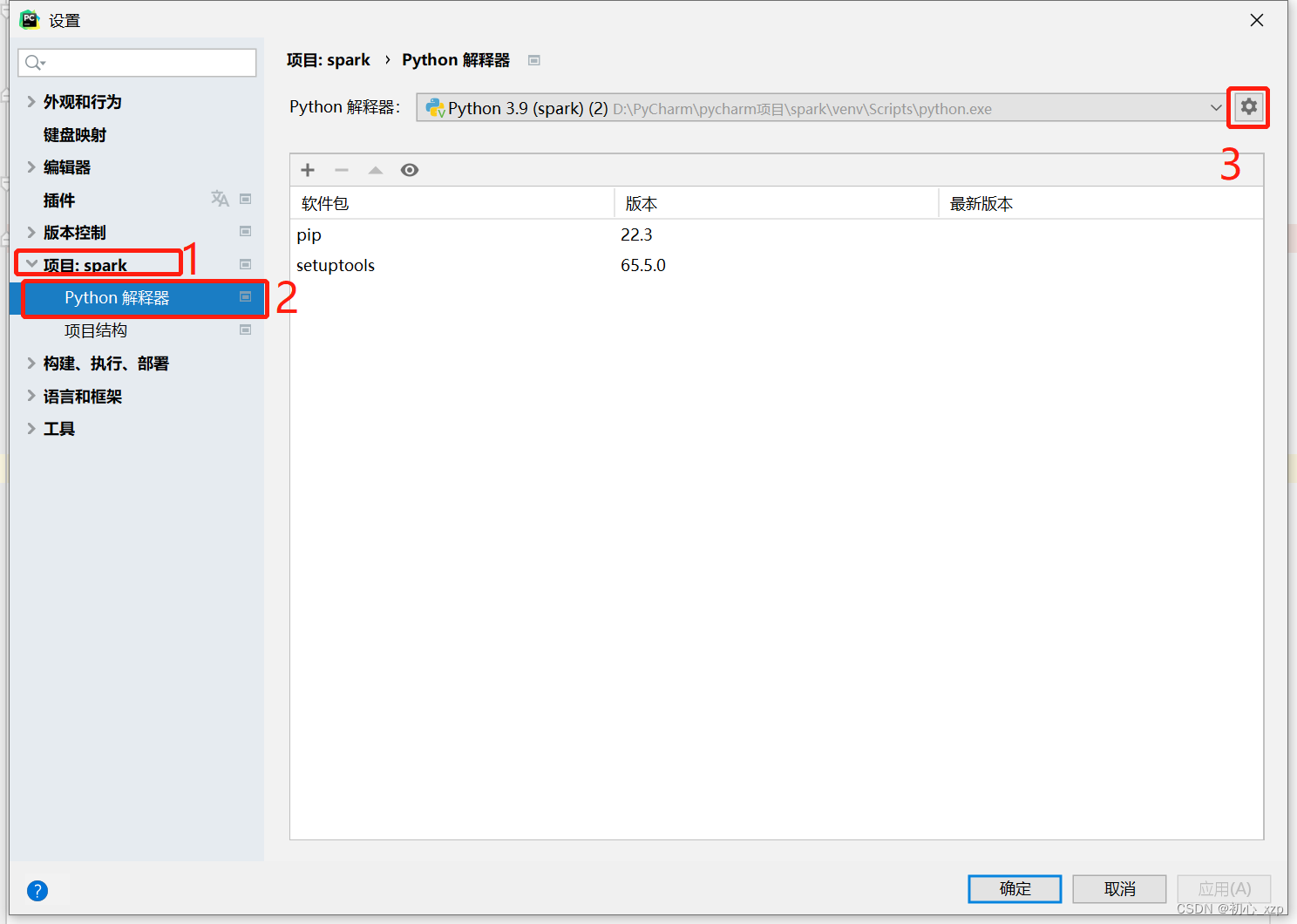

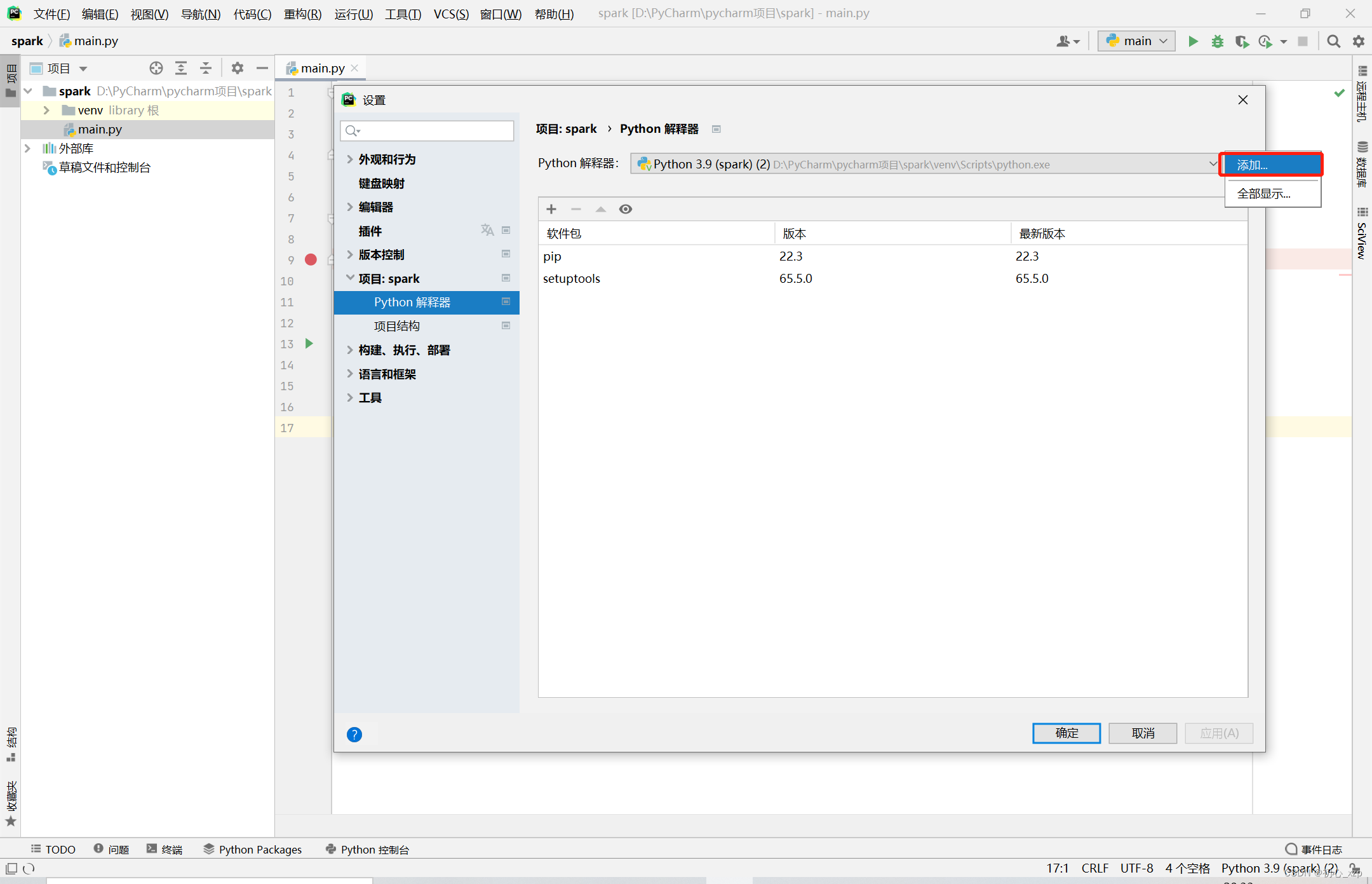

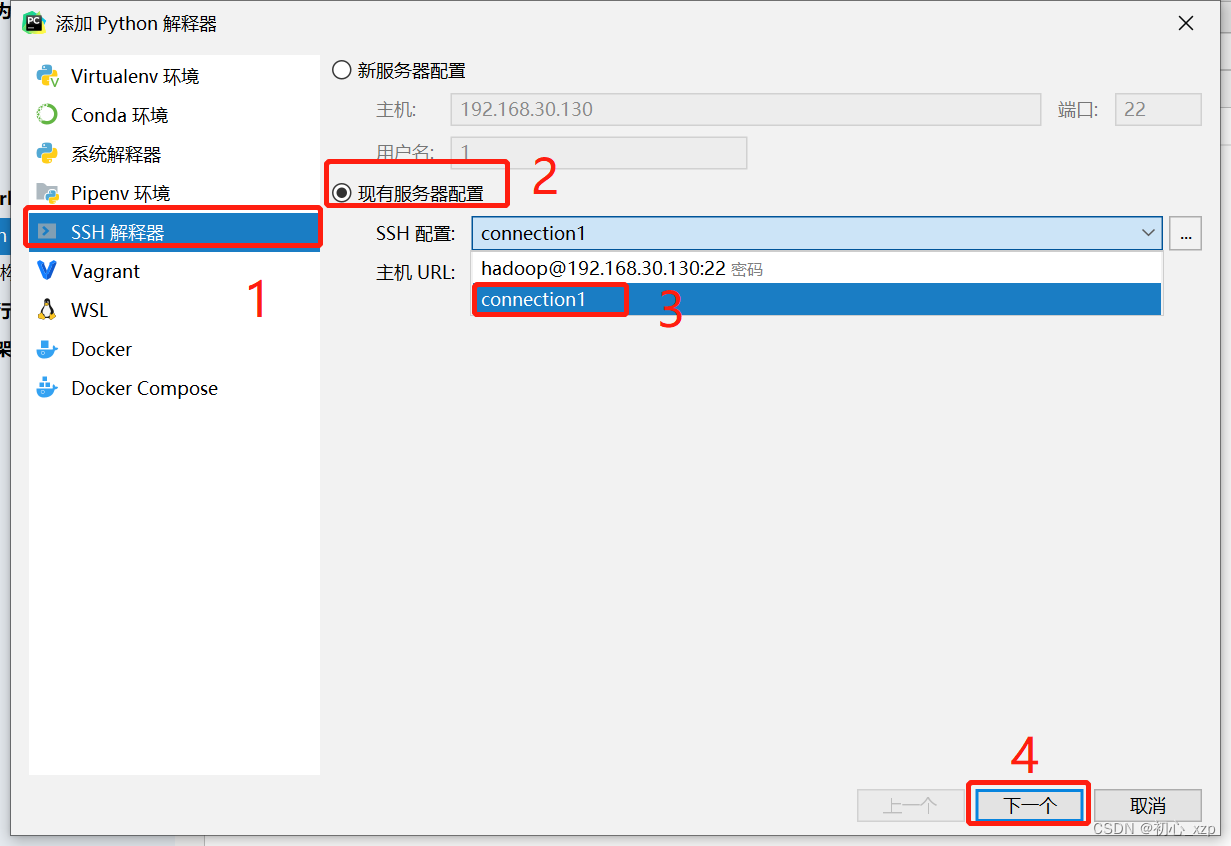

配置python解析器

选择现有服务器配置

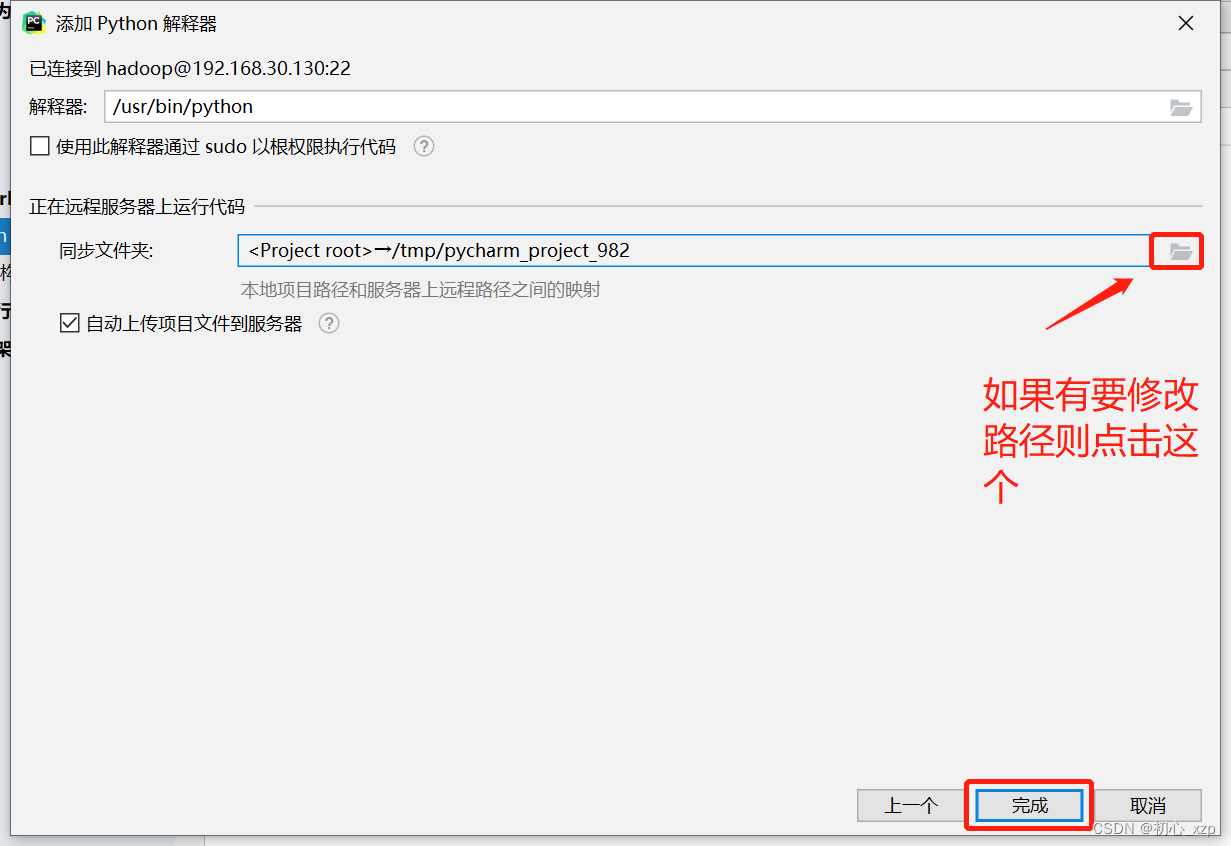

添加python解析器变量,在同步文件夹中建议在spark中创建一个文件来存放,本地项目路径可以使用默认。

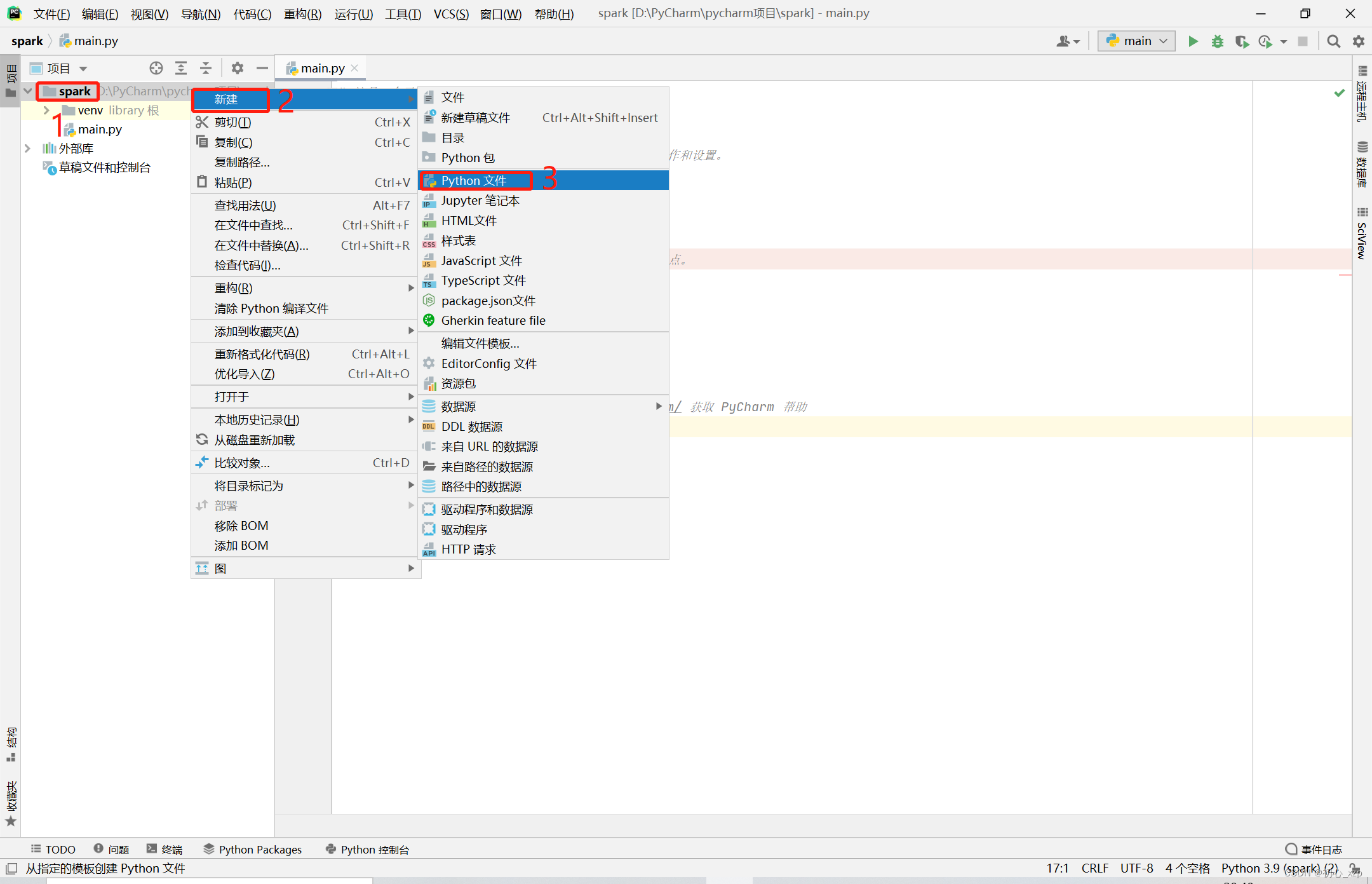

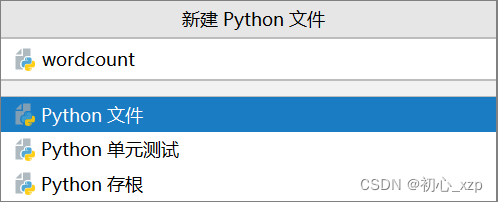

创建python文件

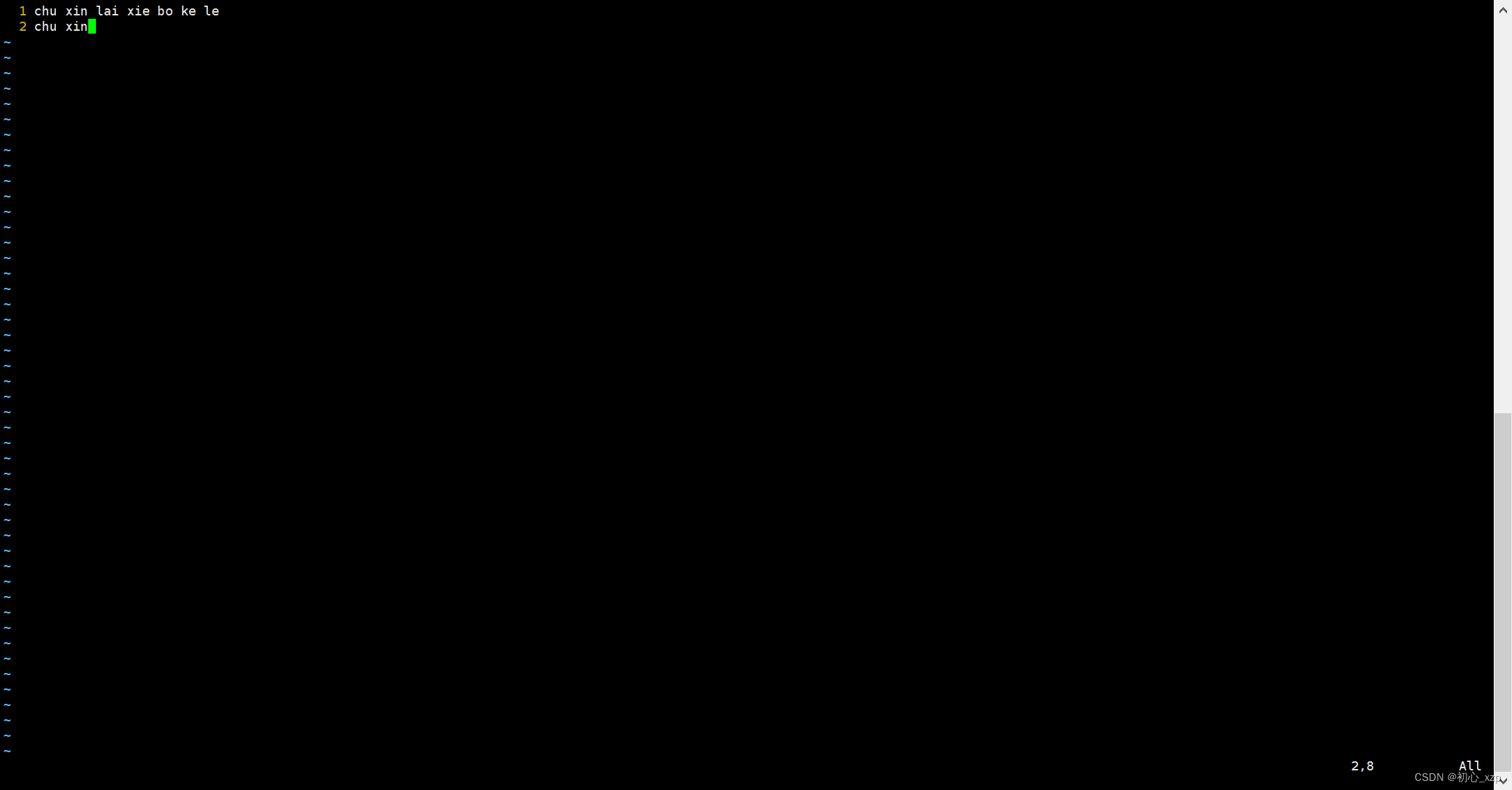

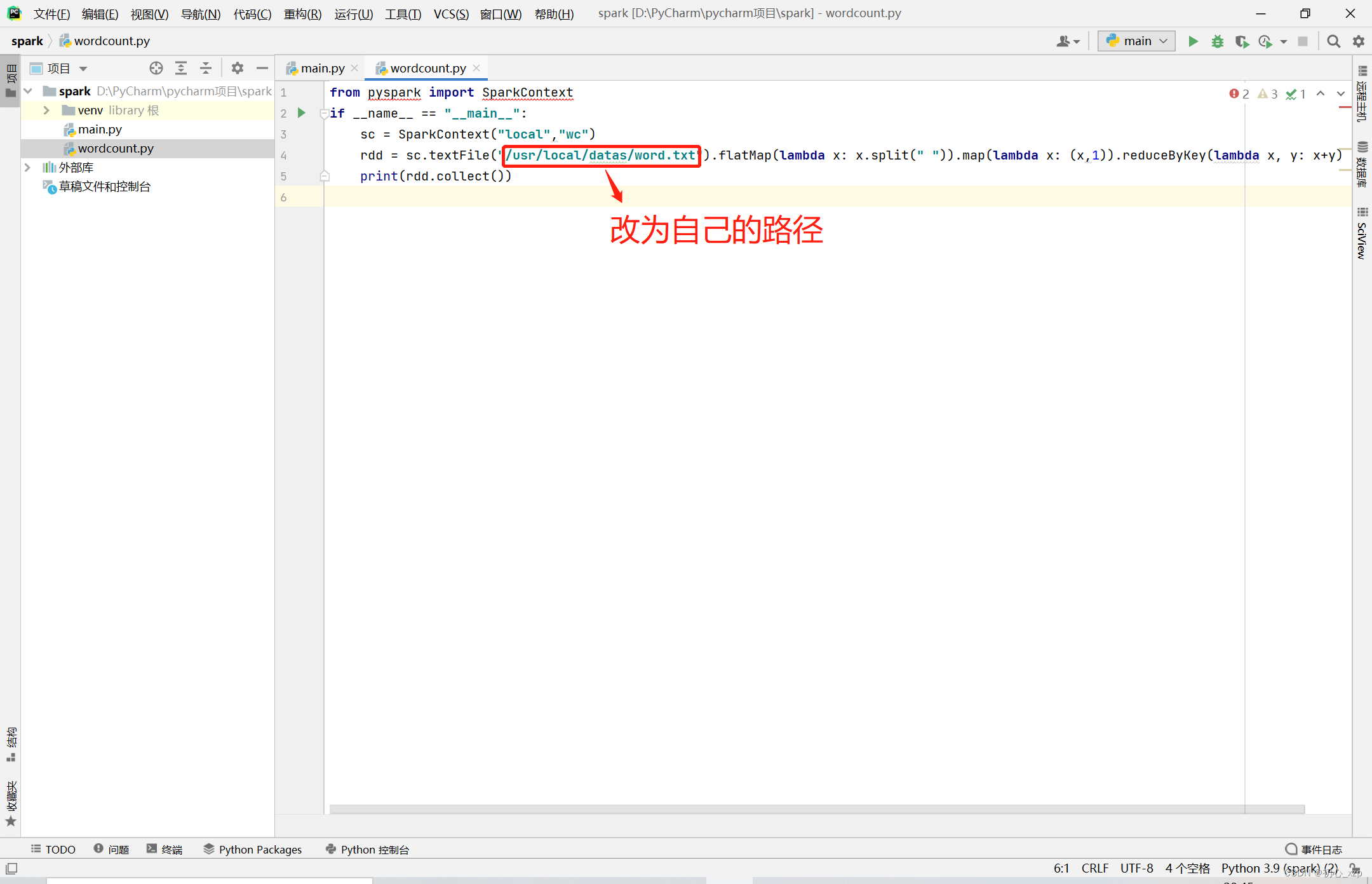

在python输入下面内容进行测试pycharm搭建spark是否成功,注:下面代码中有个路径需要修改为自己的路径。该路径是存放要处理的txt文件,里面需要编写内容,内容可以随意但里面要加入空格(因为里面split是以空格来切片) 例如:chu xin lai xie bo ke le。

在spark中输入

cd /usr/localsudo mkdir datassudo vim word.txt

from pyspark import SparkContext

if __name__ == "__main__":

sc = SparkContext("local","wc")

rdd = sc.textFile("/usr/local/datas/word.txt").flatMap(lambda x: x.split(" ")).map(lambda x: (x,1)).reduceByKey(lambda x, y: x+y)

print(rdd.collect())

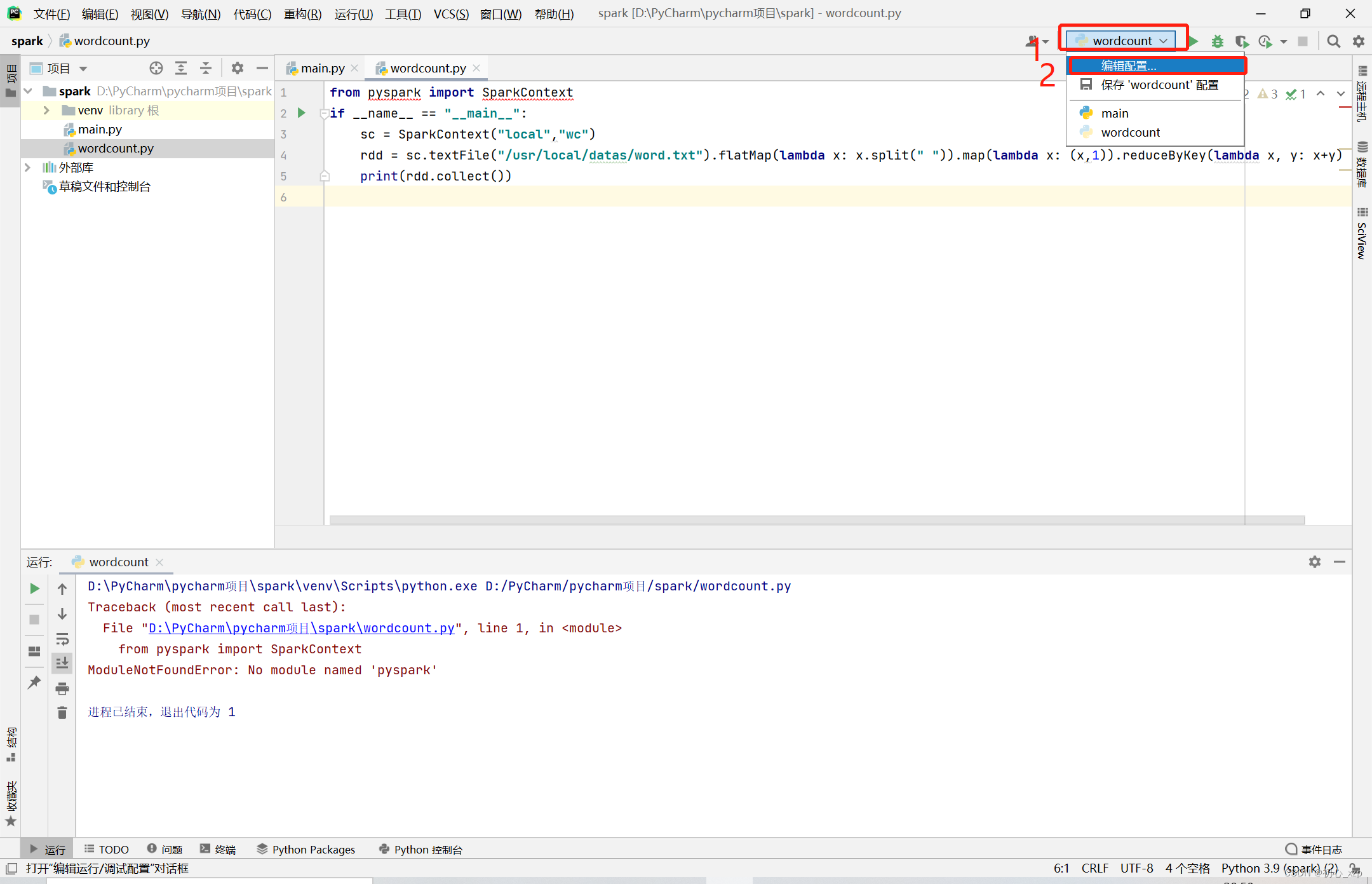

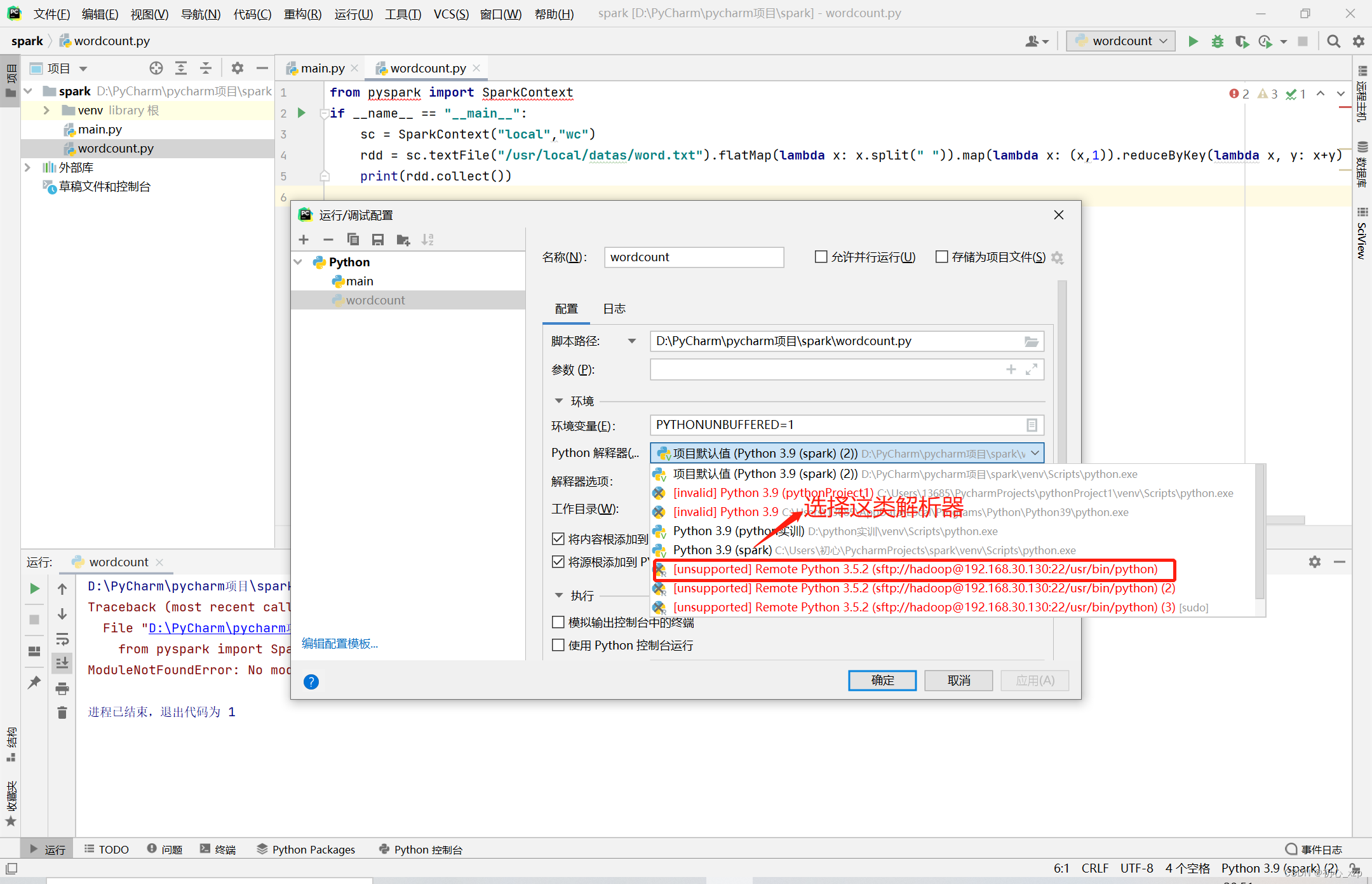

修改解析器

这里的解析器修改为spark环境中的解析器,不是本地的解析器。

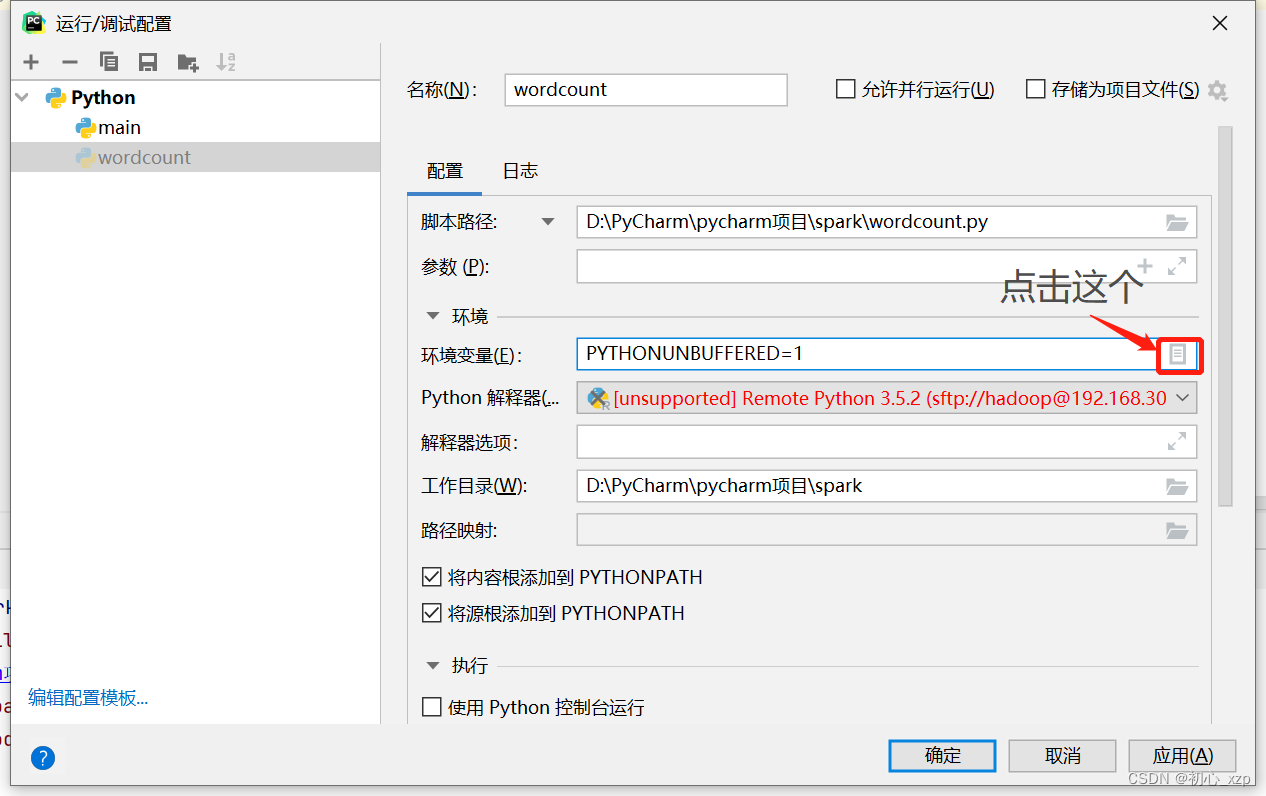

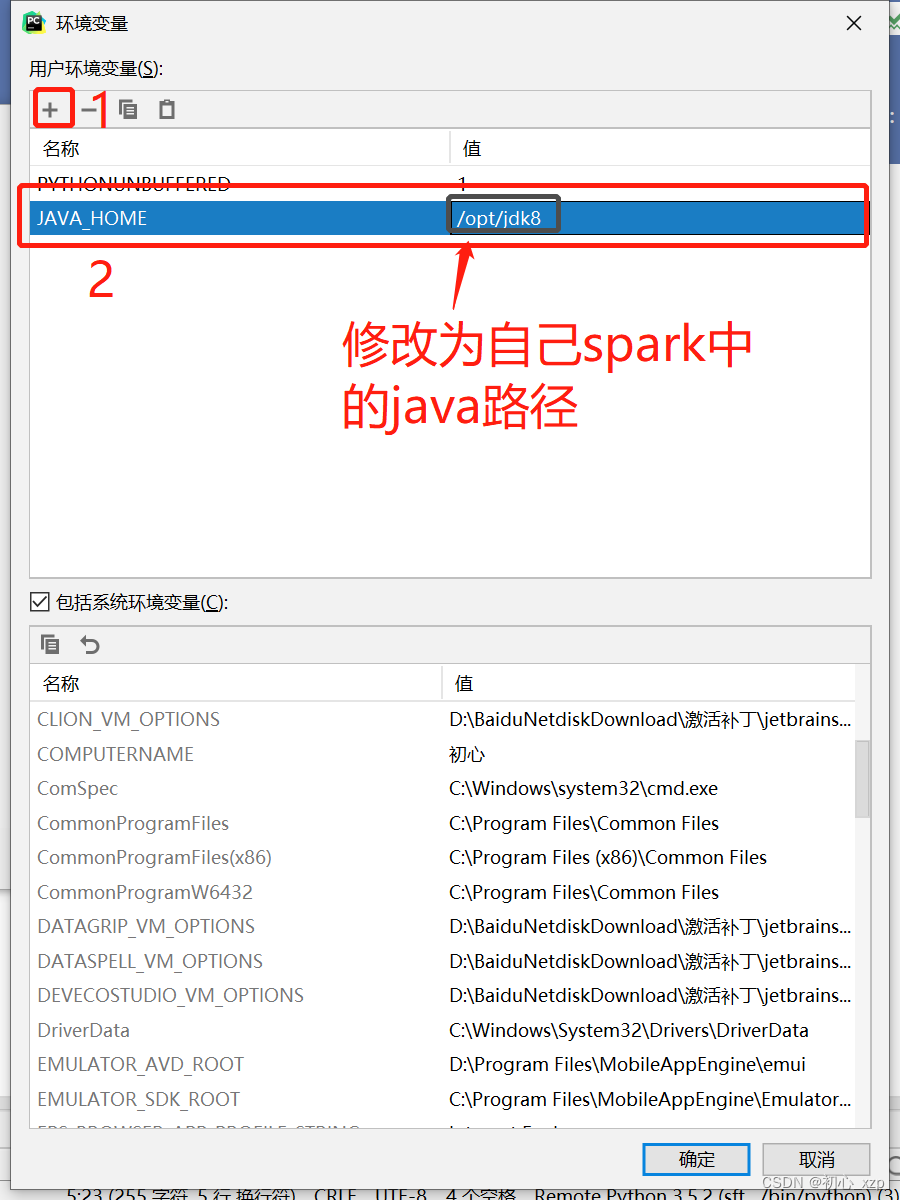

添加环境变量,也就是添加spark中Java的环境变量。

如果不知道自己spark中的java路径可以在spark中输入

whereis java

在spark中创建word.txt文件并在其中输出内容(内容随意但要加入空格例如:chu xin lai xie bo ke le)这里创建文件在spark的/usr/local/datas/word.txt中,如果在创建中遇到权限问题可以选择给文件赋予权限或者在创建文件命令前加上sudo

赋予权限命名

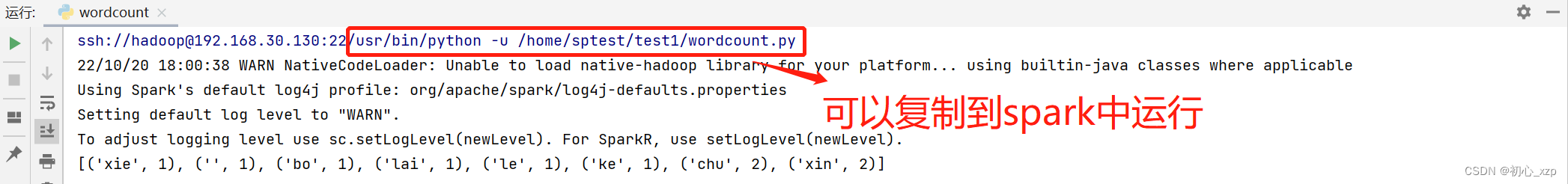

sudo chmod 777 需要赋予权限的文件路径pycharm运行结果 (运行前记得启动hadoop)

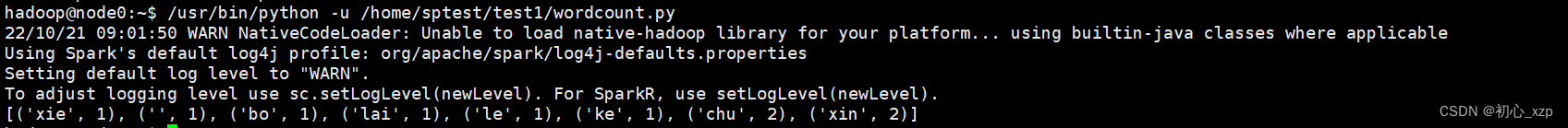

spark运行结果

1871

1871

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?