1.下载并安装 spark-1.6.0-bin-hadoop2.4 , hadoop-2.6.5 同时

添加相应的环境变量 HADOOP_HOME path 等

2. Pycharm 配置 configurations 设置 环境变量 SPARK_HOME PYTHONPATH

3.把spark的python支持包复制到相应的路径中,即在安装python 中 环境的Lib\site-packages目录下 加入 py4j pyspark

PS : py4j, pyspark 包 来自 H:\spark-1.6.0-bin-hadoop2.4\python\lib

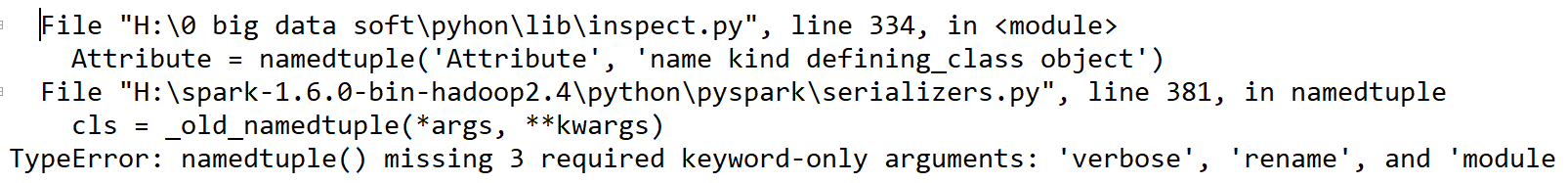

4. 完成后, 运行 第一个 pyspark 程序 遇到以下两个错误

运行错误:TypeError: namedtuple() missing 3 required keyword-only arguments: 'verbose', 'rename', and 'module

解决方案:

Spark的版本是1.6.1,Python是用pycharm安装的,版本是3.6.

spark1.6不支持python3.6

所以 只能 下载 python 3.5 版本 下载安装后 请重新配置 环境变量 和运行py 文件的python interpreter

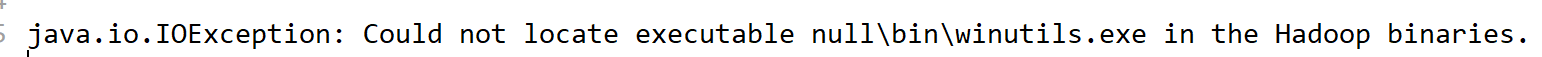

错误2 :Could not locate executable null\bin\winutils.exe in the Hadoop binaries.

解决方案:

hadoop-2.6.5\bin目录下缺少winutils.exe就会报缺少这个文件的错。

下载 winutils.exe 并加入 hadoop-2.6.5\bin目录下

最后 程序即可成功运行。

808

808

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?