RAID磁盘阵列介绍

RAID磁盘阵列详解

RAID磁盘阵列介绍

- 是Redundant Array of lndependent Disks 的缩写,中文简称为独立冗余磁盘阵列

- 把多块独立的物理硬盘按不同的方式组合起来形成一个硬盘组(逻辑硬盘),从而提供比单个硬盘更高的存储性能和提供数据备份技术

- 组成磁盘阵列的不同方式成为RAID级别(RAID Levels)

- 常用的RAID级别

- RAID 0, RAID 1, RAID 5, RAID 6, RAID 1+0 等

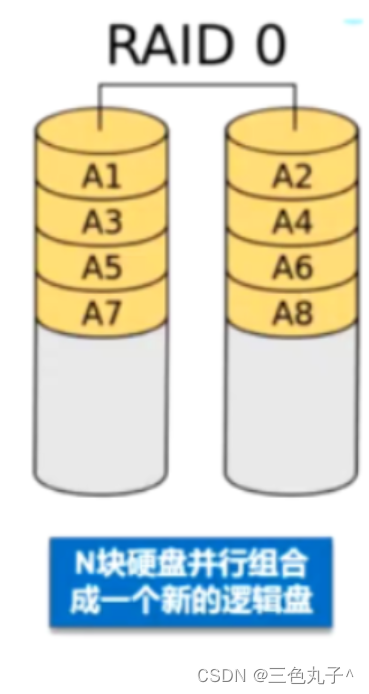

RAID 0 磁盘阵列介绍

-

RAID 0连续以位或字节为单位分割数据,并行读/写于多个磁盘上,因此具有很高的数据传输率,但它没有数据冗余(备份)

-

RAID 0只是单纯地提高性能,并没有为数据的可靠性提供保证,而且其中的一个磁盘失效将影响到所有数据

-

RAID 0不能应用于数据安全性要求高的场合

-

磁盘空间使用率:100%,故成本最低。

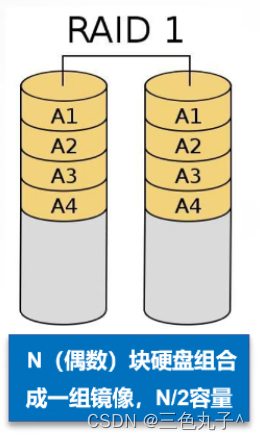

RAID 1 磁盘阵列介绍

-

通过磁盘数据镜像实现数据冗余,在成对的独立磁盘上产生互为备份的数据

-

当原始数据繁忙时,可直接从镜像拷贝中读取数据,因此RAID 1 可以提高读取性能

-

RAID 1 是磁盘阵列中单位成本最高的,但提供了很高的数据安全性和可用性。当一个磁盘失效时,系统可以自动切换到镜像磁盘上读写,而不需要重组失效的数据

-

磁盘空间使用率:50%,故成本最高。

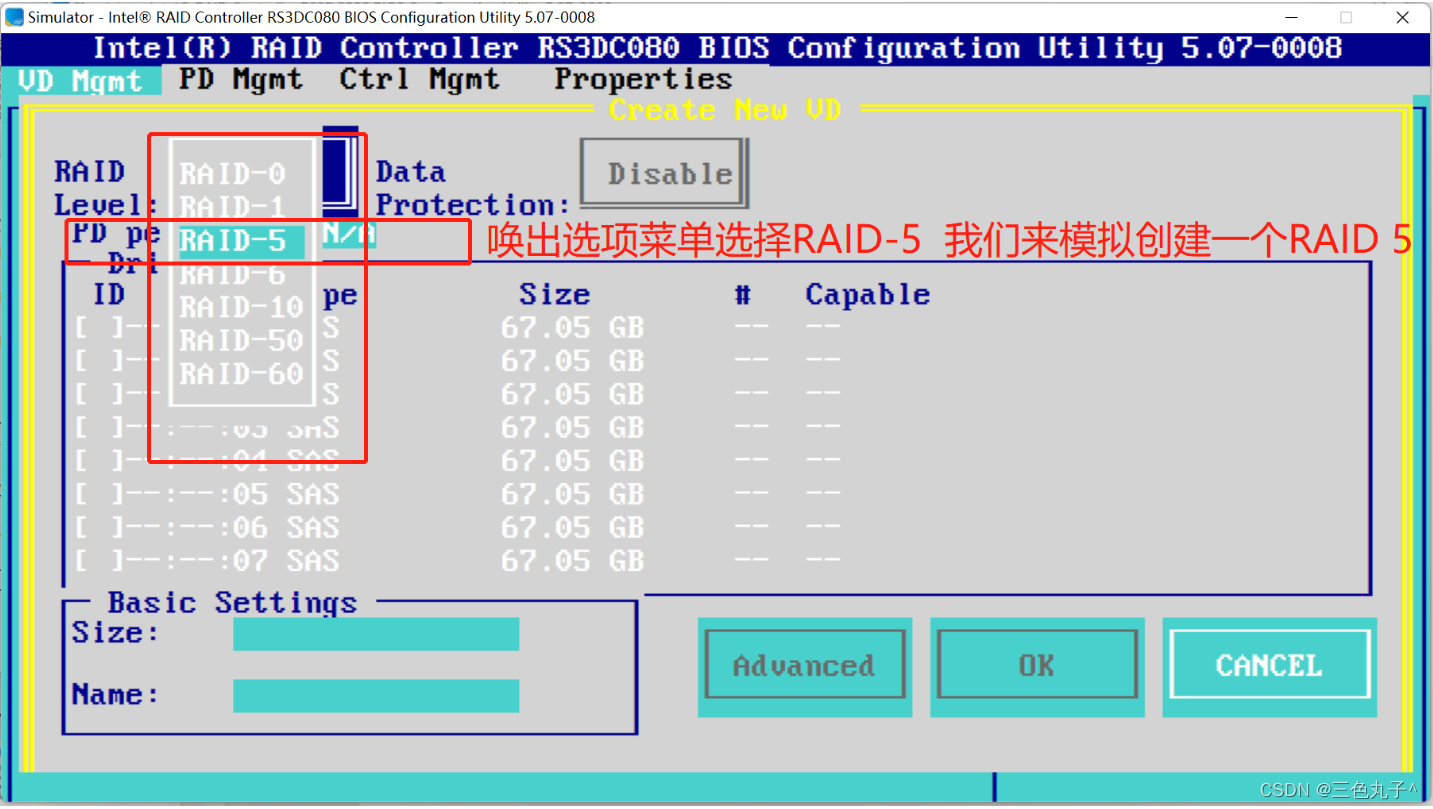

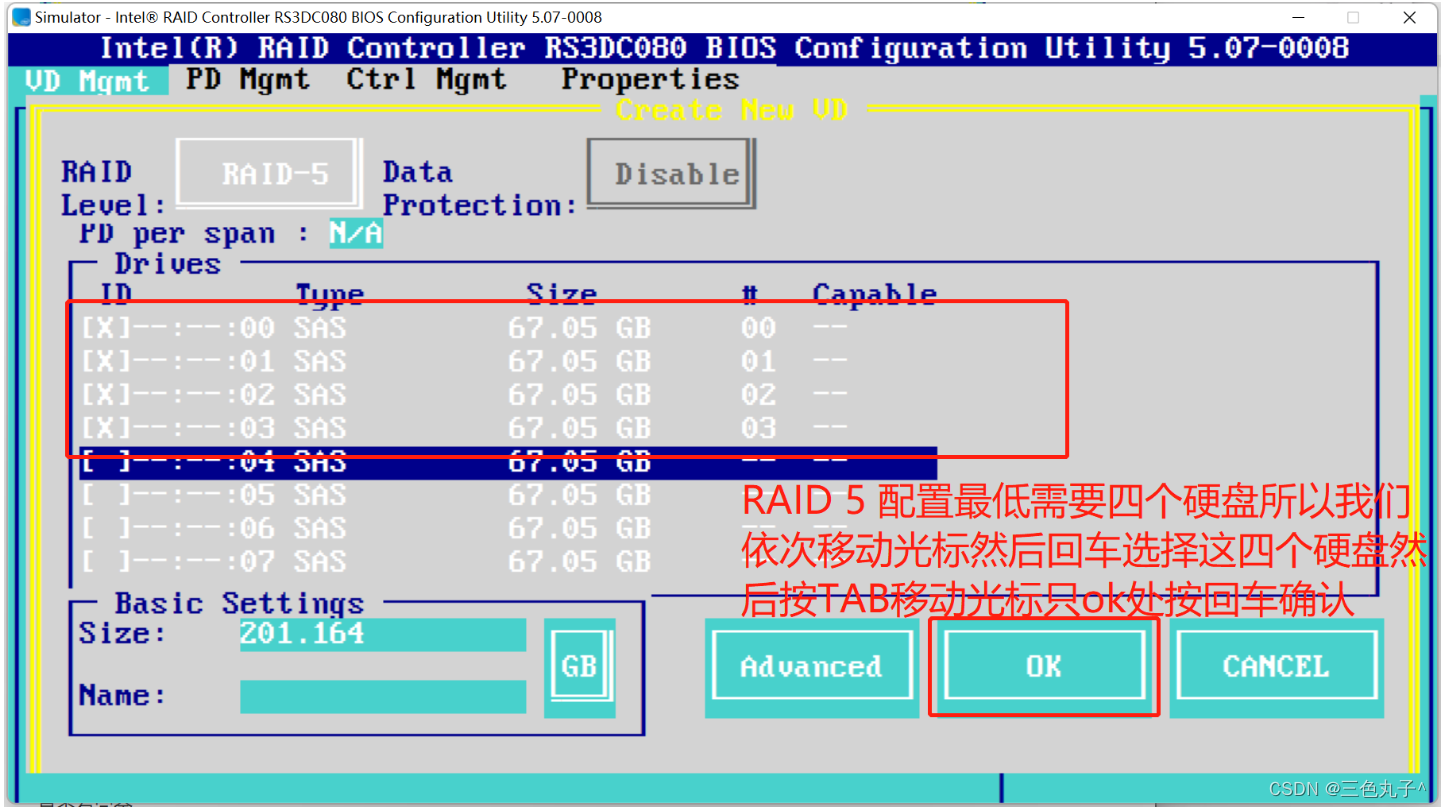

RAID 5 磁盘阵列介绍

-

N(N>=3)块盘组成阵列,一份数据产生N-1个条带,同时还有1份校验数据,共N份数据在N块盘上循环均衡存储

-

N块盘同时读写,读性能很高,但由于有校验机制的问题,写性能相对不高

-

可靠性高,允许坏1块盘,不影响所有数据

-

磁盘空间利用率:(N-1)/N,即只浪费一块磁盘用于奇偶校验

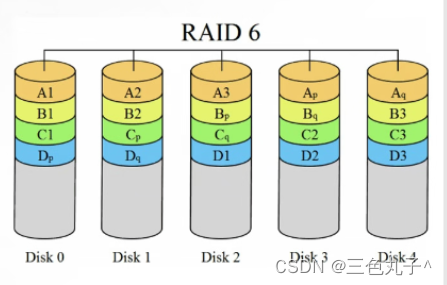

RAID 6 磁盘阵列介绍

-

N(N>=4)块盘组成阵列,(N-2)/N磁盘利用率

-

与RAID 5相比,RAID 6增加了第二个独立的奇偶校验信息块

-

两个独立的奇偶系统使用不同的算法,即使两块磁盘同时失效也不会影响数据的使用

-

相对于RAID 5有更大的“写损失”,因此写性能较差

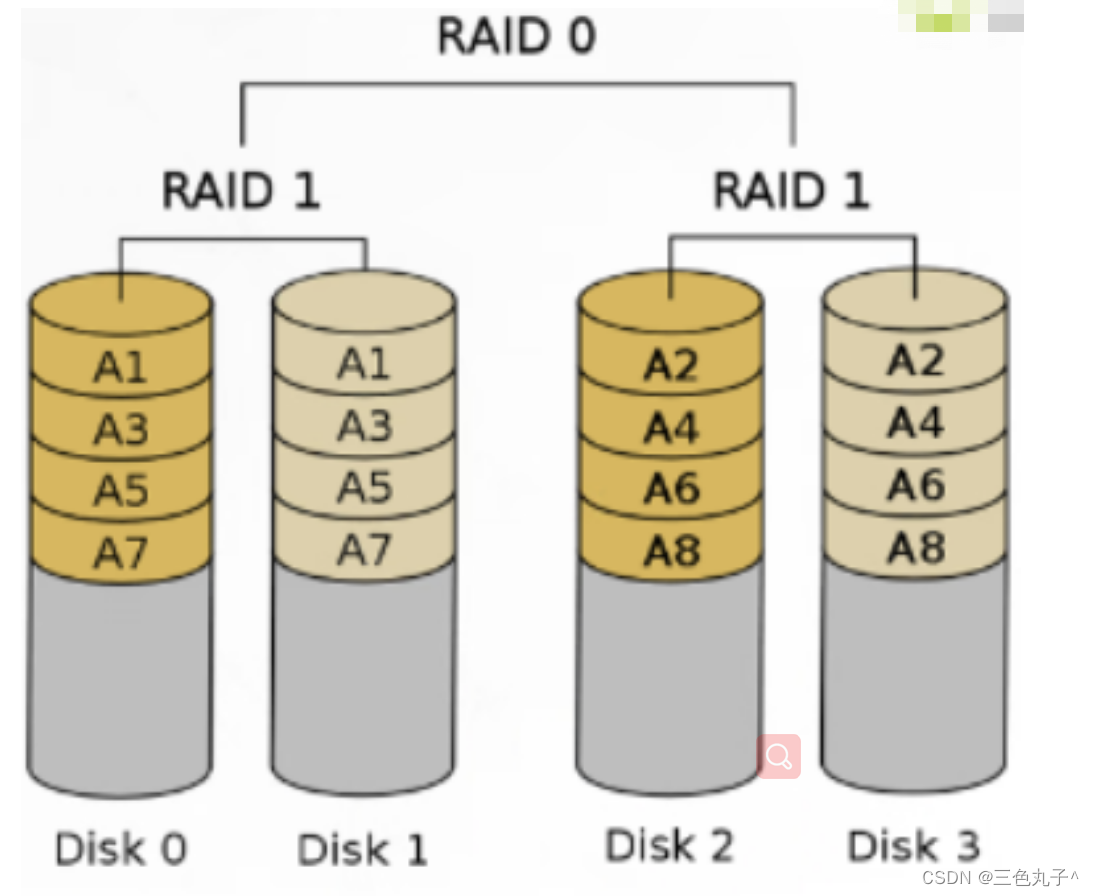

RAID 1+0 磁盘阵列介绍

-

N(偶数,N>=4)块盘两两镜像后,再组合成一个RAID 0

-

N/2磁盘利用率

-

N/2块盘同时写入,N块盘同时读取

-

性能高,可靠性高

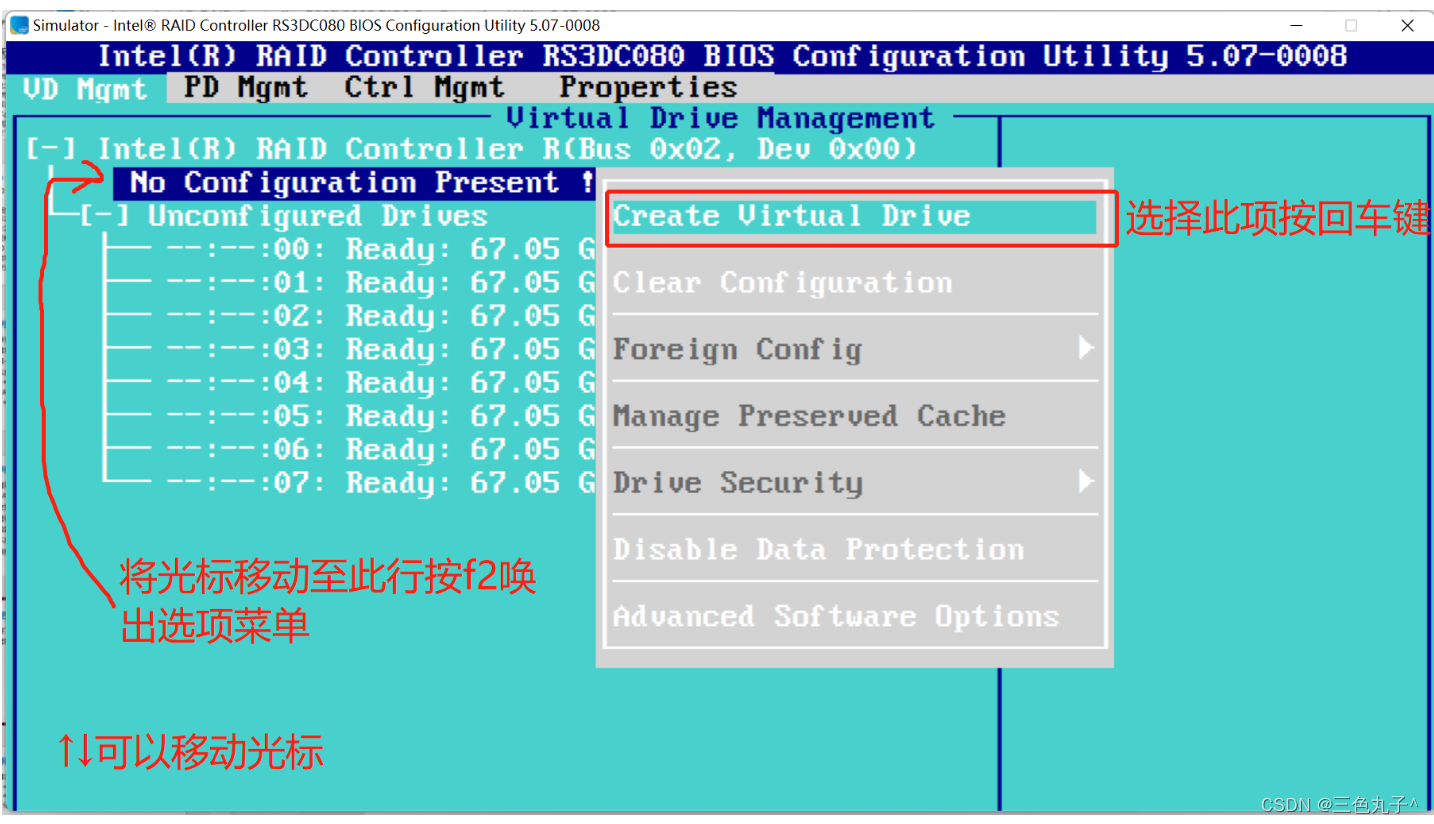

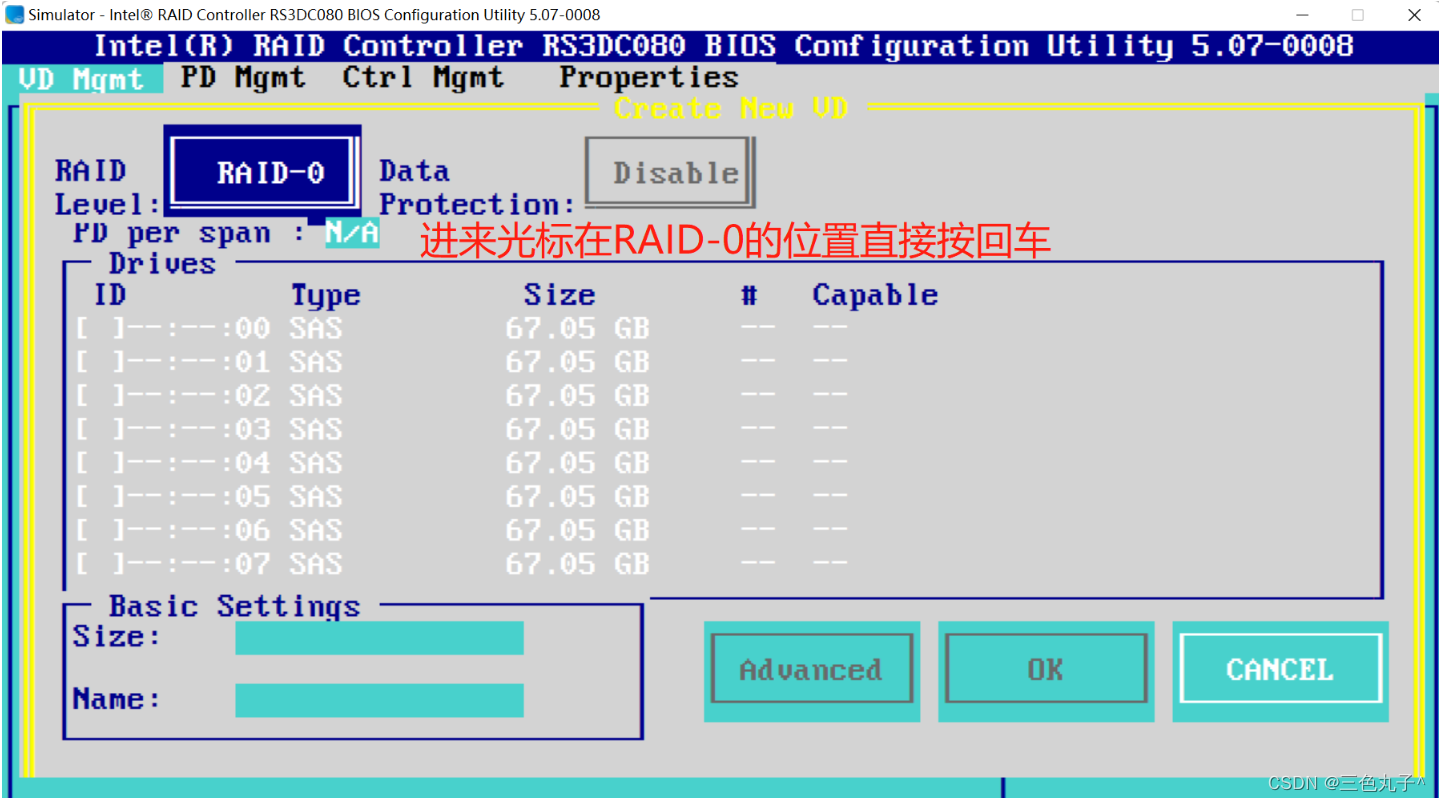

RAID磁盘阵列实战

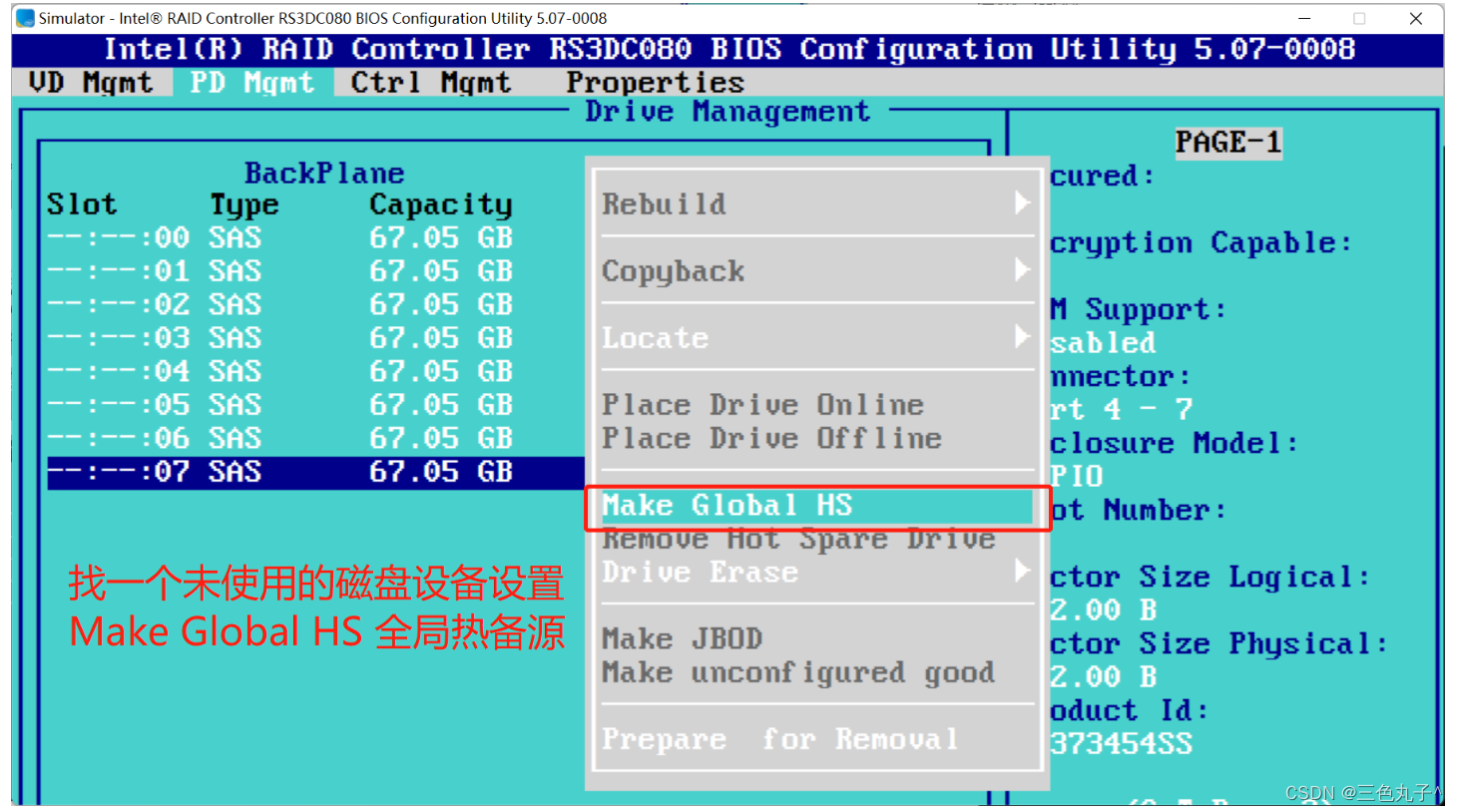

通过硬RAID创建磁盘阵列

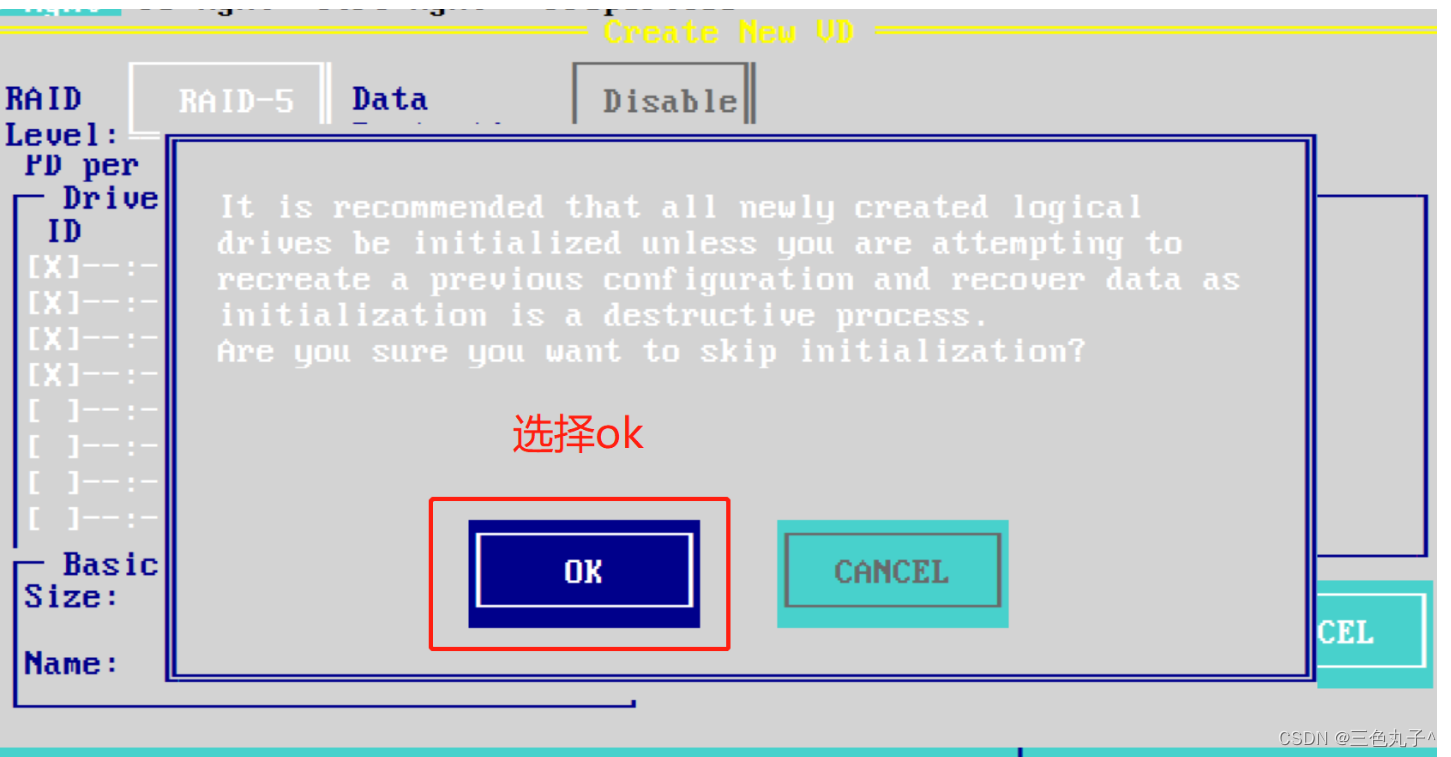

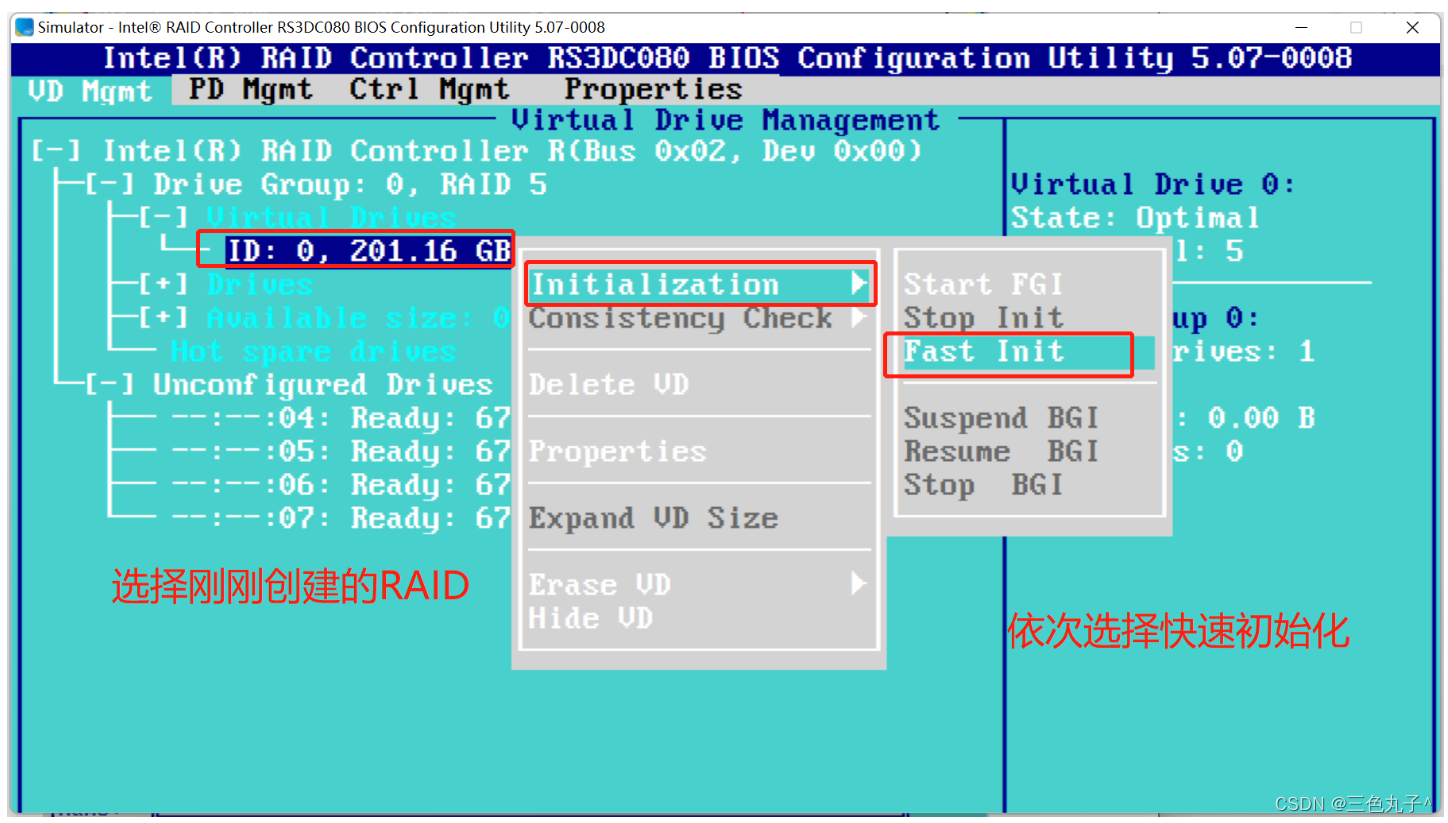

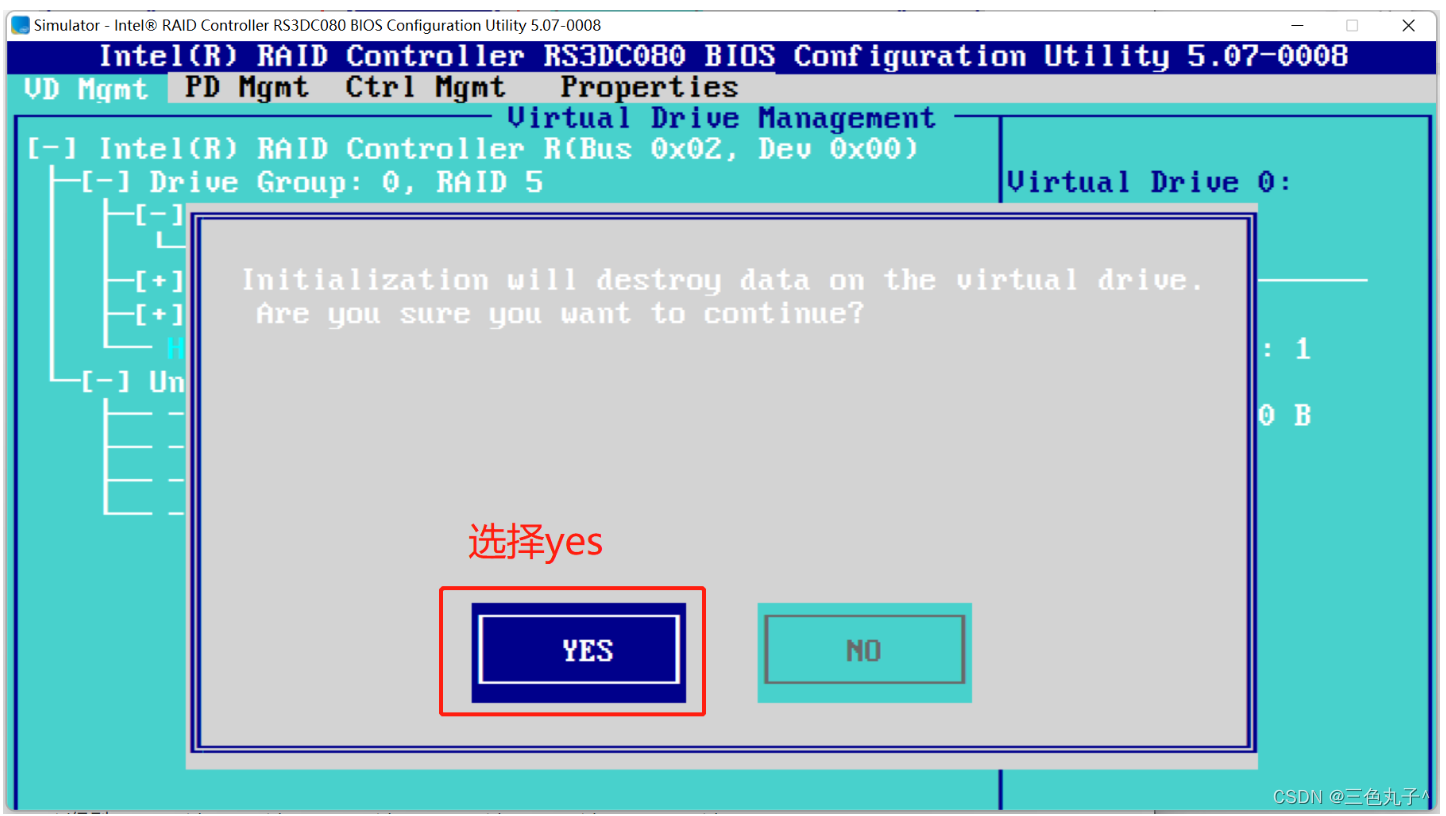

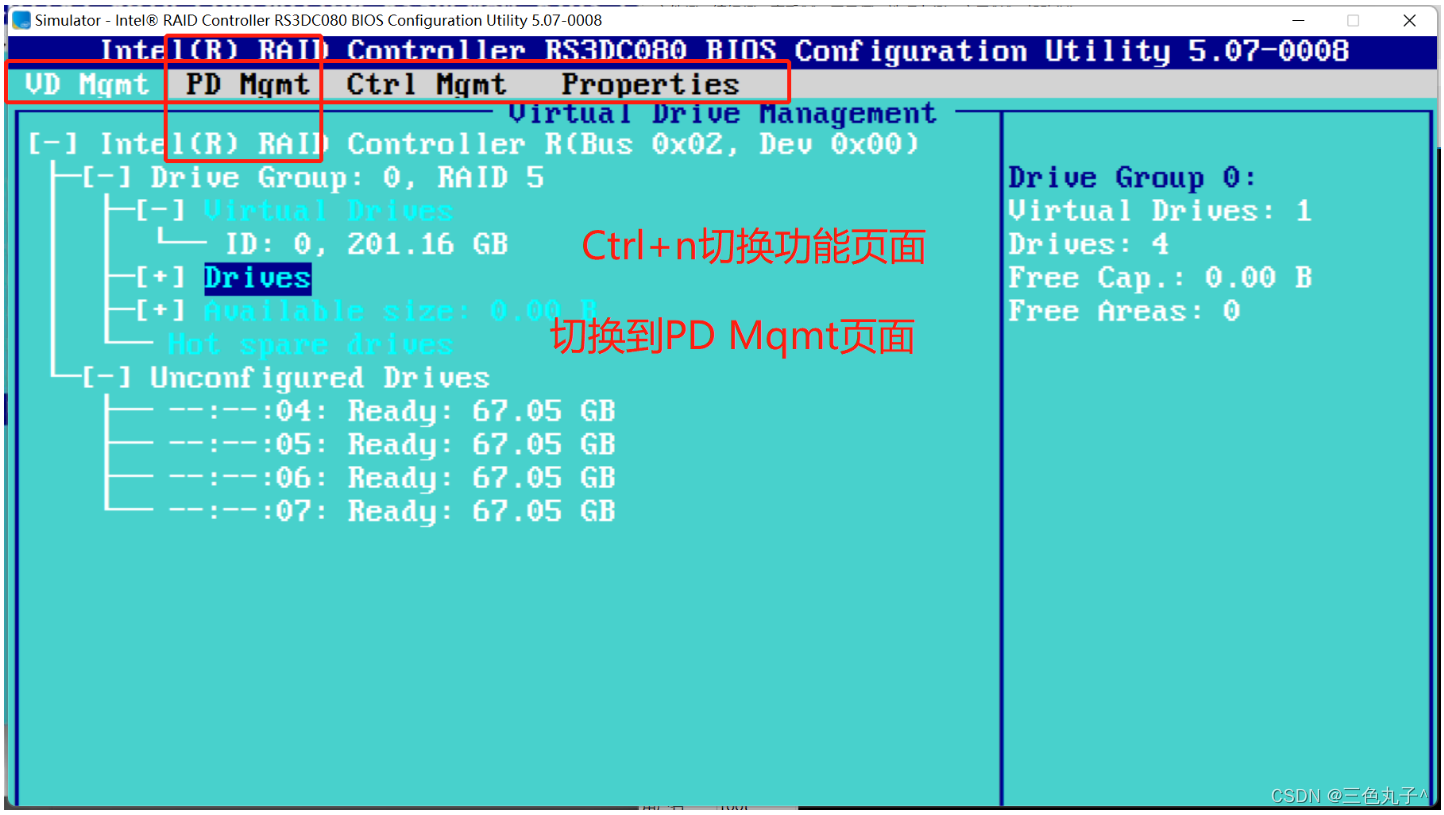

硬件RAID配置仅需三步 先创建RAID 在做初始化 然后创建热备源

1.创建RAID

2.设置初始化

3.创建热备源

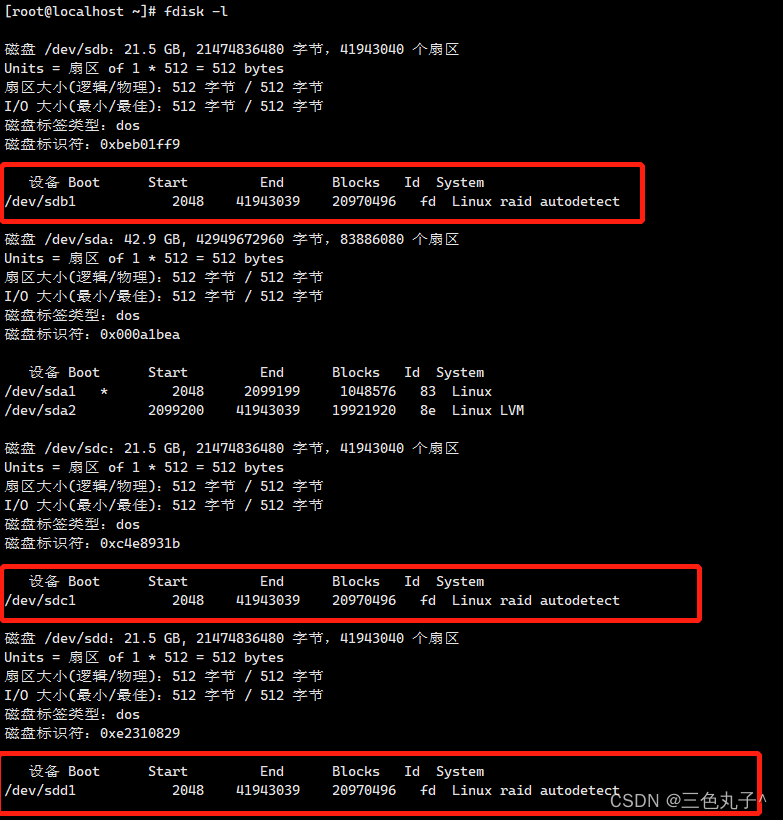

通过软RAID创建磁盘阵列

需求描述:

为Linux服务器添加5块SCSI硬盘

使用mdadm软件包,构建RAID1+0磁盘阵列,并创建一个热备源硬盘,提高磁盘存储的性能和可靠性

第一步:检查是否安装mdadm软件包

rpm -q mdadm

若未安装:yum install -y mdadm

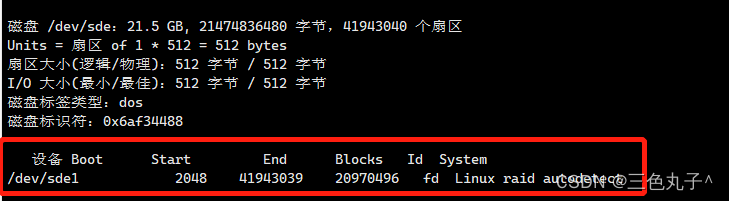

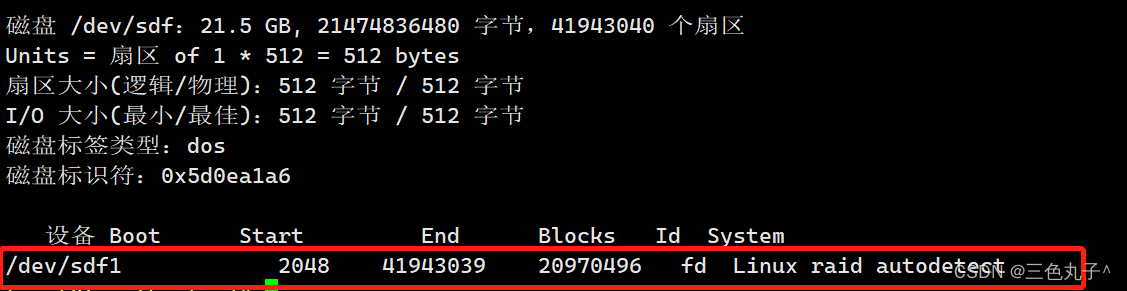

第二步:使用fdisk工具将新磁盘设备划分出主分区,并且把分区类型的ID标记改为’fd’

fdisk [磁盘设备名称]

划分出:sdb1 sdc1 sdd1 sde1 sdf1

第三步:创建RAID设备

两种方法

第一种

mdadm -C -v /dev/md0 [-a yes] -l1 -n2 /dev/sdb1 /dev/sdc1 -x1 /dev/sdf1

mdadm -C -v /dev/md1 [-a yes] -l1 -n2 /dev/sdd1 /dev/sde1 -x1 /dev/sdf1

mdadm -C -v /dev/md10 [-a yes] -l0 -n2 /dev/md0 /dev/md1 -x1 /dev/sdf1

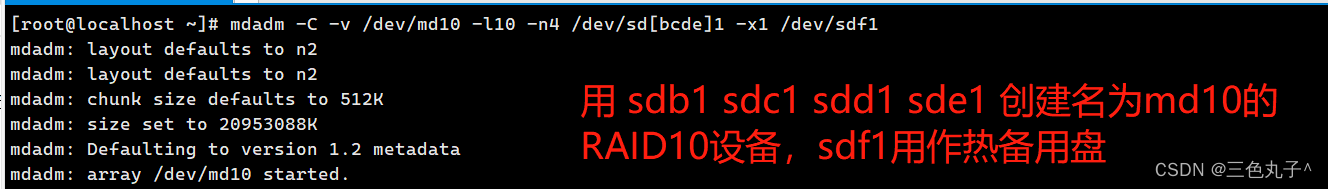

第二种

mdadm -C -v /dev/md10 -l10 -n4 /dev/sd[bcde]1 -x1 /dev/sdf1

-C:表示新建

-v:显示创建过程中的详细信息

/dev/md0:创建的RAID设备名称

-a yes :–auto,表示如果有什么设备文件没有存在的话就自动创建,可省略

-l:指定RAID的级别,l1表示创建RAID1

-n:指定使用几块硬盘创建RAID,n2表示使用2块硬盘创建RAID

/dev/sdb1 /dev/sdc1:表示使用这两块磁盘分区去创建RAID

-x:指定使用几块硬盘做RAID的热备用盘,x1表示保留一块空闲的硬盘作备用

/dev/sdf1:指用作于备用的磁盘

-E:检查磁盘是否已做RAID (mdadm -E /dev/sdb1)

-D:#查看RAID磁盘详细信息(mdadm /dev/md10)或者cat /proc/mdstat 还能查看创建RAID的进度

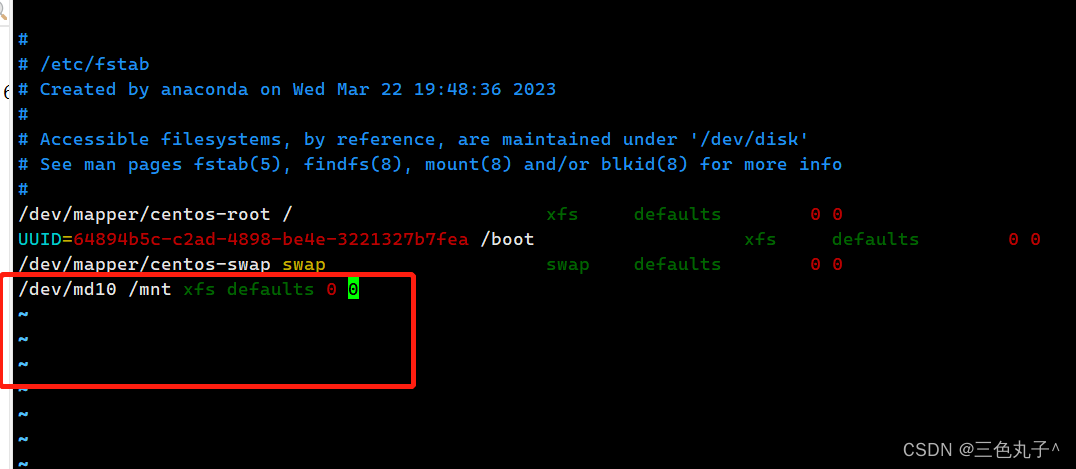

第四步:创建并挂载文件系统

mkfs.xfs /dev/md10

vim /etc/fstab 永久挂载

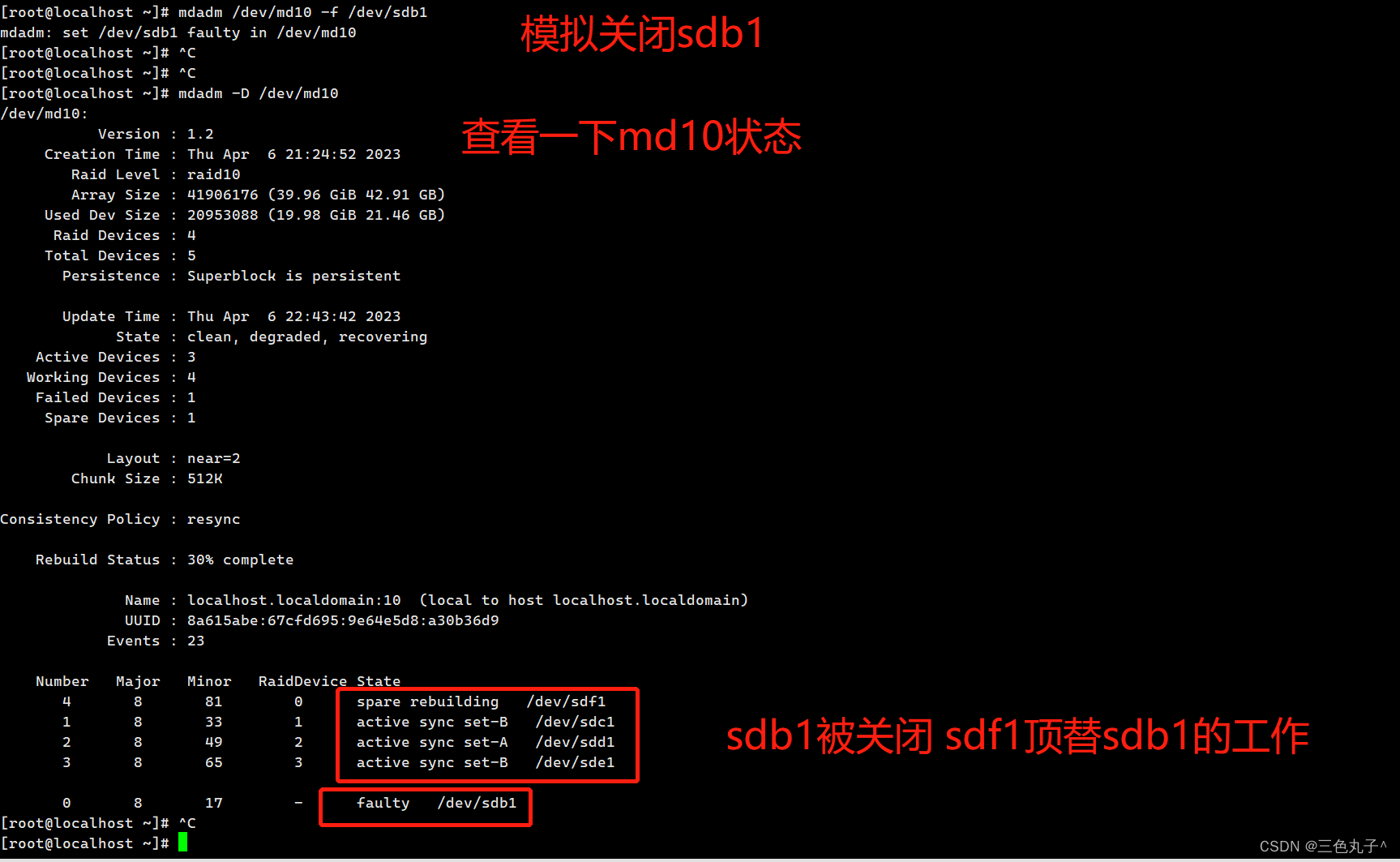

第五步:实现故障恢复

mdadm /dev/md10 -f /dev/sdb1 #模拟/dev/sdb1 故障

mdadm -D /dev/md0 #查看发现sdf1已顶替sdb1

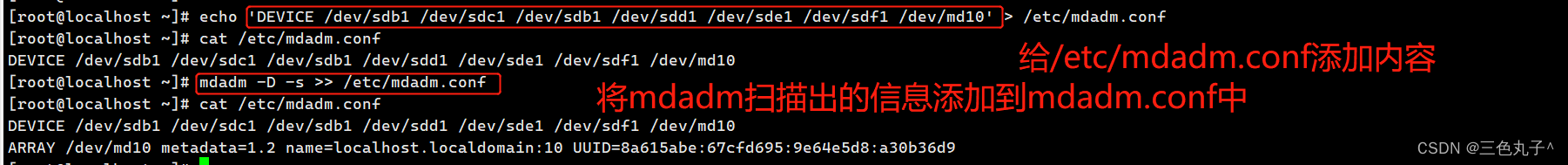

第六步:创建 /etc/mdadm.conf 配置文件,方便管理软RAID的配置,比如启动、停止

echo ‘DEVICE /dev/sdb1 /dev/sdc1 /dev/sdb1 /dev/sdd1 /dev/sde1 /dev/sdf1 /dev/md10’ > /etc/mdadm.conf

mdadm -D -s >> /etc/mdadm.conf

在操作之前需要先将md10接触挂载状态

umount /dev/md10

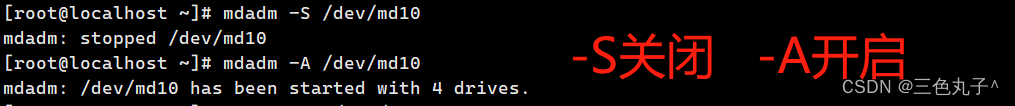

mdadm命令:

-r:移除设备

-a:添加设备

-S:停止RAID

-A:启动RAID

3395

3395

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?