案例需求和分析

过滤输入的log日志,包含atguigu的网站输出到e:/atguigu.log,不包含atguigu的网站输出到e:/other.log。

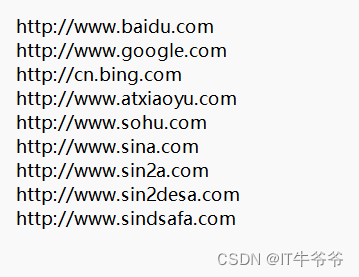

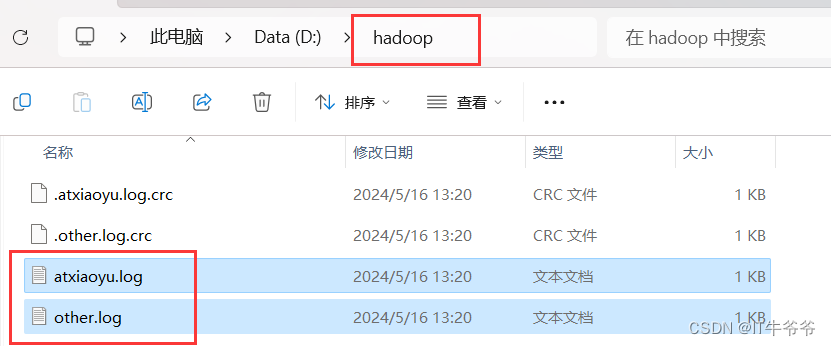

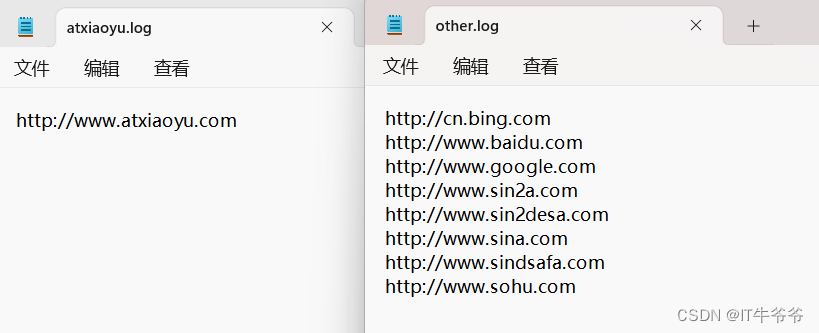

输入数据:

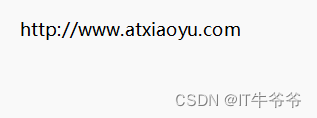

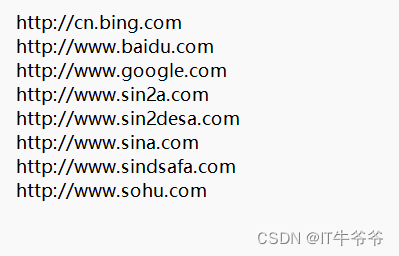

期望输出数据两个文件:

我们可以看到这里的需求跟分区差不多,可能会想到用Partition分区去做,但是不行,在Hadoop的MapReduce框架中,OutputFormat接口和Partitioner类在数据处理和结果输出方面扮演着不同的角色。尽管它们都与数据的最终输出位置有关,但它们的关注点和使用场景是不同的。

OutputFormat接口定义了如何将MapReduce作业的输出数据写入存储系统(如HDFS、本地文件系统、HBase等)。它负责数据的物理写入过程,包括文件格式的转换、数据的序列化等。

如果我们想把不同的输出结果输出到不同的文件中,我们可以自定义一个OutputFormat实现。在这个实现中,我们可以根据某些条件(如键的特定值或值的特定属性)将数据写入不同的文件。

Partitioner类用于在MapReduce作业中确定Reducer的分区。Mapper产生的每个键值对(key-value pair)都会通过Partitioner来确定它应该被发送到哪个Reducer进行处理。默认情况下,Hadoop使用HashPartitioner,它根据键的哈希值将键值对分配到不同的Reducer。

如果我们希望根据某些条件将数据分配到不同的Reducer,我们可以自定义一个Partitioner。例如,如果希望根据键的某个属性将数据分成几个逻辑组,并将每个组发送到不同的Reducer进行处理。这样,每个Reducer就可以独立地处理一组数据,并将结果输出到单独的文件(如果OutputFormat允许的话)。

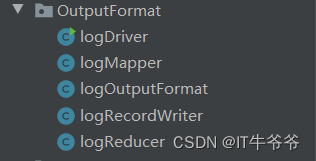

代码和结果分析

package OutputFormat;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class logDriver {

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

job.setJarByClass(logDriver.class);

job.setMapperClass(logMapper.class);

job.setReducerClass(logReducer.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(NullWritable.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(NullWritable.class);

//设置自定义的outputformat

job.setOutputFormatClass(logOutputFormat.class);

FileInputFormat.setInputPaths(job, new Path("D:\\input"));

//虽然我们自定义了outputformat,但是因为我们的outputformat继承自fileoutputformat

//而fileoutputformat要输出一个_SUCCESS文件,所以在这还得指定一个输出目录

FileOutputFormat.setOutputPath(job, new Path("D:\\logoutput"));

boolean b = job.waitForCompletion(true);

System.exit(b ? 0 : 1);

}

}

package OutputFormat;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

public class logMapper extends Mapper<LongWritable, Text,Text, NullWritable> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//不做任何处理,直接写出一行log数据

context.write(value,NullWritable.get());

}

}

package OutputFormat;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.RecordWriter;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class logOutputFormat extends FileOutputFormat<Text, NullWritable> { //reduce输出的ky就到了OutputFormat

@Override

public RecordWriter<Text, NullWritable> getRecordWriter(TaskAttemptContext job) throws IOException, InterruptedException {

logRecordWriter lrw=new logRecordWriter(job);

return lrw;

}

}

package OutputFormat;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.RecordWriter;

import org.apache.hadoop.mapreduce.TaskAttemptContext;

import java.io.IOException;

public class logRecordWriter extends RecordWriter<Text, NullWritable> {

private FSDataOutputStream atxiaoyuOut;

private FSDataOutputStream otherOut;

public logRecordWriter(TaskAttemptContext job) {

//创建两条流

try {

FileSystem fs = FileSystem.get(job.getConfiguration());

atxiaoyuOut = fs.create(new Path("D:\\hadoop\\atxiaoyu.log"));

otherOut = fs.create(new Path("D:\\hadoop\\other.log"));

} catch (IOException e) {

e.printStackTrace();

}

}

@Override

public void write(Text key, NullWritable value) throws IOException, InterruptedException {

//具体写

String log = key.toString();

if (log.contains("atxiaoyu")){

atxiaoyuOut.writeBytes(log+"\n");

}else {

otherOut.writeBytes(log+"\n");

}

}

@Override

public void close(TaskAttemptContext context) throws IOException, InterruptedException {

//关流

IOUtils.closeStream(atxiaoyuOut);

IOUtils.closeStream(otherOut);

}

}

package OutputFormat;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

public class logReducer extends Reducer<Text, NullWritable,Text, NullWritable> {

@Override

protected void reduce(Text key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {

// 防止有相同的数据,迭代写出

for (NullWritable value : values) {

context.write(key,NullWritable.get());

}

}

}

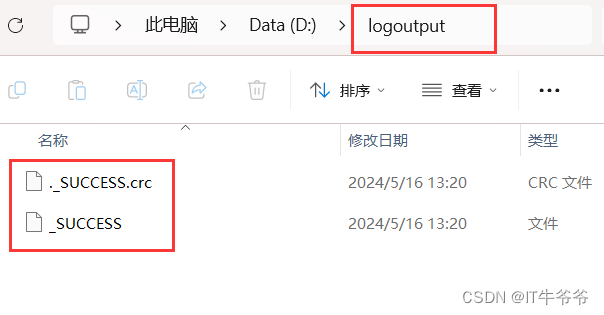

输出结果:

fileoutputformat输出的_SUCCESS文件:

7119

7119

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?