自己学习使用

写的非常nb的讲解超详细图解Self-Attention - 知乎 (zhihu.com)![]() https://zhuanlan.zhihu.com/p/410776234

https://zhuanlan.zhihu.com/p/410776234

李宏毅视频讲解

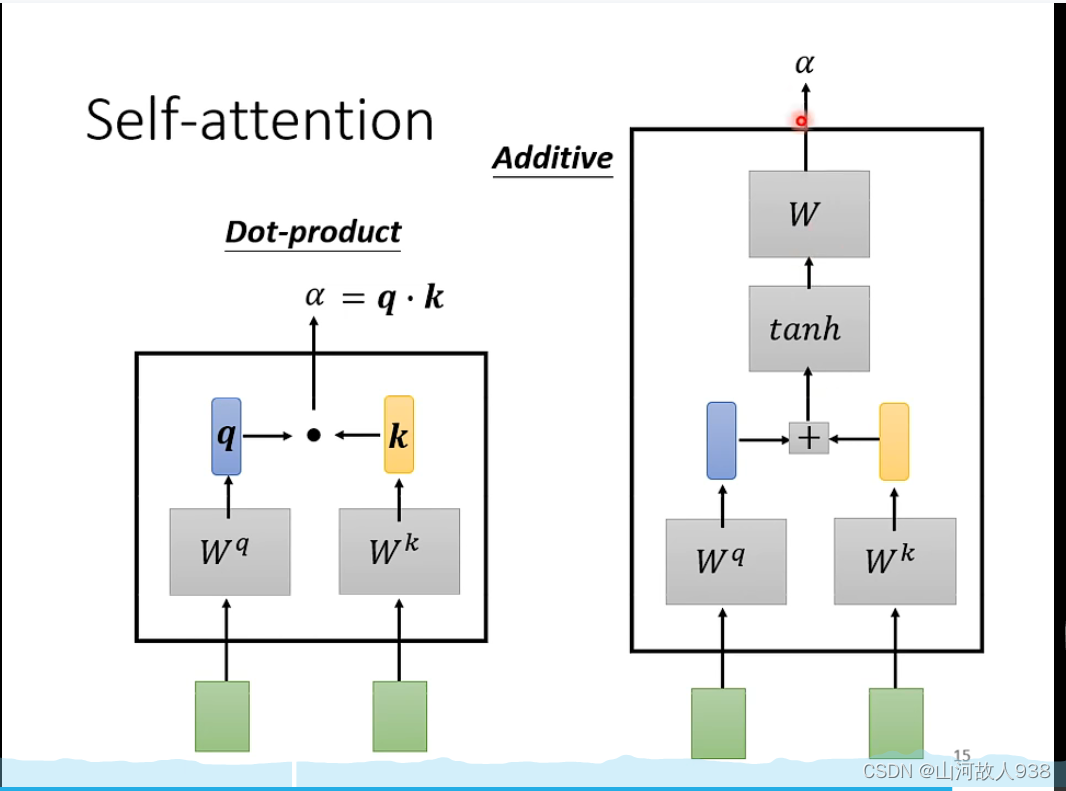

两个向量相关联的程度

计算出attention score

使用softmax

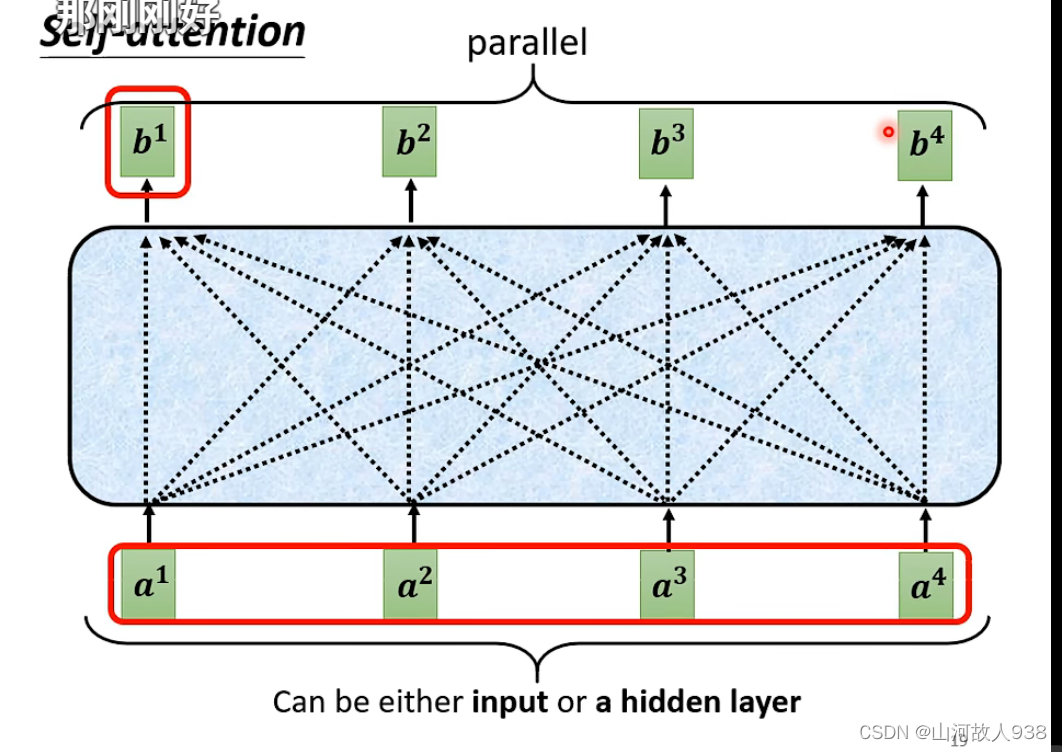

b1,b2,b3,b4可以同时被计算出来

在矩阵方方面的处理

转置后进行相乘

计算b

只有红色框框的需要训练得到

多头之间互相不影响,只在各自的层做矩阵运算

843

843

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?