刚刚,腾讯主力AI应用「元宝」宣布接入 Deepseek-R1满血版!现在,打开腾讯元宝,用户可以在模型选择框中自由切换 混元模型 和 满血版DeepSeek-R1。同时,切换到 Deepseek-R1 的腾讯元宝,还新增了 联网搜索 功能。这使得腾讯元宝不仅支持双模型,还可以实现可联网搜索,整合了微信公众号、视频号等腾讯生态中的信息源,真正实现了 “钮祜禄·腾讯元宝” 的强大功能!

值得注意的是,腾讯在推出 腾讯云支持 DeepSeek 能力开发小程序 和 ima 接入 DeepSeek-R1 能力 后,继续深化与 DeepSeek 的合作,进一步扩展其 AI 应用的功能和体验。

联网搜索+Deepseek-R1,腾讯元宝全面升级

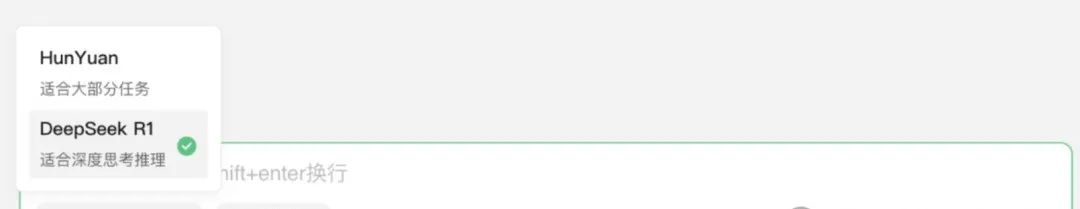

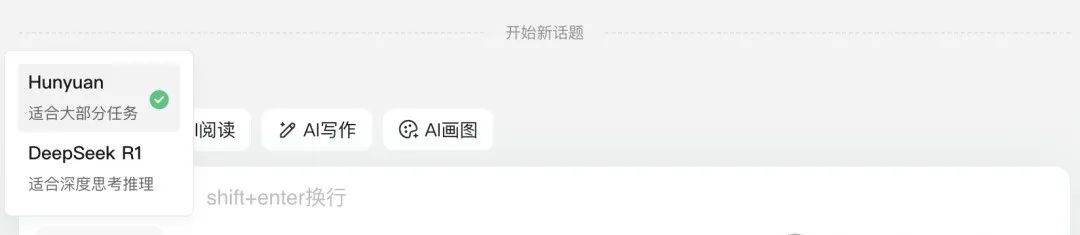

腾讯元宝表示,此次升级的目标是为了提供更加稳定、实时、全面和准确的答案。用户使用方法也非常简便,打开腾讯元宝的网页或 iOS 端 App,便可以在对话框下方自由选择使用 混元模型 或 DeepSeek-R1 模型。当选择 DeepSeek-R1 模型时,系统会进一步提供一个选项,允许用户选择是否启用联网功能。

切换到R1模型时,会再出现一个选项,自由选择是否让它联网。

据介绍,腾讯元宝接入的是 DeepSeek-R1-671B 版本,广受用户称为 “R1满血版”,因为它是 R1 系列中能力最完整、效果最优的版本。此外,腾讯元宝的联网搜索功能覆盖了 微信公众号 等腾讯生态内容及互联网的权威信源,从而使得答案的准确性大大提升。这一优势也正是腾讯元宝与其他 AI 应用的显著差异化竞争力。

Deepseek-R1联网效果测试

近,第三方评测平台 SuperClue 发布了名为《第三方平台DeepSeek-R1稳定性平层总榜》的评测报告,对接入 DeepSeek-R1 的多个平台进行了多维度评估,包括 完整回复率、准确率、推理耗时 等指标。南阳基于该评测标准,对腾讯元宝(使用 DeepSeek-R1+联网)进行了一些提问,并从多个维度对其响应进行评估。

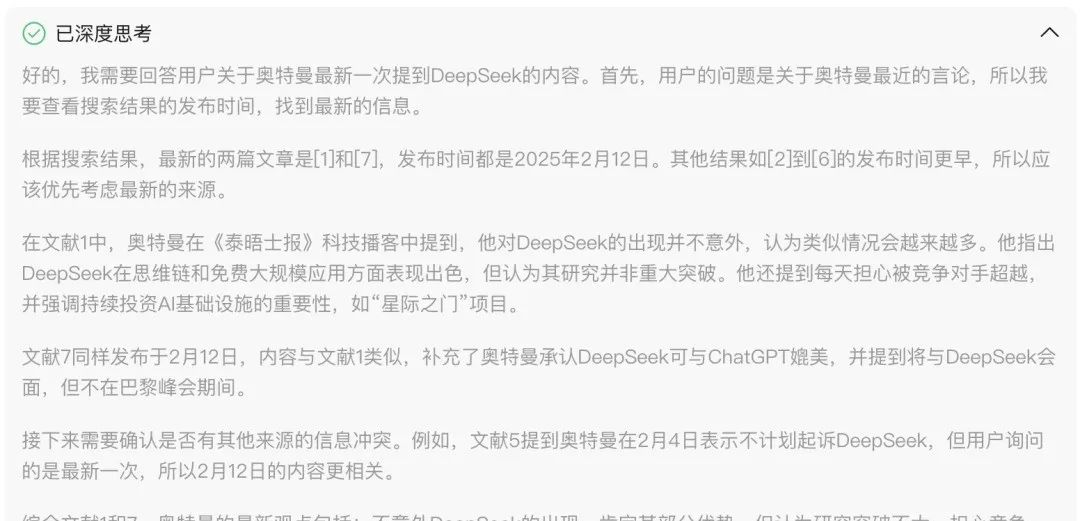

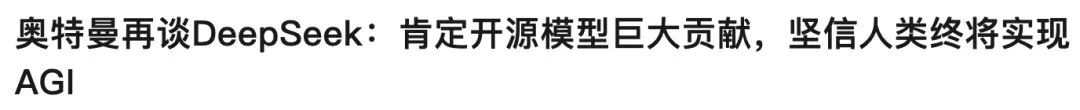

问题一: 奥特曼最新一次提到 DeepSeek 时说了哪些内容?

这个问题主要考察了腾讯元宝的联网搜索能力。元宝首先进行了深度思考:

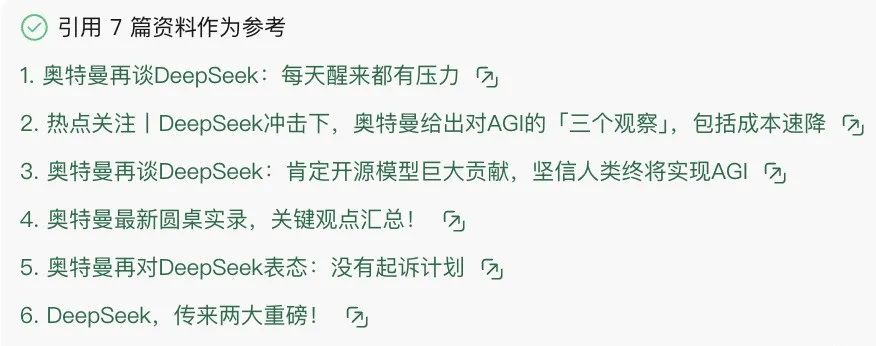

然后引用了 7篇文章 作为参考资料。经南阳核实,7篇引用的文章均来自微信公众号

而且其中的第1篇和第3篇正是量子位之前发布的实时推文。

可以看出,元宝的联网效果相当到位,确保了所引用的信息来源符合“最新”的要求。

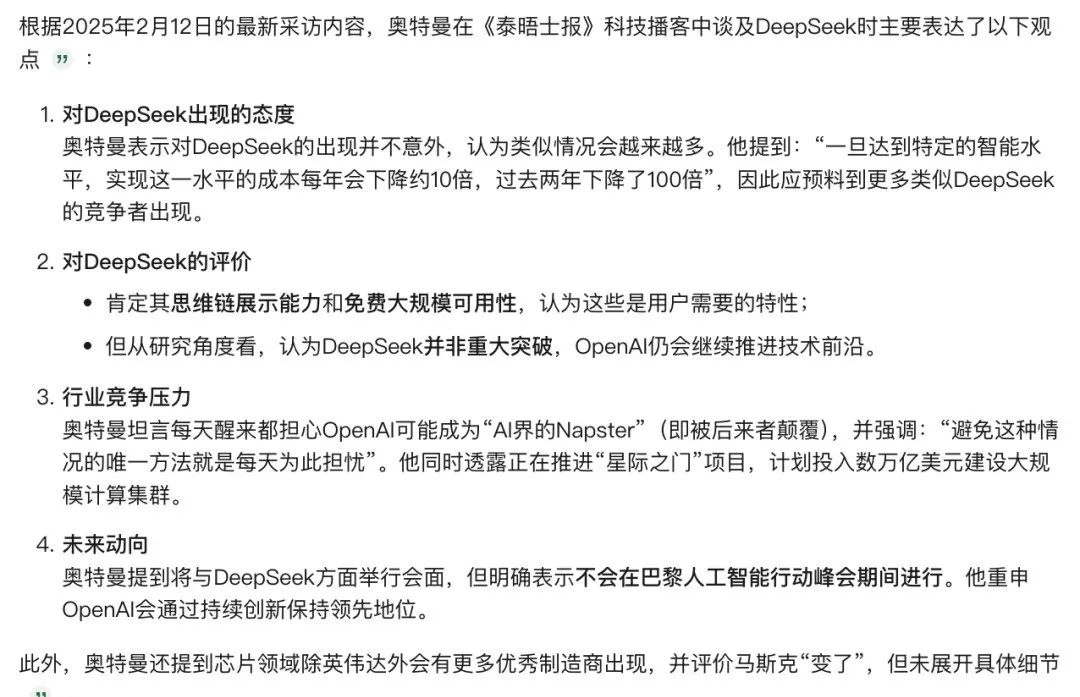

最终,元宝给出的答案如下:

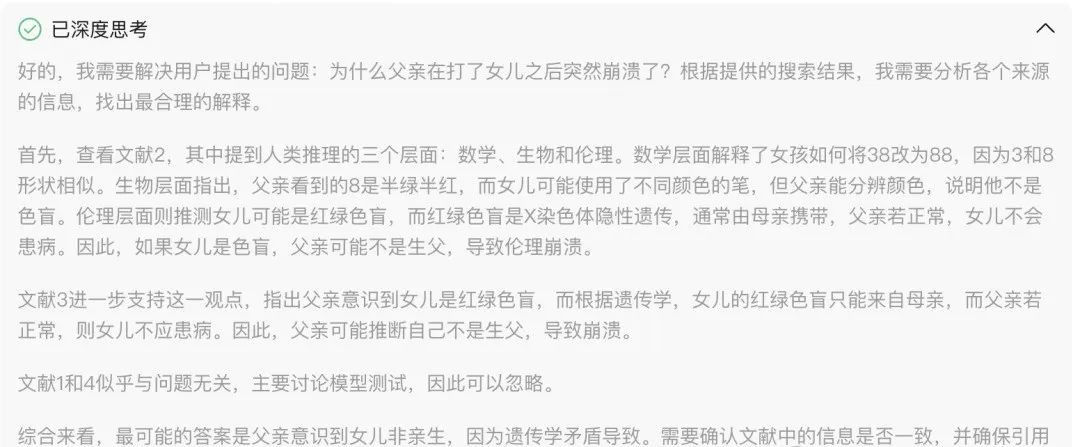

问题二: “有一天,一个女孩参加数学考试只得了38分……”

这一问是经典的 海龟汤 问题,考察的是元宝接入 DeepSeek-R1 后的推理能力。

元宝没有直接回复“服务繁忙”,而是启用了推理能力:

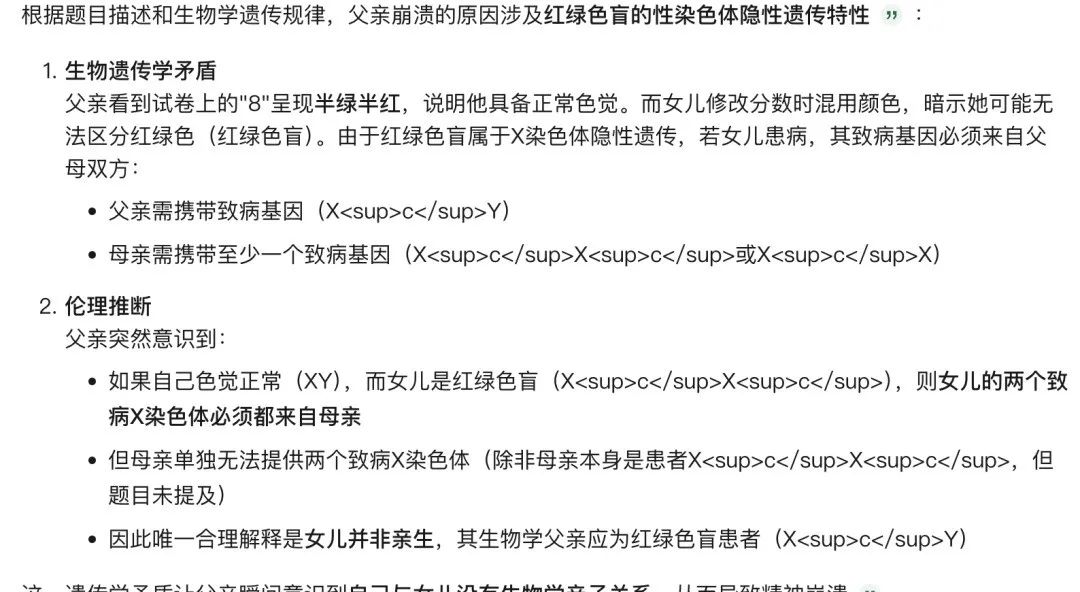

最终给出了合理的推理答案:

推理与响应速度测试

突然许愿!

希望以后有朋友做个海龟汤benchmark,来考察推理模型们的能力。

认真脸.jpg

经过测试,腾讯元宝切换到 DeepSeek-R1 后,推理速度依然不慢,几乎每次都能迅速作答。即便是反复进行复杂的推理,元宝的反应依然十分快速和准确。

可以从下面这个动图感受一下它的思考和输出速度:

腾讯方面解释称,元宝得益于 腾讯云的强大算力,不仅保障了服务的稳定性,还专门针对推理效率进行了优化,大幅提升了模型的响应速度,从而提供更优的用户体验。

腾讯拥抱DeepSeek,全面开放合作

腾讯元宝并非第一个接入 DeepSeek 的第三方平台。DeepSeek-R1 自从农历新年前发布后,凭借其卓越的效果、性价比以及开源优势,迅速在全球范围内吸引了大量用户。连奥特曼都在最近的访谈中表示,他每天醒来都担心会被 DeepSeek 等后起之秀超越。

DeepSeek-R1 的开源和高性价比吸引了大量用户的涌入,尽管很多用户因为算力限制只能运行较小的模型或无法联网,影响了体验。不过,随着第三方平台的接入,越来越多的用户可以通过不同渠道使用 DeepSeek 的强大功能。

腾讯,作为最早一批全面接入 DeepSeek-R1 的大平台之一,不仅在产品中为用户提供了智能对话和文本生成等功能,还帮助更多小程序开发者实现了基于 DeepSeek-R1 的能力接入。2月11日,腾讯云宣布了 小程序基础库的更新,开发者只需输入 3 行代码即可将 DeepSeek-R1 集成到小程序中,轻松实现智能对话等功能。而且,云开发的新用户首月套餐免费,还赠送 100 万 token。

同一天,腾讯旗下的 ima 也更新了版本,支持 DeepSeek-R1 模型,用户在使用 搜、读、写和知识库 等功能时,可以自由选择腾讯的混元大模型或 DeepSeek-R1 模型。Windows端、Mac端以及 ima 知识库小程序均可体验这一新功能。

腾讯此前也一直在大模型领域积极布局,支持开源并投资了多家大模型公司。然而,在 DeepSeek 之前,腾讯并未如此全面地拥抱第三方模型。可以看出,这不仅是 DeepSeek 的胜利,也是 开源的胜利。DeepSeek 的开源策略使得更多玩家能够放心使用并贡献自己的力量,从而推动了整个生态的发展。

最后,这也是腾讯在 AI 领域战略上的一种体现——腾讯选择拥抱那些 最佳的用户体验模型,不论它们是否是自家研发或投资的。这种“大气”的战略使腾讯在 AI 浪潮中站得更高,赢得了更多用户的信任和支持。

195

195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?