- 访问huggingface官网,搜索需要下载的预训练模型

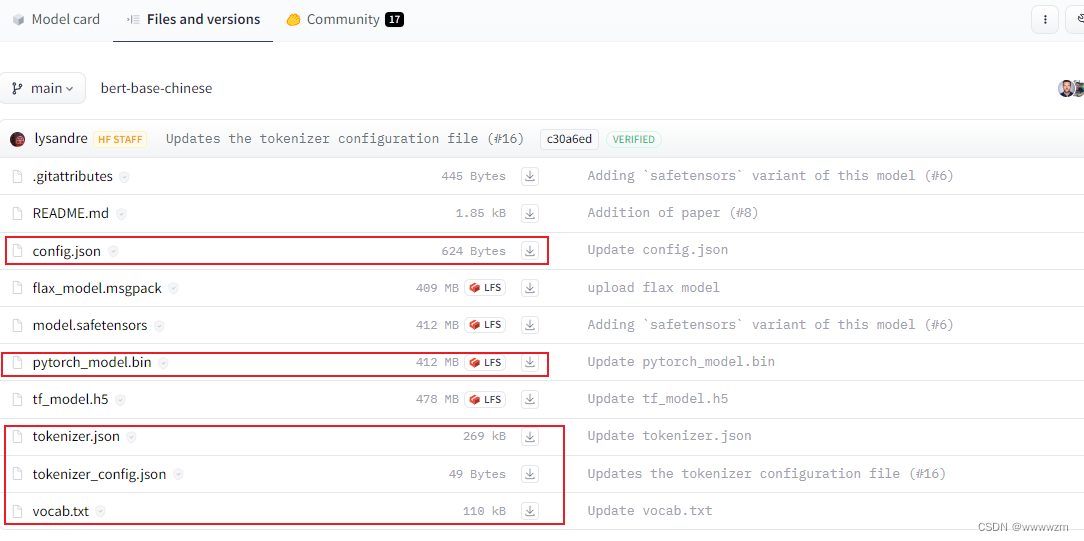

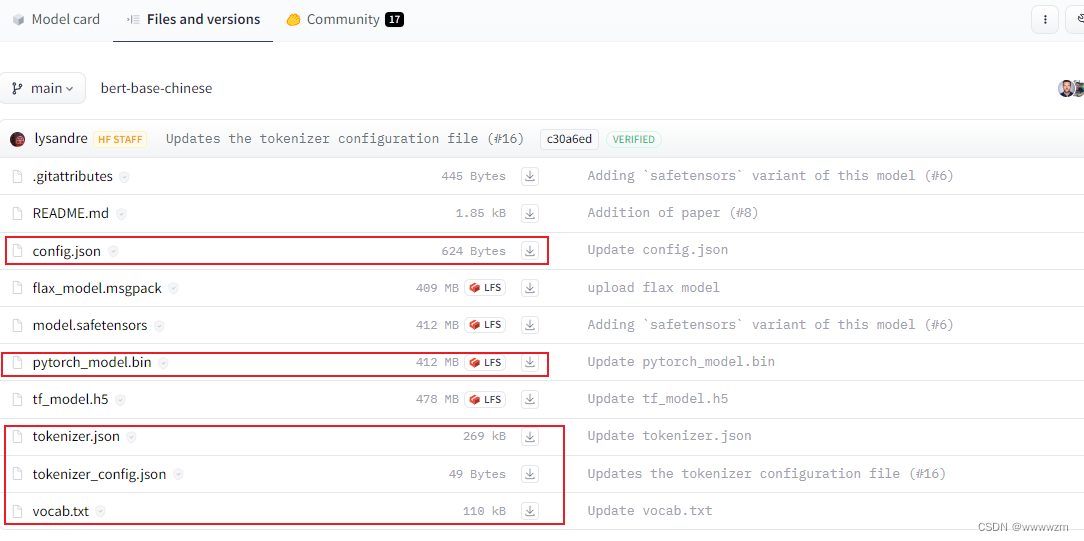

- 点击Files and versions,查看模型包含的文件,只需要下载部分文件即可。最关键的是三个文件:

- 第一个是配置文件,config.json

- 第二个是词典文件,vocab.json或vocab.txt

- 第三个是预训练模型文件,pytorch_model.bin或tf_model.h5。(根据使用的框架选择)

- 以google-bert/bert-base-chinese为例,红色框是必须下载的

- 使用方式

from transformers import AutoTokenizer, AutoModel

tokenizer = AutoTokenizer.from_pretrained("google-bert/bert-base-chinese")

model = AutoModel.from_pretrained("google-bert/bert-base-chinese")

from transformers import AutoTokenizer, AutoModel

tokenizer = AutoTokenizer.from_pretrained("D:\Pre-trained model\bert-base-chinese")

model = AutoModel.from_pretrained("D:\Pre-trained model\bert-base-chinesee")

1055

1055

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?