Logistic 回归是机器学习中经典的分类方法,常见的二项 Logistic 回归模型是一种二项分类模型,由条件概率分布

P(Y|X)

表示,形式为参数化的Logistic 分布。为了更好地理解 Logistic 回归,我们先从线性回归开始说起。

假设有

m

个样本点,记为{

设线性回归模型为

hθ(x)=θ0+θ1x1+θ2x2+…+θnxn

,记

θ⃗ =(θ0,θ1,θ2,...,θn)T,x⃗ =(1,x1,x2,...,xn)T

,那么模型可以写成

hθ(x)=θ⃗ Tx⃗

。

当然我们知道模型的估计值

θTx(i)

与实际值

y(i)

之间是有误差的,我们即为

ε(i)

,因此可得

y(i)=θTx(i)+ε(i)

,根据中心极限定理,误差

ε(i)(1≤i≤m)

是独立同分布的,服从均值为0,方差为某定值

σ2

的高斯分布(高斯分布即正态分布),因而

ε(i)

的概率分布为:

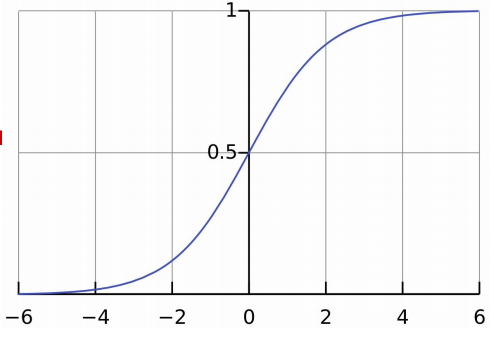

Logistic 函数(或叫 Sigmoid 函数)为

g(x)=11+e−x

,它的函数图像如下:

它的值域为[0, 1],这是一个很好的性质,我们可以认为他是一个概率分布,这是 Logistic 回归的关键。还有,对

g(x)

求导结果如下(大家可以自己证明):

如果 θ 的极大似然估计值是 θ^ ,那么学习到的 Logistic 回归模型即为:

4051

4051

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?