安装LLAMA参考博文http://t.csdnimg.cn/6yYwG

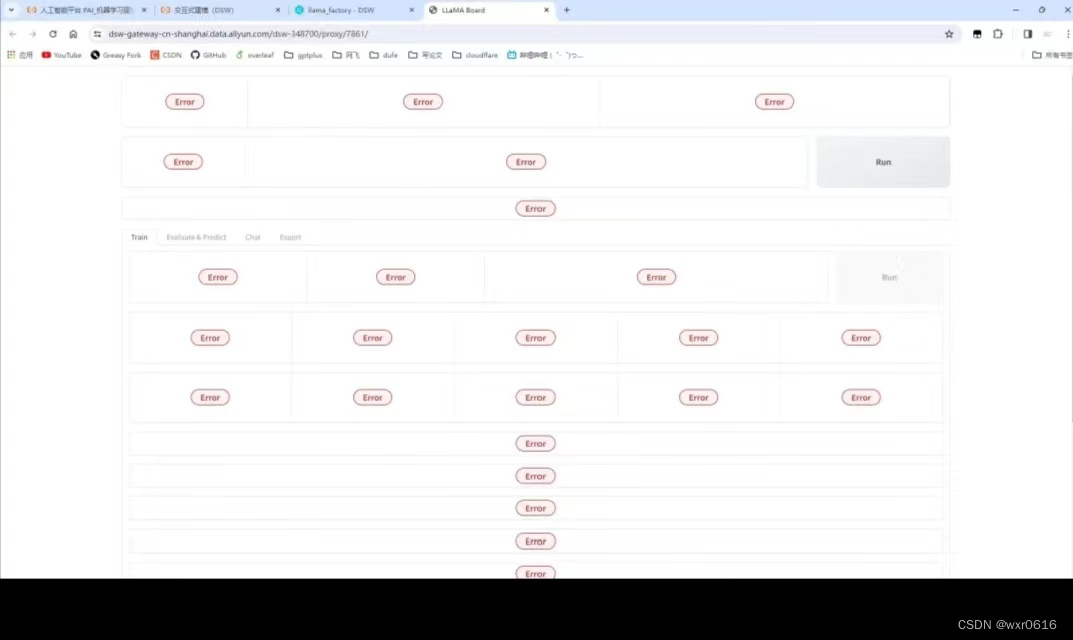

在用LLAMA微调大模型的时候总是出现connected error out并且出现这样的界面

这是由于LLMA所要求的gradio版本>=4.0.0,<=4.2.0,然而chatglm3-6b要求的gradio版本需要gradio==3.39.0才能显示出web_demo_gradio.py渲染的界面(参考该博文及博文下的评论http://t.csdnimg.cn/uzJLN)。于是当我安装了LLAMA的依赖以后原本可以打开的web_demo_gradio.py打不开了。

解决方法,创建两个Virtualenv环境

首先

pip install virtualenv

接着创建用于chatglm跑网页的chat环境

virtualenv chat

接着 进入chat环境安装chatglm的依赖

source chat/bin/activatepip install -r requirements.txt安装完成,记得先退出chat环境

deactivate再创建lora环境用于跑LLAMA模型微调

virtualenv lorasource lora/bin/activate接着安装LLAMA,LLAMA 最好不要安装在chatglm目录下

git clone https://github.com/hiyouga/LLaMA-Factory.git由于llama官网更新的V0.6.1打开会报错connection error out,我们先切换到v0.6.0分支

git checkout v0.6.0然后在安装依赖

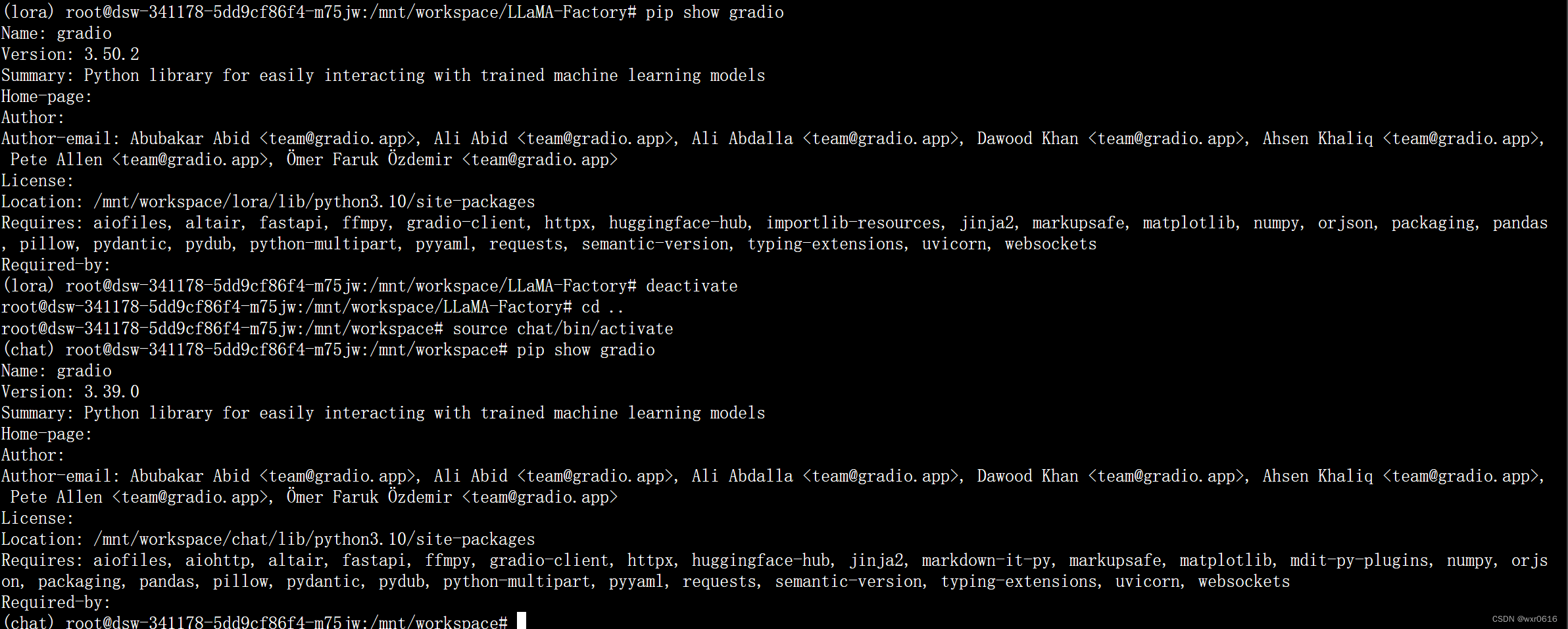

pip install -r requirements.txt然后看一下是不是两个环境各自的gradio是否符合要求

接着退出lora环境进入chat环境安装chatglm3-6b模型。 (模型安装调试后续更新)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?