目录

目录

1、安装pycahrm

下载 :PyCharm: the Python IDE for Professional Developers by JetBrains

2、配置 cuda

CUDA 是 NVIDIA 发明的一种并行计算平台和编程模型。它通过利用图形处理器 (GPU) 的处理能力,可大幅提升计算性能。CUDA(Compute Unified Device Architecture),是显卡厂商NVIDIA推出的运算平台。 CUDA™是一种由NVIDIA推出的通用并行计算架构,该架构使GPU能够解决复杂的计算问题。 它包含了CUDA指令集架构(ISA)以及GPU内部的并行计算引擎。 开发人员可以使用C语言来为CUDA™架构编写程序,所编写出的程序可以在支持CUDA™的处理器上以超高性能运行

查看cuda版本

打开NVIDIA控制面板 (下载地址 官方驱动 | NVIDIA)查看GPU显卡所支持的CUDA版本。

具体,NVIDIA控制面板——帮助——系统信息——组件——nvidia.dll后面的cuda参数,可以看到,我的显卡GTX960M支持版本为11.7,所以我下载安装cuda11.7以下的版本。

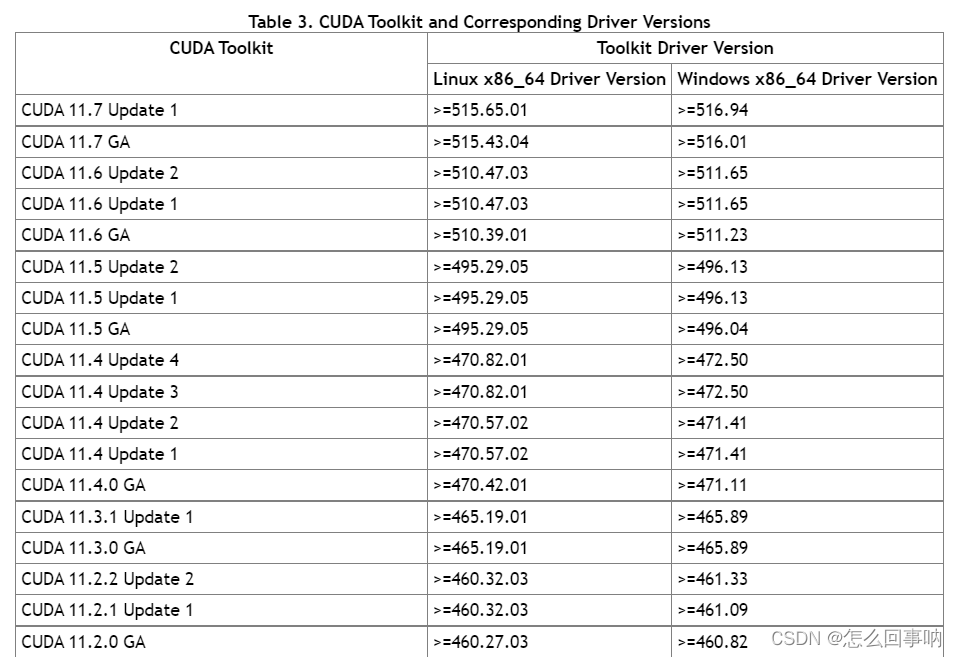

驱动版本(Driver Version)决定了能用的CUDA版本(CUDA Version)的上限

(具体可查询:Release Notes :: CUDA Toolkit Documentation (nvidia.com))

下载CUDA: CUDA Toolkit Archive | NVIDIA Developer

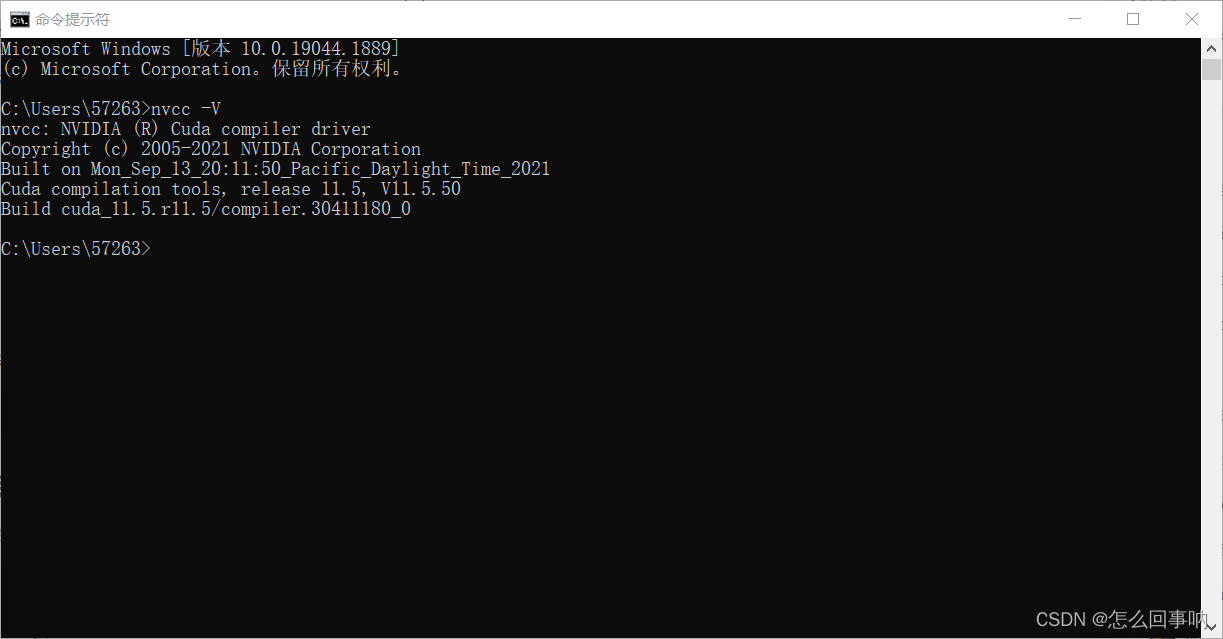

安装好后 在cmd输入nvcc -V

3、下载cuDNN

深度神经网络库 (cuDNN) 是一个 GPU 加速的深度神经网络基元库,能够以高度优化的方式实现标准例程(如前向和反向卷积、池化层、归一化和激活层)。 全球的深度学习研究人员和框架开发者都依赖 cuDNN 来实现高性能 GPU 加速。借助 cuDNN,研究人员和开发者可以专注于训练神经网络及开发软件应用,而不必花时间进行低层级的 GPU 性能调整。cuDNN 可加速广泛应用的深度学习框架,包括 Caffe2、Chainer、Keras、MATLAB、MxNet、PaddlePaddle、PyTorch 和 TensorFlow。

cuda和cuDNN的关系:CUDA看作是一个工作台,上面配有很多工具(底层)。cuDNN是基于CUDA的深度学习GPU加速库,有了它才能在GPU上完成深度学习的计算。

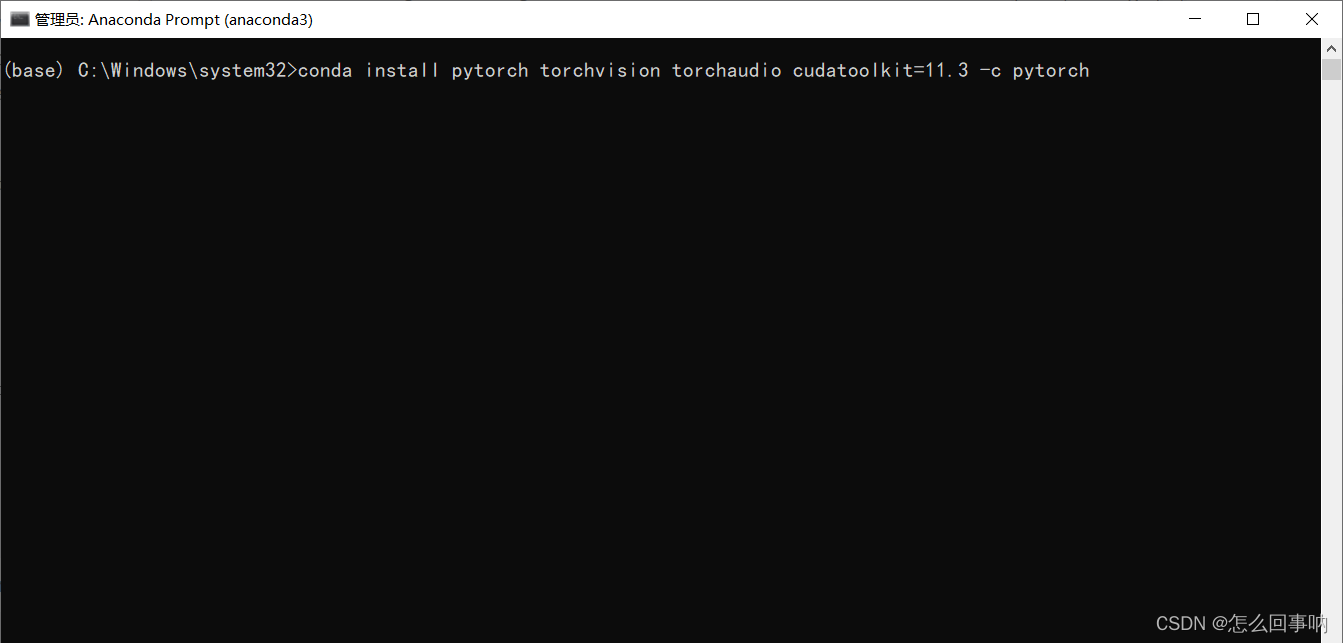

可以通过pytorch-GPU直接下载(pytorch里包含cudnn)

直接下载

下载之前

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main/

地址:PyTorch下载

负责代码,到anaconda端,即可下载

镜像下载

但是上述方法可能很慢。故可以使用镜像下载 。

将下载完的包放到 Anaconda3/pkgs 目录下,删除原来下载的缓冲文件

打开Anaconda Prompt(若需安装在其他环境,输入conda activate <环境名>)

稳妥起见,cd Anaconda3/pkgs进入对应目录下

输入:conda install --use-local <下载包的名字>

输入conda list验证是否安装

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?