题目叫 A Discriminatively Trained, Multiscale, Deformable Part Model ,什么意思

中文对应翻译:一个 区别训练,多尺度,变性部件模型 。

这是一篇最好的目标检测算法论文之一

他由3部分组成 HOG特征 (HOG feature),变性部位模型 (Deformable Part Model ), 隐形支持向量机 Latent SVM.

这篇;论文做了什么?

利用上面3个部分,进行对象检测。包括人的检测,汽车,动物,飞机等。

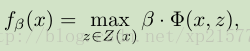

主要思想是如下图:

如上图:对人脸检测:分成7个部分,头发,左轮廓,右轮廓,左眼,右眼,鼻子,嘴巴,每个部分分别检查和训练,但它们像弹簧一样连接在一起。

文章分为三部分: HOG特征 (HOG feature),变性部位模型 (Deformable Part Model ), 隐形支持向量机 Latent SVM.

HOG特征 (HOG feature),是局部特征的提取,是嘴巴,还是鼻子,或者是眼睛,等等。

变形部位模型:把所有部位,局部特征(嘴巴,鼻子,等等),像弹簧连接在一起的整个装置。

隐形支持向量机 Latent SVM:是用来训练样本的,我们要知道,把嘴巴,鼻子,眼睛,等部分,放在一个弹簧装置里面。但我们要给每个部位分配参数,训练就是调整这些参数。参数的意义,代表每个部分的重要性。嘴巴检测最重要,就给他参数分配更高的参数。还有就是:我们要判断一幅图片对象的存在,我们要给检测的对象,打分,分越高,就越有可能是样本。所一这里的SVM是打分函数参数的调节器。最后用打分函数打分。

变形部件什么意思?看下面图:

每个人不是标准的站姿。(比如,腿,脑袋,手,肩膀).Deformable(变形)部位,意思是系统检测的时候,人的姿态不标准,每个部位位置不统一,姿态不一,Deformable Part Model 叫变形部位模型。所以增加了检测难度。这也是挑战的难度。

上图:显示的是人的检测模型可以通过各个部分训练,再通过各个部分检测。把人头检测分为六部分,头,左肩膀,右肩膀,左腿,右腿,双脚。

对象由各部分建模组成一个变形装置.

HOG features

HOG 特征 由cell,block组成。cell是在一个像素周围的8*8正方形里面梯度直方图,

0-180方向 9bin,block是2*2的cell,再归化block长度,

再在detection window 中,在长和宽方向取w*h个block.组成HOG特征,用来描述局部轮廓特征。

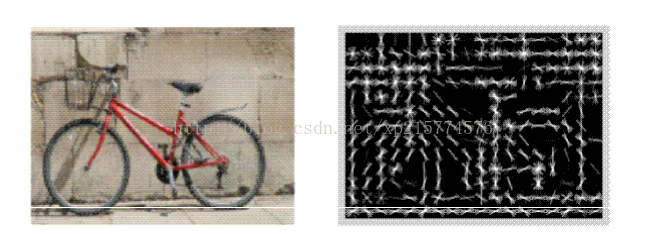

detection score = sum of filter responses - deformation cost

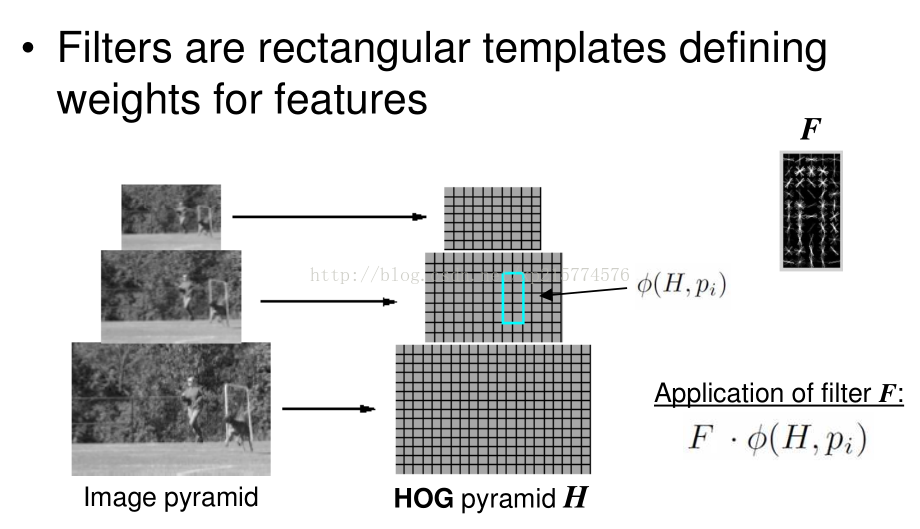

上图:显示得是HOG特征金字塔,root filters检测是整个对象轮廓。part filters,检测每个部分的轮廓。deformable model 检测的是各部位相对于整体对象位置的分数。

而且,部分过滤器(part filters)是整体过滤器(root filters)分辨率的两倍,因为部分特征轮廓,分得更精细,因为部位大小小,所以分辨率高。也知道为什么要用金字塔了。

φ(H,pi )

由于对象检测是采用的 a scanning window 窗口扫描。在图片上从高度方向,和长度方向扫描,固定扫描窗口的大小。pi=(x,y,l)是图片扫描窗口的位置在l层上。

H=HOG 金字塔

φ(H,pi ) 是用HOG特征在pi上提取HOG特征值,pi与H映射。F是HOG每个block局部特征的参数。来说明每个block特征重要性,block特征越重要,相应的参数值越高。

A model consists of a root filter F 0 and part

model (P 1 ,…,P 6 ), P i = (F i , v i , s i , a i , b i )

– F i : filter

– (v i ,s i ) : location and size of part positions box

– (a i ,b i ) : deformation cost parameters

上说明的模型的组成:F0总体对象特征参数,Fi是i部位的特征参数,Pi是i部件,Vi是部件位置,Si部件的大小,

ai,bi是变形部件成本参数.

detection score = sum of filter responses - deformation cost。

公式(1)前半部分是sum of filter responses,代表总体轮廓特征和每个部位轮廓特征匹配分数。后半部分是各部位相对于总体对象位置的分数,重叠度越高,变形成本越低。

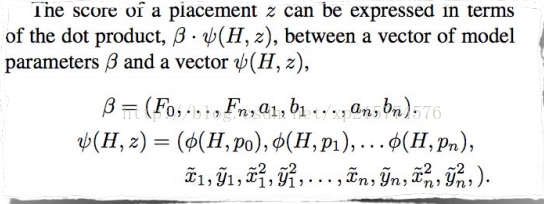

公式1转换成映射的形式。 β · ψ(H,z)。SVM训练的目的是调整参数 β .

下面的工作,是怎么训练β.最后用

Latent svm

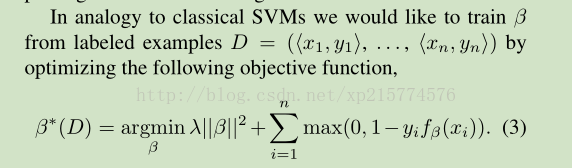

β ∗ (D)在D已知样本集中求最小值。λ||β|| 2是什么意思?λ||β|| 2最小代表SVM支持向量机之间的距离最大。

后半部分代表成本,要使成本最小,尽可能的使正样本在支持向量机两侧,即下图三条线傍边两条线上外。如果负样本跑到最上面线下面,就要计算,加到成本中去。

β ∗ (D)不是关于β的凸函数,如果是凸函数,在区间能最小值唯一,直接梯度下降,坐标下降法,求解。

而β ∗ (D),在区间内有非常多的极值点,所以是非凸函数。

并且后半部分,只有 D中硬实例有用,(the hard instances of D),非硬实例,1−y i f β (x i )<0,直接被0替代。

什么叫硬实例,就是y i f β (x i )<=1的点,有哪些点呢。下图,假如xi为负样本,即红点,哪些从左往右第一根直线下面的红点,就为硬实例,假如为正样本,即绿点,哪些第3根线上面的点为硬实例,即那些错误分类的点。

2915

2915

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?