最近看到一篇文章给各位分享下

一套管理软件到底应该卖多少,是一个仁者见仁,智者见智的问题。随着对管理要求的越来越高,大量的中小型企业都面临采购软件的问题,同时市场供给也不断增加,导致现在的中小管理软件市场表面上供给过剩,价格越来越低。前段时间,在2013年IT峰会,马云说了,IT行业还在杀价,还是拼价格,而不是价值。

是的,我们在推销管理软件时,经常会遇到这样的回绝“价格太贵了!”。

于是乎,我们自己越卖越怕,越卖价格越便宜。

试问,管理软件价格应该多少算是合适呢?

客户往往会说:“你们做软件的最赚钱了,复制一下就行了,又不要成本。”

软件行业又是属于典型的IT行业, IT给人印象最深的就是摩尔定律“每18个月速度快一倍,价格便宜一倍”。

其实这些都对,但只看到IT产品的可复制性,忽略了它的服务性特征。

由于使用管理软件的人存在种种情况,使得我们卖软件的得提供各种各样的服务,比如:安装系统、故障解决、流程疏理、管理咨询等等,有时甚至连杀毒和添加信任等这些最基本的动作都得我们来完成。“软件就是服务”在管理软件行业中体现得更加淋漓尽致,说白了就是一个彻底的服务行业,是智力和劳动力的集合体,我们的很多客户却没有理解软件的成本到底体现在哪里。随着这几年物价飞涨,杂工工资由2000年的30、50元一天,现在都涨到300、500元了。而我们IT民工、码农呢,也得养活全家老少,而产品价格却一降再降。导致优秀的人才无法在这个行业生存。

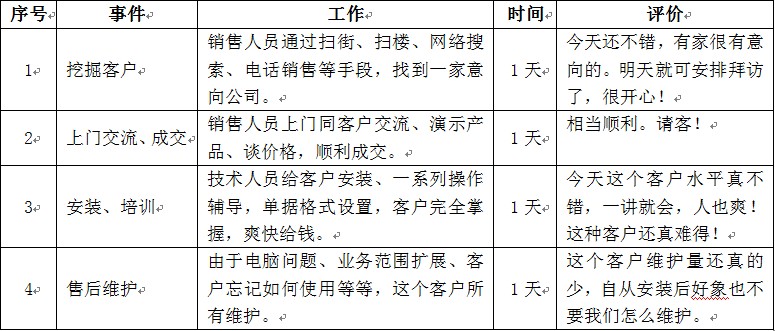

下面我就通过一个例子来分析一下。比如:一套单机版软件卖2000元(对于许多人来说感觉也不是很低了),销售模式为典型的软件公司,即“推销”模式。一套软件会消耗掉多少人工呢?请看下表。

如果软件公司每个人、每天都能这样周而复始地工作,简直是我们终极追求了。

但我们再来算一下,这样的情况下,每人一年可产出多少呢?

365/7*5-11(法定节日)*(2000/4)≈12万。这就是一个人的整个毛收入,减去进货成本(如果自己研发的产品,减去研发人员工资)、车旅费,剩下毛利润最多8万。再减去公司税收、房租、水电、利润等。请问:员工的工资能给多少?真可谓是“不算不知道,一算吓一跳”。

现在管家婆、用友、金蝶等公司都推出几百块钱的软件,人家说是“我们这款产品用于赚人气,而不是赚钱”。但这招其实是很恶毒的,使想买软件的人认为,软件只值这个价,也使众多中小软件公司以身家性命扑上去,“我也就同他们拼了”。到年关一算,真的什么都没留下,徒长一岁,空悲切。再来看看这些公司,这几年的日子并不是那么好过,行业龙头没有做好,害了整个行业,到头来还是害了自己。

大家不妨仔细想想,你的客户哪个不比你有钱,个个开奔驰、宝马的,可是他赖以生存、帮他利润倍增的管理软件,花费却还不够他吃一餐饭的钱。

这几年,我们公司通过不断摸索,形成了这样的基本思路,就是:不断找客户,更多的接触客户,如果哪个客户嫌价格贵,我们就先放一放,自嘲曲:“这个客户暂时还没有用软件的命!”再曲:“今天买人家的,二、三年以后还是得买我们的。”我们的出路在高端商业企业和中小工业企业客户上, 在于懂得软件是需要高价值服务的客户上。同时我们也呼吁广大从事IT行业的朋友,在向客户介绍软件的时候,多从软件的服务性角度出发,考虑要有合理的利润和价值,想想你的家人、想想你为之奋斗的目标。

13万+

13万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?