整理一下写的非常好的关于AdaBoost算法的博客:

1.1 基于第一步,因此外层循环即为数据集特征的循环;

1.1.1 如果是按照第一个特征来划分类别,那么第一个特征点中存在节点,即树的左右分支,这个时候怎样判断是左还是右呢?

1.1.2 首先根据数据大小跟定一个阈值T,这里我们T=minx+INT*stup,即最小特征值(第一个坐标的最小值或者。。。。。)+(1,2,3,4,5.....)*步长,这个阈值随着整数值INT的改变而循环改变;大于阈值T的则为“rt”,反之则为“lt”;

1.1.3判断错误率,初始化一个5*1的列向量e,全部为1,如果预测结果和标签相同,则将初始化对应的值修改为0,最后再用一个权重向量D.T*e,这个值即为最后的错误率,如果这个错误率小于一定的阈值,即为最有的决策树。

1.1.4 这里要比较每个阈值T的结果是"rt"和"lt"的错误率,同时你还要判断大循环中第一个特征的错误率,或者第二个特征的错误率;

https://blog.csdn.net/cherdw/article/details/78144098

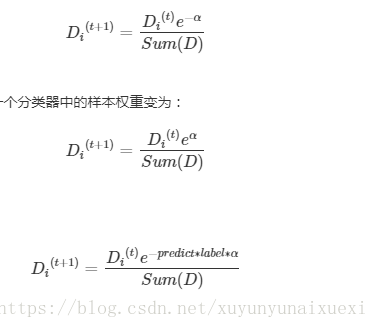

https://blog.csdn.net/lvsolo/article/details/51031117这篇博客关于其中的D的公式的推导和使用写的非常好,其中关于

《机器学习实战》这本书上的代码就是利用了这一公式,自己理解半天没懂,这篇博客帮了大忙。

https://blog.csdn.net/xiaxzhou/article/details/72872270这篇博客人代码完整,注释清晰。

https://blog.csdn.net/haidao2009/article/details/7514787解释清楚

推导+案例

https://blog.csdn.net/GYQJN/article/details/45501185

https://blog.csdn.net/guyuealian/article/details/70995333

https://blog.csdn.net/v_JULY_v/article/details/40718799

2052

2052

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?