1. 图文并茂说明raid0,raid1, raid10, raid01, raid5等原理

RAID-0, 以chunk为单位并行读写数据,速度非常快,但是没有冗余容错能力,如果一块硬盘损坏的话,会导致所有数据的丢失,最少磁盘数:1+

RAID-1,也成为镜像,由两组以上的N个磁盘互作镜像,在一些多线程操作系统中能提供非常好的读取速度,读的速度等于硬盘数量的背书,与RAID 0相同,但是写的速度比较低。所需的最少磁盘数2+

RAID-10,读、写性能提升,可用空间大小N*min(S1,S2,...)/2,有容错能力,每组镜像最多只能坏一块,最少磁盘数量4,4+。成本比较高。

RAID-5,磁盘中的每组数据直接进行运算生成校验码,读、写性能提升,可用空间:(N-1)*min(S1,S2,...),最少磁盘书:3,3+

2. 创建一个至少有两个PV组成的大小为20G的名为testvg的VG,要求PE大小为16M,而后在卷组中创建大小为5G的逻辑卷testlv;挂载至/users目录

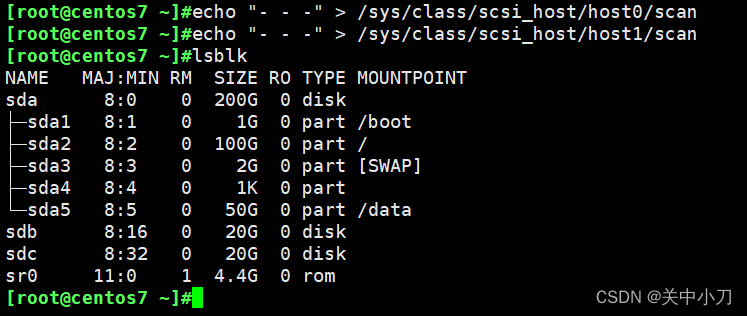

增加两块20G的虚拟磁盘,确认主机总线号

![]()

扫描识别新增的磁盘

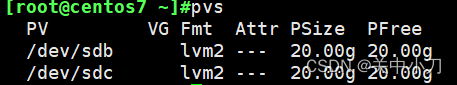

创建物理卷

显示pv

为卷组分配物理卷,并制定pe大小为16M

![]()

显示vg信息

创建LV,testlv

格式化lv

linux

linux

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

141

141

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?