图像融合论文解读——Text-IF: Leveraging Semantic Text Guidance for Degradation-Aware and Interactive Image Fusion (CVPR2024)

本文主要解读了Text-IF: Leveraging Semantic Text Guidance for Degradation-Aware and Interactive Image Fusion,CVPR 2024的文章,以供大家参考。

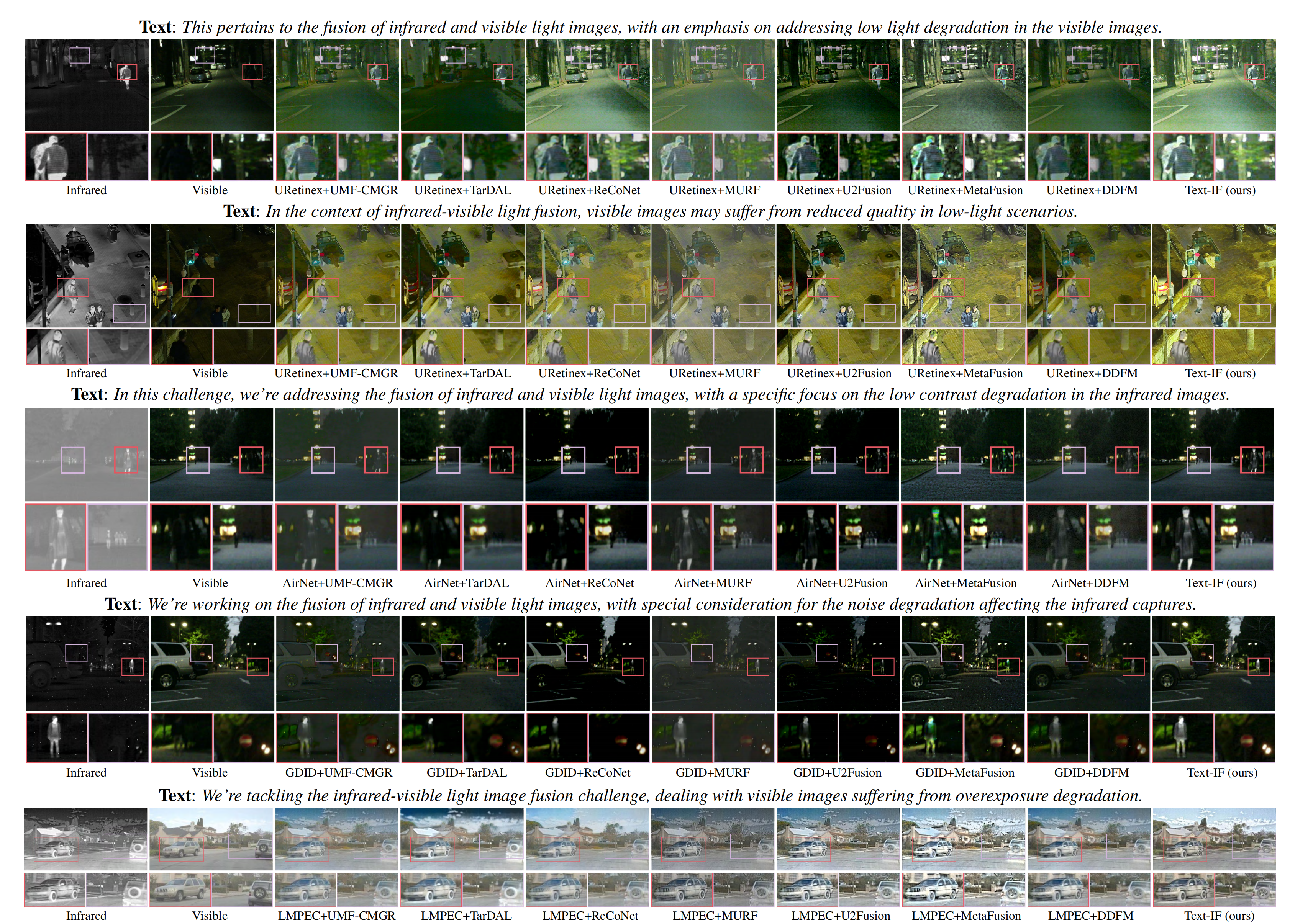

现有的融合方法在处理低质量源图像的退化时通常是无力的,且无法实现主观和客观需求的交互。为了解决这些问题,作者引入了一种利用语义文本引导图像融合模型进行退化感知和交互式图像融合任务的新方法,称为Text-IF。它创新性地将经典的图像融合扩展到文本引导的图像融合,并能够协调地解决融合过程中的退化和交互问题。

论文: https://openaccess.thecvf.com/content/CVPR2024/html/Yi_Text-IF_Leveraging_Semantic_Text_Guidance_for_Degradation-Aware_and_Interactive_Image_CVPR_2024_paper.html

代码: https://github.com/XunpengYi/Text-IF

现有图像融合方法存在的问题

缺乏自适应去退化的能力

受环境条件的限制,获取的红外和可见光图像可能会受到退化的影响,并显示出较低的融合图像质量。可见光图像容易受到弱光,过曝等退化问题的影响,而红外图像不可避免地受到噪声(包括热噪声、电子噪声和环境噪声)、低对比度等影响。目前的融合方法缺乏自适应去退化的能力,导致融合图像质量低下。此外,依靠人工预处理来增强图像存在灵活性和效率的问题 。因此,研究一种协调退化感知处理和交互式融合的模型具有实际意义。

设计一个个性化的退化模型来实现图像的增强和融合是可行的。然而,大多数的图像融合任务都需要在各种复杂的条件下全天候进行。如图1所示,需要多个图像恢复模型来满足需求,频繁的模型切换带来很大的消耗和麻烦。此外,分离方法还存在实现增强与融合不协调的问题,导致整体性能不理想。

不灵活的非交互式融合

此外,现实世界的图像融合是复杂、灵活和面向任务的。图像融合的需求可能会随着用户的主观需求和客观应用任务的不同而改变。在所有场景中,如果该方法是非交互的,产生相对固定的融合结果,通常不能满足用户的各种灵活的需求。文本作为人机交互的重要方式,在指定需求的模型中被广泛应用。语义文本和图像处理过程之间的交互可以达到定制图像处理的目标。因此,通过文本实现图像融合中的退化感知处理和用户交互性具有重要意义。

本文解决方案和贡献

为此,提出了一个模型,该模型利用语义文本指导进行退化感知和交互式图像融合,称为 Text-IF。它集成了文本和图像融合,以满足协调退化感知处理和交互融合的需求。特别是,它允许文本提供灵活的语义指导来处理各种退化,这是一种多模态信息融合。Text-IF 包含图像管道和文本交互引导体系结构,后者包括文本语义编码器和语义交互引导模块。

在图像融合流水线中,作者精心设计了基于 Transformer 的图像提取模块和交叉融合层,以实现高质量的融合。在文本语义编码器中,聚合了强大的预训练视觉语言模型(CLIP)的文本语义提取能力。通过语义交互引导模块,将文本的语义特征和图像融合特征耦合在一起,达到文本引导图像融合的目标。解决了现有图像融合方法难以适应具有退化的复杂场景融合,只能输出相对固定的结果而没有交互性的问题。为后续文本引导图像融合任务的研究提供了可行的方向。

总体而言,本文贡献总结如下:

• 为了适应复杂的退化条件,作者解决了图像融合和退化感知处理的综合问题。它突破了图像融合质量提升的局限性。

• 引入了语义交互引导模块,将文本和图像的信息融合在一起。所提方法不仅实现了多模态图像融合,还实现了多模态信息融合。

• 所提出的方法最终增加了定制融合结果的自由度。它提供了交互式融合,可以生成更灵活、更高质量和用户所需的结果,而无需事先的专业知识或预定义的规则。

具体方法实现

问题描述

一般的图像融合方法将图像融合任务表述为以两个源图像(如 Ivis, Iir )为输入,并采用融合网络(如 θn )

得到固定化的图像融合结果。该网络旨在学习与融合任务对应的映射预定义融合函数 Fif 。简单来说,可

以描述为:

I

f

=

F

i

f

(

I

v

i

s

,

I

i

r

;

θ

n

)

I^f=\mathcal{F}_{if}(I_{vis},I_{ir};\theta_n)

If=Fif(Ivis,Iir;θn)这意味着融合网络倾向于学习相对固定的融合策略。而且,在复杂的环境中,例如源图像遭受退化,这种任务范式是无能为力的。本文研究了利用文本打破传统单一融合结果的缺陷,以及质量提升的难度,探索了文本引导的图像融合新范式。由于引入了文本语义,融合任务被改写为:

I

f

=

F

s

−

i

f

(

I

v

i

s

,

I

i

r

,

T

t

e

x

t

;

θ

n

−

s

)

I^f=\mathcal{F}_{s-if}(I_{vis},I_{ir},T_{text};\theta_{n-s})

If=Fs−if(Ivis,Iir,Ttext;θn−s)总的网络架构如图2所示。

图像融合管道

图像编码器: 图像编码器分别将源可见光图像和红外图像作为输入,基于Transformer/Restormer块作为基础特征提取器。 F v i s = F v I ( I v i s ) , F i r = F i I ( I i r ) , F_{vis}=\mathcal{F}_v^I(I_{vis}),F_{ir}=\mathcal{F}_i^I(I_{ir}), Fvis=FvI(Ivis),Fir=FiI(Iir),交叉融合层:交叉融合层旨在整合来自不同模态的特征信息。为了全面整合各个维度的特征,首先使用交叉注意力(CR-ATT)对不同模态的特征进行交互。具体来说,可以表示如下: { Q v , K v , V v } = F q k v v ( F v i s ) , { Q i , K i , V i } = F q k v i ( F i r ) , \{Q_{v},K_{v},V_{v}\}=\mathcal{F}_{qkv}^{v}(F_{vis}),\quad\{Q_{i},K_{i},V_{i}\}=\mathcal{F}_{qkv}^{i}(F_{ir}), {Qv,Kv,Vv}=Fqkvv(Fvis),{Qi,Ki,Vi}=Fqkvi(Fir), F f i = s o f t m a x ( Q v K i d k ) V i , F f v = s o f t m a x ( Q i K v d k ) V v , F_f^i=softmax(\frac{Q_vK_i}{d_k})V_i,\quad F_f^v=softmax(\frac{Q_iK_v}{d_k})V_v, Ffi=softmax(dkQvKi)Vi,Ffv=softmax(dkQiKv)Vv, F f 0 = C o n c a t ( F f i , F f v ) F_f^0=Concat(F_f^i,F_f^v) Ff0=Concat(Ffi,Ffv)语义交互融合解码器:交叉融合层输出的特征首先通过如下的自注意力(SE-ATT)增强,随后,它由语义文本特征以交互方式引导。 F ^ f 0 = s o f t m a x ( Q f K f / d k ) V f \hat{F}_f^0 = softmax(Q_fK_f/d_k)V_f F^f0=softmax(QfKf/dk)Vf语义交互融合解码器被设计用于交互文本语义特征和图像融合特征。具体来说,它是由基于Transformer 的解码器模块和语义交互指导模块(SIGM)构建的,这将在下一段介绍。融合解码器块和SIGM紧密耦合成多级级联,从而实现了密集的调节和引导效果。简单地说,语义交互融合解码器可以描述为: F f k + 1 = { F f D ( L f s ( F f k , F t e x t ) ) } r , F_f^{k+1}=\{\mathcal{F}_f^D(\mathcal{L}_f^s(F_f^k,F_{text}))\}_r, Ffk+1={FfD(Lfs(Ffk,Ftext))}r,请注意,需要在解码器各层之间进行上采样,以对应于编码器的下采样。

文本交互引导架构

预置的图像融合流水线可以有效地获得相应的融合特征。而文本交互引导架构是文本语义信息耦合和图

像融合的关键部分。

文本语义编码器:给定一个文本 Ttext ,该文本提供相应的语义特征来引导图像融合网络获得指定的融合结果(例如,指定任务类型和退化类型),文本交互引导架构的文本语义编码器应将其传送到文本嵌入中。

CLIP 作为大型预训练的视觉语言模型,对文本特征提取有很好的效果。作者倾向于从 CLIP 中冻结良好的文本编码器,以保持良好的语言一致性。用 {·}e 表示冻结的权重,这个过程可以表示为:

F

t

e

x

t

=

{

F

t

I

}

e

(

T

t

e

x

t

)

,

F_{text}=\{\mathcal{F}_t^I\}_e(T_{text}),

Ftext={FtI}e(Ttext),在不同但语义相似的文本中,提取的特征应该在欧几里得空间中很接近。

此外,作者设计了MLP 来挖掘这种关系,并进一步映射文本语义信息和语义参数。因此,它可以得到:

γ

m

=

Φ

m

I

(

F

t

e

x

t

)

,

β

m

=

Φ

m

I

I

(

F

t

e

x

t

)

,

\gamma_m=\Phi_m^I(F_{text}), \beta_m=\Phi_m^{II}(F_{text}),

γm=ΦmI(Ftext),βm=ΦmII(Ftext),语义交互指导模块(SIGM):在语义交互引导模块中,语义参数通过特征调制和融合特征进行交互,从而获得引导的效果。特征调制包括尺度和偏差控制,分别从两个角度调整特征。特别地,一个残差连接被用来减少网络拟合的难度。它可以被描述为:

F

^

f

i

=

(

1

+

γ

m

)

⊙

F

f

i

+

β

m

,

\hat{F}_f^i=(1+\gamma_m)\odot F_f^i+\beta_m,

F^fi=(1+γm)⊙Ffi+βm,

损失函数

和一般的图像融合方法仅融合Y通道图像不同。本文使用了三通道的图像融合,并且提出了一个颜色损失,在CbCr空间中约束颜色的一致性,从结果上看效果还可以。

强度损失:

L

i

n

t

=

1

H

W

∥

I

f

−

m

a

x

(

I

v

i

s

g

,

I

i

r

g

)

∥

1

L_{int}=\frac{1}{HW}\|I_f-max(I_{vis}^g,I_{ir}^g)\|_1

Lint=HW1∥If−max(Ivisg,Iirg)∥1结构相似性损失:

L

S

S

I

M

(

t

)

=

(

1

−

S

S

I

M

(

I

f

,

I

v

i

s

g

)

)

+

δ

i

r

(

t

)

(

1

−

S

S

I

M

(

I

f

,

I

i

r

g

)

)

L_{SSIM}(t)=\begin{pmatrix}1-SSIM(I_{f},I_{vis}^{g})\end{pmatrix}+\delta_{ir}(t)\begin{pmatrix}1-SSIM(I_{f},I_{ir}^{g})\end{pmatrix}

LSSIM(t)=(1−SSIM(If,Ivisg))+δir(t)(1−SSIM(If,Iirg))最大梯度损失:

L

g

r

a

d

=

1

H

W

∥

∇

I

f

−

m

a

x

(

∇

I

v

i

s

g

,

∇

I

i

r

g

)

∥

1

L_{grad}=\frac1{HW}\|\nabla I_f-max(\nabla I_{vis}^g,\nabla I_{ir}^g)\|_1

Lgrad=HW1∥∇If−max(∇Ivisg,∇Iirg)∥1颜色一致性损失:

L

c

o

l

o

r

=

1

H

W

∥

F

C

b

C

r

(

I

f

)

−

F

C

b

C

r

(

I

v

i

s

g

)

∥

1

L_{color}=\frac1{HW}\|\mathcal{F}_{CbCr}(I_f)-\mathcal{F}_{CbCr}(I_{vis}^g)\|_1

Lcolor=HW1∥FCbCr(If)−FCbCr(Ivisg)∥1

总损失:

L

t

o

t

a

l

=

α

i

n

t

(

t

)

L

i

n

t

+

α

S

S

I

M

(

t

)

L

S

S

I

M

(

t

)

+

α

g

r

a

d

(

t

)

L

g

r

a

d

+

α

c

o

l

o

r

(

t

)

L

c

o

l

o

r

L_{total}=\alpha_{int}(t)L_{int}+\alpha_{SSIM}(t)L_{SSIM}(t)+\alpha_{grad}(t)L_{grad}+\alpha_{color}(t)L_{color}

Ltotal=αint(t)Lint+αSSIM(t)LSSIM(t)+αgrad(t)Lgrad+αcolor(t)Lcolor

实验结果

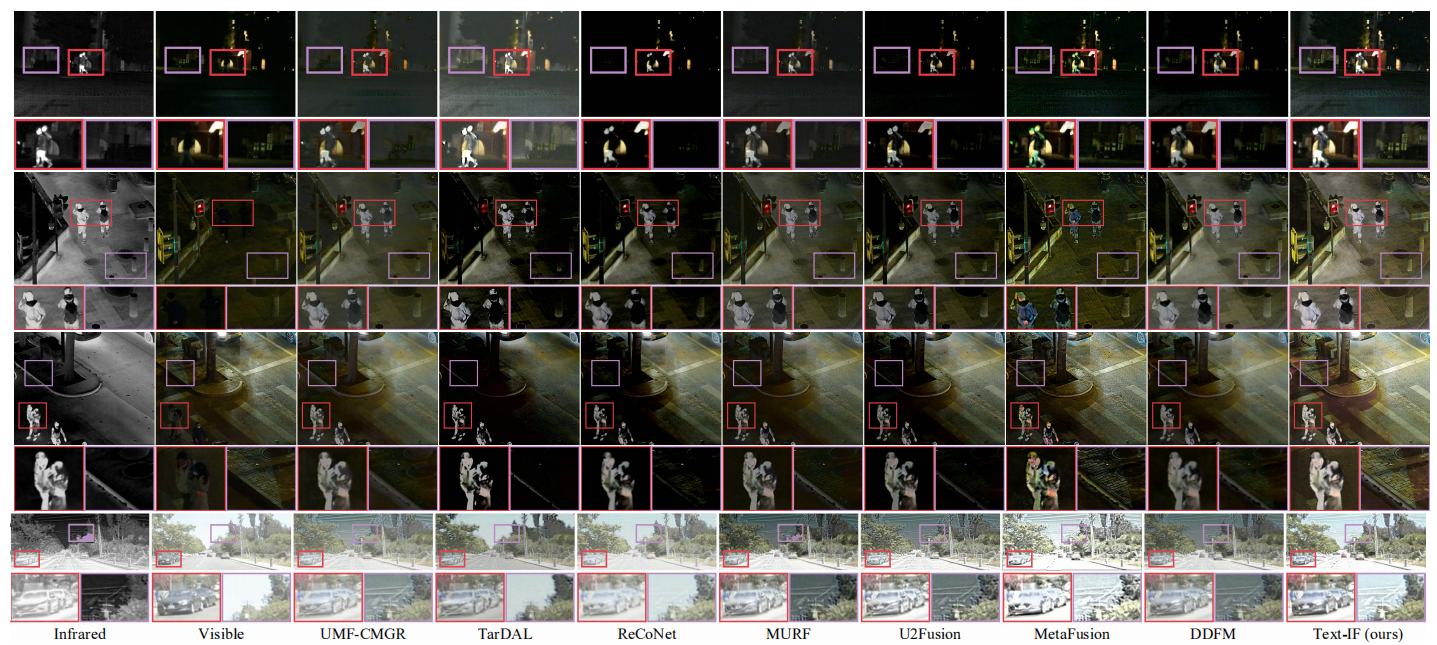

无文本引导的结果对比

现有的图像融合方法没有语义指导。为了比较公平性,首先只比较没有提供语义指导的融合性能。此时,Text-IF使用默认文本,这意味着没有引入额外的语义信息。

高级视觉任务上的验证

消融实验

2554

2554

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?