图像融合论文解读——Diff-IF: Multi-modality image fusion via diffusion model with fusion knowledge prior

基于扩散模型在多模态图像融合领域有待探索,本文主要解读了Diff-IF: Multi-modality image fusion via diffusion model with fusion knowledge prior,Information Fusion 2024的文章,以供大家参考。

论文: https://www.sciencedirect.com/science/article/pii/S1566253524002288

代码: https://github.com/XunpengYi/Diff-IF

图像融合中的生成式模型

基于生成对抗网络(GAN)的图像融合

基于GAN的融合网络主要包括一个生成器,通过合并来自不同领域的信息来生成融合图像,以及一个鉴别器负责对生成图像和源图像之间概率分布进行相似性评估。虽然基于GAN的图像融合模型产生了令人满意的融合图像,但它们受到不稳定训练过程和模式崩溃等问题的困扰。这些挑战导致了分布不合理、质量较低的融合图像的产生,显著影响了基于GAN的方法的实用性。

基于扩散模型(Diffusion Model)的图像融合及面临的挑战

文章指出,尽管扩散模型在图像生成任务取得了巨大的成功,扩散模型在多模态图像融合的核心挑战是缺乏Ground Truth,这使得扩散模型的基线没有办法直接用于多模态图像融合任务(如图1所示)。扩散模型在图像融合中的实现如图2(a)所示,目前可行的范例是利用一个无条件的预训练扩散模型和基于分数的方法。

(1)这种方法依赖于预训练的扩散模型提供的先验,这意味着这种基于扩散的方法在图像融合任务中不需要训练。它通过后设计的分数匹配优化过程实现图像融合,但设计繁琐,不针对任务。

(2)图像生成预训练的扩散参数可能是不合适的和不适用的,并不适用于图像融合。

(3)应用预训练后的网络也会导致修改网络结构的困难,进一步限制了该方法的应用范围。

在这种情况下,本文提出了另一个范例:训练基于扩散的图像融合模型,根据任务的要求和特征进行定制,使扩散过程更加紧凑和特定于任务。

具体来说:提出了一种新的具有融合知识先验的多模态融合扩散模型,称为Diff-IF。考虑到多模态图像融合中GT的缺失,Diff-IF将图像融合扩散模型设计为具有融合知识先验的条件扩散模型。它利用目标搜索技术,根据特定的图像融合任务提供具有最优先验分布的扩散模型。此外,Diff-IF同时包含了正向和反向扩散过程。首先,由于在前向扩散过程中融合图像的分布是未知的,因此创新性地提出了利用融合知识先验以代表融合图像的分布。其次,设计反向扩散去噪过程,生成符合融合知识先验概率分布的高质量融合图像。值得注意的是,这种可训练的DDPM过程可以通过根据融合任务的要求进行定制化的训练来实现,而不需要进行繁琐的设计。因此,Diff-IF在各种融合任务中提供了高质量的融合结果,同时与基于GAN的方法相比,也拥有更稳定的训练过程。

方法

融合知识先验和最优先验搜索

针对缺乏Ground Truth的问题,作者提出了Fusion Knowledge Prior和Targeted Search的方法,具体的说就是通过现有的融合方法获取一个先验的融合知识分布,随后通过指标/人工为导向的方法优选出自定义的融合分布。

扩散模型

得到自定义的融合分布后,作者通过Diffusion Model直接学习生成这一融合分布。具体来说设计了DDM和MDRM的两个模块,这一过程类似于知识蒸馏。

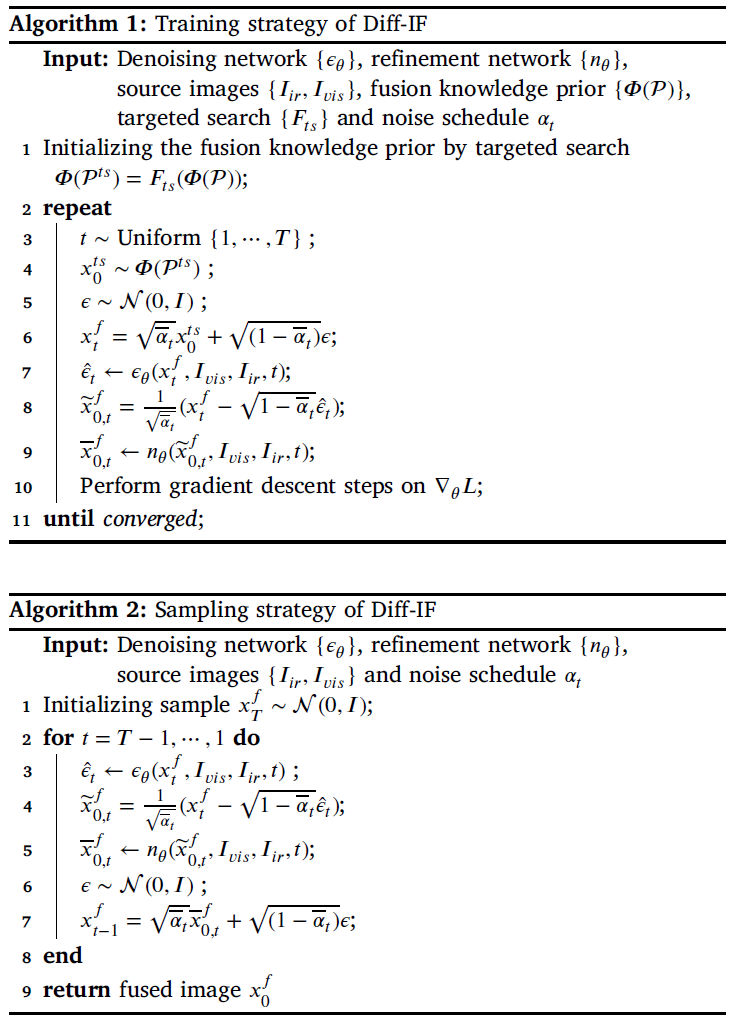

因此,Diff-IF的训练策略和采样策略可以被总结为:

总结

这篇论文指出了现有扩散模型在多模态图像融合中的限制,提出了一个可行的用扩散模型训练的范式。针对多模态图像融合的扩散模型的应用可以围绕这一问题具体的展开,如何用扩散模型更好的进行融合还是值得进一步探究的。

977

977

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?