前言、Boosting提升算法思想

Boosting:提升、推进的意思

一般来说,找到弱学习算法要相对容易一些,然后通过反复学习得到一系列弱分类器,组合这些弱分类器得到一个强分类器。

Boosting算法涉及到两个部分:加法模型和前向分布算法。

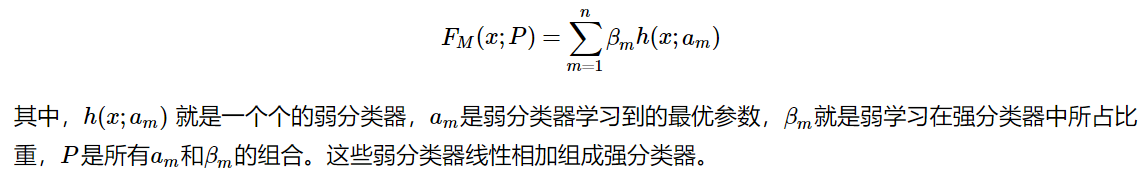

加法模型:就是说强分类器由一系列弱分类器线性相加而成。一组组合形式如下:

前向分步,就是说再训练过程中,下一轮迭代产生的分类器是在上一轮的基础上训练得来的。也就是可以写成这样的形式:

![]()

由于采用的损失函数不同,Boosting算法因此也有了不同的类型,AdaBoost就是损失函数为指数损失的Boosting算法。

一、AdaBoost

1.1 原理理解

1.每一次迭代的弱学习h(x;am)有何不一样,如何学习?

Adaoost改变了训练数据的权值,也就是样本的概率分布,其思想是将关注点放在被错误分类的样本上,减小上一轮被正确分类的样本权值,提高那些被错误分类的样本权值。然后,再根据所采用的一些基本机器学习算法进行学习,比如逻辑回归。

2. 弱分类器权值βm如何确定?

AdaBoost采用加权多数表决的方法

1.2 实例

1.3 算法流程

1.4 公式推导

二、面经

323

323

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?