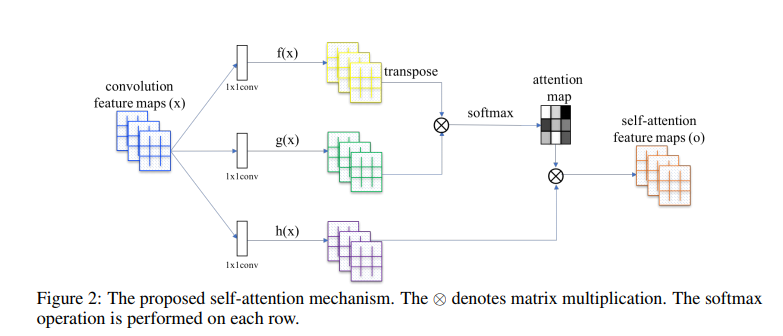

1.self-attention

1. Ian goodfellow 2018年 新作,在GAN生成中加入了attention的机制,同时将SNgan的思想引入到生成器当中。

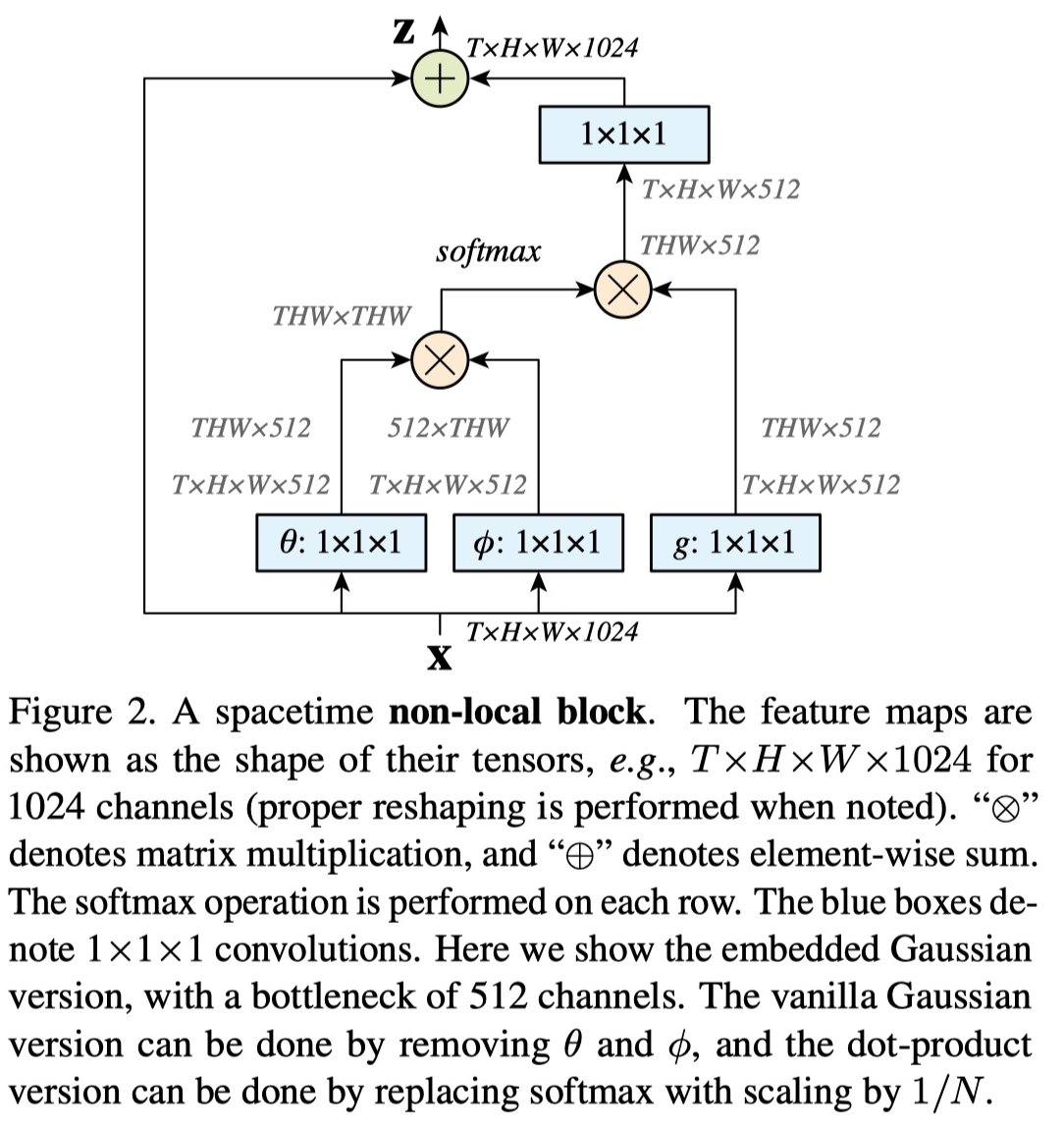

2. CVPR2018: Non-local:Non-LocalNeural Network

2.通道注意力+位置注意力

cvpr2019:DANet

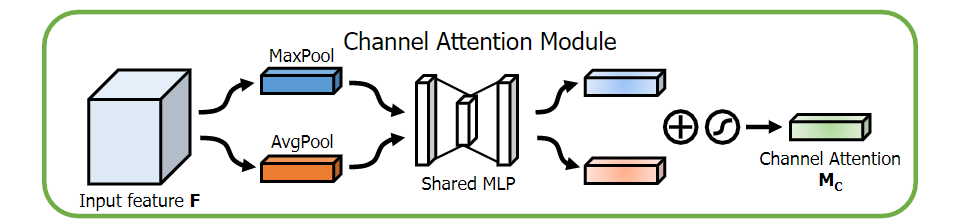

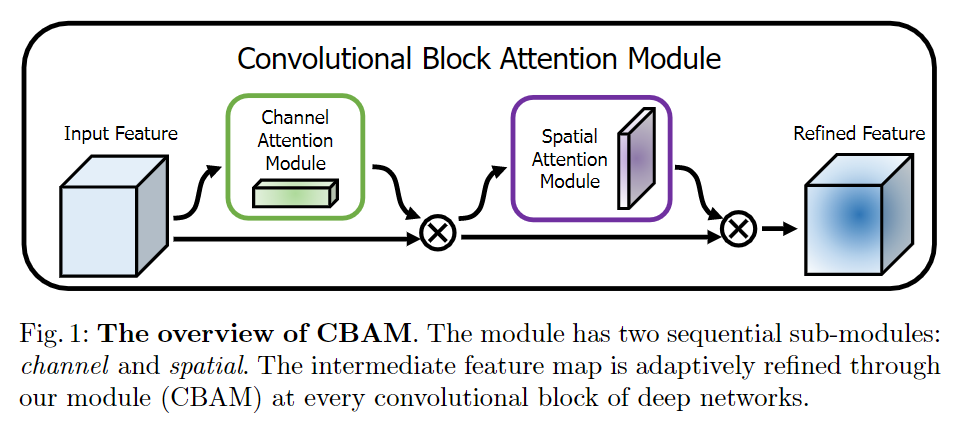

3.通道注意力+空间注意力

通道注意力和空间注意力,三种结合方式:

通道注意力+空间注意力组合之一:

4.通道注意力+位置注意力

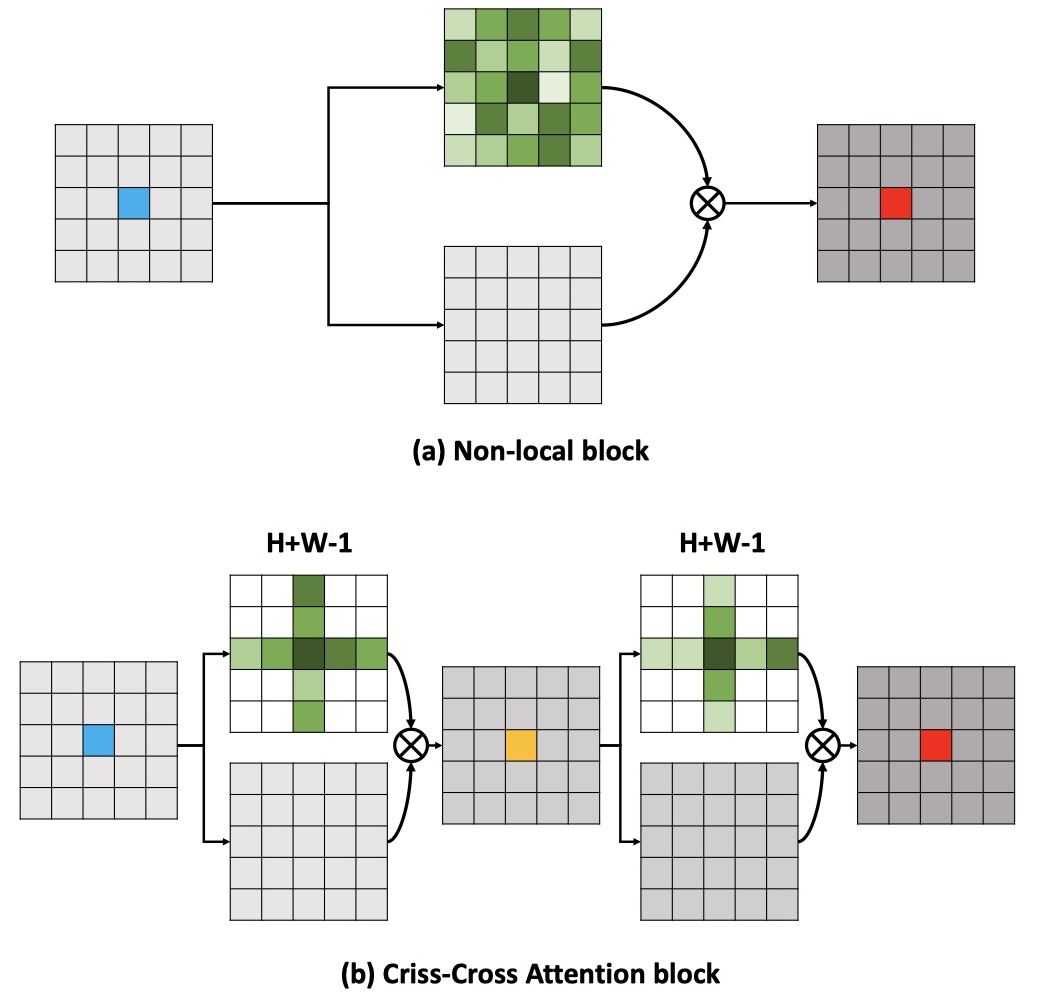

5.Criss-CrossAttention注意力

ICCV2019:CCNet

6.Multi-Head attention

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?