keywords: CKN, Nyström方法, RKHS, graph, kernel

作者: Dexiong Chen, Julien Mairal, Laurent Jacob

原文: Convolutional%20Kernel%20Networks%20for%20Graph-Structured%20f955a167b075436e93b7f97801eaaffa/Convolutional_Kernel_Networks_for_Graph-Structured_Data.pdf

发表时间: 2020

方法: 类似于CKN,只是针对图结构的数据,使用图核构建核映射。将图中的路径属性提取出来,使用kernel映射到H空间中,再通过Nyström方法:映射到有限维子空间中,在子空间中进行池化形成新的特征映射。filter可以使用无监督方式利用k-means算法映射到子空间得到,也可以通过有监督的反向传播得到。

源代码: https://github.com/claying/GCKN

精读: Yes

结论: GCKN容易正则化,任务适配,在分类数据集上表现良好,但是比GNN更加难计算。

实验:图像分类

问题: 将GNN和核方法结合起来,解决图像分类问题

Summary

这篇论文是专门针对图结构的数据提出了一种新的方法,该方法将GNN和核方法结合起来,叫做GCKN——Graph Convolutional Kernel Networks。论文也介绍了多层图核,主要包括walks kernel、path kernel和WL subtree kernel,论文基于这些核提出了GCKN。一方面,GCKN中的kernel提供了一种无监督的、有表现力的、易于规范化的数据表示,在训练样本数量较少时非常有用;另一方面,GCKN也可以在大规模数据上进行端到端的学习,从而产生一种新的图卷积神经网络。

Introduction & Related work

背景介绍:图核可以生成好的经验结果,但是数据表示却和模型学习过程是解耦的。为了让图核产生特定于任务的数据表示,图神经网络诞生了,它与卷积神经网络类似,但是多层模型结构是图结构的,图神经网络比核方法更加难正则化。

GNN和核方法有不同的特点,但是在图像建模中,它们可以结合起来解决问题,有两种相反的联合方式:

- 有一类GNN的输出存在于WL核的再生核希尔伯特空间(RKHS)中。这是利用核构建GNN,最后的模型训练为典型的神经网络。

- 利用GNN架构设计一种新的核,等价于用随即权重和梯度下降初始化的无限宽GNN。

还有其他方法:

- 利用由图核诱导的度量来初始化GNN。

- 利用图核来获得插入到神经网络的连续嵌入。

本篇论文提出一种显示多层核表示,可以被用来作为传统的核方法,当数据多时,可以训练为GNN用来进行端对端的学习。

Walks and Path kernels

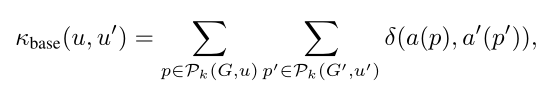

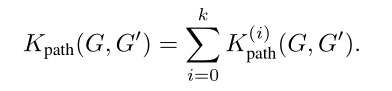

如果p和p’的属性相等,那么σ的值为1;否则为0。k_base(u,u’)核含义是两个不同的图的path集合的属性相等的path的数量。

延伸:两个图中长度到k的所有path的属性相等的数量

Walks kernel:把P替换成W

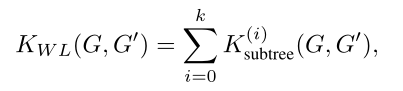

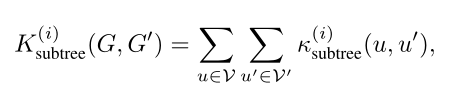

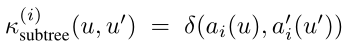

Weisfeiler-Lehman subtree kernels

WL子树核比较子树模式而不是子树,这种核捕获子树模式,它通过迭代地聚合和散列每个节点邻居的属性来增加节点属性。

其中

属性 a i ( u ) a_i(u) ai(u)捕获以节点u为根的深度为i的子树模式。

Graph Convolutional Kernel Networks

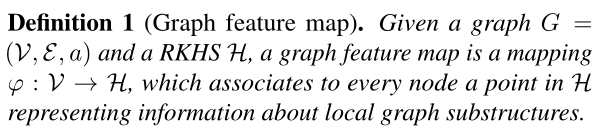

图特征映射φ

-

定义:φ从节点空间V到空间H,就是把V中的一个节点和H中的一个点关联起来,H中的点表示局部图子结构的信息。

-

特点:依赖于图G,可以看作是描述G中节点的空间H的|V|个元素的集合

-

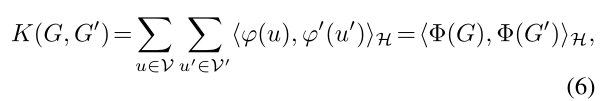

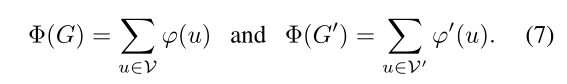

核与图G、G‘的映射φ、φ’联系起来的定义式:

其中

特征映射的单层网络构建

path kernel的连续性松弛

把Dirac函数替换成核 κ 1 \boldsymbol{\kappa_1} κ1,允许使用连续性属性,而且可以进行路径之间的不精确比较。

从图特征映射φ0到图特征映射φ1

-

φ0是从节点(边)映射到在欧氏空间表示属性的H0。

-

相反, ϕ 1 p a t h \phi_1^{path} ϕ1path是高斯核 κ 1 \boldsymbol{\kappa_1} κ1的核映射,将边p映射到以φ0§为中心的高斯函数。

- 第一步是从节点u中提取长度为k(这里用红、蓝、绿三种颜色表示)的路径;

- (在右侧面板)通过高斯核映射将它们映射到RKHS H j + 1 \mathcal{H_{j+1}} Hj+1。在节点u处通过它们在 H j + 1 \mathcal{H_{j+1}} Hj+1的表示的局部路径聚合(池化)得到新的映射 φ j + 1

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

865

865

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?