一层网络实际上是一个线性函数,即权重W与输入x相乘(偏置项包含其中)

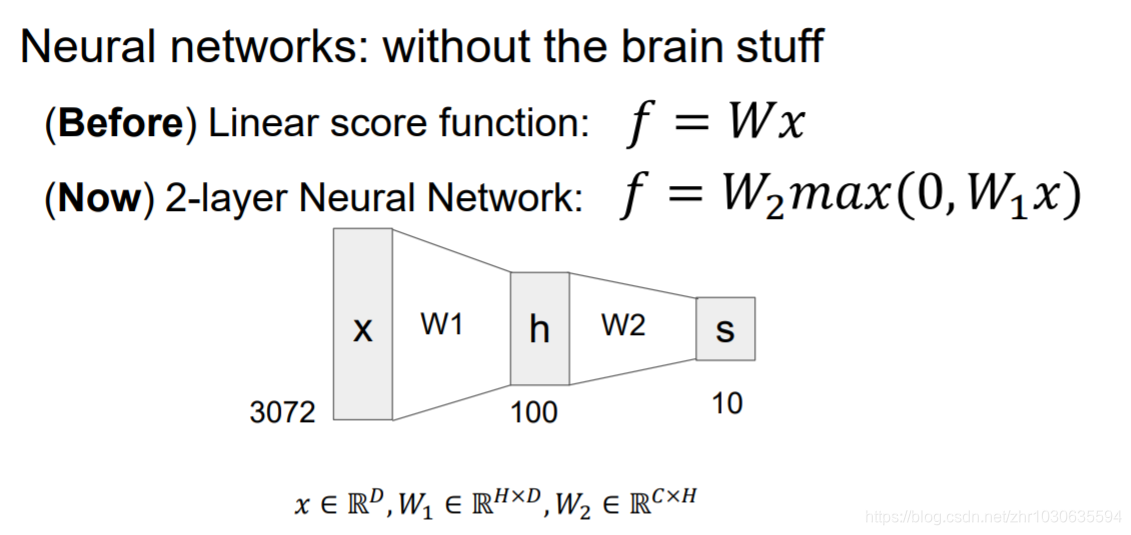

当我们增加一层,变为两层神经网络

这里的max是将第一层负数结果置为0

用权重W2乘第一层结果

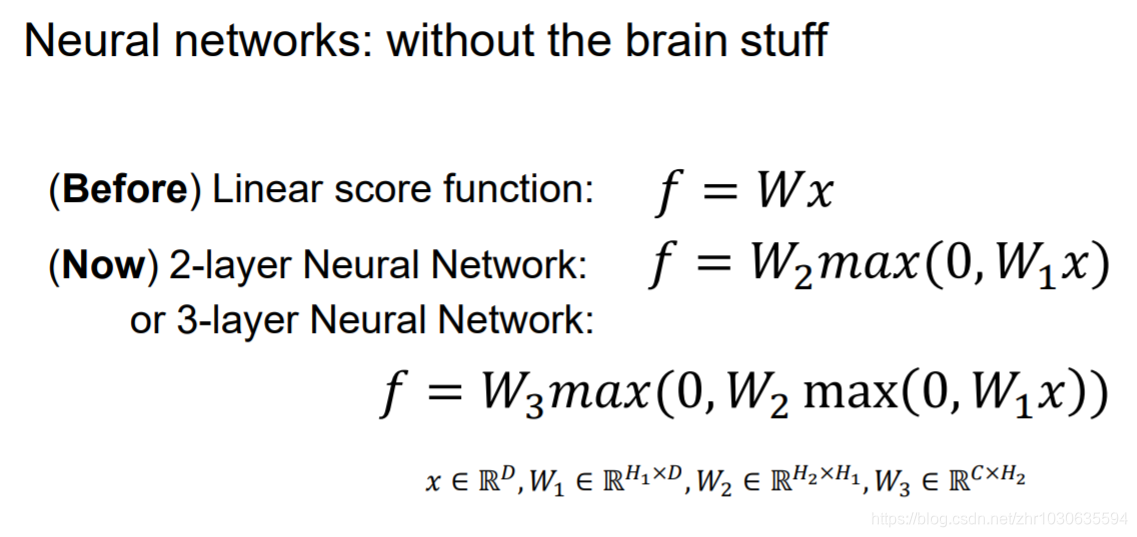

当我们扩展到三层即更多层,也是类似

那么我们不使用max可以吗?

我们看到,如果没有max,W1 W2 可以合成一个大的W3,最后还是一个线性分类,没有实质性改变

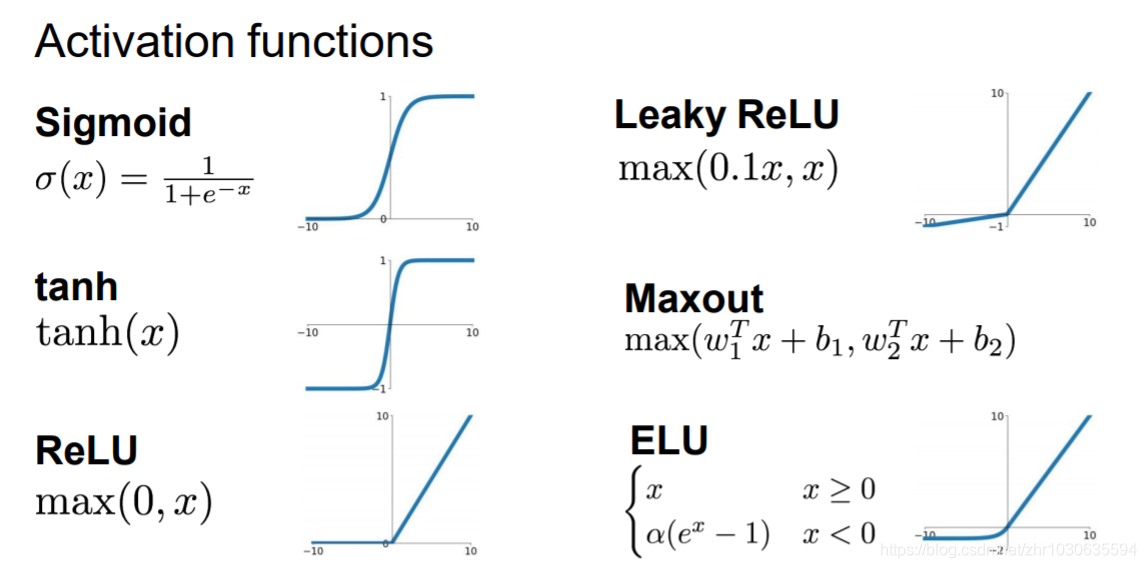

所以,这里的max是不可去掉的,而这里的max,被称作激活函数

激活函数:

我们看到激活函数有很多种,也可以自己定义,我们上面使用的max,就是ReLu,也是在默认情况下效果较好的

激活函数给模型引入了非线性因素,使得深层神经网络有了意义

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?