hadoop安装包3.3.6版本

链接:https://pan.baidu.com/s/1_afgDWVBhcU4QW_QokupQQ?pwd=0910

提取码:0910

jdk包1.8_212版本

链接:https://pan.baidu.com/s/18unrZ1FH_B4H6jHbn09Vhg?pwd=wqkh

提取码:wqkh

liunx虚拟机安装iso文件

链接:https://pan.baidu.com/s/1176bZCpz1LQvcVfERSWCdQ?pwd=kx2z

提取码:kx2z

第一步

- 安装三台虚拟机

- Ping www.baidu.com测试网络

- service network restart打开网络

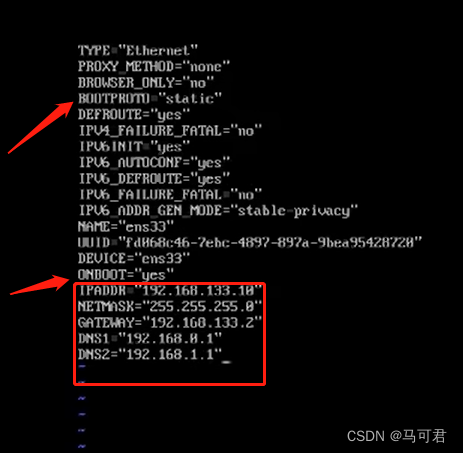

- cd /etc/sysconfig/network-scripts

- vi ifcfg-ens33修改ip地址

- Ping www.baidu.com测试网络

- service network restart打开网络

- Systemctl stop firewall关闭防火墙

- Systemctl disable firewall 彻底关闭

第二步

- hostnamectl set-hostname 主机名

- reboot重启

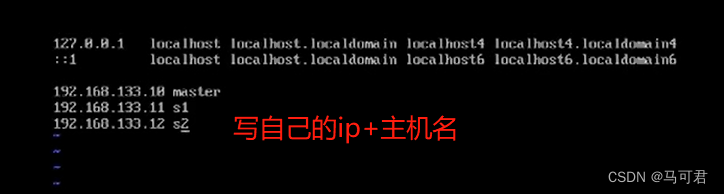

- vi /etc/hosts配置host文件(三台虚拟机同样操作)

- ping 另一台主机名

第三步

- 连接xshell

- yum install lrzsz安装上传工具

- rz 传文件

第四步

免密登录

- ssh-keygen -b 1024 -t rsa(三台虚拟机都要操作)

- cd .ssh进入ssh中

- vi id_rsa.pub

- ssh-copy-id 主机名(root目录下)

- 输入免密的祝你明密码

cd .ssh

- vi authorized_keys

- Ssh 主机名(测试免密登录)

第五步

- cd .ssh

- Ls

- Chmod 600 authorized_keys改权限(三台虚拟机都要操作)

- 时间同步配置

- Cd . ssh

- Crontab -e

- 0 1 * * * /usr/sbin/ntpdata cn.pool.ntp.org

- Clock

第六步

- tar -xzvf 文件压塑包(解压压塑包,仅在主虚拟机操作,最后复制到其他虚拟机)

- Yum install vim

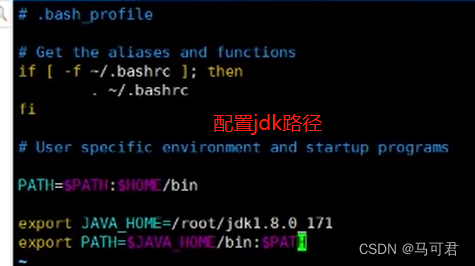

- vi .bash_profile

- Source 。Bas_profile重新加载

- Java -version检查java是否安装

- Scp -r jdk文件 root@另一虚拟机名:~/(传jdk到指定的虚拟机)

第七步

- cd /hadoop-3.3.6/etc/hadoop

- vi hadoop-env.sh配置java环境(三台虚拟机都要配置)

- vi 配置java环境

- vi core-site.xml

<property>

<name>fs.default.name</name>

<value>hdfs://hadoop10:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/root/hadoopdata</value>

</property>

- vi hdfs-site.xml

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

- Vi mapred-site.xml

<property>

<name> mapreduce.framework.name </name>

<value>yarn</value>

</property>

- vi yarn-site.xml

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop10</value>

</property>

<property>

<name> yarnnodemanager.aux-services</name>

<value>mapreduce shuffle</value>

</property>

- vi slaves

第八步

- cd(到root下)

- Scp -r hadoop-3.3.6 另一个主机名:~/(把hadoop文件copy到其他虚拟机下)

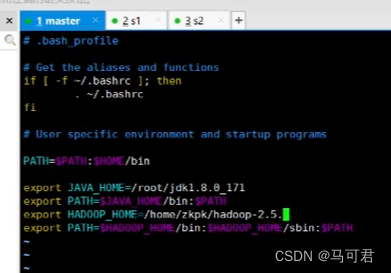

- 配置系统变量(三台虚拟机都要配置)

- Vi .bash_profile

- mkdir /root/hadoopdata(创建文件夹)

第九步

- hdfs namenode -format(格式化hadoop)

第十步

- start-all.sh(启动hadoop)

- Jps(检查是否全部启动)

- Cd /hadoop-3.3.6etc/hadoop(进入到hadoop目录下)

- hadoop jar -/hadoop-3.3.6/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.6.jar pi 10 10

- 在hadoopmaster上启动Firefox, 输入http://主机名:50070/检查

- 代表Hadoop安装成功

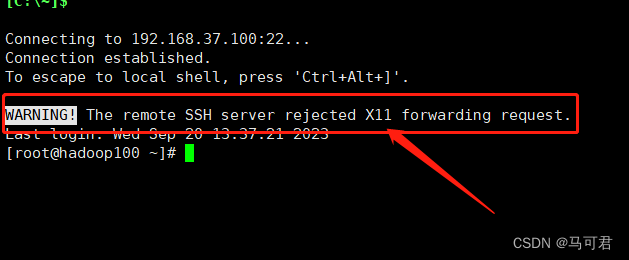

第十一步

- 重启

- 修改这个问题

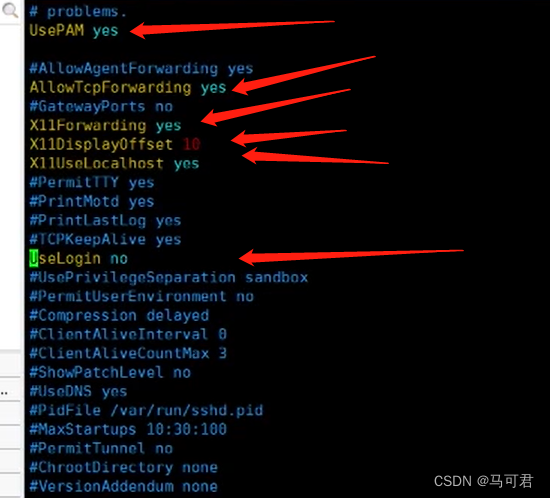

- 输入Vi /etc/ssh/sshd_config,修改页面上的选项,去掉前边的#

- Yum install xorg-x11-xauth(root目录下)

- Yum install xclock

- Systemctl restart sshd (重启sshd)

- 关闭,重新启动连接

- Clock(测试clock是否可以使用)(显示时间)

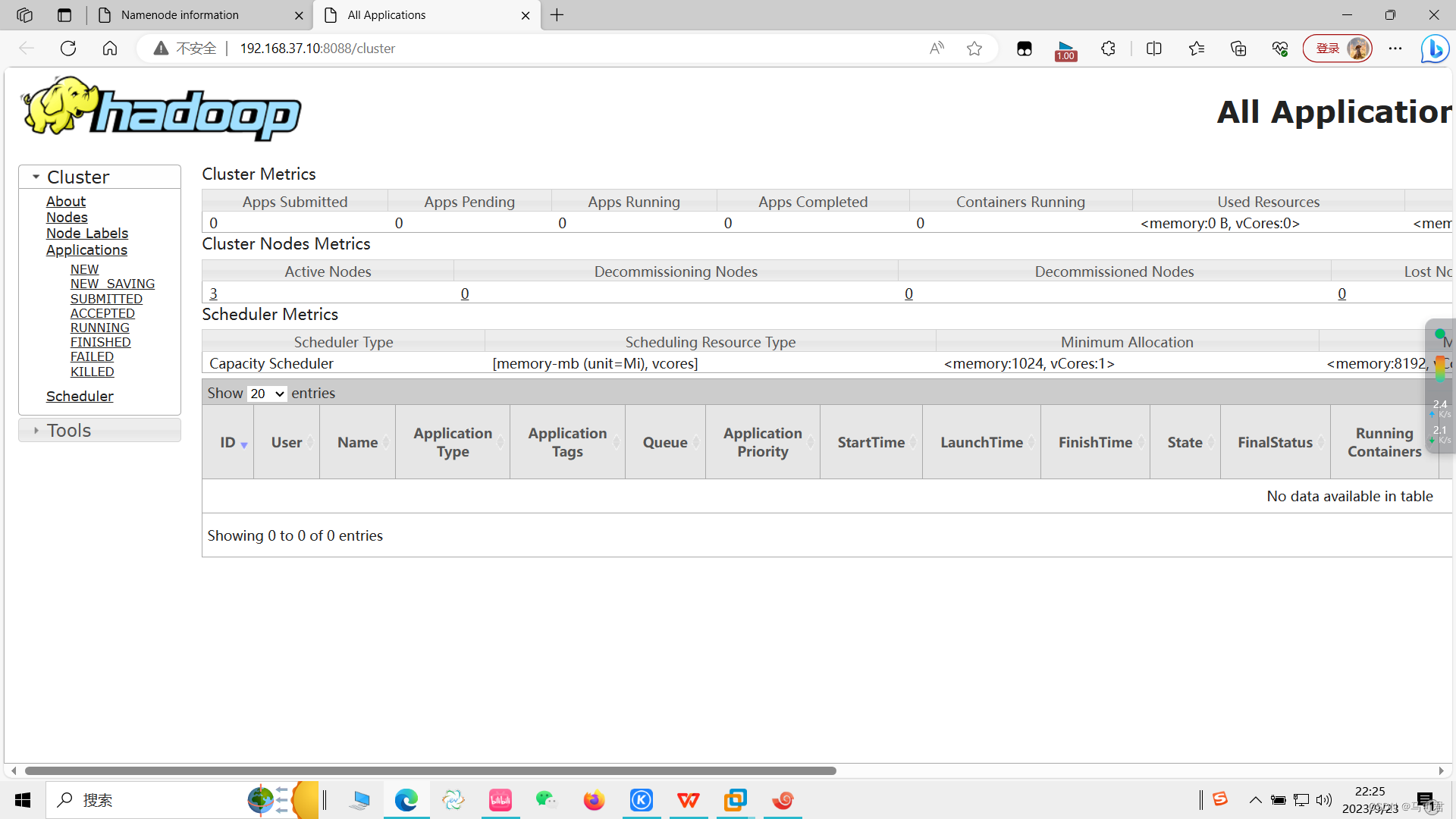

- Start-all.sh启动hadoop

- 在Firefox浏览器输入 主机名:50070(hadoop3.x.x.x输入9870端口)

- Ip:8088(查看hadoop运行状态)

第十一步

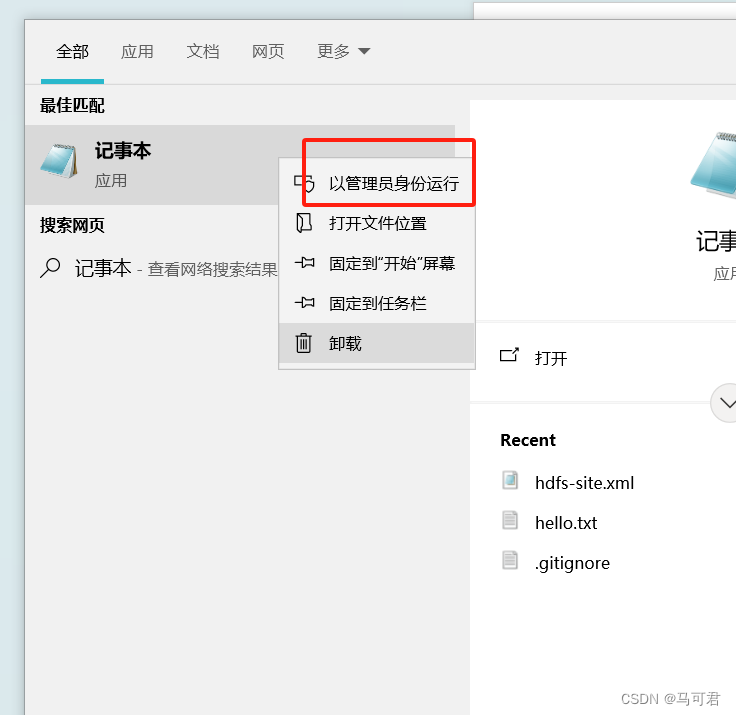

解决hadoop网页上传不了文件问题

- 状态栏打开记事本,以管理员身份运行,

- 在文件中点击打开,进入到c/window/system32/drivers/etc

- 点击右下角进入所有文件

- 点击hosts进入,编辑输入自己创建的虚拟机名称和ip,

- 保存退出

- 重启hadoop,在浏览器输入虚拟机的ip:9870进入浏览器(hadoop是3.x.x版本的使用9870端口,hadoop是2.xxx版本的使用50070端口,如果不能用这俩端口都试试)

- 输入ip:8088进入yarn调度页面

- 到这hadoop就安装完毕了,

1161

1161

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?