朴素贝叶斯法:

前提:朴素贝叶斯法是建立在贝叶斯定理和特征条件独立假设的基础上的分类方法。

大致流程为:对于给定的训练数据集,首先基于特征条件独立假设学习输入/输出的联合概率分布:然后基于此模型,对给定的输入x. 利用贝叶斯定理求出后验概率最大的输出y。

说白了就是通过贝叶斯公式算出后验概率,哪个大就归为哪一类。

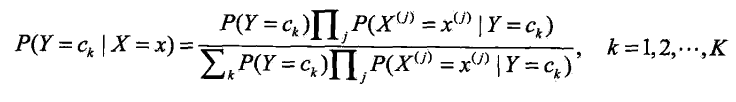

首先引入条件独立性假设:

正是由于这个假设,朴素贝叶斯方法实现起来非常简单,而且效率高,但是正是由于这个假设,分类准确性会受到一些影响。(这是当然的,有个这么强的假设,肯定会牺牲掉一些东西)

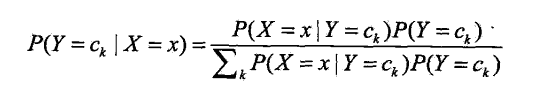

然后是贝叶斯公式;

将两个式子融合下就成了朴素贝叶斯法的基本公式:

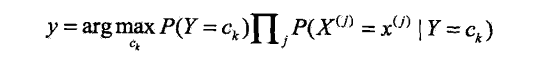

而我们要求的就是上诉实在的最大值,对于各分类,分母是相同的,所以也可直接写成

在第一章中将结构风险最小化时,我们就说过,朴素贝叶斯最大后验概率就是其中一个例子。

所以朴素贝叶斯法将实例分到后验概率最大的类中,这等价于期望风险最小化。

具体证明在书上,就不写了。

从公式中我们也可以发现,分子中各部分都需要用到的都是训练数据集,也就是要用到极大似然估计,那么就有可能出现概率值为0的情况。(比如我要确定x=(1,a)的类标记, 训练集中数据为(1,b,Y=1)(2,c,Y=-1),这样P(x2=a|Y=1)=0)

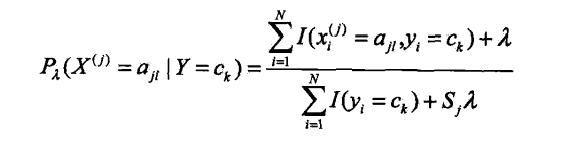

解决这种问题的方法是用贝叶斯估计,

当系数=1时,就是拉普拉斯平滑(。。。。我不知道在这里怎么打这个符号)

1276

1276

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?