0.说明

本文章仅用于python爬虫的学习,爬取到的数据仅用于学习、竞赛等非营利活动,如有侵权请及时联系。

1.简单介绍

我们在爬虫时,往往都是静态界面,或者没有嵌套的的界面,直接使用requests.get()方法就可以 获取,但是当遇到动态刷新的界面,或者有iframe嵌套的界面,我们应该怎么处理。

selenium是一个很棒的库,除了可以完成自动化操作,还可以很好的解决上面的问题,下面我以爬取全国电动汽车充电站数据为例,学习一下爬虫的另一些方面。

2.代码部分

话不多说,先上代码

from bs4 import BeautifulSoup

from selenium import webdriver

import re

import requests

import xlsxwriter

# 1.得到一个城市所有停车桩链接

info = []

driver = webdriver.Chrome("chromedriver.exe") #启动浏览器

driver.get("http://www.bjev520.com/jsp/beiqi/pcmap/do/pcMap.jsp?cityName=北京") #用浏览器打开链接,北京可以改成其他省份

driver.switch_to.frame('left') #网页是嵌套的,在一网页下面,有一个iframe,我们找到这个iframe

soup = driver.find_elements_by_tag_name('a') #链接都在a标签中,我们找到a标签

for item in soup:

info.append(item.get_attribute('href')) #提取数a标签里面的href链接

#2.爬虫函数

def get_data(url):

try:

headers = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/92.0.4515.131 Safari/537.36'}

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

print(response.status_code)

return None

except:

print('访问 http 发生错误... ')

return None

# 3.数据筛选

j=1

workbook = xlsxwriter.Workbook("test.xlsx")

df = workbook.add_worksheet()

cols = ["名称","地址","快充数量","慢充数量","支付方式","充电费","服务费","停车费","开放时间"]

for i in range(9):

df.write(0,i,cols[i])

for u in info:

url = u

print(j)

html = get_data(url)

if html !=None:

soup = BeautifulSoup(html)

Name = soup.find_all("div",{"class":"news-top"})[0]

name = Name.find_all("p")[0].text

Address = soup.find_all("div",{"class":"news-a"})[0]

address = Address.find_all("p")[0].text

try:

num = soup.find_all("div",{"class":"news-c"})[0].find_all("p")[0].text

p = re.compile('数量:(.*)个')

num = re.findall(p,num)[0]

except:

num = "NA"

try:

num2 = soup.find_all("div",{"class":"news-c"})[0].find_all("p")[1].text

p = re.compile('数量:(.*)个')

num2 = re.findall(p,num2)[0]

except:

num2 = "NA"

Pay_type = soup.find_all("div",{"class":"news-con"})[0].find_all("ul",{"class":"news-d details"})[0]

pay_type = Pay_type.find_all("li")[0].find_all("div")[0].text

p1 = re.compile("支付方式:")

pay_num = Pay_type.find_all("li")[1].find_all("div")[0].text.strip()

pay_fee = Pay_type.find_all("li")[2].find_all("div")[0].text.strip()

pay_park = Pay_type.find_all("li")[3].find_all("div")[0].text.strip()

time = Pay_type.find_all("li")[4].find_all("div")[0].text.strip()

#4.把数据存储

if name != None:

df.write(j,0,name)

df.write(j,1,address)

df.write(j,2,num)

df.write(j,3,num2)

df.write(j,4,pay_type)

df.write(j,5,pay_num)

df.write(j,6,pay_fee)

df.write(j,7,pay_park)

df.write(j,8,time)

j = j+1

else:

j=j+1

workbook.close()

3.内容分析

本次爬虫数据来源:全国电动汽车充电站分布图

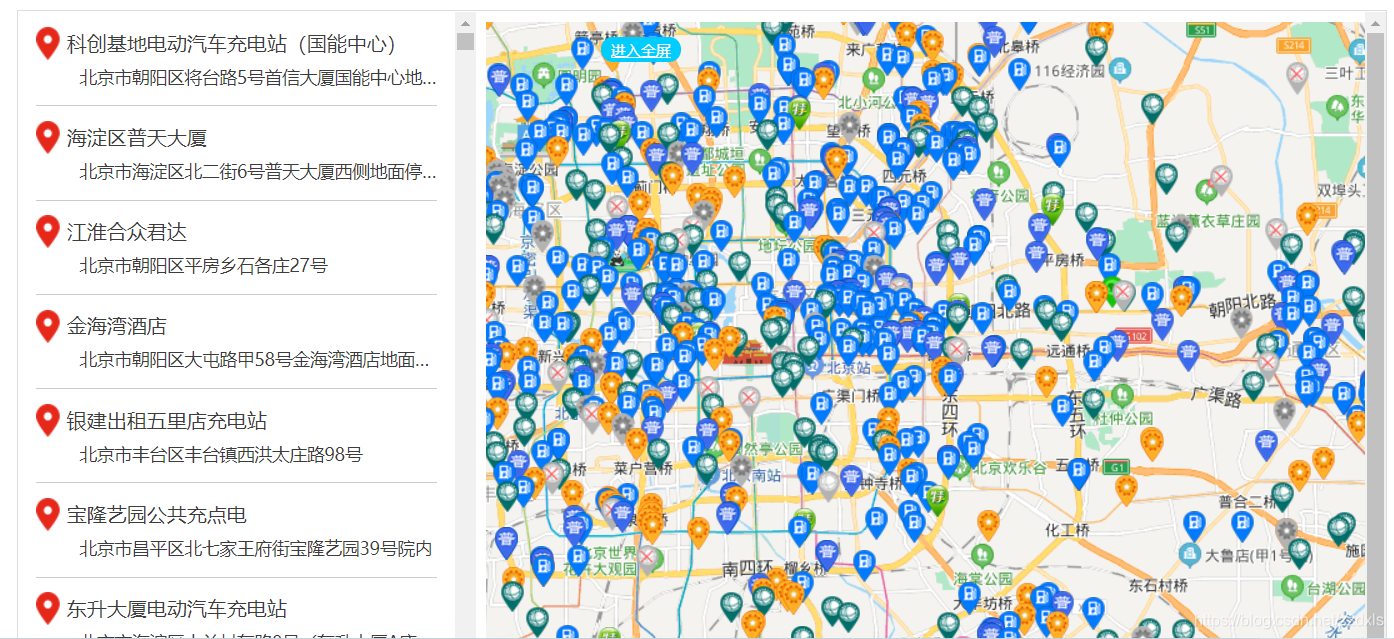

进入网页,看到是一个中国地图,地图省份上面有数字,应该是这个省份充电桩数量,我们点进去城市看下,以北京市为例。

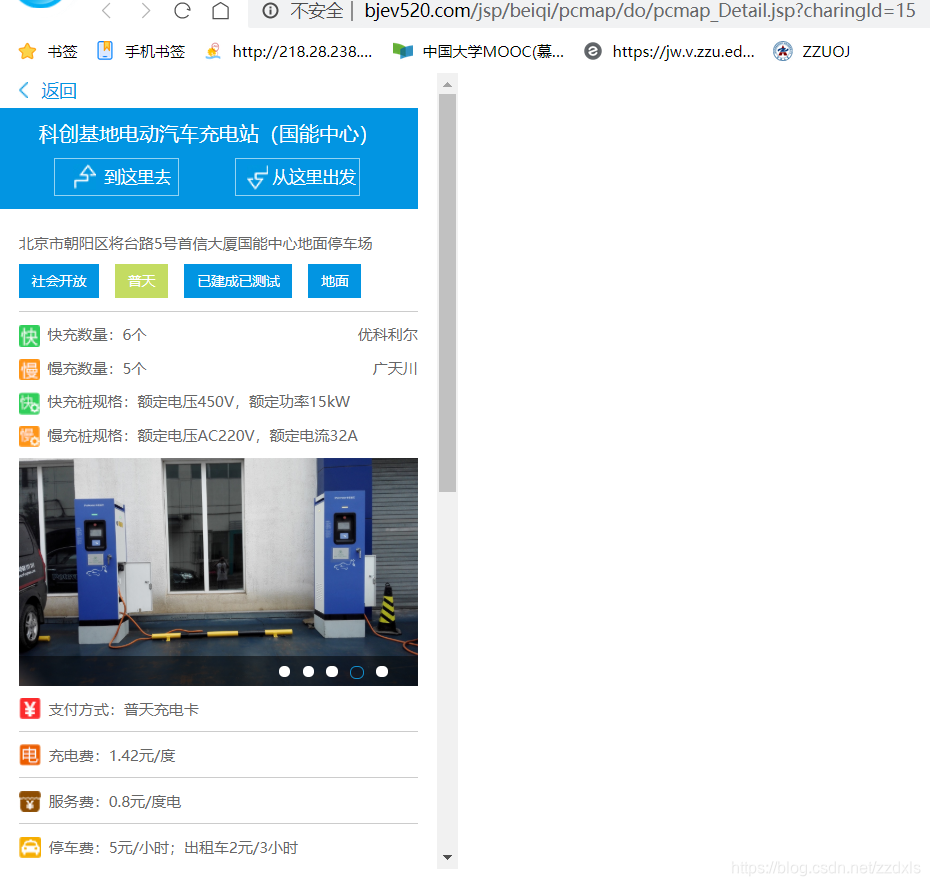

左边是地址,右边是地图,我们不关心地图,只关心左边的地址。点击左边的地址,发现跳转到了一个界面, 这里面包含了所有的数据,心中窃喜。

话不多说,开始整活

1.检查链接

![]()

地图的链接是这样的,一看又是心中狂喜,根据经验,把北京换成其他城市,肯定跳转到其他城市,试验了一下,果然是。这样要得到全国的充电站数据,得到一个一个省的就可以,而且还做好了分类,针不戳。

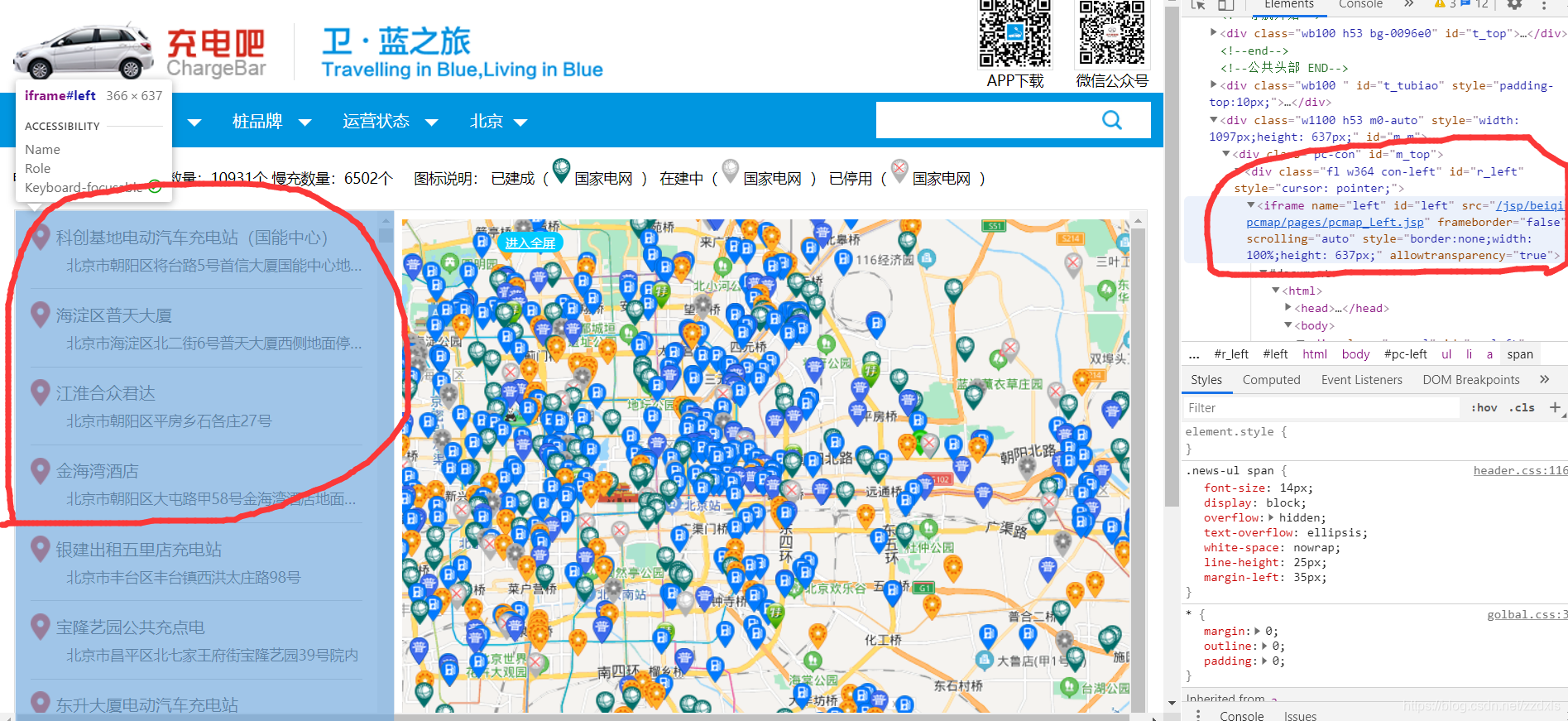

2.检查网页源代码

发现数据都在这个 id = 'left' 的 iframe框架里面,事情有些不简单了,这时候直接get方法,得到的源代码,没有iframe部分,那怎么办。查了资料发现,可以用selenium库,解决这个问题。

driver = webdriver.Chrome("chromedriver.exe") #启动浏览器

driver.get("http://www.bjev520.com/jsp/beiqi/pcmap/do/pcMap.jsp?cityName=北京") #用浏览器打开链接,北京可以改成其他省份

driver.switch_to.frame('left') #网页是嵌套的,在一网页下面,有一个iframe,我们找到这个iframe这样就进入了iframe里面的html代码。想着可以得到网页的源代码,问题就不大了????

soup = BeautifulSoup(driver.page_source, "html.parser")

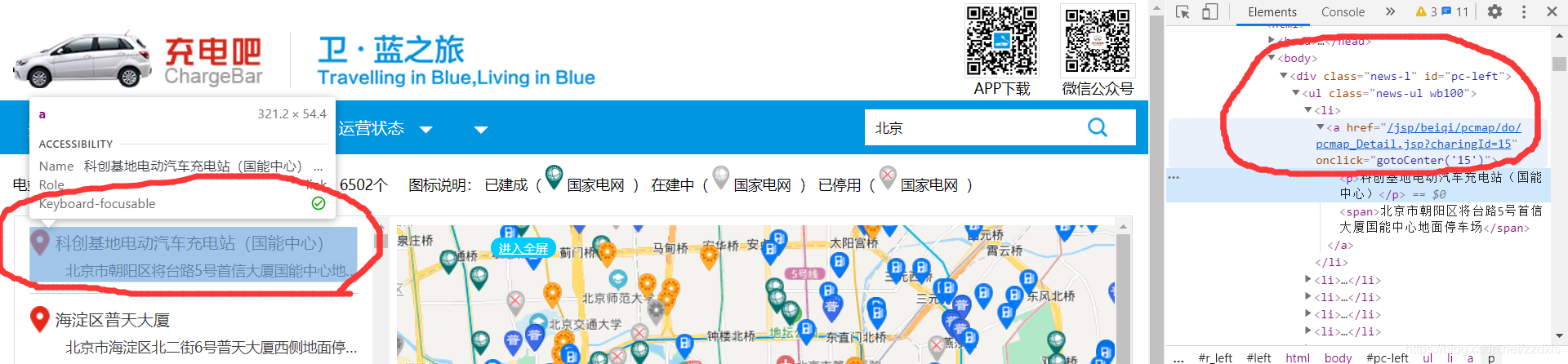

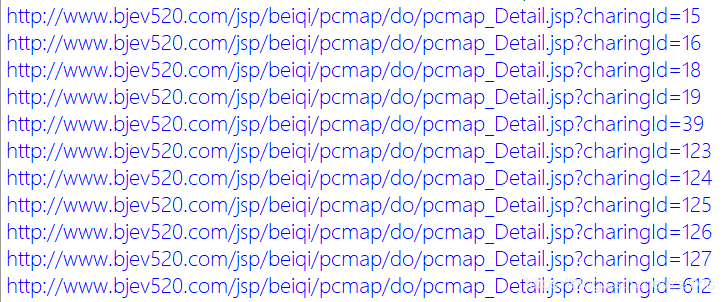

可以看到,每一个地点,都在一个链接上面,这个链接都在<a>标签中,单独输入链接,我们可以得到和上面一样的内容,好家伙,那我得到这个界面所有的<a>标签内容不就可以了吗。

话不多说,开始尝试

driver = webdriver.Chrome("chromedriver.exe") #启动浏览器

driver.get("http://www.bjev520.com/jsp/beiqi/pcmap/do/pcMap.jsp?cityName=北京") #用浏览器打开链接,北京可以改成其他省份

driver.switch_to.frame('left') #网页是嵌套的,在一网页下面,有一个iframe,我们找到这个iframe

soup = driver.find_elements_by_tag_name('a') #链接都在a标签中,我们找到a标签

for item in soup:

print(item.get_attribute('href')) #提取数a标签里面的href链接打印出来的结果正是所有的链接

数据的开头和结尾

链接问题解决

3.开始爬虫

爬虫的话,因为都是静态界面,那就三步走:requests.get()获取源代码,Beautifulsoup提取信息,正则表达式进一步提取信息(可选)。

爬虫的代码,url就是上面的链接

def get_data(url):

try:

headers = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/92.0.4515.131 Safari/537.36'}

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

else:

print(response.status_code)

return None

except:

print('访问 http 发生错误... ')

return None数据筛选

for u in info:

url = u

print(j)

html = get_data(url)

if html !=None:

soup = BeautifulSoup(html)

Name = soup.find_all("div",{"class":"news-top"})[0]

name = Name.find_all("p")[0].text #地名

Address = soup.find_all("div",{"class":"news-a"})[0]

address = Address.find_all("p")[0].text #地址

try:

num = soup.find_all("div",{"class":"news-c"})[0].find_all("p")[0].text

p = re.compile('数量:(.*)个')

num = re.findall(p,num)[0]

except:

num = "NA" #快充数

try:

num2 = soup.find_all("div",{"class":"news-c"})[0].find_all("p")[1].text

p = re.compile('数量:(.*)个')

num2 = re.findall(p,num2)[0] #慢充数

except:

num2 = "NA"

Pay_type = soup.find_all("div",{"class":"news-con"})[0].find_all("ul",{"class":"news-d details"})[0]

pay_type = Pay_type.find_all("li")[0].find_all("div")[0].text #支付方式

pay_num = Pay_type.find_all("li")[1].find_all("div")[0].text.strip() #充电费

pay_fee = Pay_type.find_all("li")[2].find_all("div")[0].text.strip() #服务费

pay_park = Pay_type.find_all("li")[3].find_all("div")[0].text.strip() #停车费

time = Pay_type.find_all("li")[4].find_all("div")[0].text.strip() #开放时间4.数据存储

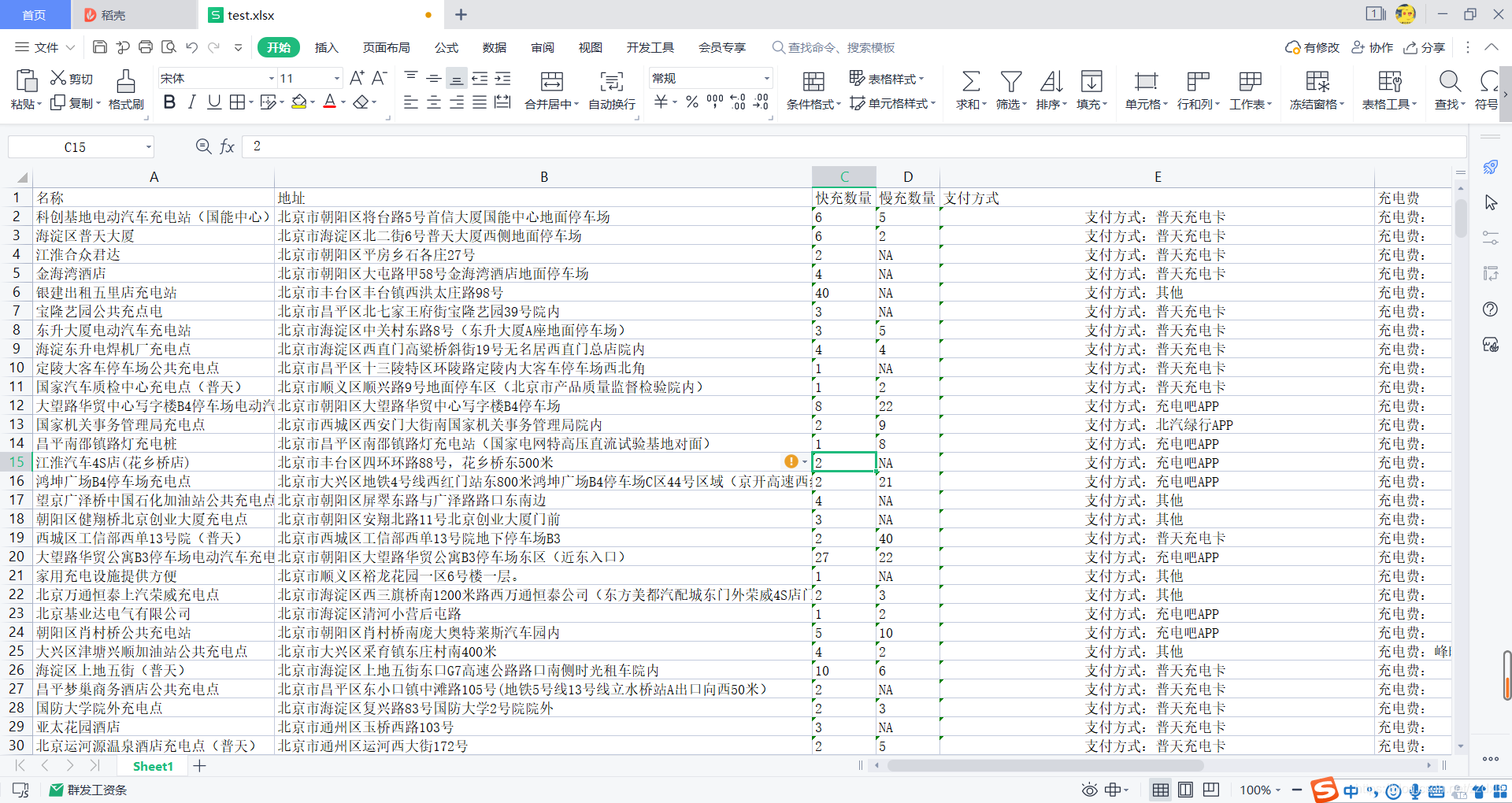

使用xlxswriter进行对xlsx文件存取,方便数据的合并,看看效果

4.总结

后续的话还可以对数据进一步处理,也可以做可视化,和数据处理。

driver = webdriver.Chrome("chromedriver.exe") 这行代码,要根据自己谷歌浏览器的版本,下载对应的的chromedriver.exe文件。

655

655

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?