这一讲开始将是学习理论(Learning Theory)方面的内容.

Bias/variance trade-off(偏差-方差权衡)

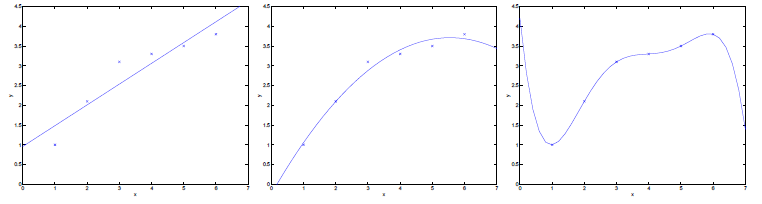

回到线性回归问题,如图:

泛化误差(generalization error):可能出现的错误并不再已有的数据集中

上图中,左右两幅图的泛化误差都比较大.

左边是欠拟合(underfit)的,即使能够拟合很大一部分数据,但还是可能出现偏差(bias).

右边是过拟合(overfit)的, 在有限小数据,拟合程度是很好的,但是对于一个新的输入,很有可能会有很大的误差,这种称作模型有很大的方差(variance).

所以,经常要在偏差和方差中间做权衡,如果选择的模型太简单参数太少,可能会有很大的偏差(但是很小的方差),如果模型太复杂,参数太多又可能会有很大的方差(但很小的偏差). 上面给出的例子中中间的二次函数比左边的线性函数和右边的五次函数拟合得都好.

引理:(联合界,the union bound)假设A1,A2,…,Ak为k个不同的事件(可能独立也可能不独立).那么,

本文介绍了机器学习中的经验风险最小化与偏差-方差权衡概念。通过线性回归问题,解释了欠拟合和过拟合的原理,并探讨了如何在偏差和方差之间寻找平衡。文中还引入了Hoeffding不等式和一致收敛的概念,用于分析训练误差与泛化误差的关系,进一步讨论了样本复杂性和所需数据集大小的确定方法。

本文介绍了机器学习中的经验风险最小化与偏差-方差权衡概念。通过线性回归问题,解释了欠拟合和过拟合的原理,并探讨了如何在偏差和方差之间寻找平衡。文中还引入了Hoeffding不等式和一致收敛的概念,用于分析训练误差与泛化误差的关系,进一步讨论了样本复杂性和所需数据集大小的确定方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?