nn1为active,nn2为standby,upgrade.sh为批量执行脚本

首先下载2.7.2的hadoop源码进行编译,形成hadoop-2.7.2.tar.gz

安装新版本的hadoop,从log-server上分发新版的hadoop并解压

cd /letv/setupHadoop

./upgrade.sh distribute cluster_nodes hadoop-2.7.2.tar.gz /letv/usr/local

./upgrade.sh common cluster_nodes “cd /letv/usr/local;tar -xzvf hadoop-2.7.2.tar.gz”

将新版hadoop 的 /etc/hadoop下的所有文件替换为原版hadoop的相同文件夹下的配置文件。

./upgrade .sh common cluster_nodes “cd /letv/usr/local/hadoop-2.7.2/etc;rm -rf hadoop;cp -r /usr/local/hadoop/etc/hadoop /letv/usr/local/hadoop-2.7.2/etc “

一、 Prepare Rolling Upgrade

1、以hadoop用户登录nn2执行

“hdfs dfsadmin -rollingUpgrade prepare”

2、nn2上执行

“hdfs dfsadmin -rollingUpgrade query”

等待,直到出现 “Proceed with rolling upgrade”如果不出现,重复执行前一个命令

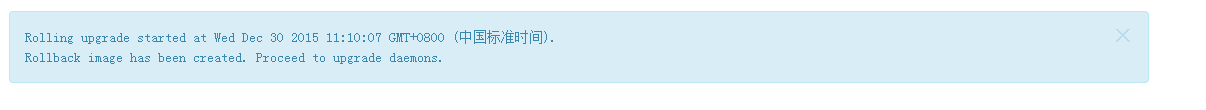

3、完成操作后,在namenode的50070端口页面最上端上会出现相应提示信息,表示roll

本文详细介绍了如何将Hadoop集群从2.6.4版本升级到2.7.2版本,包括准备滚动升级、主动和备用NameNode及ZKFC的升级、JournalNode和DataNodes及Nodemanager的升级步骤,确保集群稳定且无数据丢失。

本文详细介绍了如何将Hadoop集群从2.6.4版本升级到2.7.2版本,包括准备滚动升级、主动和备用NameNode及ZKFC的升级、JournalNode和DataNodes及Nodemanager的升级步骤,确保集群稳定且无数据丢失。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1401

1401

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?