《Spark亚太研究院系列丛书——Spark实战高手之路 从零开始》本书通过Spark的shell测试Spark的工作;使用Spark的cache机制观察一下效率的提升构建Spark的IDE开发环境;通过Spark的IDE搭建Spark开发环境;测试Spark IDE开发环境等等。本节为大家介绍基于IDEA使用Spark API开放Spark程序。

基于IDEA使用Spark API开放Spark程序(3)

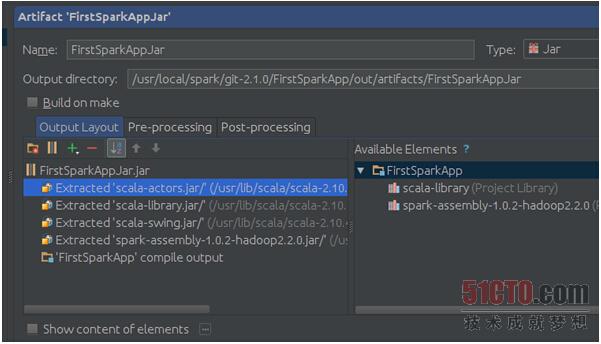

把名称改为FirstSparkAppJar:

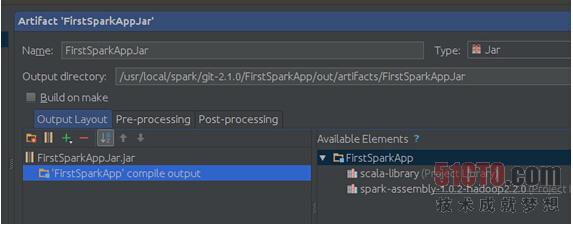

因为每台机器上都安装了Scala和Spark,所以可以把Scala和Spark相关的jar文件都删除掉:

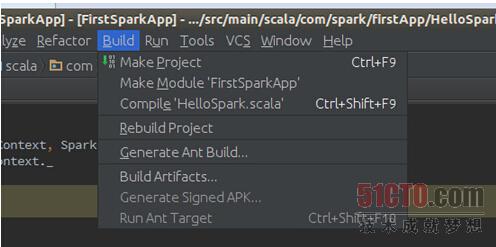

接下来进行Build:

选择“Build Artifacts”:

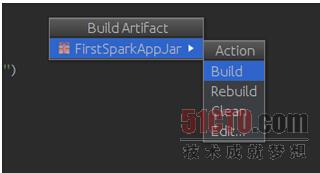

第一次是选择Build,以后同一个工程要选择Rebuild,然后等待编译完成:

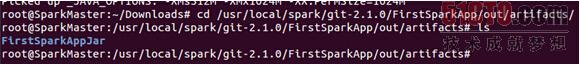

进入其编译后目录查看编译完成的文件:

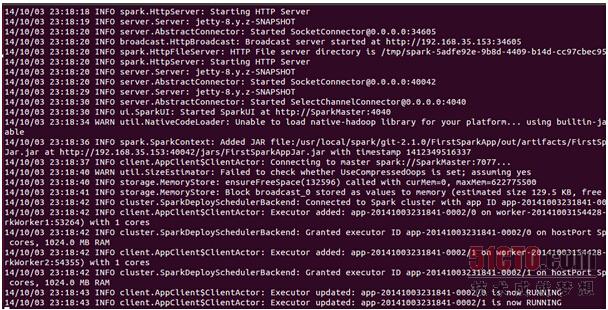

接下来使用spark-submit运行该程序:

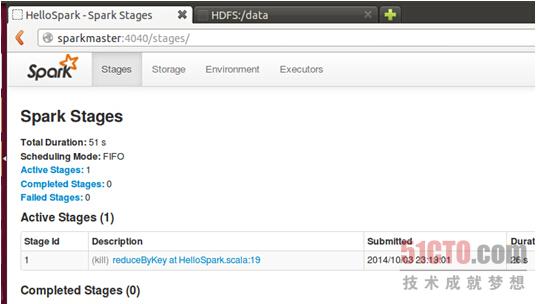

此时查看控制台:

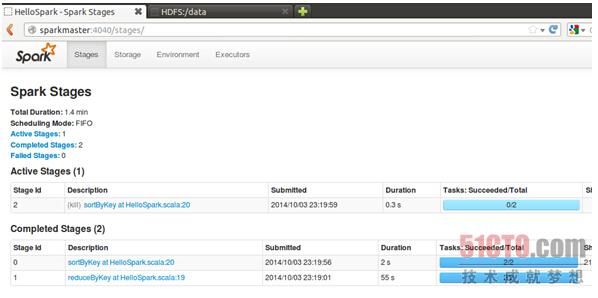

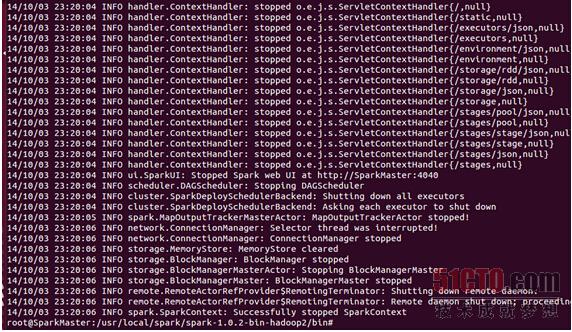

最后运行完成任务:

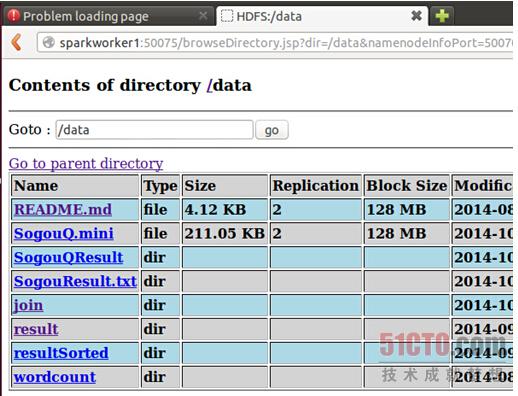

我们到HDFS控制台查看运行结果:

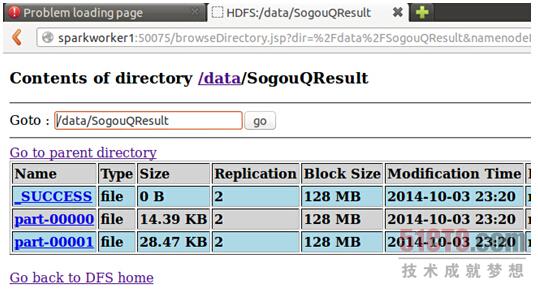

进入SogouQResult文件夹:

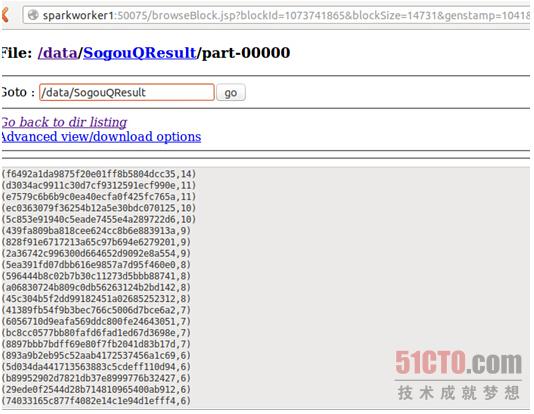

查看执行结果:

这个内容和我们前面完全spark-shell的执行时一样的。

231

231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?