基础智能体的进展与挑战综述

从类脑智能到具备可进化性、协作性和安全性的系统

【翻译说明】本文是由Bang Liu(MetaGPT)等作者2025年3月发表于Arxiv网站的论文《Advances and Challenges in Foundation Agents: From Brain-Inspired Intelligence to Evolutionary, Collaborative, and Safe Systems》翻译而来,其目的是帮助中文阅读者更容易理解。翻译过程中借用了ChatGPT-4o模型的英转中能力,并根据翻译团队的体会和理解进行了修正,也算一次AI时代的人智协作实验,如有不到位的地方,欢迎读者指正。

摘要

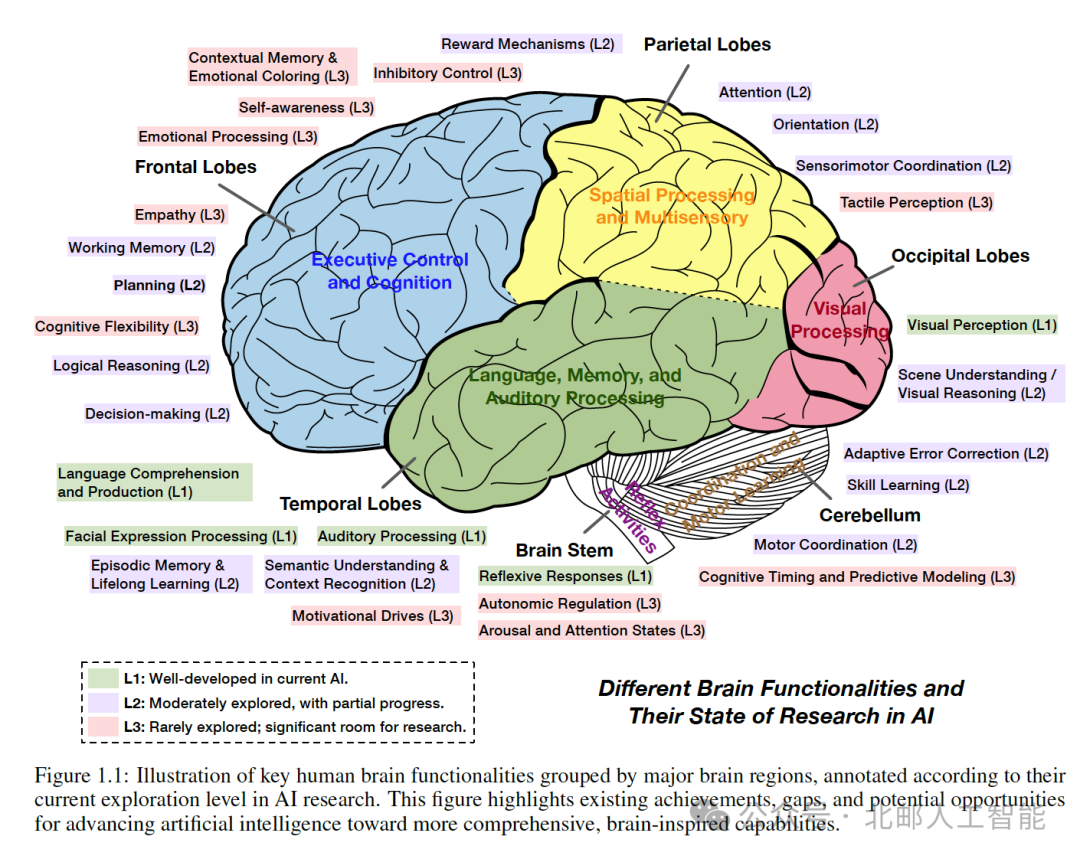

大型语言模型(LLMs)的出现和发展加速了人工智能领域的变革性转变,为能够在不同领域中进行复杂推理、鲁棒感知和多样化行动的高级智能体铺平了道路。随着这些智能体越来越广泛地推动AI研究和实际应用,它们的设计、评估和持续改进呈现出复杂而多样的挑战。本综述提供了一个全面的概述,将智能体框定在一个模块化、类脑启发的架构中以进行调查和研究。该架构融合了认知科学、神经科学和计算研究中的原理。我们将探索内容结构化为四个相互关联的部分:(1)深入研究智能体的模块化基础,系统性地将其认知、感知和操作模块映射到人脑的类似功能上,并阐明其核心组成部分,如记忆、世界建模、奖励处理和类情感系统;(2)讨论自我增强与适应性进化机制,探索智能体如何自主改进其能力、适应动态环境,并通过自动化优化范式,包括新兴的自动机器学习(AutoML)与基于大语言模型的优化策略实现持续学习;(3)研究协作性与进化性多智能体系统,探讨在智能体交互、协作和社会结构中涌现的集体智能,并强调其与人类社会动态的相似性;(4)关注构建安全、可靠和有益的AI系统这一关键问题,强调内在与外在安全威胁、伦理对齐、系统鲁棒性及在现实部署中必需的循序渐进策略。通过将模块化AI架构与不同学科的洞见相结合,本综述对关键的研究空白、挑战与机遇进行了产生,希望能推动技术进步与有意义的社会效益之间的和谐发展。本论文相关的Github项目地址为:

https://github.com/FoundationAgents/awesome-foundation-agents

前言

大型语言模型(LLMs)通过其在自然语言和多模态理解、推理与生成方面展现出的前所未有的能力,彻底改变了人工智能(AI)领域。大型语言模型在海量数据集上训练,并展现出诸如推理、上下文学习,甚至初步规划等涌现能力。然而,虽然这些模型在实现智能机器方面迈出了重要一步,但它们自身尚未完全具备一个“智能体”应有的全部能力。自人工智能诞生以来,AI研究者们一直在追寻真正“智能”的系统,这样的系统应当能够学习、规划、推理、感知、交流、行动、记忆,并表现出多种类似人类的能力和灵活性。这些被称为“智能体”的存在,还应该能够兼顾长远与短期思维,执行复杂行为,并能与人类和其他智能体互动。LLMs 是迈向实现智能体的重要一步,但并不是完全实现目标的最终答案。

本综述全面概述了基于 LLM的智能体的最新研究现状。尽管过去有许多关于智能体的研究论文和书籍,也有大量关于LLM的论文和资料,但还很少有能将二者系统性结合并深入探讨的资料。尽管LLM可以实现智能体所需的许多关键能力,但它们本质上只是提供了构建智能体的基础。举例而言,LLM能够辅助生成旅行计划等任务,但尚不能为复杂的专业任务生成完整可行的计划,也难以在不产生幻觉的前提下维持长期记忆。此外,它们在执行现实世界行动方面的自主能力仍十分有限。我们可以将 LLM 视为“引擎”,而智能体则是基于这些引擎构建的“汽车”、“船只”或“飞机”。在这种“引擎-载具”的类比框架下,我们可以自然地提出一些关键问题:

● 当前的LLM技术能提供智能体的多少能力?

● 还有哪些功能尚无法基于当前技术实现?

● 除了LLM之外,还需要做哪些努力,才能实现真正能够在物理世界中自主行动与交互的智能体?

● 想要构建真正整合的LLM智能体,还存在哪些挑战?

● 为了构建能够高效与人类协作、善于沟通的智能体,我们还需要发展哪些能力?

● 哪些领域是当前LLM智能体的可以较容易获得成功的领域?

● 一旦我们拥有完全智能的 LLM 智能体,对社会将产生哪些影响?我们又该如何为这一未来做好准备?

这些问题不仅关乎扩展当前LLM和智能体的工程实践,也引发了对未来研究方向的思考。本综述的编写汇集了来自人工智能多个前沿领域的研究者,从LLM的研发到智能体的设计,来尝试全面回应上述问题。本总数共分为四部分:

(1)阐述了构建个体智能体所需的基本能力,并将其与人类在感知与行动等方面的能力进行了对比;

(2)探讨了智能体的进化能力,以及这一能力对智能工具(如工作流管理系统)的影响

(3)讨论了智能体社会,强调它们的协作与集体行为能力;

(4)涉及伦理与社会方面的问题,包括智能体的安全性与责任问题。

本综述面向研究者、学生、政策制定者以及行业从业者。读者群体包括对 AI、LLM和智能体感兴趣的非专业读者,以及关注未来人与AI共存社会的人们。读者可以是本科生、研究生,也可以是研究人员和产业技术人员。本总数不仅希望解答读者对AI与智能体的疑问,还希望激发他们提出新的问题。最终,希望更多人加入我们,共同探索这一充满活力的研究领域。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?