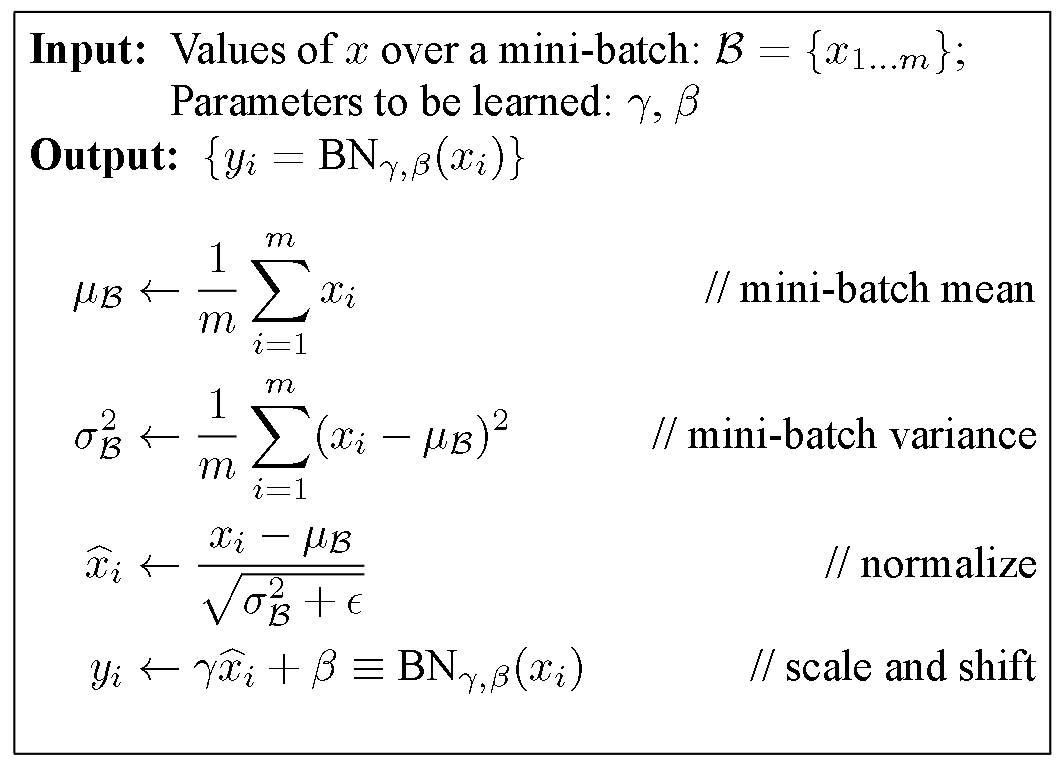

BatchNormalization是神经网络中常用的参数初始化的方法。其算法流程图如下:

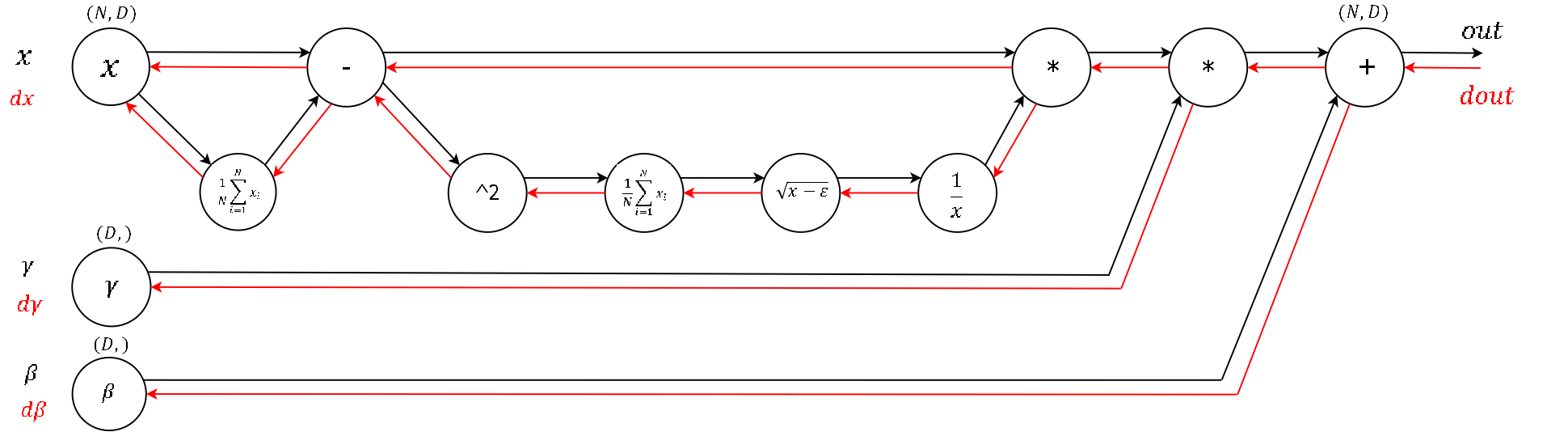

我们可以把这个流程图以门电路的形式展开,方便进行前向传播和后向传播:

那么前向传播非常简单,直接给出代码:

def batchnorm_forward(x, gamma, beta, eps):

N, D = x.shape

#为了后向传播求导方便,这里都是分步进行的

#step1: 计算均值

mu = 1./N * np.sum(x, axis = 0)

#step2: 减均值

xmu = x - mu

#step3: 计算方差

sq = xmu ** 2

var =

BatchNormalization是神经网络中的一种参数初始化技术,通过规范化输入层来加速训练和改进模型性能。文章详细介绍了BatchNormalization的算法流程,并以门电路的形式展开解释前向传播和后向传播过程。在前向传播中,给出了简洁的代码实现;而在反向传播时,强调了求导过程中处理多个支路的加和操作,提示在处理复杂表达式时分步求导的重要性。

BatchNormalization是神经网络中的一种参数初始化技术,通过规范化输入层来加速训练和改进模型性能。文章详细介绍了BatchNormalization的算法流程,并以门电路的形式展开解释前向传播和后向传播过程。在前向传播中,给出了简洁的代码实现;而在反向传播时,强调了求导过程中处理多个支路的加和操作,提示在处理复杂表达式时分步求导的重要性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3350

3350

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?