原文地址:http://blog.csdn.net/gumpeng/article/details/51397737

注:本篇文章也是多个博客的综合整理。

1、决策树基本问题

1.1 定义

我们应该设计什么的算法,使得计算机对贷款申请人员的申请信息自动进行分类,以决定能否贷款?

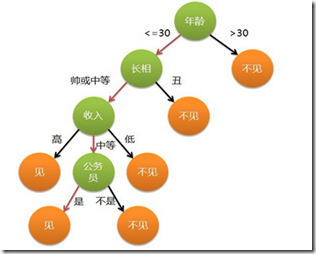

一个女孩的母亲要给这个女孩介绍男朋友,于是有了下面的对话:

女儿:多大年纪了?

母亲:26。

女儿:长的帅不帅?

母亲:挺帅的。

女儿:收入高不?

母亲:不算很高,中等情况。

女儿:是公务员不?

母亲:是,在税务局上班呢。

女儿:那好,我去见见。

决策过程:

这个女孩的决策过程就是典型的分类树决策。相当于通过年龄、长相、收入和是否公务员对将男人分为两个类别:见和不见决策树是一种描述对样本实例(男人)进行分类(见或不见)的树形结构。

决策树由结点和有向边组成。最上部是根节点,此时所有样本都在一起,经过该节点后样本被划分到各子节点中。每个子节点再用新的特征来进一步决策,直到最后的叶节点。叶节点上只包含单纯一类样本(见或不见),不需要在进行划分。

结点两种类型:内部结点和叶结点。

内部结点表示一个特征或属性,叶节点表示一个类。

1.2 熵

首先,我们该选择什么标准(属性、特征)作为我们的首要条件(根节点)对样本(男人)进行划分,决定见或不见呢?——特征选择

母亲希望女儿能最快速的有一个明确的态度,决定见或不见,这样好给男方一个明确的答复。

母亲需要获得尽可能多的信息,减少不确定性。

信息的如何度量?——熵

母亲得到信息越多,女儿的态度越明确,与男方见与不见的不确定性越低。因此,信息量与不确定性相对应。使用熵来表示不确定性的度量。

熵定义:如果一件事有k种可的结果,每种结果的概率为

则我们对此事件的结果进行观察后得到的信息量为:

熵越大,随机变量(见与不见)的不确定性越大。

1.3 条件熵(局部,现象发生的前提下的熵)

条件熵H(Y|X)表示在已知随机变量X的条件下随机变量Y的不确定性。例如,知道男生年龄的前提条件下,根据女儿见与不见的不确定性。

熵与条件熵中概率由数据估计得到时,所对应的熵和条件熵称为经验熵和经验条件熵。若概率为0,令0log0=0

1.4 信息增益

信息增益表示得知特征X(年龄)的信息使得类Y(见与不见)的信息的不确定性减少程度。

特征A对训练数据集D的信息增益g(D,A),定义为集合D的经验熵H(D)与特征A给定条件下的经验条件熵H(D|A)之差

熵H(Y)与条件熵H(Y|X)之差称为互信息,即g(D,A)。

信息增益大表明信息增多,信息增多,则不确定性就越小,母亲应该选择使得信息增益增大的条件询问女儿。

1.5 信息增益准则的特征选择方法

对数据集D,计算每个特征的信息增益,并比较他们的大小,选择信息增益最大的特征。

1.6 信息增益率

信息增益率定义:特征A对训练数据集D的信息增益比定义为其信息增益与训练数据D关于特征A的值的熵HA(D)之比

2 ID3

2.1 ID3 的定义

ID3算法的核心是在决策树各个子节点上应用信息增益准则选择特征,递归的构建决策树,具体方法是:从根节点开始,对节点计算所有可能的特征的信息增益,选择信息增益最大的特征作为节点的特征,由该特征的不同取值建立子节点;再对子节点递归调用以上方法,构建决策树。

直到所有特征的信息增益均很小或没有特征可以选择为止。最后得到一个决策树。

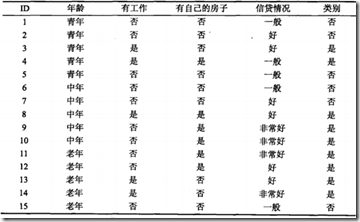

例子:贷款申请样本数据表

根据贷款申请样本数据表,我们有15条样本记录,则样本容量为15。最终分为是否贷款2个类,其中是有9条记录,否有6条记录。有年龄、有工作、有自己的房子和信贷情况4个不同特征。每个特征有不同的取值,如年龄有老、中、青3种取值。

由熵的定义:

计算经验熵:

然后计算各特征对数据集D的信息增益。分别以A1,A2,A3,A4表示年龄、有工作、有自己的房子和信贷情况4个特征。

根据年龄有取值青年、中年、老年。

本文详细介绍了决策树的基础知识,包括熵、信息增益、信息增益率等概念,并对ID3、C4.5、CART算法进行了讲解。此外,还探讨了随机森林的理论和构造过程,以及其在避免过拟合上的优势。通过对这些算法的理解,读者可以更好地掌握决策树及其应用。

本文详细介绍了决策树的基础知识,包括熵、信息增益、信息增益率等概念,并对ID3、C4.5、CART算法进行了讲解。此外,还探讨了随机森林的理论和构造过程,以及其在避免过拟合上的优势。通过对这些算法的理解,读者可以更好地掌握决策树及其应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6418

6418

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?