一、决策树

决策树的学习过程包括三个步骤:

a)特征选择。不同的特征和预测目标具有不同强度的相关性,选择相关性最强的特征能够有效提高预测效果。

b)节点分裂。训练集会在决策树中按照节点规则分流,如果 节点A 没办法给出一个满意的分类结果,那它就会选择分裂,分成 2 个或者多个节点。那么根据什么分裂呢?节点A 会用熵来判断用哪个特征分裂是最优的。

c)剪枝。决策树不加限制地分裂容易产生过拟合现象,剪枝可以一定程度地缓解过拟合,提高泛化能力。

决策树的学习算法有多种,常用的有:ID3,C4.5,CART。下面逐个介绍

1、ID3

前言

1.1计算公式

1.2例子

以如下样本为例:

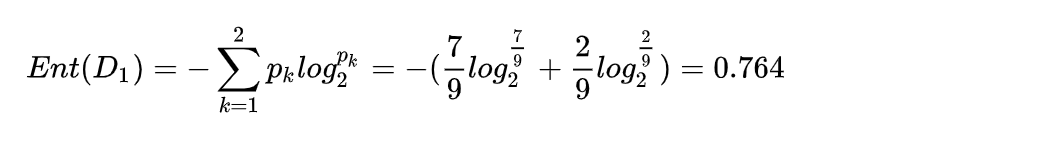

当我们最左侧的纹理清晰的子集D1进行第二次分裂时,可以计算D1的信息熵:

7好2坏

此时对于 D1 子集的触感属性进行属性不同取值区间的信息熵计算得出,当触感硬滑时:

6好0坏

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9454

9454

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?