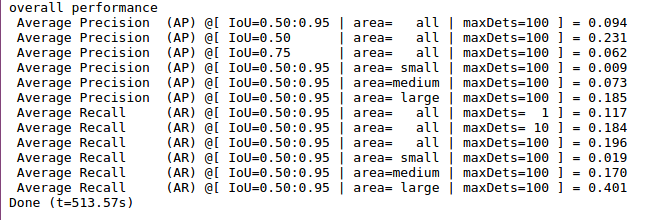

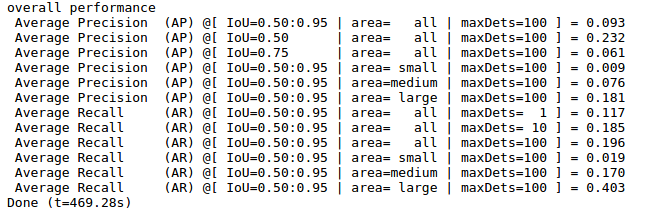

本文主要实验文献文献《Deep Compression: Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffman Coding》算法,在tiny-yolo coco上的压缩效果,在darknet基础上,编写该算法进行压缩实验,结果如下:

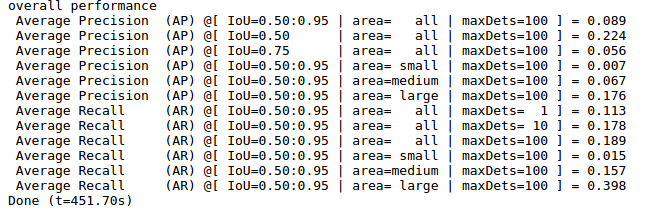

原始模型大小64M:mAP=0.224

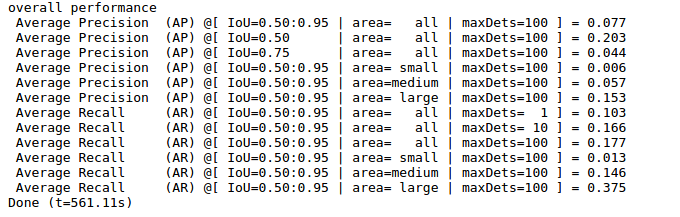

训练500次,模型大小54M:mAP=0.203

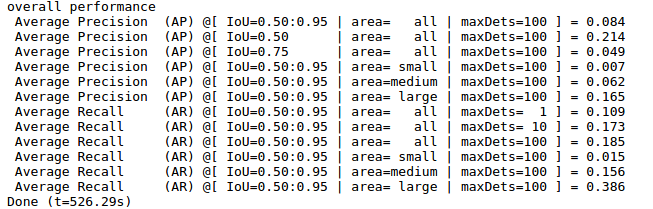

训练5000次,模型大小49M:mAP=0.214

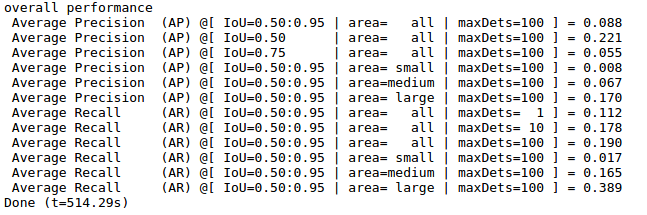

训练50000次,模型大小39M:mAP=0.221

训练100000次,模型大小30M:mAP=0.231

训练180000次,模型大小23M:mAP=0.232

懒得训练了,目前每迭代1500次,下降0.1M,要训练到底,应该是可以压缩到18M左右

3275

3275

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?