[题外话]近期申请了一个微信公众号:平凡程式人生。有兴趣的朋友可以关注,那里将会涉及更多更新机器学习、OpenCL+OpenCV以及图像处理方面的文章。

1、Logistic回归算法的原理

假设现在有一些数据点,我们用一条直线对这些点进行拟合(该线称为最佳拟合直线),这个拟合过程就称作回归。

利用logistic回归进行分类的主要思想是:根据现有数据对分类边界线建立回归公式,以此进行分类。这里的“回归”一词源于最佳拟合,表示要找到最佳拟合参数集。此处的回归公式例如sigmoid函数、reLU函数等。找到最佳的分类回归系数,建立这些函数后,然后利用函数对新的样本数据进行分类。

Logistic回归的一般过程:

1> 收集数据:采用任意方法收集数据。

2> 准备数据:由于需要进行距离计算,因此要求数据类型为数值型。另外,结构化数据格式则最佳。

3> 分析数据:采用任意方法对数据进行分析。

4> 训练算法:大部分时间将用于训练,训练的目的是为了找到最佳的分类回归系数。

5> 测试算法:一旦训练步骤完成,分类将会很快。

6> 使用算法:首先,我们需要输入一些数据,并将其转换成对应的结构化数值;接着,基于训练好的回归系数就可以对这些数值进行简单的回归计算,判定它们属于哪个类别;在这之后,我们就可以在输出的类别上做一些其他分析工作。

Logistic回归的优缺点:

优点:计算代价不高,易于理解和实现。

缺点:容易欠拟合,分类精度可能不高。

适用数据类型:数值型和标称型数据。

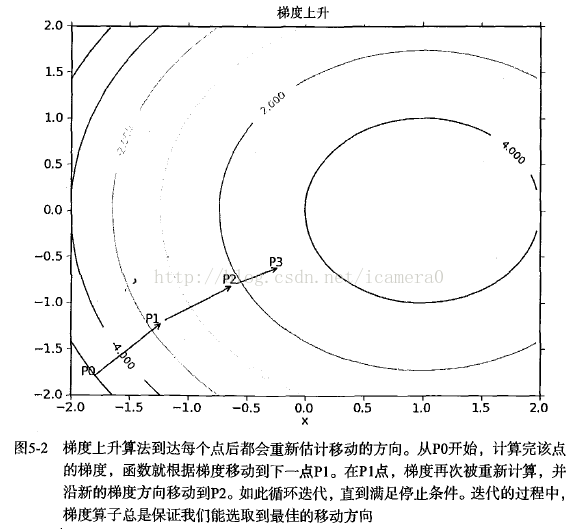

Sigmoid函数公式:

Sigmoid函数具体的计算公式如下:

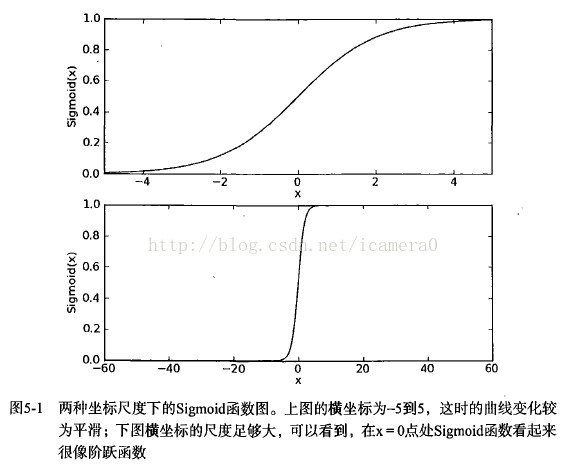

图5-1给出了Sigmoid函数在不同坐标尺度下的两条曲线图。当x为0时,Sigmoid函数值为0.5.随着x的增大,对应的Sigmoid值将逼近于1;而随着x的减小,Sigmoid值将逼近于0。如果横坐标刻度足够大,Sigmoid函数看起来很像一个阶跃函数。

实际上,Sigmoid函数是一种阶跃函数(stepfunction)。在数学中,如果实数域上的某个函数可以用半开区间上的指示函数的有限次线性组合来表示,那么这个函数就是阶跃函数。而数学中指示函数(indicator function)是定义在某集合X上的函数,表示其中有哪些元素属于某一子集A。

为了实现Logistic回归分类器,可以在每个特征上都乘以一个回归系数,然后把所有的结果值相加,将这个总和带入Sigmoid函数中,进而得到一个范围在0~1之间的数值。任何大于0.5的数据被分入1类,小于0.5即被归入0类。所以,Logistic回归也可以被看成是一种概率估计。

Sigmoid函数的输入记为z,由下面公式得出:

z=w0*x0+w1*x1+w2*x2+…+wn*xn

如果采用向量的写法,上述公式可以写成z=wTx,它表示将这两个数值向量对应元素相乘然后全部加起来即得到z值。其中的向量x是分类器的输入数据,向量w也就是我们要找到的最佳参数(系数),从而使得分类器尽可能地精确。

为了寻找最佳参数,需要用到最优化理论的一些知识。本文中使用梯度上升法作为最优化方法。

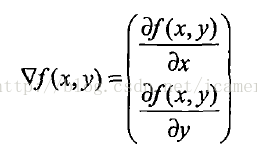

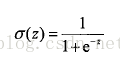

梯度上升法的基本思想是:要找到某函数的最大值,最好的方法是沿着该函数的梯度方向探寻。函数f(x,y)的梯度由下式表示:

这个梯度意味着要沿x的方向移动:

沿y的方向移动:

其中,函数f(x,y)必须要在待计算的点上有定义并且可微。一个具体的函数例子见图5-2。图中梯度上升算法沿梯度方向移动了一步。可以看到,梯度算子总是指向函数值增长最快的方向。这里所说的是移动方向,而未提到移动量的大小。该量值称为步长,记作a。用向量来表示的话,梯度算法的迭代公式如下:

该公式将一直被迭代执行,直至达到某个停止条件为止,比如迭代次数达到某个指定值或算法达到某个可以允许的误差范围。

梯度下降算法与梯度上升算法类似,只是公式中的加号变为减号即可。梯度上升算法用来求函数的最大值,而梯度下降算法用来求函数的最小值。

(未完待续)

3012

3012

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?