SVM是一种二类分类模型,其基本模型定义为特征空间上的间隔最大的线性分类器,其学习策略便是间隔最大化,最终可转化为一个凸二次规划问题的求解

1. 基本原理

SVM方法是通过一个非线性映射p,把样本空间映射到一个高维乃至无穷维的特征空间中(Hilbert空间),使得在原来的样本空间中非线性划分(或回归)的问题转化为在特征空间中的线性划分(或回归)的问题.简单地说,就是升维和线性化.升维,就是把样本向高维空间做映射,一般情况下这会增加计算的复杂性,甚至会引起“维数灾难”.但是作为分类、回归等问题来说,很可能在低维样本空间无法线性处理的样本集,在高维特征空间中却可以通过一个线性超平面实现线性划分(或回归).

2.线性分类

2.1确定超平面

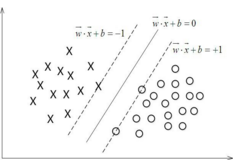

现在有一个二维平面,平面上有两种不同的数据,分别用圈和叉表示。由于这些数据是线性可分的,所以可以用一条直线将这两类数据分开,这条直线就相当于一个超平面

wx′+b=0

,超平面一边的数据点所对应的y全是-1 ,另一边所对应的y全是1

hθ(x)=g(wx′+b)

{1,−1,hθ(x)≥0.5hθ(x)<0.5

2.2 计算几何间距

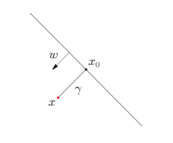

假定对于一个点 x ,令其垂直投影到超平面上的对应点为

x0

,w 是垂直于超平面的一个向量,

γ^=y(w′x+b)=yf(x)

x=x0+γw||w||

γ=w′x+b||w||

γ^=yγ=γ^||w||

几何间隔就是函数间隔除以 ||w|| ,而且函数间隔 y∗(wx+b)=y∗f(x) 实际上就是 |f(x)| ,只是人为定义的一个间隔度量,而几何间隔 |f(x)|||w|| 才是直观上的点到超平面的距离

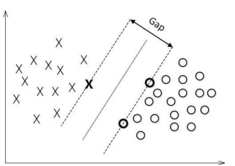

2.3最大间隔分类器

maxγi

yi(w′x+b)=γ^i>γ^

中间的实线便是寻找到的最优超平面(Optimal Hyper Plane),其到两条虚线边界的距离相等,这个距离便是几何间隔,两条虚线间隔边界之间的距离等于2,而虚线间隔边界上的点则是支持向量。由于这些支持向量刚好在虚线间隔边界上,所以它们满足

y(w′x+b)=1

3119

3119

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?