Hadoop分布式环境搭建

环境配置

JDK:java1.8。

这里要保证java环境变量不包含空格,并且java之前环境变量也不包含空格。这里可以用Program Files可以有PROGRA~1代替。例如我的java路径是C:/Program Files/Java/jdk1.8.0_144那么可以用C:/PROGRA~1/Java/jdk1.8.0_144代替。安装java教程看这里。

Hadoop:2.7.3。

- 下载hadoop下载地址

- 解压hadoop到一个文件夹

配置环境变量和java类似

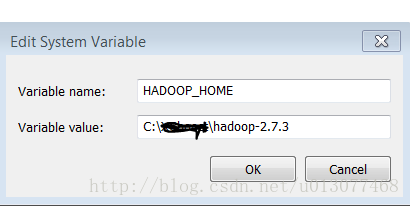

新建HADOOP_HOME变量 地址为C:\xxxx\hadoop-2.7.3,如下图:

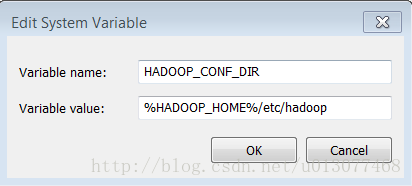

新建HADOOP_CONF_DIR变量 地址为 %HADOOP_PREFIX%\etc\hadoop,如下图:

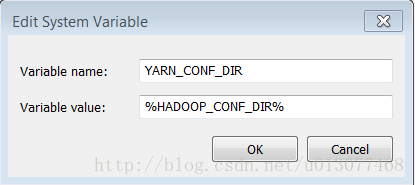

新建YARN_CONF_DIR 变量 地址为%HADOOP_CONF_DIR%,如下图:

PATH添加%HADOOP_HOME%/bin

- 下载winutils相关,hadoop在windows上运行需要winutils支持和hadoop.dll等文件。链接。下载对应版本的就可以,例如我用的是2.7.3,可以直接下载2.7.1的就好。然后把winutils.exe和hadoop.dll复制到hadoop的bin目录下。

hadoop环境配置

首先,进入hadoop文件夹下的etc\hadoop文件夹,文件夹下修改文件:

- 修改core-site.xml为如下代码:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>- 修改mapred-site.xml为如下带啊名:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>- 修改hdfs-site.xml如下:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/c:/hadoop-2.7.1/data/namenode</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/c:/hadoop-2.7.1/data/datanode</value>

</property>

</configuration>- 修改yarn-site.xml为:

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

</configuration>- 修改hadoop-env.cmd,JAVA_HOME设置为 set JAVA_HOME=C:\Java\jdk1.8.0_144,并在尾部添加

set HADOOP_IDENT_STRING=%USERNAME%

set HADOOP_PREFIX=C:\hadoop-2.7.3

set HADOOP_CONF_DIR=%HADOOP_PREFIX%\etc\hadoop

set YARN_CONF_DIR=%HADOOP_CONF_DIR%

set PATH=%PATH%;%HADOOP_PREFIX%\bin- 创建slaves文件,并在其中添加localhost

运行hadoop

- 打开cmd,执行‘hdfs namenode -format’,执行没有报错,说明成功

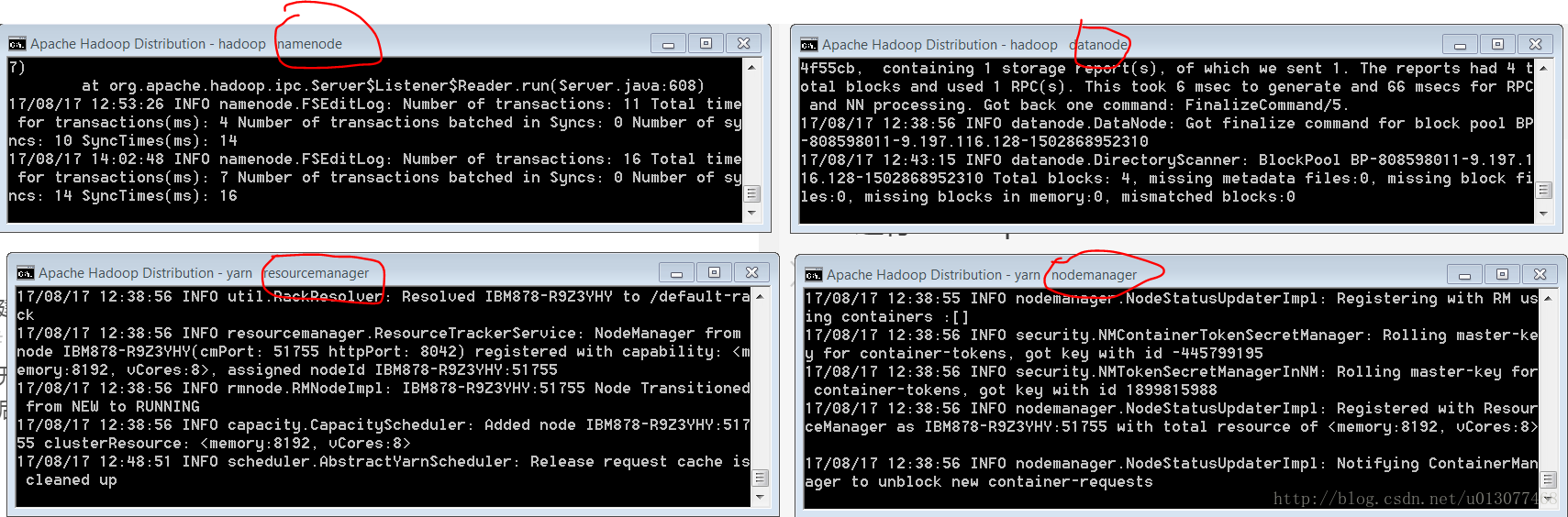

- 然后进入hadoop目录下sbin文件夹,双击start-all.cmd,得到如下图所示四张图:

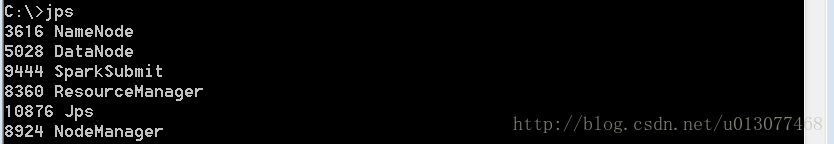

namenode,datanode,resourcemanager,nodemanager四个进程。则启动成功。

打开cmd输入jps可以看到:

GUI

Resourcemanager GUI 地址 – http://localhost:8088:

Namenode GUI 地址 – http://localhost:50070

参考文献

http://blog.csdn.net/fly_leopard/article/details/51250443

http://toodey.com/2015/08/10/hadoop-installation-on-windows-without-cygwin-in-10-mints/

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?